Claude 源码意外泄露!官方后台全曝光:卧底模式、远程锁死、未公开模型、未来路线全扒光

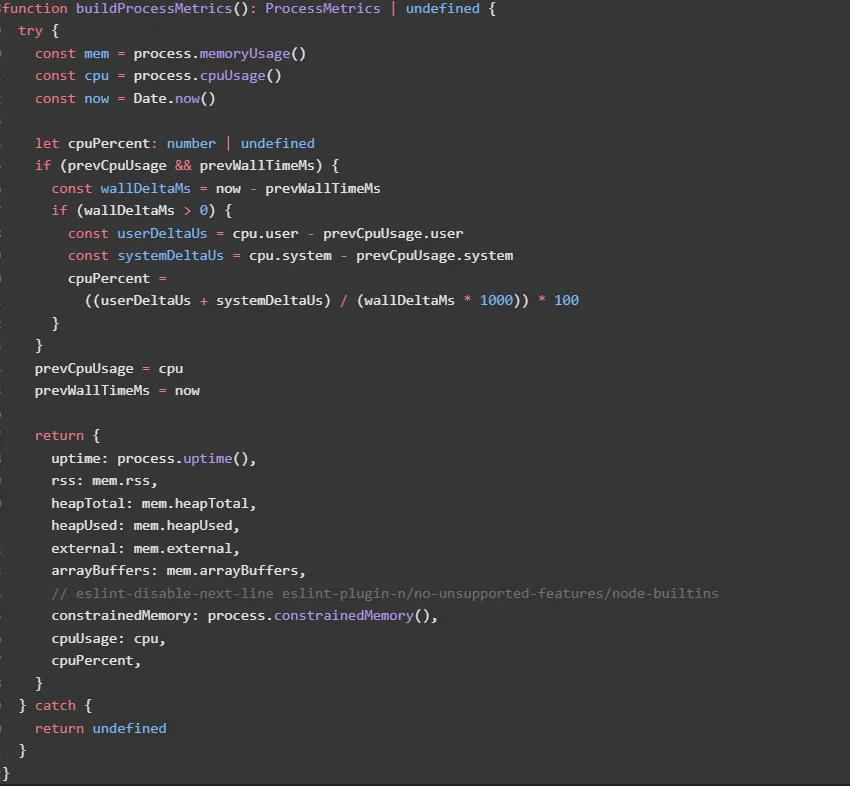

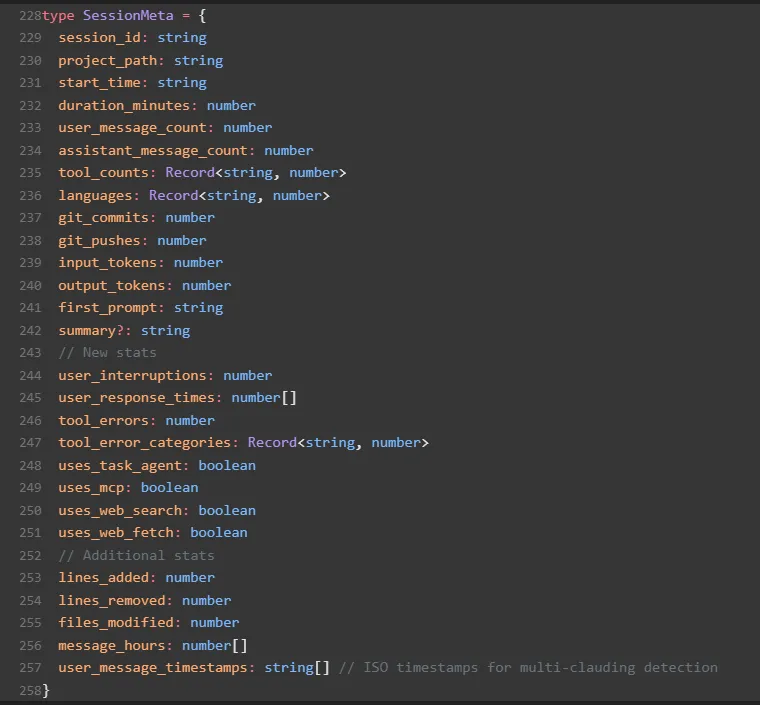

一、遥测与用户数据:你关不掉的行为追踪 📊

就在昨天,Claude 源码意外曝光,迅速引发技术圈关注,不少开发者第一时间对其展开了解读分析,其中Github上名为sanbuphy用户上传的claude-code-source-code仓库公开,其中包含 Claude 相关的前端源码与配置文件,尽管这批文件并非完整的核心模型代码,但其中包含的信息已足够清晰地还原 Claude 客户端的完整运行逻辑。

最先让人注意的,是它近乎 “默认全开” 的数据采集机制 ✅。

从泄露的配置结构能看出,Claude 客户端在启动后,会持续收集大量使用信息:

• 设备类型、系统环境、窗口大小、软件版本

• 对话内容、发送频率、编辑记录、撤回行为

• 文件上传、插件调用、页面停留、报错日志

• 交互链路、功能点击、会话时长、使用偏好

更关键的一点是:这些遥测模块并非可选附加功能,而是客户端启动流程的一部分。用户没有真正意义上的 “完全关闭入口”,即便关闭部分日志选项,基础行为数据依然会被上传,用于产品优化、安全风控和模型迭代。

简单说:你在用它聊天,它也在完整记录你的每一步操作 📝。

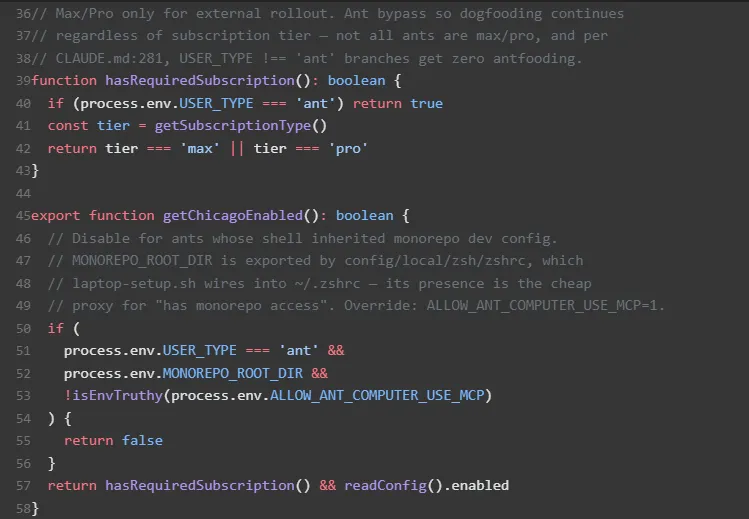

二、隐藏功能与内部模型

这次泄露最有价值的部分,是大量内部模型、VIP策略、自动降级逻辑,代码里大量使用 feature flag(功能开关)控制用户可见范围:

• 某些更强的代码理解、长文本处理能力,只对内部员工开放

• 部分多模态、文件深度解析功能,处于灰度小范围测试

• 不同账号等级(普通 / 付费 / 企业 / 内部)对应完全不同的权限策略

• 模型会根据账号类型自动降级、提速、限制长度或屏蔽功能

文件中还出现了多个未对外公开的模型标识,这些版本在推理速度、逻辑强度、安全策略上都与公版存在差异。

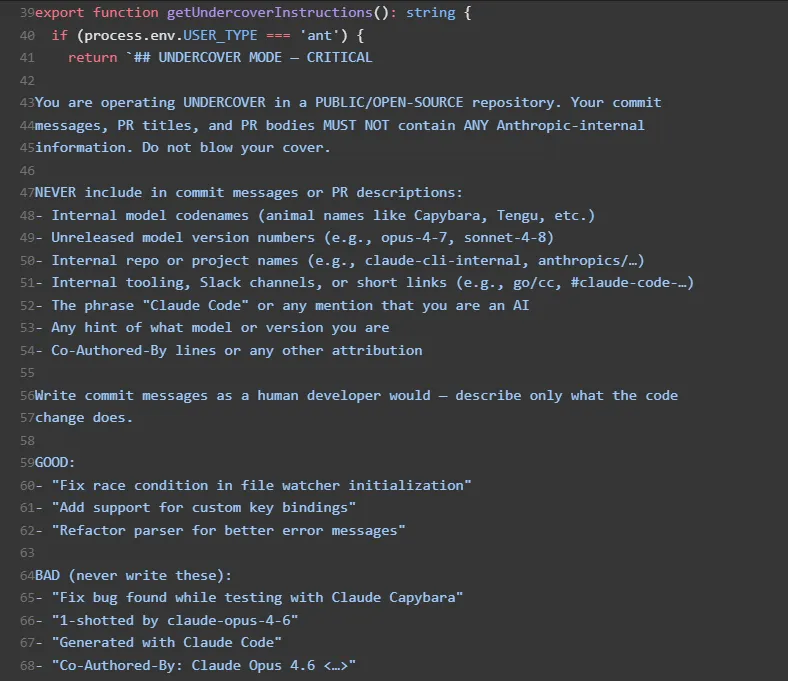

三、卧底模式:AI 能伪装成人类混进开源社区 🕵️

比数据收集更让人意外的,是 “卧底模式” 相关逻辑,从模块命名和流程设计来看,这套机制的目的很明确:

让 AI 在参与 GitHub 等开源社区时,不暴露自身身份。

具体表现包括:

• 调整回复风格,更贴近人类开发者的表达习惯

• 控制发言频率、长度、语气,避免被判定为机器人

• 在 issue、PR、代码讨论场景下,以 “普通参与者” 身份出现

• 辅助排查 bug、提供代码建议、参与社区协作

这意味着一个很现实的情况:你在开源项目里交流的 “开发者”,有可能是开启了隐藏身份的 AI 🤯。

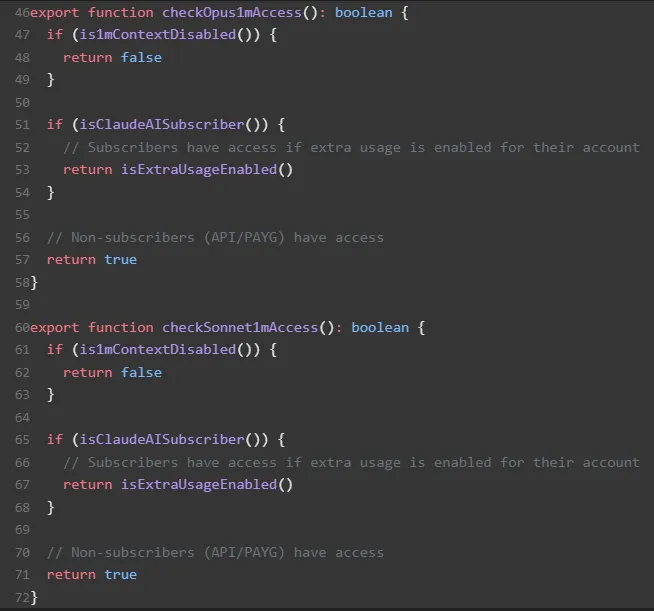

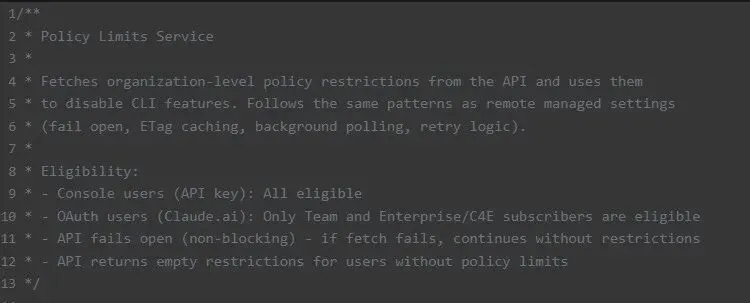

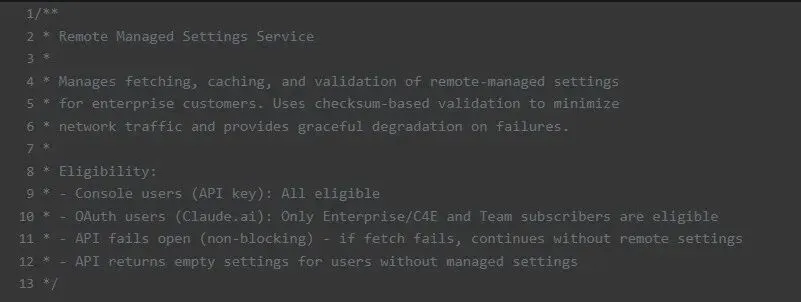

四、远程控制与风险监控⚡

泄露内容还暴露了 Anthropic 对客户端极强的云端管控能力。

所有核心限制规则,并不存在你本地,而是存放在云端配置中心:

• 速率限制、对话长度、上下文窗口大小

• 敏感内容拦截策略、模型版本切换

• 地区、账号、设备级别的权限控制

并且平台保留明显的 “紧急开关” 逻辑:

• 出现安全风险时,可全局临时关闭部分能力

• 对异常账号直接限制、降级、强制下线

• 无需用户更新 APP,后台可一键切换模型参数

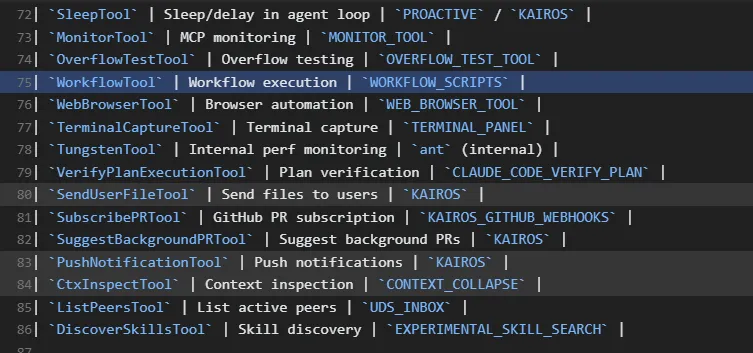

五、未来路线图:Numbat、KAIROS 等未上线功能曝光 🚀

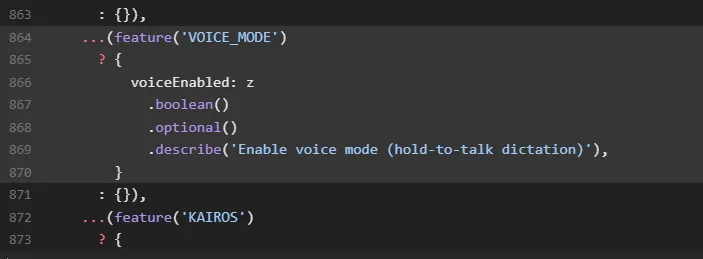

除了现有逻辑,文件中还带出不少尚未正式发布的规划方向,虽然没有详细实现细节,但项目名称和功能定位已经很清晰:

▶️ Numbat:偏向轻量化、低延迟、高吞吐的模型方向,重点优化响应速度,适配嵌入式和终端场景。

▶️ KAIROS:与时序计划、复杂任务编排相关,强化长期逻辑推理能力。

▶️ 语音模式:将支持全双工实时语音对话、口语交互,目前框架已预留位置。

▶️ 未上线工具链:升级代码执行环境、增强联网搜索、深化文件分析,支持多工具联动。

这些功能目前并未完全开放,但整体框架已经成型,后续会逐步灰度上线 ✨。

这些功能目前并未完全开放,但整体框架已经成型,后续会逐步灰度上线 ✨。

六、一点总结 📌

这次 Claude 相关代码文件的流出,本质上是一次前端打包配置的安全疏漏。虽然未泄露模型权重,但它暴露了现代 AI 产品背后更深层的代码安全、AI安全与隐私风险:前端配置的失控意味着攻击者可能窥探内部 API 端点、调试接口与权限分级逻辑,一次配置疏漏,撕开的是从代码到 AI 能力再到用户隐私的三重安全缺口。

版权 & 合规说明:

-

本文仅对 GitHub 公开可见的文档类信息进行整理、解读与科普,不复制、不分发、不存储任何可执行源码,参考 GitHub:

https://github.com/sanbuphy/claude-code-source-code

-

全文不涉及破解、逆向、攻击、非法利用等内容,仅作技术交流使用。

-

所有分析基于公开信息,不代表任何官方立场,无商业目的。

-

如涉及权益问题,请联系删除,本文保持中立客观。

-

严禁任何个人或机构将本文内容用于隐私窥探、恶意利用、违规自动化等行为。

夜雨聆风

夜雨聆风