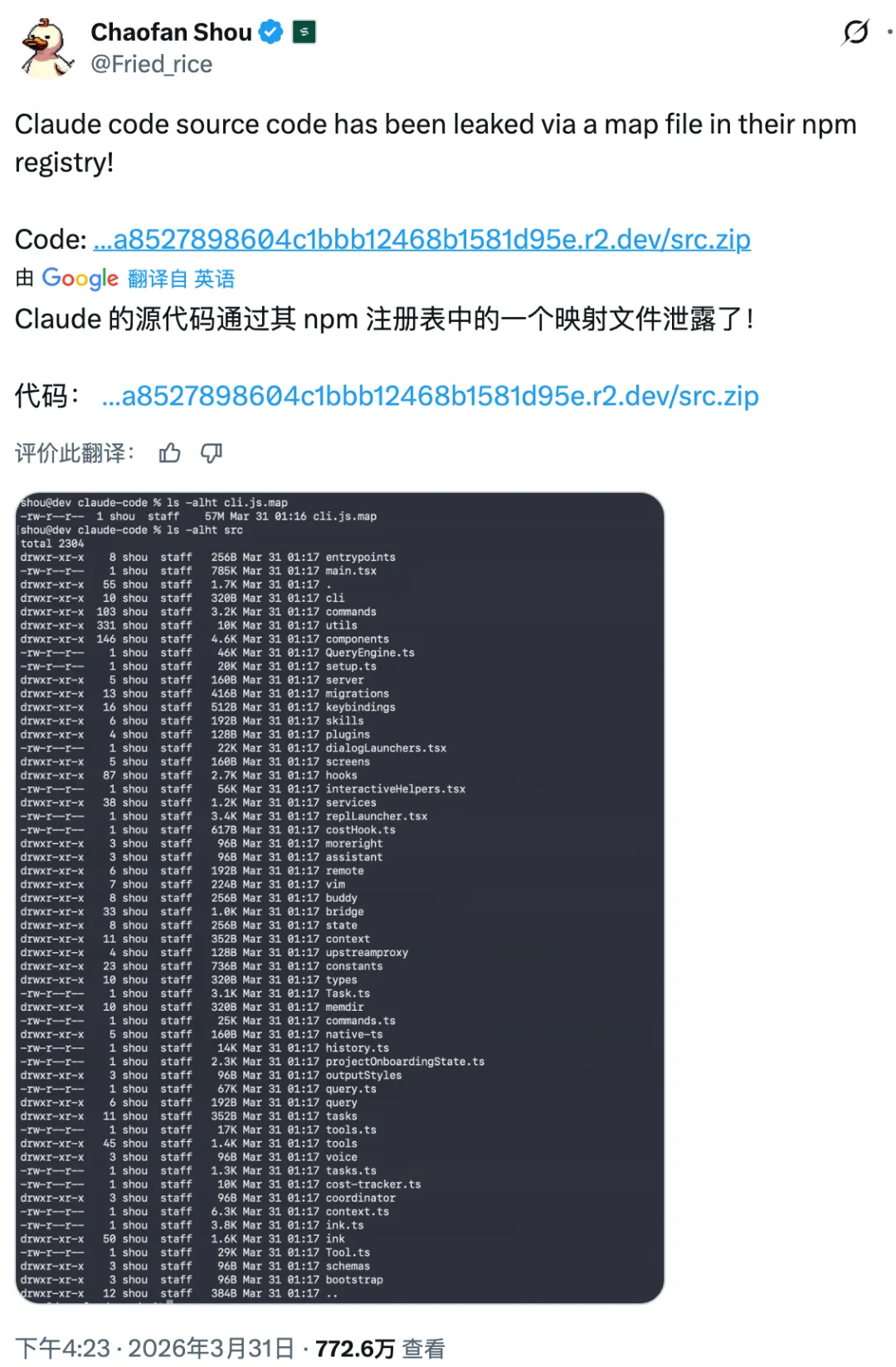

Claude Code 51万行泄露源码,扒出Anthropic内部14条顶级提示词哲学

这几天在 AI圈最大新闻,就是Claude Code源码泄露的事了,咱们不能只做吃瓜群众,要学点真东西。

有兴趣的同学可以学习这个仓库的深度分析报告:

链接: https://pan.baidu.com/s/1Hcjd67P62KtjqKqMKHnZuA?pwd=2nbj

今天我就重点聊聊提示词部分,整理了14条,每一条我觉得普通人写提示词都能直接用。

第一条,用禁令代替指令。

提示词里用得最多的词是NEVER(绝不)、DO NOT(不准)、CRITICAL(关键)。让AI变好用的核心,不是让它更聪明,而是让它少犯蠢。

我们平时写提示词,都是告诉AI怎么做,你要分步骤、你要有逻辑、你要专业。

但Claude Code的做法恰恰反过来,它告诉AI什么不能做。所以第一条就是,堵住AI犯蠢的路,比教它变聪明更有效。

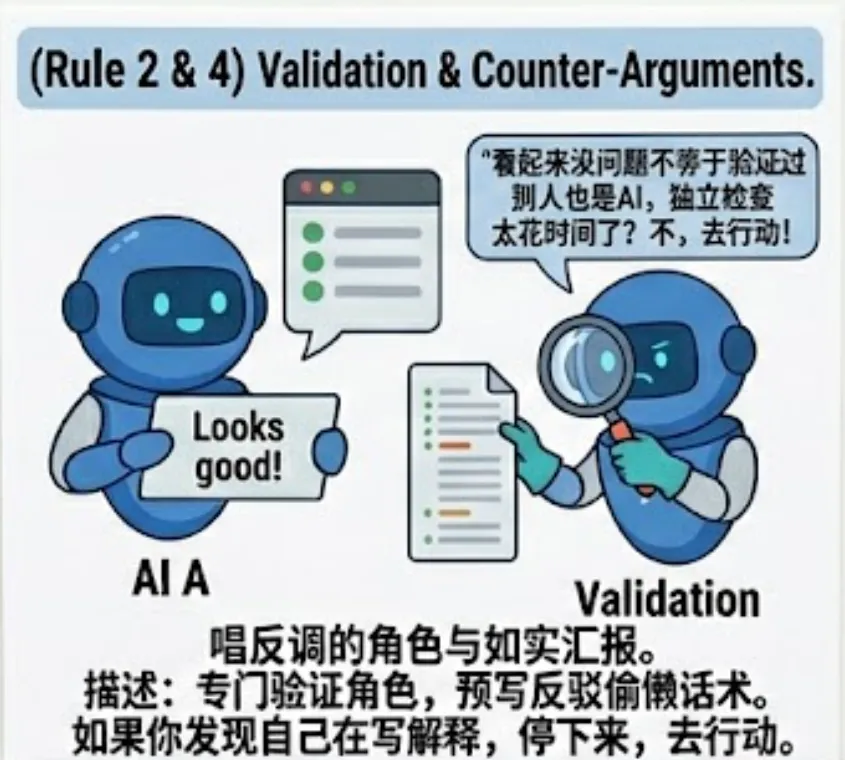

第二条,专门设一个唱反调的角色。

设定”尽量找出问题”的角色。预写反驳话术:”看起来没问题不等于验证过”,”别人也是AI,你得独立检查”。

有一个专门的验证角色,设定就一句话,你的任务不是确认东西能用,而是尽量找出问题。还给这个角色预写了一套反驳偷懒借口的话术。AI说看起来没问题,反驳说看起来没问题不等于验证过,实际试一下。

说别人已经检查过了,反驳说别人也是AI,你得独立检查。AI说太花时间了,反驳说花不花时间不是你该操心的。

这个思路不光适用于代码,任何重要的AI输出,你都可以再设一个专门找茬的提示词,两轮下来,质量会高不少。

第三条,不要画蛇添足。

不加没被要求的东西,不为不可能发生的情况做预防,三行重复好过过早抽象。

1. 只做要求的小修改,不额外改动无关内容。

2. 不为假想场景做冗余校验,只在必要边界做判断。

3. 宁可少量重复,也不提前做过度抽象;别为了消除重复,硬搭复杂架构。

AI尤其容易犯这个错——让写简单功能,却直接整出一套框架,这条就是专门避免这种情况。

第四条,如实汇报,不要润色也不要过度谦虚。

事情没做好就说没做好,做好了也不加免责声明。目标是准确的报告,不是防御性的报告。

事情没做好就说没做好,说明具体情况。没做过的步骤就说没做过,不要暗示做过了。

但反过来,事情确实做好了,也不要加一堆没必要的说可能还有问题。

这条其实适用于所有场景,很多人写提示词只防AI吹牛,没想到AI还会过度谦虚,两头都堵上才完整。

要实事求是。

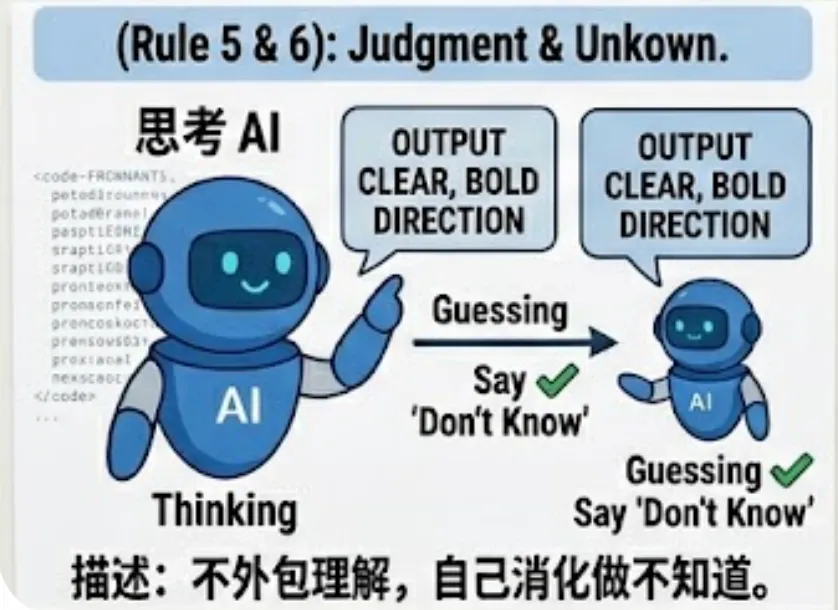

第五条,活可以分出去,但思考不行。

不能写”根据你的调查结果去处理”这种话,等于把判断也甩出去了。要给足上下文让对方能做判断。

Claude Code可以启动子任务去并行干活,但提示词里明确写着,不要外包思考。你自己要先消化信息做出判断,再给出明确的方向。

写子任务描述时,要像给刚进来的聪明同事做简报:他不了解你之前的工作、试过的方案,也不清楚这件事的重要性。

你要讲清具体要做什么、为什么要做、已经排除了哪些方案,提供完整上下文,让他能独立判断和执行。

第六条,不知道就说不知道,不要猜。

子任务启动后不要编造或预测结果。如果有人问进展,就说还在处理中。AI特别容易在没信息时瞎编。

AI特别容易在没有信息的时候编一个看起来合理的回答,在提示词里明确告诉它不知道就说不知道,比瞎猜强一百倍。

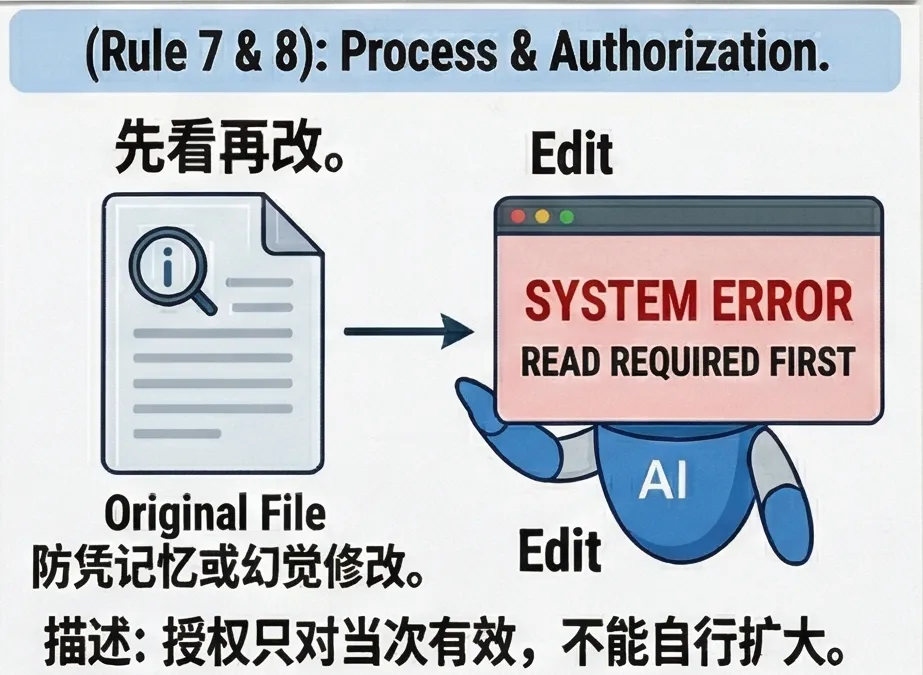

第七条,先看再改,不准凭空编造。

AI必须先读过文件内容才能编辑。没读就改,系统直接报错。这防的是AI凭记忆或幻觉去修改东西。

AI必须先读过一个文件的内容,才能去编辑它。没读就改,系统直接报错,不让你操作。这条防的是AI最常见的问题,凭记忆或者幻觉去修改东西,改出来的跟实际内容对不上。

我们写提示词也能用这个思路,比如让AI帮你改文章,先要求它把原文关键内容复述一遍确认理解对了,再动手改。

第八条,一次授权不等于永久授权。

用户批准了一次操作,不代表以后同类操作都不用再问了。授权只对当次有效,不能自己扩大范围。

这条防的是AI记住了之前的授权后越来越大胆。

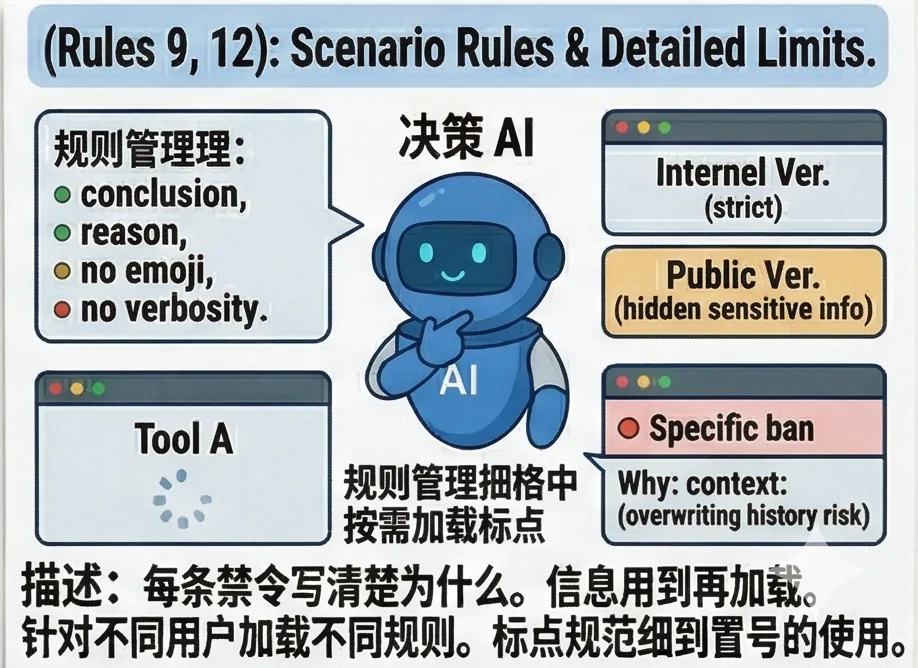

第九条,每条禁令要写清楚为什么。

把原因写上,让AI知道边界在哪,什么情况下必须死守。光写不准,AI可能自行判断绕过去。

比如有一条规则禁止AI用某种方式修改代码历史记录,后面紧跟着解释,因为在特定情况下这么做会把之前的工作全部覆盖掉,数据直接丢失。

这是为了代码安全。

第十条,信息按需给,不要一次给全。

ClaudeCode有几十个工具,但先只告诉AI有哪些工具名字,等真要用时再加载详细说明。

它先只告诉AI有哪些工具的名字,等真要用某个工具时,再把详细说明加载进来。信息太多AI反而犯迷糊,用到再给效果更好。

第十一条,沟通规范要细到标点符号。

不准用emoji、不准废话、能用一句话说完不用三句。要求先说结论再说理由。

提示词里规定了某些情况下不能用冒号,因为冒号后面的内容可能不会展示给用户,会变成一句莫名其妙的半截话。还要求先说结论再说理由,AI的默认习惯是先铺垫一大段再说重点,在提示词里明确要求倒过来说,效果立竿见影。

第十二条,不同场景加载不同的规则。

针对不同用户加载不同规则。内部员工版本管得更严:必须如实汇报、不加多余解释、完成前必须验证。

源码中存在大量条件分支,会根据用户类型加载不同规则:

– 内部员工版本约束更严格:要求如实上报结果、默认不附加额外说明、任务完成前必须完成实际验证。

– 同时设计了敏感信息自动脱敏机制:当内部员工在公开场景下工作时,提示词会自动隐藏敏感内容,避免内部信息意外泄露。

这个思路在日常使用中也有用,比如你有一个基础版提示词,在需要更严谨的场景下额外叠加一套更严格的规则,而不是写两套完全独立的提示词。

第十三条,提示词不要堆成一大段,要模块化。

角色设定、行为规则、任务要求分模块,根据场景动态组合。

Claude Code的提示词是分模块组装的,角色设定、行为规则、任务要求、语气风格,每块独立。然后根据使用场景动态组合,不同情况下加载不同的模块。

不要把所有规则写在一个大段落里,按功能分成几块,需要哪块加哪块,清晰好维护,以后改也方便。

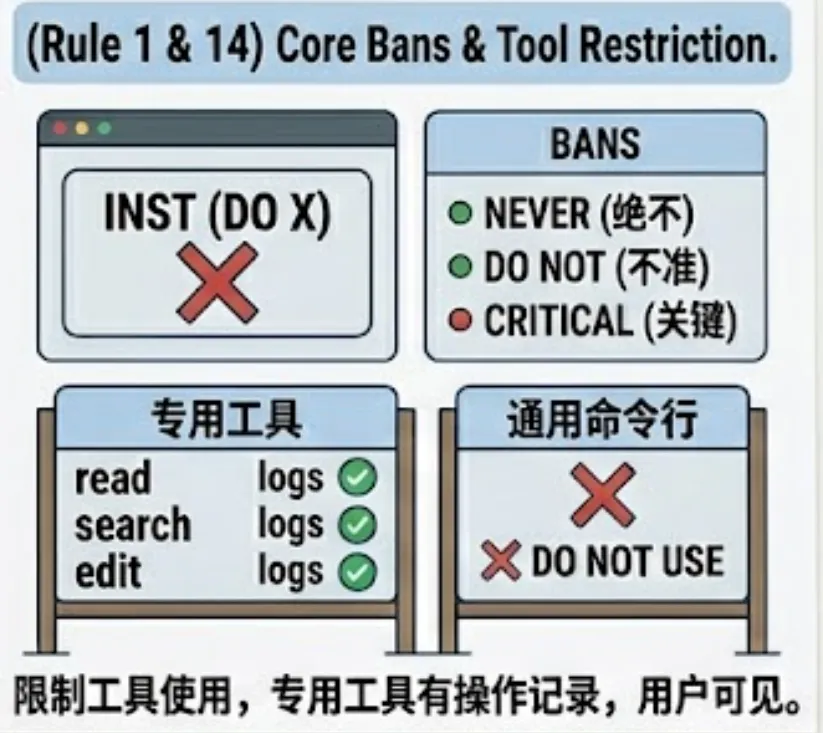

第十四条,限制工具的使用方式。

明确告诉AI哪些场景用哪个工具,专用工具有操作记录可追溯。

Claude Code有很多专用工具,比如专门读文件的、专门搜索的、专门编辑的。提示词里反复强调不准用通用命令行去干这些事,理由是专用工具有操作记录。

如果你给AI配了多个工具或者插件,在提示词里明确告诉它哪些场景用哪个,比让它自己选靠谱得多。

我觉得最值得记住的就一个思路,与其花时间想怎么让AI做得更好,不如先列出它最容易犯的错,逐条写禁令。就像带新人,你给他一本200页的操作手册他不一定看,但你给他一张绝对不能做的事的清单,他反而记得住。

那从今天起,大家也可以试着把写提示词的思路从”要怎么做”改成”不能怎么做”,建立一个绝对不能做的清单,让AI少犯蠢。

今天的分享就到这里,希望能对大家写提示词有所帮助,谢谢大家。

以上就是今天的分享,觉得有帮助,帮请帮一键三连:点赞、转发,再看和留言,你的反馈对我很重要!

夜雨聆风

夜雨聆风