使用这个工具你的AI可以省一半的Token

使用这个工具你的AI可以省一半的Token

最近用Claude Code或者Codex写代码时,我越来越觉得,真正偷偷烧钱的,不是那一两句提示词,而是命令输出。

你让AI跑一次git status,它会把一长串改动状态、路径、提示信息全塞进上下文。你再让它跑cargo test、pytest、docker ps、一堆重复日志、通过项、样板提示、进度条又继续往里灌。项目一大,token就像漏水一样往下掉。

前几天偶然在GitHub上翻到一个开源工具RTK,全名是Rust Token Killer。它干的事不复杂,但很实用:在命令输出进入LLM上下文之前,先做一层压缩,把噪音过滤掉,把重复内容合并掉,把真正有用的结果留下来。

它到底能省多少

如果你只是觉得“省一点点”,那就低估它了。

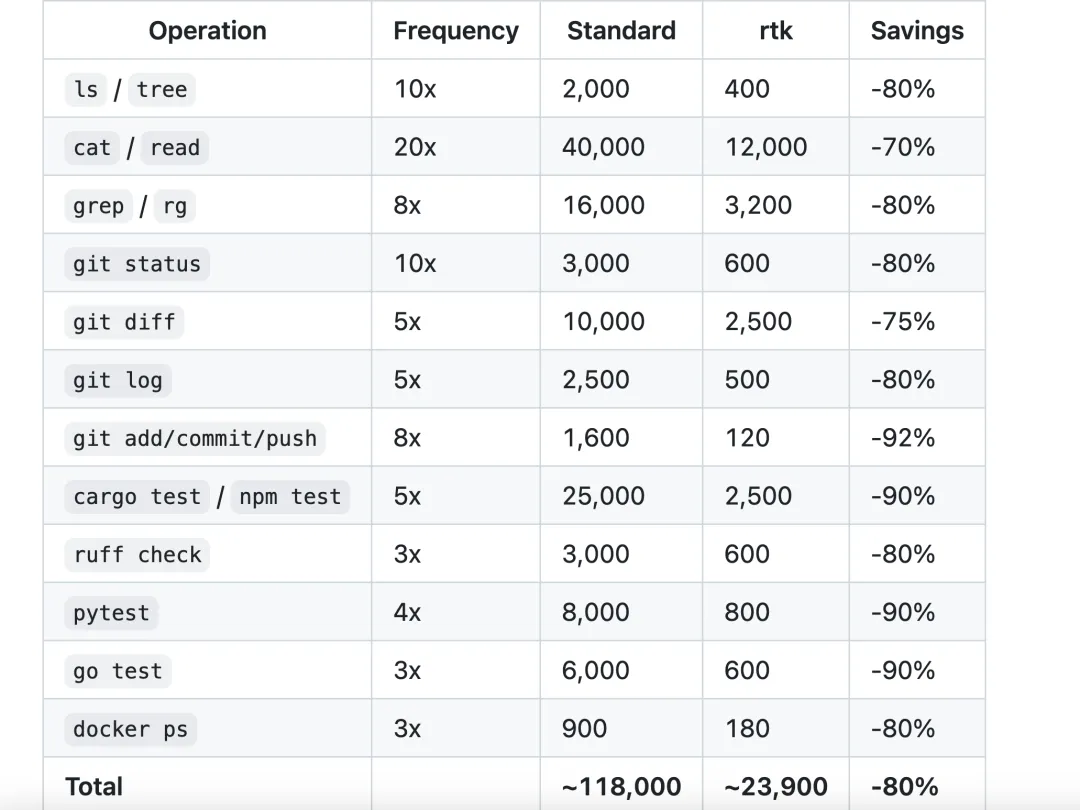

RTK官方README给的估算很直接。在一个30分钟的Claude Code会话里,常见命令的token开销大概能从约118000压到约23900,整体节省接近80%。单看常见场景,git status大约能省80%,cargo test、pytest这类测试命令通常能省90%左右。

|

|

|

|

|

|---|---|---|---|

git status |

|

|

|

git diff |

|

|

|

cargo test

npm test |

|

|

|

pytest |

|

|

|

所以题目里说“省一半”其实已经很保守了。对测试、构建、日志这类高噪音命令来说,很多时候不止一半。下图是官方给的完整对比

它是怎么做到的

RTK的思路非常朴素:不改你的项目,不碰你的模型,只处理命令行输出。

按官方文档,它主要做四件事:

-

智能过滤。去掉注释、空白、样板提示、进度条这类噪音。 -

分组整理。把相似结果按目录、文件或错误类型折叠起来。 -

截断冗余。保留关键上下文,不把几百行重复信息全塞给AI。 -

去重合并。重复日志不再逐行输出,而是变成“某类信息重复了多少次”。

举个最直观的例子。cargo test正常输出里,最占token的常常不是失败信息,而是一大堆“通过了什么”。RTK会优先把失败、错误、警告留下来,把那些对下一步决策帮助不大的内容压缩掉。git status、git log、docker logs、kubectl logs也是同一类问题。

怎么装,怎么接进AI工具里

安装方式有三种,最省事的是:

brew install rtk

或者:

curl -fsSL https://raw.githubusercontent.com/rtk-ai/rtk/master/install.sh | sh

如果你习惯用Cargo安装,官方更推荐这一条:

cargo install --git https://github.com/rtk-ai/rtk

这里要注意一个小坑:crates.io上还有另一个同名的rtk项目。装完之后最好马上跑一下:

rtk --version

rtk gain

只要rtk gain能正常显示token节省统计,说明你装对了。

接入方式也挺简单,但不同AI工具略有区别。

如果你用的是Claude Code,推荐直接执行:

rtk init -g

它会给Claude Code装上Hook,让像git status这样的shell命令在执行前透明改写成rtk git status。你的使用习惯基本不用变。

如果你用的是Codex,对应命令是:

rtk init -g --codex

这个模式不会像Claude Code那样走Hook,而是把规则写到~/.codex/RTK.md和~/.codex/AGENTS.md里,让Codex在执行shell命令时优先使用rtk。

除了Claude Code和Codex,RTK现在还支持Cursor、GitHub Copilot、Gemini CLI、Windsurf、Cline/Roo Code、OpenCode、OpenClaw等工具。官方README里列的是10款已支持的AI编程工具。

平时怎么用

即便你暂时不想接Hook,也可以先手动用起来:

rtk git status

rtk cargo test

rtk pytest

rtk docker ps

rtk kubectl pods

RTK现在已经覆盖了100多个常用命令,除了git、cargo、pytest,还包括docker、kubectl、gh、tsc、ruff、go test、pnpm list、aws这些高频开发场景。

另外我觉得很实用的一个命令是:

rtk gain

它会直接告诉你,自己到底省了多少token。不是“感觉省了”,而是能看到统计结果。

值不值得装

如果你平时只是偶尔让AI写几行代码,这类工具的收益不会特别夸张。

但如果你已经把Claude Code、Codex、Cursor这类工具当成重度生产力工具来用,情况就不一样了。项目越大,命令输出越多,RTK这种“先压缩再喂给模型”的工具就越划算。它不改变你的工作流,改的是上下文里那些本来就没必要出现的噪音。

说白了,这不是一个“看上去很炫”的工具,而是一个很实在的省钱工具。

如果你最近正被AI编程的token消耗搞得有点肉疼,可以直接试一下。保守地说,省一半;按官方给的数据看,很多场景远不止一半。

参考链接

-

RTK GitHub仓库:https://github.com/rtk-ai/rtk -

RTK官网:https://www.rtk-ai.app

夜雨聆风

夜雨聆风