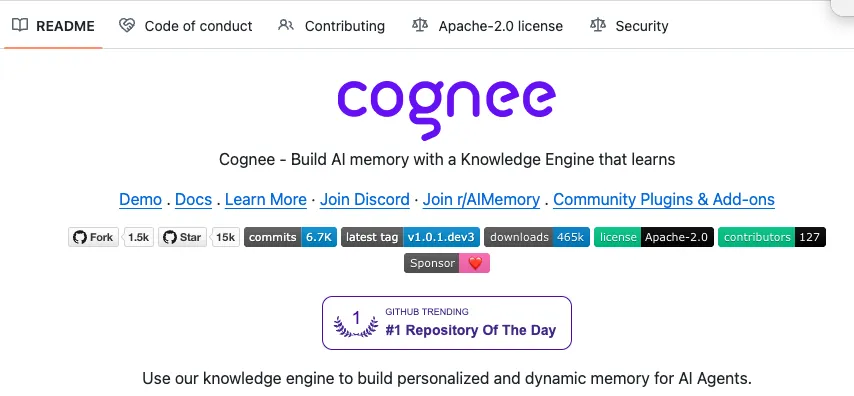

Cognee 火了:6 行代码,给 AI Agent 补上一层“能记住事”的长期记忆

我点进 Cognee 看了一圈,第一反应不是它又做了个 RAG 轮子。

而是它终于开始认真处理一件很烦的事:Agent 明明接了知识库,聊两轮还是像失忆。

这事很多人都踩过坑。

传统 RAG 更像“临时翻资料”,问一次捞一次。文档切块切得散,语义能对上,但上下文经常断。上一轮提过的人、这轮新出现的文件、几段对话之间的关系,检索一乱,Agent 就开始答非所问。

Cognee 处理这个问题的方法,挺直接。

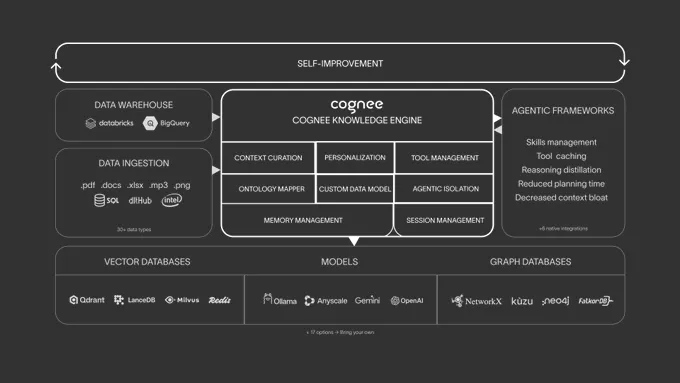

它不是只做向量检索,而是把向量搜索和图数据库放到一起。文档一边保留语义可检索能力,一边把实体、事件、上下游关系串起来,最后变成一个统一记忆层。

这个思路的好处,不在“听上去高级”。

而在于 Agent 终于不只是会搜,还开始有点“记住脉络”的意思了。

我比较在意的还有它的工程味。

整个流程被抽象成 ECL,也就是 Extract、Cognify、Load。名字起得不复杂,但意思很清楚:先把数据抽出来,再做认知整理,最后加载进记忆系统。它想替掉的,不只是传统 RAG 的检索环节,而是一整条记忆构建链路。

而且它没把自己做成一个只适合 demo 的玩具。

Cognee 提供了比较 Pythonic 的数据管道,能接 30 多种数据源,过往对话、文件、图像、音频转写这些都能往里塞。你要给 Agent 补长期记忆,不用再自己东拼西凑一堆 ingestion 脚本。

还有个细节挺加分。

它支持 CLI,也有本地 UI,还兼容 Ollama 本地模型。对不少想先在本地把 Agent 跑顺的开发者来说,这种组合比“云上一键托管”更实在。

当然,6 行代码这件事,看看就好。

真正难的从来不是接进去,而是记忆怎么更新、怎么遗忘、关系图会不会越长越乱。但至少从现在看,Cognee 把“给 Agent 加记忆”这件事,从概念拉回到了能动手试的阶段。

对想搭 Agent 长期记忆系统的人,这项目值得点进去看。

GitHub地址:topoteretes/cognee

夜雨聆风

夜雨聆风