auto-openclaw:让 OpenClaw 拥有操作电脑的能力

在大多数人的印象中,AI 智能体往往只能处理文本任务,无法直接与电脑界面交互。但随着视觉语言模型(VLM)的发展,这种局面正在被打破。今天,我们要介绍的 auto-openclaw 项目,就是一个将 UI-TARS 视觉语言模型与 OpenClaw 集成的创新方案,让 AI 能够像人一样看屏幕、点鼠标、打键盘。

一、 项目简介:让 AI 拥有桌面操作能力

auto-openclaw 是一个基于 UI-TARS Desktop 修改的项目,将其 CLI 作为 OpenClaw 的 skill 接入,实现了 AI 智能体对桌面的自动化操作。通过视觉语言模型的能力,AI 可以理解屏幕内容,然后执行相应的鼠标和键盘操作,完成各种 GUI 任务。

1. 工作原理

auto-openclaw 的工作流程非常清晰:

用户 → OpenClaw → ui-tars skill → UI-TARS CLI → 截屏 → VLM 推理 → 执行操作 → 循环 ↓ JSON Lines 反馈 ← 最终截图 ← 完成

简单来说,当用户向 OpenClaw 下达 GUI 任务时,系统会通过 UI-TARS CLI 截取屏幕,然后将截图发送给视觉语言模型进行分析。模型会根据任务要求和屏幕内容,生成相应的操作指令,如点击、输入文本、滚动等。这些操作会被执行,然后系统会再次截屏,循环这个过程直到任务完成。

2. 核心优势

- 视觉理解

利用 VLM 技术,AI 可以真正”看到”屏幕内容,而不仅仅是基于文本指令 - 自然语言交互

用户可以用自然语言直接下达 GUI 任务,无需编写复杂的脚本 - 跨平台支持

支持 Windows、MacOS 等多种操作系统 - 实时反馈

通过 JSON Lines 格式提供详细的操作反馈 - 易于集成

作为 OpenClaw 的 skill 接入,使用简单方便

二、 安装配置:快速上手指南

要使用 auto-openclaw,需要完成以下几个步骤:

1. 前置要求

在开始安装之前,请确保你的系统满足以下要求:

-

Node.js >= 20 -

pnpm 9.10.0 -

OpenClaw 已安装 -

VLM API(推荐火山引擎 doubao-seed-2-0-pro-260215)

2. 克隆并构建项目

首先,你需要克隆项目代码并进行构建:

git clone https://github.com/yangzhuxinyzx/auto-openclaw.git

cd auto-openclaw

pnpm install

# 按顺序构建

cd packages/ui-tars/shared && pnpm run build && cd -

cd packages/ui-tars/sdk && pnpm run build && cd -

cd packages/ui-tars/operators/nut-js && pnpm run build && cd -

cd packages/ui-tars/cli && pnpm run build && cd -

# 全局链接 CLI

cd packages/ui-tars/cli && npm link构建完成后,可以通过以下命令验证安装是否成功:

ui-tars --version # 应输出 1.2.3

ui-tars start --help # 应显示 --output 选项3. 配置 VLM 模型

接下来,你需要配置视觉语言模型。创建 ~/.ui-tars-cli.json 文件,并填入以下内容:

{

"baseURL": "https://ark.cn-beijing.volces.com/api/v3",

"apiKey": "<你的 API Key>",

"model": "doubao-seed-2-0-pro-260215",

"useResponsesApi": true

}auto-openclaw 支持任何 OpenAI 兼容的视觉语言模型 API,你可以根据自己的需求选择合适的模型。

4. 接入 OpenClaw

最后,将 skill 文件复制到 OpenClaw workspace:

mkdir -p ~/.openclaw/workspace/skills/ui-tars

cp skills/ui-tars/SKILL.md ~/.openclaw/workspace/skills/ui-tars/OpenClaw 会自动发现并加载这个 skill,无需额外配置。

三、 使用方法:让 AI 帮你操作电脑

安装配置完成后,你就可以在 OpenClaw 对话中直接下达 GUI 任务了。

1. 基本使用

在 OpenClaw 对话中,你可以直接用自然语言下达各种 GUI 任务,例如:

-

打开浏览器访问抖音 -

打开微信搜索某某发一条消息 -

打开记事本输入 Hello World

OpenClaw 会通过 auto-openclaw skill 来理解和执行这些任务。

2. 手动测试

如果你想单独测试 UI-TARS CLI 的功能,可以使用以下命令:

ui-tars start --target nut-js --query "点击桌面空白处" --output json3. 高级参数

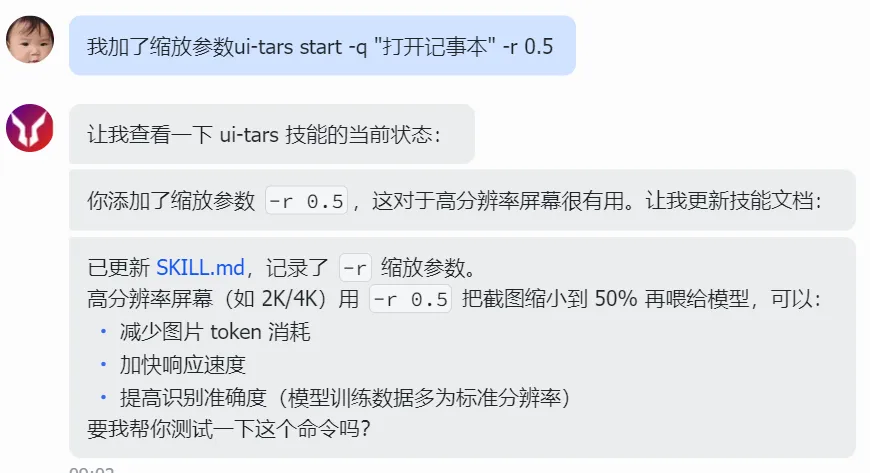

UI-TARS CLI 提供了一些高级参数,帮助你更好地控制任务执行:

-r, --resolution-scale <scale>

截图分辨率缩放比例(0.1-1.0),例如 0.5 表示半分辨率 -

用途:降低分辨率可以减少截图大小,加快模型推理速度,特别适合性能较低的设备 -

默认值:1(全分辨率)

--max-pixels <pixels>

图像预处理的最大像素数(默认值取决于模型版本) --max-image-length <count>

发送给模型的历史图像最大数量(默认:5)

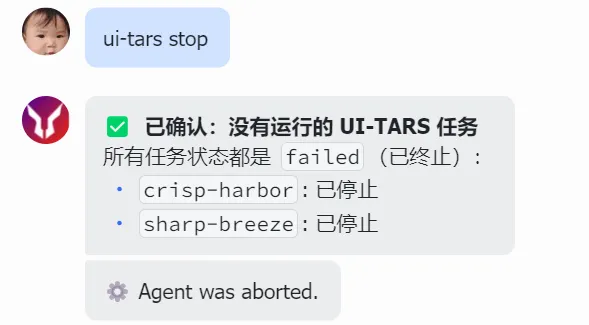

4. 停止任务

如果你需要中途停止正在执行的 UI-TARS 任务,可以使用 stop 命令:

ui-tars stop

这个命令会终止正在运行的 UI-TARS 进程,并清理相关的 PID 文件。

5. 输出格式

auto-openclaw 使用 JSON Lines 格式输出操作过程,每行一个事件:

|

|

|

|

|---|---|---|

screenshot |

|

loop

width, height |

prediction |

|

action_type

thought, action_inputs |

error |

|

message |

done |

|

status

summary, screenshotPath |

退出码:0 成功 / 1 出错 / 2 需人工 / 3 用户中止

四、 技术实现:相对原版的改动

auto-openclaw 基于 UI-TARS Desktop v0.3.0-beta.11 修改,主要做了以下改动:

- packages/ui-tars/cli/

— 新增 --output json结构化输出、退出码、操作摘要、最终截图保存,新增stop命令,新增-r分辨率缩放参数 - packages/ui-tars/operators/nut-js/

— type 操作剪贴板 fallback、scroll 改进、wait 缩短

这些改动使得 UI-TARS CLI 更加适合作为 OpenClaw 的 skill 使用,提供了更清晰的操作反馈和更稳定的执行效果。

五、 应用场景:auto-openclaw 的潜力

auto-openclaw 可以应用于多种场景,为用户提供便利:

1. 日常办公自动化

-

自动填写表单 -

批量处理文件 -

自动化数据录入 -

定时执行重复性任务

2. 软件测试

-

自动化 GUI 测试 -

模拟用户操作流程 -

发现界面 bug

3. 个人助手

-

帮助用户完成复杂的电脑操作 -

提供可视化的操作指导 -

解放用户的双手,让电脑操作更加轻松

六、 总结

auto-openclaw 项目通过将 UI-TARS 视觉语言模型与 OpenClaw 集成,实现了 AI 智能体对桌面的自动化操作。这是 AI 技术在桌面自动化领域的重要应用,为用户提供了一种全新的与电脑交互的方式。

通过 auto-openclaw,用户可以用自然语言直接下达 GUI 任务,而无需关心具体的操作步骤。AI 会通过视觉理解屏幕内容,然后执行相应的操作,完成任务。这种方式不仅提高了工作效率,也降低了用户的操作门槛。

未来,随着视觉语言模型的不断发展,auto-openclaw 有望支持更复杂的桌面操作任务,为用户带来更多便利。如果你对 AI 桌面自动化感兴趣,不妨尝试一下 auto-openclaw,体验 AI 操作电脑的神奇能力。

致谢

-

UI-TARS Desktop — ByteDance 开源的 GUI Agent 桌面应用(Apache-2.0) -

OpenClaw — 开源自托管 AI Agent

License

Apache-2.0(继承自 UI-TARS Desktop)

夜雨聆风

夜雨聆风