DeepSeek V4:AI从"对话工具"到"智能系统"的分水岭,OpenCSG已上线

今天,当 DeepSeek V4 正式上线并开源的消息传来,很多人的第一反应可能是:“又一个更强的模型?”但如果你真正理解这次发布的意义,就会发现——这不是一次简单的性能迭代,而是一场 AI 基础设施的范式革命。

一个被低估的里程碑

DeepSeek V4 带来了三个关键突破:

百万级上下文(1M Token) —— 这意味着 AI 第一次真正具备了“读完一本书再思考”的能力。不再是碎片化的对话,而是跨系统、跨时间、跨数据源的持续推理。

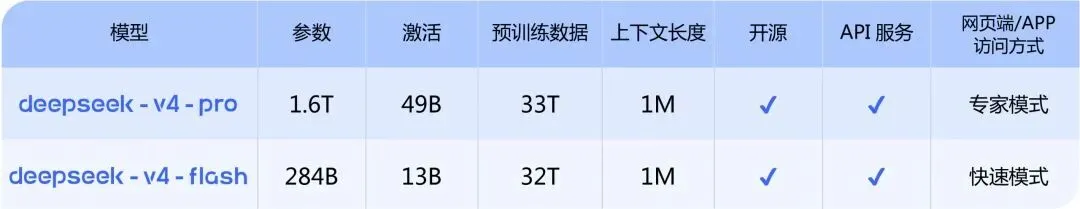

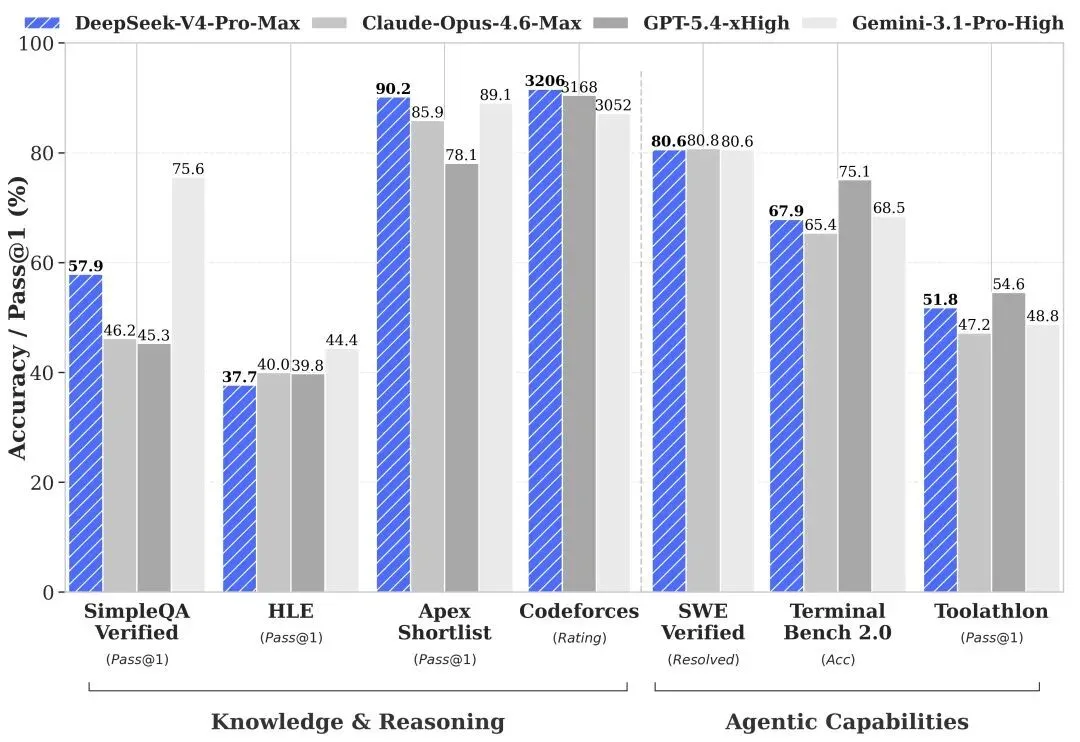

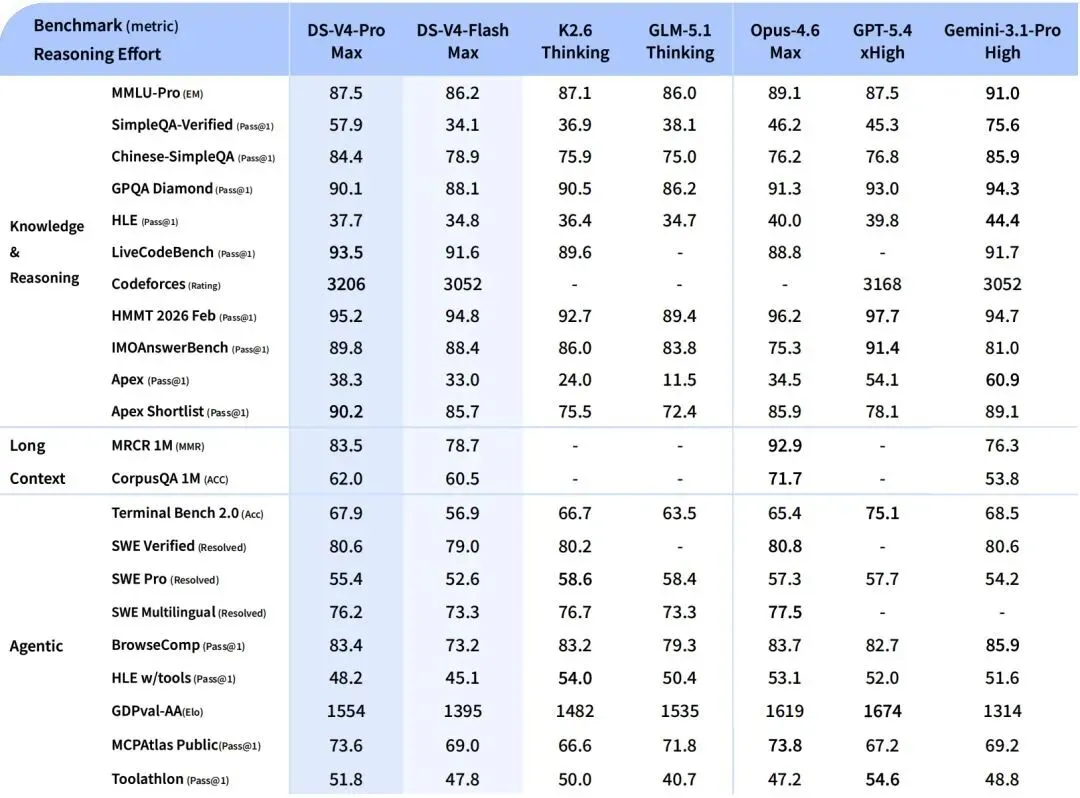

超大规模 MoE 架构(1.6T 参数/49B 激活) —— 在保持极致效率的同时,实现了性能的质的飞跃。DeepSeek V4-Pro 在多项基准测试中已经比肩 GPT-4o 和 Claude Sonnet 3.5 等顶级闭源模型。

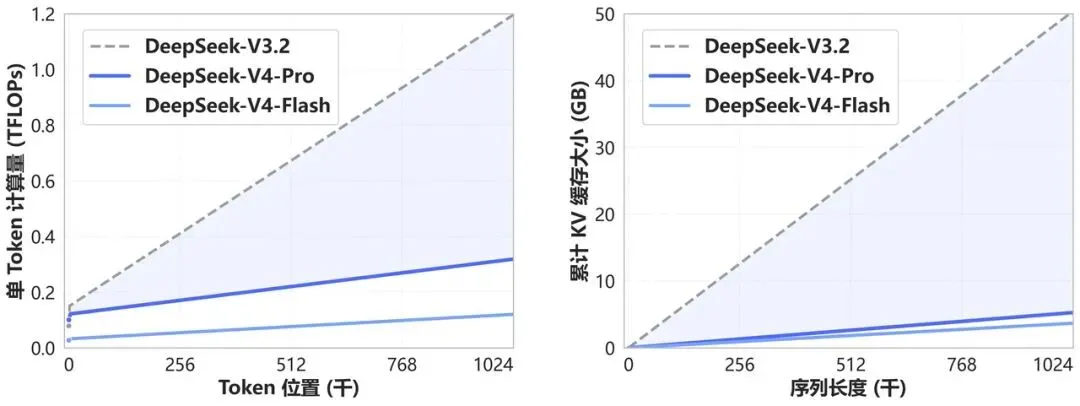

极致的推理效率优化 —— 通过创新的 CSA(压缩稀疏注意力)和 HCA(重度压缩注意力)机制,DeepSeek V4 将计算量(FLOPs)降低至传统方法的 27%,KV Cache 降至 10%。这不是微调,而是结构性突破。

这三个突破叠加在一起,意味着什么?意味着 AI 正在从 Chat(对话)→ Copilot(助手)→ Agent(智能体)→ Persistent Intelligence(持续智能)完成关键跃迁。

技术革命的本质:让“不可能”变成“标配”

过去,长上下文一直是 AI 的能力瓶颈。处理超长文本不仅计算成本呈指数级增长,而且模型的注意力机制会随着上下文长度的增加而急剧衰减。这就像让一个人同时记住一百本书的内容再回答问题——理论上可能,实际上不可行。

DeepSeek V4 通过技术创新,把“上下文长度”从能力瓶颈变成了基础能力。其核心思路是:用“压缩+稀疏”替代“全量计算”。

想象一下,当你阅读一本小说时,你不需要逐字逐句地记住每个细节,而是会自动提取关键情节、人物关系和核心主题。DeepSeek V4 的注意力机制正是模仿了这种人类的认知方式——在 token 维度进行智能压缩,结合稀疏注意力,既保留了关键信息,又大幅降低了计算负担。

这带来了两个直接的变化:

长任务不再意味着成本爆炸 —— 企业终于可以让 AI 处理真实世界的复杂流程,而不用担心天价账单。

Agent 可以处理真正的“长链条任务” —— 从需求分析、方案设计、代码实现到测试部署,AI 可以像人类工程师一样完成完整的工作流。

Agent 时代的“操作系统级模型”

如果用一句话总结 DeepSeek V4 的定位,那就是:Agent 时代的操作系统级模型。

为什么这么说?因为 DeepSeek V4 解决了 Agent 落地的三大核心问题:

1. 长上下文 = Agent 的原生记忆系统

过去,Agent 最大的痛点是“没有长期记忆”。每次对话都是新的开始,无法积累经验,无法处理复杂的多步骤任务。现在,百万 token 的上下文能力,等价于给 Agent 装上了一个原生的 Memory Layer。它可以记住整个项目的历史、理解完整的业务逻辑、追踪长期的任务进展。

2. 高效率 = 商业化的可行性

传统的长上下文模型有一个致命问题:成本太高。企业即使想用,也会因为天价的推理成本而望而却步。DeepSeek V4 通过将 FLOPs 降低 73%、KV Cache 降低 90%,直接打开了企业落地的空间。这不是锦上添花,而是决定生死的关键。

3. MoE 架构 = 天然的多专家系统

DeepSeek V4 的 MoE(混合专家)架构,天然契合 Agent 体系的设计理念。不同的专家模块对应不同的 Agent 能力,路由机制就是 Agent Orchestration(编排)。这种架构让模型在保持高性能的同时,也具备了高度的灵活性和可扩展性。

DeepSeek 官方也明确表示,V4 针对 Claude Code、OpenClaw、OpenCode、CodeBuddy 等主流 Agent 产品进行了专项适配和优化。这说明,模型设计已经开始“为 Agent 而生”。

OpenCSG 视角:从模型到生产力的最后一公里

DeepSeek V4 定义了“智能能力的上限”,但企业真正关心的是:如何把这个能力变成生产力?

这正是 OpenCSG 要解决的问题。如果说 DeepSeek 提供的是“发动机”,那么 OpenCSG 提供的就是“整车解决方案”——从模型管理、数据治理、Agent 编排到运维监控,形成完整的 AgenticOps 闭环。

具体来说,OpenCSG 通过三个层面与 DeepSeek V4 形成互补:

模型层:CSGHub 提供多模型管理能力,让企业可以灵活选择和切换不同的模型版本,不被单一供应商锁定。

Agent 层:AgenticHub 提供 Agent 的构建、测试、部署和编排能力,让企业可以快速搭建自己的智能系统。

数据层:帮助企业沉淀和管理 AI 交互过程中产生的数据资产,这些数据才是企业真正的护城河。

更重要的是,OpenCSG 支持 On-Prem(本地部署)方案。对于金融、医疗、政府等对数据安全有严格要求的行业,这意味着他们可以在享受 DeepSeek V4 强大能力的同时,保持数据主权和完全可控。

三个确定性的未来趋势

站在 DeepSeek V4 发布的节点上,我们可以看到三个确定性的趋势:

趋势一:长上下文成为标配 —— 未来所有模型,上下文长度小于 128K 的将被淘汰,1M Token 将成为标配。这不是技术炫耀,而是实用需求。

趋势二:Agent 替代传统软件 —— 软件形态将从 SaaS 演变为 Agent-as-a-Service。用户不再需要学习复杂的软件操作,只需要用自然语言描述需求,Agent 就能自动完成。

趋势三:数据成为唯一护城河 —— 模型会越来越便宜、越来越强,但数据沉淀不会被替代。谁掌握了高质量的数据,谁就掌握了未来。

写在最后

DeepSeek V4 的发布,标志着 AI 从“对话工具”走向“智能系统”的分水岭。但技术突破只是起点,真正的挑战在于:如何把模型能力转化为企业的生产力?

在这个过程中,DeepSeek 定义了“智能能力的上限”,OpenCSG 定义了“智能落地的路径”。最终,谁能把模型变成生产力,谁就赢。

现在,DeepSeek V4 已经开源,API 已经上线,百万上下文的普惠时代已经到来。接下来,就看我们如何用好这个工具,创造真正的价值。

即刻体验:

-

官网对话:chat.deepseek.com

-

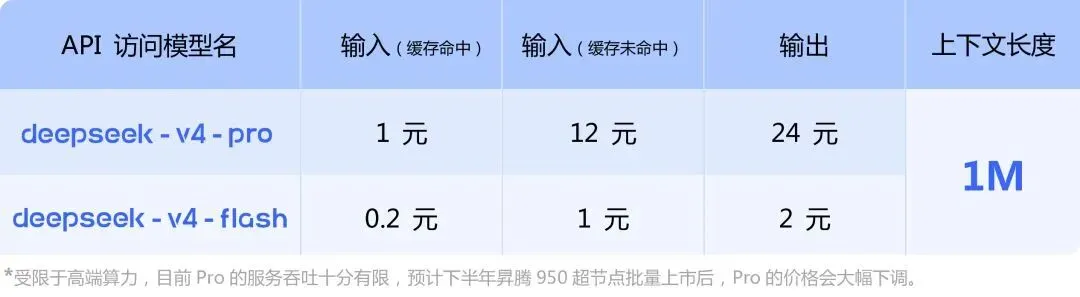

API 调用:修改 model_name 为 deepseek-v4-pro 或 deepseek-v4-flash

-

开源权重:HuggingFace 和 OpenCSG 已同步上线

社区地址

OpenCSG社区:https://opencsg.com/models/deepseek-ai/DeepSeek-V4-Pro-Base

hf社区:https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro-Base

社区地址

hf社区:https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro-Base

关于 OpenCSG

OpenCSG 是全球领先的开源大模型社区平台,致力于打造开放、协同、可持续生态,AgenticOps是人工智能领域的一种AI原生方法论,由OpenCSG(开放传神)提出。AgenticOps是Agentic AI的最佳落地实践也是方法论。核心产品 CSGHub 提供模型、数据集、代码与 AI 应用的 一站式托管、协作与共享服务,具备业界领先的模型资产管理能力,支持多角色协同和高效复用。

更多推荐

夜雨聆风

夜雨聆风