GPT Image 2 爆火:AI画图终于能写字了

GPT Image 2 爆火:AI画图终于能写字了

事情是这样的。

4月22日,OpenAI突然发布了GPT Image 2。几乎没有预告,就这么甩出来了。

然后全网炸了。

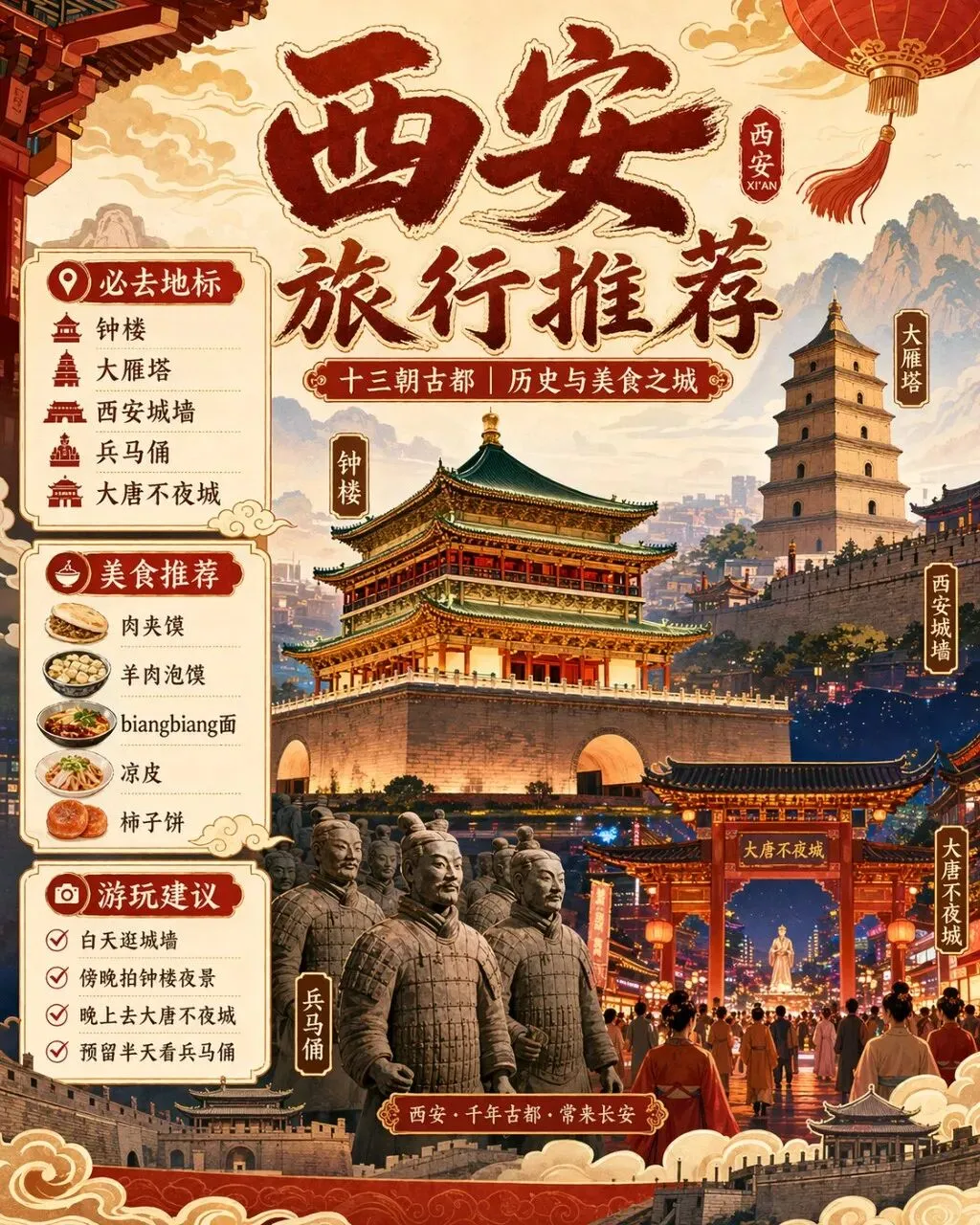

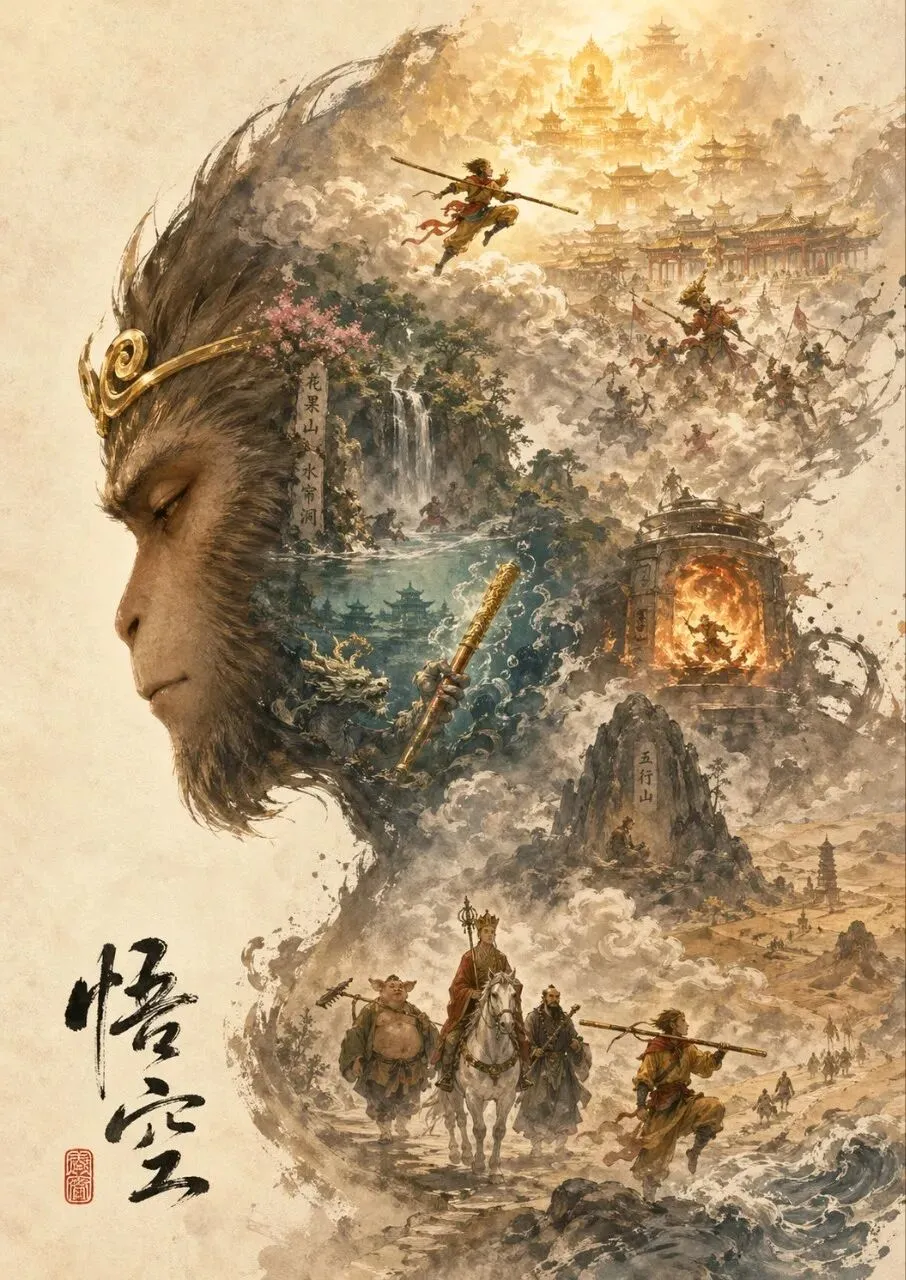

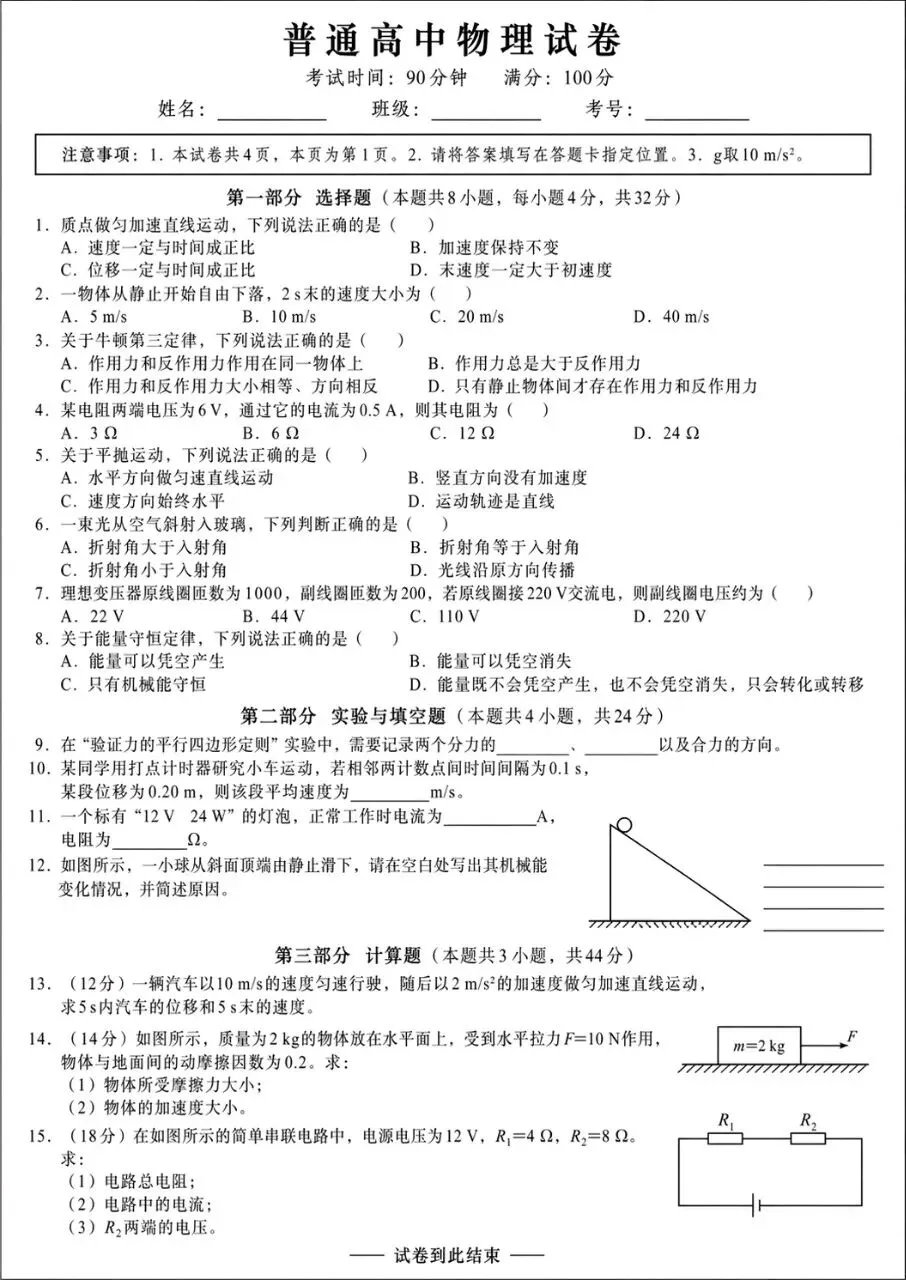

我刷到几张图,第一反应是「等等,这真的是AI生成的?」上面的中文文字,工整、清晰、笔画正确。不是那种鬼画符,是真的能看懂的文字。

你知道之前的AI画图有多惨吗。让它画个招牌,出来的图上写着「深夜食堂」,笔画歪歪扭扭像喝了假酒。让它做个信息图,数据标签糊成一团。文字渲染一直是AI画图的死穴,搞得创作者们只能先让AI画背景,自己再用PS把文字贴上去。

但现在,GPT Image 2直接把这个问题给解决了。

不是修修补补的优化,是从根子上换了一套玩法。

&&

首个能「思考」的图像模型

这个才是真正的杀手锏。

GPT Image 2是OpenAI首个具备推理能力的图像生成模型。

什么意思?它可以联网搜索,可以自我复核输出,可以像人一样「想一下再画」。

以前你让它画「某品牌的咖啡店」,它只能靠训练数据里的模糊印象去猜。现在它会先联网查一下这个品牌的视觉风格,再根据查到的信息去生成。画完之后还能自己检查一遍,看看有没有明显错误。

这带来的变化是质的飞跃。Arena评测榜单上,GPT Image 2直接拿下综合表现第一。文生图榜单1512分,甩第二名242分,这不是一点点领先,是断层式碾压。

&&

中文文字渲染99%准确率

这个数字我得单独说一下。

腾讯云那边的实测报告,GPT Image 2的中文文字排版准确率达到99%以上。对比一下,DALL-E 3大概在60%左右,前代GPT Image 1.5在90-95%。

从95%到99%,听着好像只提升了4个百分点。但实际用起来,感受完全不一样。95%意味着每画20张图就有1张文字出错,你得盯着检查。99%意味着你可以放心让它画,基本不会出问题。

更骚的是,它支持多语言渲染。中文、日语、韩语、印地语、孟加拉语,都能精准处理。

我放一张实测图,大家感受一下。

上面的「GPT」三个字母,清晰、标准、没有任何歪斜。之前的AI画这种带文字的图,要么字母糊掉,要么位置不对。现在?一气呵成。

&&

4096×4096分辨率

标准输出分辨率4096×4096。

对比一下,DALL-E 3最高1792×1024,Midjourney大概在1024-2048这个范围。GPT Image 2直接翻倍。

这意味着什么?你可以直接用它生成印刷级别的图片,不用再放大或者重绘。海报、杂志封面、产品包装,一次生成直接可用。

&&

全新独立架构

这个技术点听着有点硬,但挺重要。

GPT Image 2采用全新的独立架构,内部代号「Spud」。不是基于之前GPT-4o的图像管线,是重新设计的一套多模态推理模型。

OpenAI还宣布了一个消息,DALL-E 2和DALL-E 3将于2026年5月12日正式关闭。GPT Image 2是DALL-E系列的正式继任者。

这信号挺明确,OpenAI认为新架构已经成熟到可以完全替代旧产品了。

&&

对话式编辑

还有一个我觉得特别实用的功能。

你生成了一张图,觉得不太满意,可以直接跟它说「把背景换成日落」「加一只猫」「把这个人衣服改成红色」。

它会精准修改你指定的部分,不会把整张图重画一遍把好的地方也毁了。

这个功能的背后,是模型对图像的语义理解。它知道哪个区域是「背景」,哪个区域是「人物」,哪个区域是「衣服」。修改指令可以精确落实到具体位置。

说真的,这种交互方式让AI画图从「工具」变成了「协作者」。

&&

单次生成8张图

还有一个升级,单次提示最多可以生成8张图像。

而且不同场景之间可以保持角色、物体、风格的一致性。

这意味着什么?你可以让它画一套系列图,比如「同一个人物在不同场景里的表现」,不用一个个分开画,一次搞定,风格统一。

&&

几个效果展示

我再放几张GPT Image 2生成的图,大家感受一下这个质量。

看着这些图,我是真的觉得AI画图终于跨过了那个「能用但不好用」的阶段,进到了「好用」的阶段。

&&

怎么体验

GPT Image 2已向所有ChatGPT用户开放。免费用户每天大约可生成5张图片。高级功能(思考能力、高质量输出)需要Plus、Pro或Business订阅。

如果你想体验完整功能,需要ChatGPT Plus账号。

如果你需要Plus代充,可以扫描下面的二维码。

&&

&&

团队亮点

还有一个小细节值得提一下。

GPT Image 2的团队13个人,用了4个月做出来。超半数是华人工程师,带头的是个无锡小伙子叫陈博远。

OpenAI里华人工程师的比例这几年一直在上升,黄仁勋之前说过「华人AI人才占一半」,这话的含金量还在涨。

&&

一点感受

我一直在想一个问题,AI画图的进步到底是什么级别的进步。

以前我觉得这只是工具效率的提升,画得快一点、好一点,但本质还是工具。

现在我开始觉得,这是创作方式的变化。

当图像模型开始能「思考」,能联网查资料,能自我检查输出,它就从单纯的执行工具变成了有判断力的协作者。

这种变化听着好像只是功能叠加,但我觉得它触及了一个更本质的东西。

创作的核心从来不是技术能力,而是判断力。你得知道这张图好不好,文字对不对,风格合不合适。以前这些判断全靠人,工具只负责执行。现在工具开始能分担一部分判断,创作者可以更专注于表达本身。

我不知道这个变化会走到哪里,但「能思考的图像模型」这个概念,确实是值得认真关注的事。

&&

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~

谢谢你看我的文章,我们,下次再见。

夜雨聆风

夜雨聆风