Anthropic 断供之后:OpenClaw 用户的 Token 账单正在失控

“你以为花的是订阅费,其实烧的是你的未来。”

4月10号那天,我的信用卡收到了一条通知。不是扣款,是预授权失败。Anthropic 的 Claude Pro 订阅,那个我每月固定交 $20 就能无限用的套餐——突然不让 OpenClaw 用了。

我盯着屏幕看了很久。然后打开 OpenClaw 的后台,看了一眼 Token 消耗统计。那个数字让我差点把手机摔了。

过去一个月,我的 OpenClaw 实例烧掉了 47,000,000 个 Token。按 Anthropic 的新 API 定价,这大概是 $1,200。而我之前每个月只付 $20。这不是涨价,这是断粮之后的饥荒。

Anthropic 为什么要这么做?官方说法是”优化资源分配”。但真实原因,小米大模型负责人罗福莉在社交媒体上捅破了窗户纸——OpenClaw 的上下文管理机制效率极低,单次任务的 Token 消耗量是 Claude 自身框架的数倍之多。翻译成人话:你让 OpenClaw 做一件事,它背后可能调了 Claude 十几次,每次都在疯狂传上下文。

我算了一笔账。一个典型的”整理今日邮件并生成待办清单”的任务,在 Claude 的网页端,大概消耗 5,000 Token。通过 OpenClaw 做同样的事?我的日志显示,它消耗了 78,000 Token。十五倍。

因为 OpenClaw 的每一个”酷炫功能”,都在偷偷烧钱。

“记忆宫殿”(Memory Palace)——为了让 Agent 记住你三个月前提过的一个偏好,它每次对话都要把相关记忆片段塞进上下文。不是智能检索,是暴力遍历。你的记忆库越大,每次对话的 Token 基数就越高。”主动记忆”(Active Memory)更狠——Agent 会主动”回忆”过往对话,生成摘要,再把这些摘要塞进新的对话里。一个任务触发三次记忆回溯,Token 消耗翻三倍。

“Diary flows”——让 Agent 每天写日记,反思自己的工作。听起来很人文,很温暖,对吧?但每篇”日记”都要调用一次模型,生成几百字的反思文本。如果你养了三个 Agent,每天三篇日记,一个月就是 270 次额外调用。每次调用按 10,000 Token 算,这又是 270 万 Token。

还有那个”梦境回溯”(Dreaming REM backfill)——Agent 在空闲时”做梦”,整理和压缩记忆。这个功能在 v2026.4.9 上线时,社区一片欢呼。但没人告诉你,每次”做梦”都是一次完整的模型调用,而且因为要在后台运行,它用的是最高优先级的 API 队列,单价更贵。

我把这些功能全部打开,跑了一个月。账单出来,我沉默了。

然后我开始做实验。逐个关闭功能,观察 Token 消耗的变化。

关闭 Memory Palace,Token 消耗下降 40%。关闭 Active Memory,再降 25%。关闭 Diary flows,再降 15%。关闭 Dreaming,再降 10%。最后剩下的 10%,才是”实际工作”的消耗。也就是说,我过去一个月花的钱,90% 烧在了”让 Agent 更像人”的功能上。

Anthropic 的断供,本质上是一次”成本归位”。OpenClaw 用户过去享受的低价,是 Anthropic 在补贴。Claude Pro 的 $20 月费,设计初衷是”个人用户轻度使用”,不是”喂饱一个 24 小时运行的 Agent 集群”。OpenClaw 把这个边界打破了,Anthropic 把账单寄了回来。

小林,研究生,用 OpenClaw 辅助写论文。以前靠 Claude Pro 的订阅,每月 $20 能覆盖。断供后,他算了下,按 API 计费,一个月要 $180。”我导师的课题经费里没有这一项。要么自己掏钱,要么不用。”他选择了后者,回到了手动查文献。

老张,独立开发者,用 OpenClaw 管理三个 side project 的客服和运营。他的 OpenClaw 实例每天处理大概 200 条用户咨询。断供前,$20/月。断供后,按 API 计费,$800+/月。”这比我其中一个项目的月收入还高。要么涨价,要么裁员——裁掉 Agent。”

Lisa,一人公司创始人,养了 8 个 Agent 做内容矩阵。她的账单最夸张——断供前 $20/月,断供后估算 $2,400/月。”我直接关了 5 个 Agent,剩下 3 个做最核心的工作。效率掉了 60%,但至少还能活。”

三个故事,同一个结局:Agent 越多,账单越疯;功能越全,成本越失控。

OpenRouter 是一个选择。它聚合了多个模型的 API,可以按价格自动切换。但问题是——Claude 的替代模型,要么精度不够,要么延迟太高。你让内容创作的 Agent 用 GPT-4o-mini,写出来的东西你自己都看不下去。让数据分析的 Agent 用 DeepSeek,等它出结果的时间够你手动算三遍。

本地模型?我试过。在 M4 Mac Mini 上跑 Qwen-32B,7B Token 的上下文,速度还能接受。但复杂推理任务,本地模型和 Claude 的差距不是一点半点。而且本地跑模型,电费也是成本。我算过,M4 Mac Mini 24GB 满载跑一天,电费大概 $0.5,一个月 $15。加上硬件折旧,其实也没省多少。

更隐蔽的成本是时间。配置本地模型、调 Prompt、处理幻觉、手动纠错——这些时间如果换算成时薪,可能比 API 账单更贵。

所以 Anthropic 断供之后,OpenClaw 用户面临的不是”换个供应商”那么简单的问题。而是一个根本性的拷问:这些 Agent 创造的价值,真的值这个价吗?

我重新梳理了自己的工作流。哪些任务 Agent 做得比人好?哪些只是”看起来自动化了,实际上更麻烦”?结论是残酷的——大概 30% 的任务,Agent 确实提升了效率;40% 的任务,Agent 和人差不多,但成本更高;30% 的任务,Agent 纯粹是在添乱。

那 30% 的”真效率”,就是我愿意付费的部分。其他的,砍了。

第一,关闭所有”情绪价值”功能。Memory Palace、Diary flows、Dreaming——这些让 Agent 更像人的功能,是 Token 消耗的大户。如果你的 Agent 是工具,不是宠物,这些功能可以全部关掉。

第二,用”最小上下文”策略。在 config.yaml 里限制每次对话的上下文长度。OpenClaw 默认是 200K,但你真的需要让 Agent 记住三个月前的每一句对话吗?设成 50K,精度下降有限,成本砍半。

第三,批量处理,减少调用次数。别让 Agent 每收到一封邮件就调用一次模型。攒到 10 封一起处理,Token 效率提升 3-5 倍。

第四,模型分级。核心任务用 Claude,边缘任务用 GPT-4o-mini 或 DeepSeek。我现在的配置是:内容创作和代码审查用 Claude,邮件分类和日程管理用 GPT-4o-mini,数据分析用 DeepSeek。账单从 $1,200 降到了 $340。

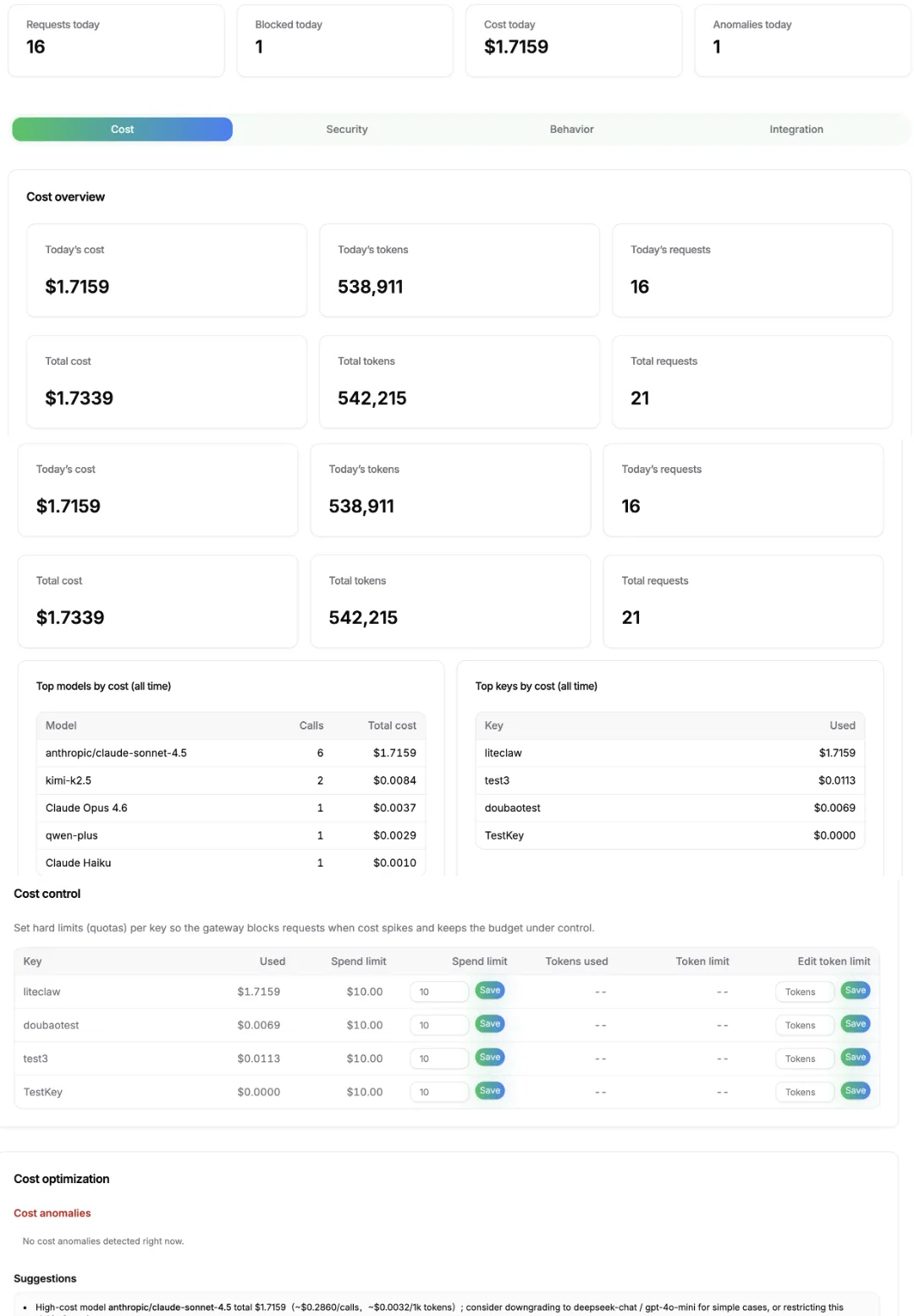

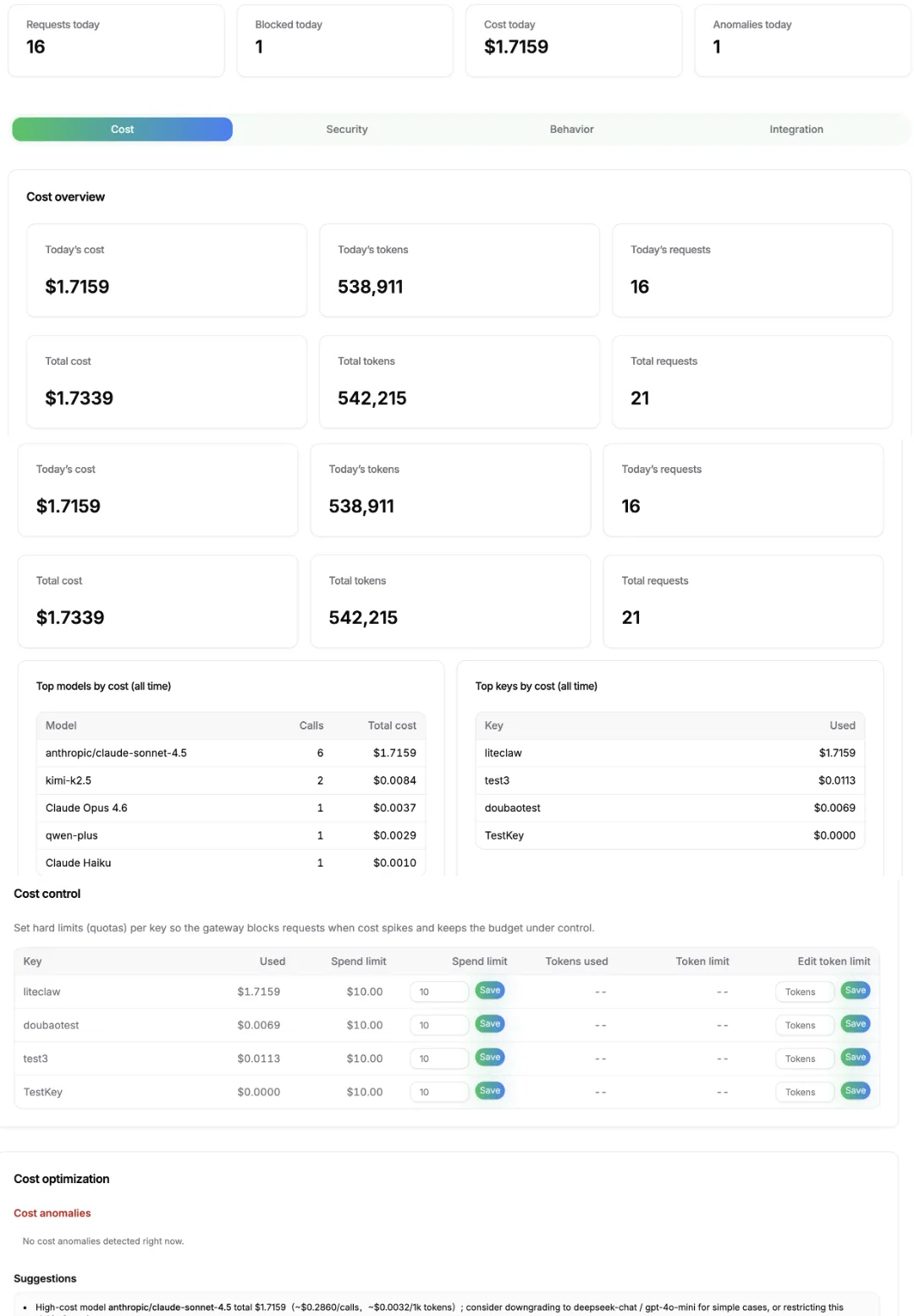

第五,也是最实际的——设硬预算上限。用工具监控每个 Agent 的 Token 消耗,超过阈值自动降级或暂停。市面上有一些方案在做这个,比如 ClawFirewall,它除了安全功能,还能做成本监控和配额管理。你可以给每个 Agent 设月度 Token 上限,超了自动切到便宜模型或暂停服务。不是让你少做事,是让你知道钱花在哪了。

Anthropic 的断供,撕开了 OpenClaw 生态的一个幻觉——”无限智能,低价可得”。这个幻觉维持了两年,现在醒了。醒得有点疼,但总比一直做梦好。

真正的 AI 原生工作流,不是堆 Agent、堆功能、堆 Token。是做减法。找到那 30% 真正有价值的部分,把资源集中在上面。其他的,该砍就砍。

你可以在这里了解 ClawFirewall:

https://clawfirewall.ai

一个轻量级的 AI Gateway,用于:

-

控制 AI 成本

-

监控 Token 使用

-

保护 API Key

-

管理 AI Agent 调用