Nature:上百个医疗 AI 数据涉嫌造假,且在医院里使用

数据造假的 AI 模型,已经用到病人身上了

全球多个用于预测脑卒中和糖尿病的 AI 模型,训练数据可能是假的。

这些 AI 工具已经被引用进 124 篇同行评审论文,至少两个模型已在医院里用于真实患者。

最近,Nature 披露多个用于训练疾病预测 AI 模型的所使用的数据集存在造假嫌疑。

医疗 AI 模型通过分析患者的健康信息,预测未来罹患某些疾病的风险。如果数据真实可靠,模型的预测结果本可帮助医生开展早期筛查与风险评估。

然而,AI 模型的质量高度依赖训练数据的质量。澳大利亚昆士兰科技大学研究团队发现,预测脑卒中和糖尿病的 AI 模型所使用的数据涉嫌造假,与真实临床情况严重不符。

图源:Nature

首先,脑卒中预测的 AI 数据集中包含 5110 名患者的健康信息中 BMI 的缺失率仅为 0.3%,其余所有变量则完全没有缺失值。

在真实的临床研究中,受试者因错过随访、中途退出乃至死亡等原因,数据缺失几乎不可避免。

但这个数据的完美程度,在现实中几乎不可能出现。

面对外界质疑,数据上传者声称数据来自「机密来源」,仅供教育用途,但始终未披露任何具体出处。

另一个是糖尿病预测数据集,声称包含 10 万人的医疗和人口统计数据。

图源:kaggle

研究发现,10 万人的血糖数据里只有 18 个离散取值——在真实人群中,血糖值是连续分布的,这在生物学上根本不可能出现。

此外,BMI 与血糖水平在理论上存在较强的正相关,但这份数据中两者之间的关联几乎为零,与已知的医学规律明显相悖。

当数据上传者被问及数据来源时,以「保密原因」拒绝披露,也没有回应 Nature 的采访请求。

涉嫌造假的数据,已被下载超 40 万次

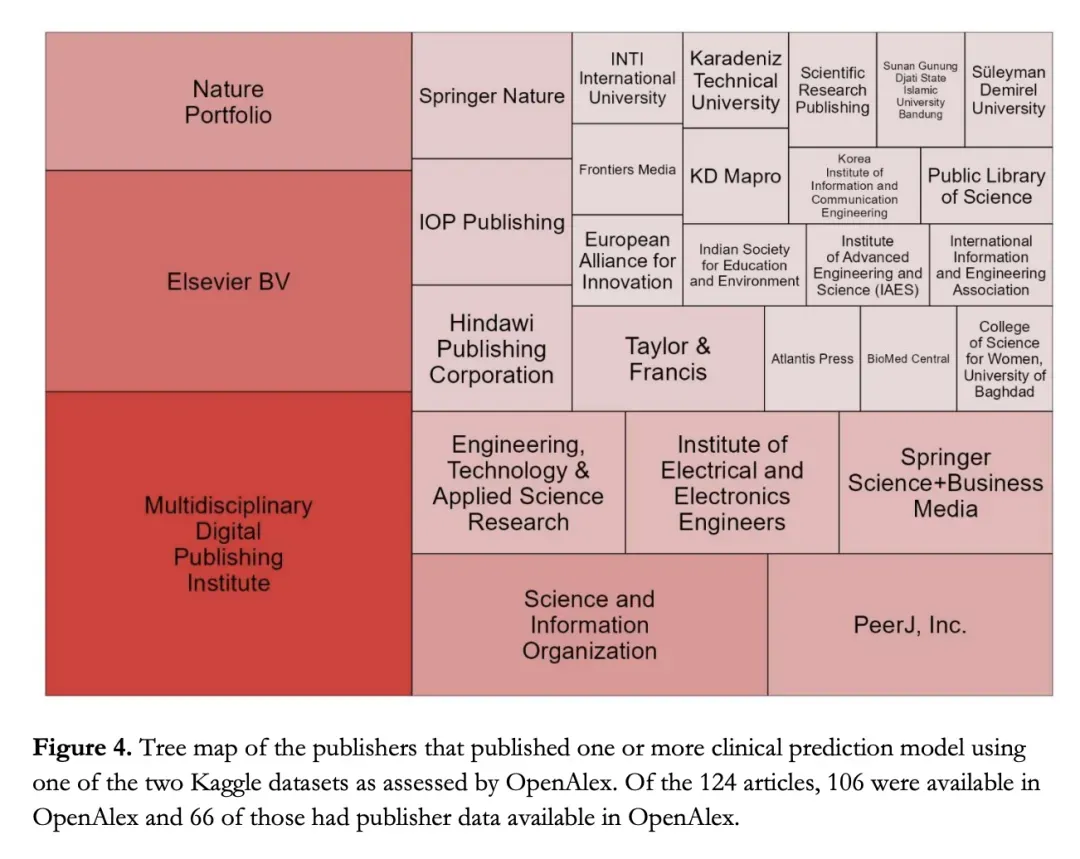

研究团队发现,已经有 124 篇经过同行评议的论文,用了这两个开放获取的健康数据集来训练 AI 模型。

其中,卒中数据集被下载了超过 28.8 万次,有 104 篇论文用它来训练其他的 AI 模型;糖尿病数据集也被下载了超过 11.4 万次,21 篇论文拿它来建模。

也就是说,基于假数据得出的研究结论,已经堂而皇之地发表在学术期刊上。而后续研究者如果参考这些论文、继续在上面叠加新模型,可靠性同样无从保障。

图源:medRxiv

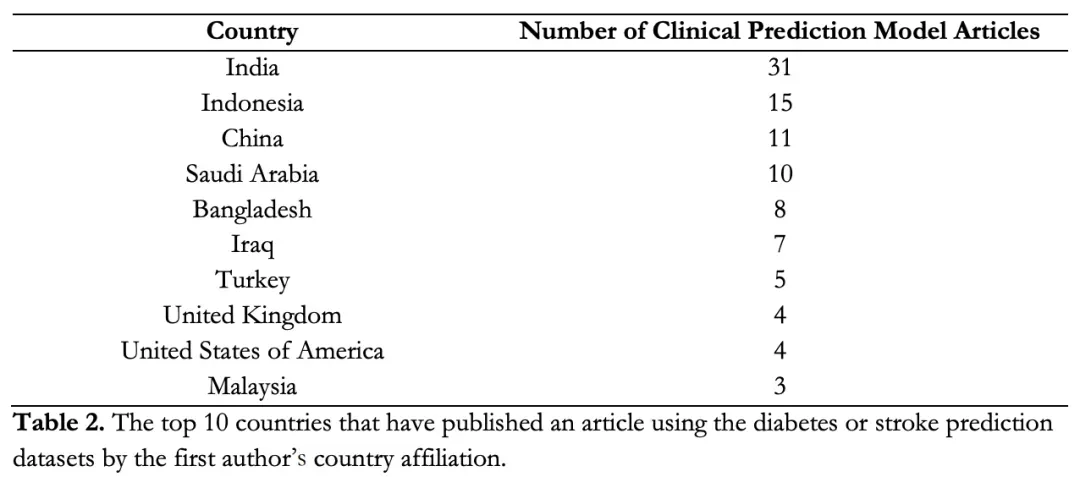

这 126 篇文章中作者来自 32 个国家,其中印度第一,中国第三。

图源:medRxiv

更严重的是,涉嫌使用假数据的卒中 AI 预测模型已在印度尼西亚某医院部署,另一项研究暗示该 AI 模型正在美国某心脏诊所使用。

甚至,有 AI 模型出现在 2024 年提交的医疗设备专利申请中,还有两个是公开可访问的网络工具,任何人都可以上传个人信息来检测患病风险。

当被问及为何使用来源不明的数据时,部分论文作者回复说:「在进行研究和提交稿件时,我们没有意识到数据集可能是合成或模拟的。」

目前已有至少三篇相关论文被撤稿,撤稿声明中写明「对研究中使用的数据的来源和有效性表示担忧」。

平台方面则拒绝就是否会对这两个数据集采取行动作出回应。

来源不明的 AI,不应用在任何地方

这不是抽象的数据质量问题。

AI 模型的性能,完全取决于训练数据的质量。

如果数据不代表真实人群——不管是因为伪造、还是因为只反映了特定人群,模型学到的模式就是错的。

用假数据训练出来的卒中风险预测工具,可能在某些真实患者身上系统性地低估风险,也可能在另一些患者身上系统性地高估。

医生看到的是「AI 评分」,但这个数字背后是什么,没有人能追溯。

研究者呼吁,使用来源不明数据集训练的预测模型,不应在临床决策中使用。

机构和资助方应强制要求披露训练数据来源,期刊应拒绝不符合要求的论文,同时建议将这两个数据集从 Kaggle 下架。

一个模型的可信度,取决于它是用什么数据建立起来的,这件事不应该是事后才去追问的问题。

加入读者交流群:

—精彩回顾—

联 系 我 们 : wbfsh@staff.weibo.com

夜雨聆风

夜雨聆风