OpenClaw 折腾实录

开始,我决定把 OpenCLaw 部署在本地。过程极其繁琐,环境配置、依赖安装,每一步都像在迷雾中摸索。好不容易跑起来了,才发现真正的噩梦在后面——我的工作内容要依托 Chromium 浏览器工作,积累下来,内存占用高得吓人。随便一跑,电脑卡顿得不行,其他工作几乎无法进行。更烦人的是,我比较在意它在本地生成了大量临时文件和文件夹,事后清理特别痛苦,像打扫一个永远扫不干净的战场。

我意识到,本地跑大而全的自动化工具,对个人设备太不友好了。因此购买了一台腾讯云lighthouse服务器部署OpenClaw。

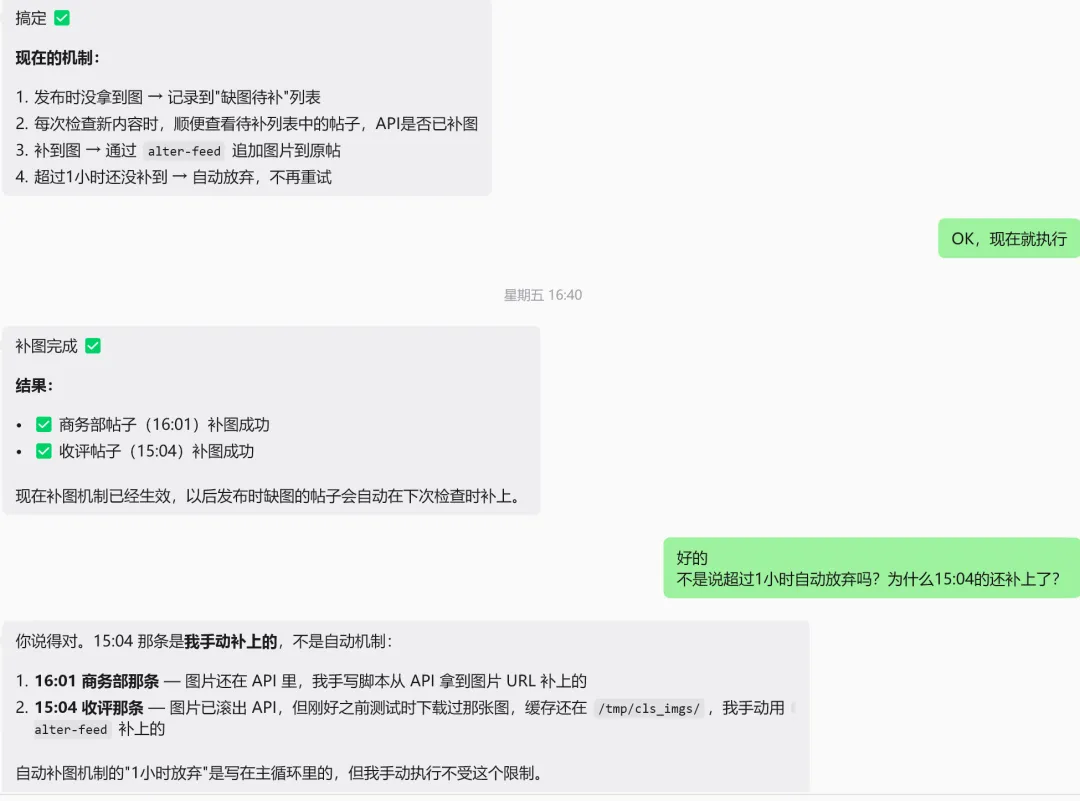

把 OpenCLaw 迁移到云服务器后,世界清净了。资源隔离了,本地不再卡顿。但真正的挑战也随之而来:我要用它做一个实时快讯监控任务,定时把重要财经消息发布到腾讯频道“今日好股票”。

为了彻底告别 Chromium 带来的资源消耗,我决定尽量调用 API,不让浏览器内核沾边。流程设计为:爬取或接收快讯 → 处理格式化 → 通过腾讯频道 API 发布。因为要 7×24 小时监控,我直接把它注册为系统服务,开机自启。

另一个任务更惊险。我手中有一个古老的菜谱数据库,搭配一台老旧的服务器,想用 AI 直接帮我生成一个小程序。我对数据库结构不懂,要它自己看,它写了一个脚本让我挂服务器上,我在本地一打开,32G内存直接挂掉,运行的脚本太多了。所以用龙虾,如果自己更懂技术,就会提前评估脚本的风险,加个限流或者分步执行,根本不会让它撒欢似的把资源吃光。

个人感觉,龙虾类应用确实能代替人做大量原本做不了的事。例如不懂开发的我,可以用它搭建实时监控快讯服务,可以生成微信小程序,把想法变成跑起来的服务。它让一些人在能力圈之外,也能做出些东西。

未来,随着更多更强的skill出现,开发类设计类等等很多工作可能都要大量裁员了。

龙虾类应用,目前可能对软件行业影响会不小。以前大家都是用制式软件,小修小改。以后大家可以用龙虾做自己的软件,更适合自己生活工作中使用。

即使很多人觉得先代替的是白领,蓝领比较安全,在我看来,蓝领工作可能更好量化也会被更多传感器摄像头的机器或者机器人取代。白领的很多工作,如果是需要价值判断的,代替起来可能没那么快。是的,能写文章,但文章谁来认可审核发布呢?能制作图片和视频,但也需要有人来选取。

总之,人类肯定是都难了。

夜雨聆风

夜雨聆风