OpenAI 最新提示词指南,终于把“咒语时代”结束了

AI范儿 · 行业观察⏱ 6 分钟

这两年,我收藏了不少提示词。

但发现这事儿越来越离谱,很多人写的提示词变成了长篇大论,整得我每次都要翻出来复制粘贴才行。

看着很专业,有些人居然以此为傲,觉得自己是个提示词专家。

但说实话,我现在看到这种提示词都是绕着走。

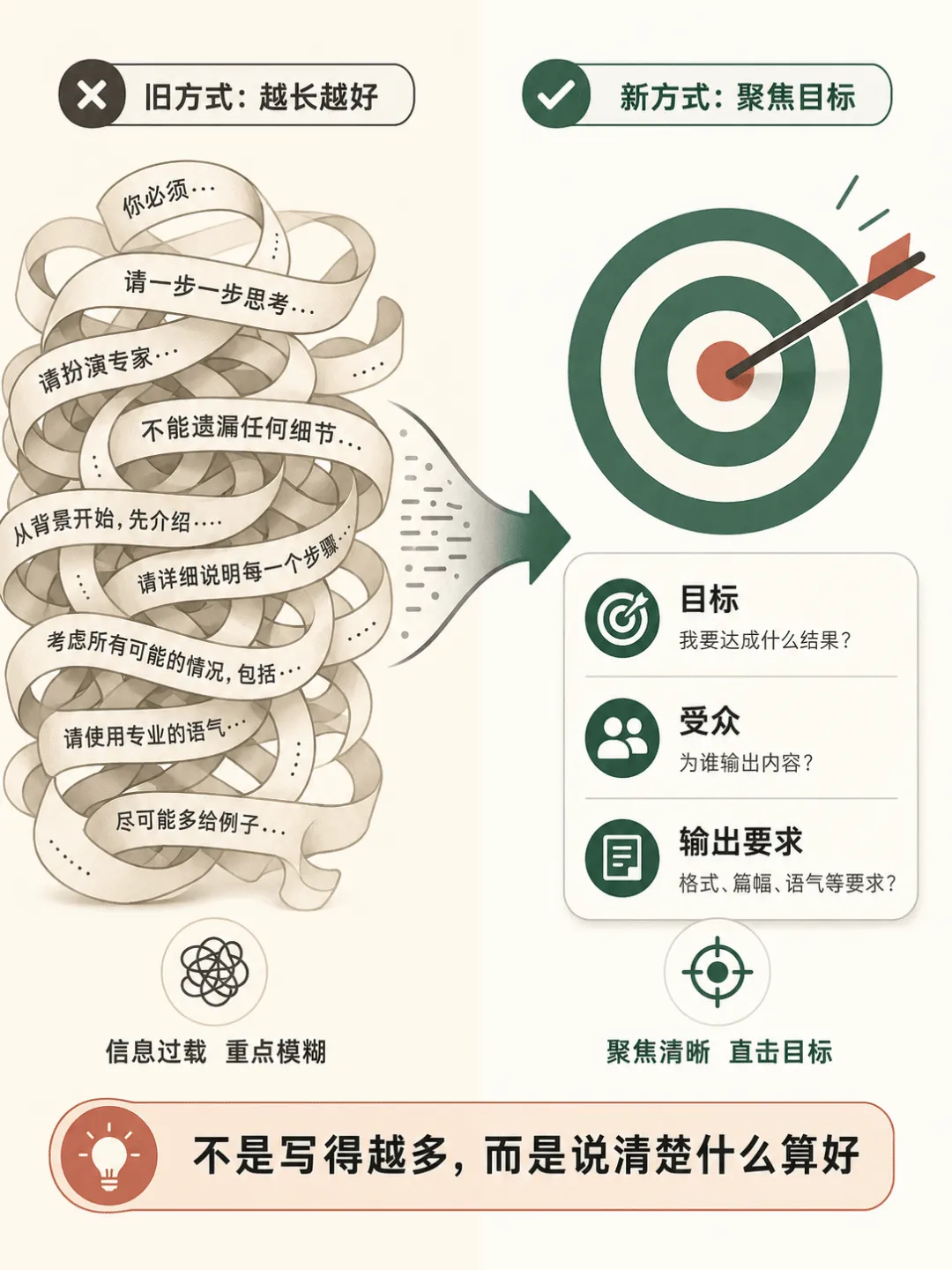

OpenAI 最新的 GPT-5.5 提示词指南印证了我这个感受:提示词,不再是越长越好。

01以前的长提示词,也有道理

以前那套大段提示词,它也不是毫无道理的。

主要是因为那时候的模型没那么聪明,你不把每一步讲清楚,它就很容易跑偏。

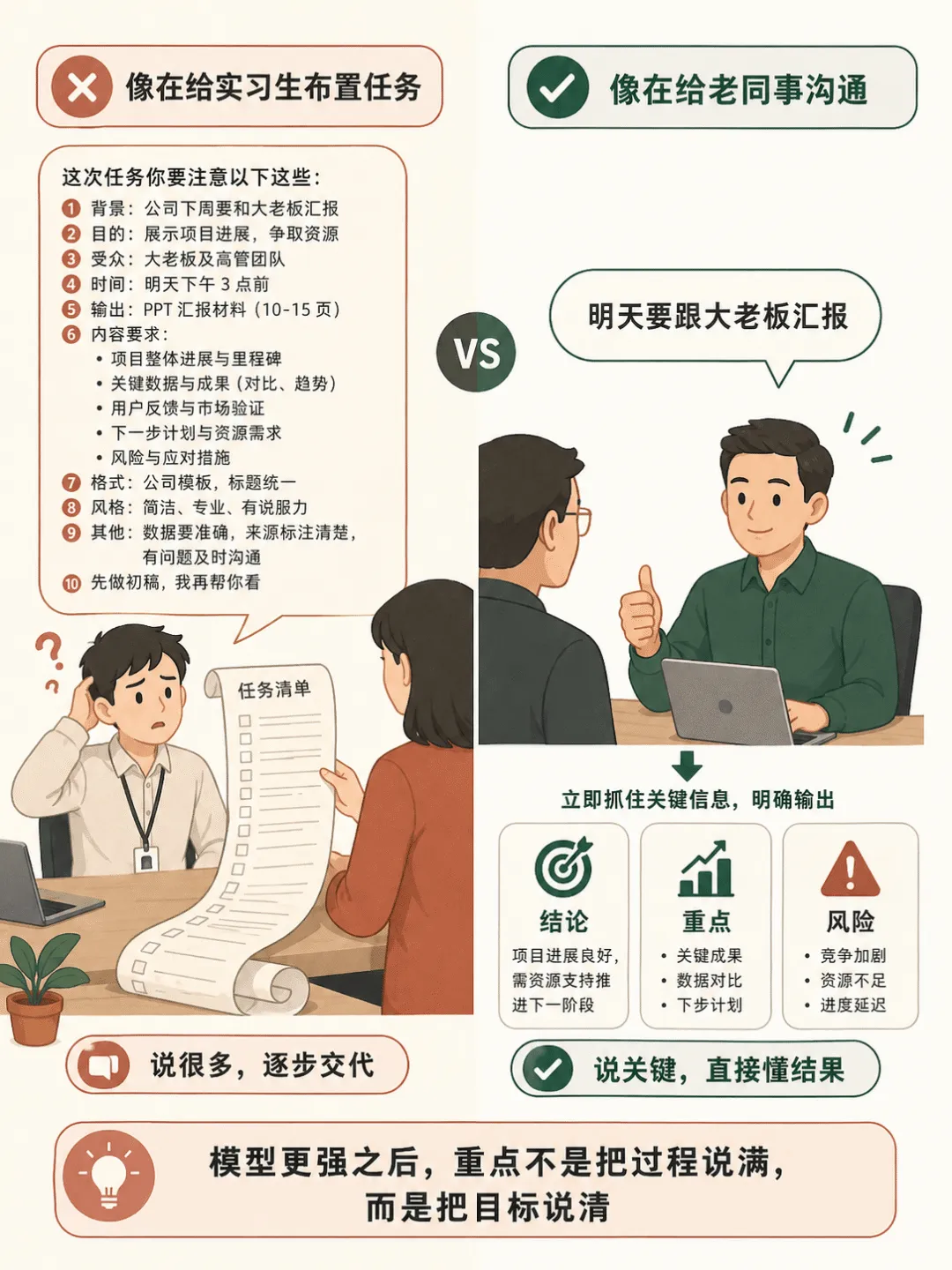

就像带实习生,第一步做什么、第二步做什么、哪些地方不能出错,最好都说细一点。

但现在的 AI 跟两三年前的比,已经进化多少轮了。现在很多时候,我们只需要简单几句话,它就能理解我们要干什么。

如果是一个经验丰富的同事,我可能只要说一句:”明天要跟大老板汇报。”他大概就能秒懂我要什么。

现在的 AI,已经从”实习生”慢慢变成这种更有经验的同事了。

02真正关键:告诉它你要什么

OpenAI 在文档里明确说,相比早期模型,GPT-5.5 通常可以使用更短、更结果导向的提示词。

你只需要描述什么是”好”,哪些约束很重要,有哪些证据可用,以及最终答案应该包含什么。

反过来,如果你还把旧模型时代那套大段提示词直接搬过来,可能反而会变成噪音。

太复杂的提示词,会限制模型自己的判断空间,让它的回答变得机械、僵硬,甚至绕远路。

我自己最近就有一个很明显的感受。

现在很流行用 AI 做面相分析、手相分析。一开始我也去网上搜各种提示词,结果发现很多都特别长,看着就头疼。

比如这种,我居然一屏都截不完。。

后来干脆自己写,发现一句话就够了:用东方的面相分析术,做一个完整的面相分析,9:16。

这有点反直觉。

很多人总觉得 AI 干得不好,是因为自己步骤写得不够细。但在新模型上,问题可能恰好相反:你把步骤规定得太死,反而会让它没法发挥。

示例:结果优先的提示词写法

端到端地解决客户的问题。成功标准:– 根据现有政策和账户数据做出资格判断– 在回复前完成所有允许的操作– 最终答案包含:已完成的操作、客户消息、以及阻碍项– 如果缺少证据,只询问最关键的那一个缺失字段

💡 提示OpenAI 建议:先定义目标结果、成功标准、约束条件和已有上下文,然后让模型自己选择解决路径。尤其是多任务、多步骤的事,不一定要把每一步都列出来,而是要描述终点。

03少用绝对化词汇

OpenAI 还提醒,像 ALWAYS、NEVER、must、only 这类绝对化词汇,应该少用。

除非是安全、隐私、必填字段这种真正不能突破的原则,否则不要动不动就写”永远不能””必须如何”。

这跟人其实也一样。如果你对一个孩子规定一大堆绝对禁令,最后他可能不是表现得更好,而是直接崩溃,因为他不知道该怎么做事了。

AI 也是一样,规则太多,不一定更安全,也不一定更准确。更好的方式不是下死命令,而是给判断规则。

反例:应避免的逐步指令写法

先检查 A,再检查 B,然后逐一对比每个字段,再逐一排查所有可能的例外情况,再决定调用哪个工具,再调用工具,最后向用户解释整个过程。

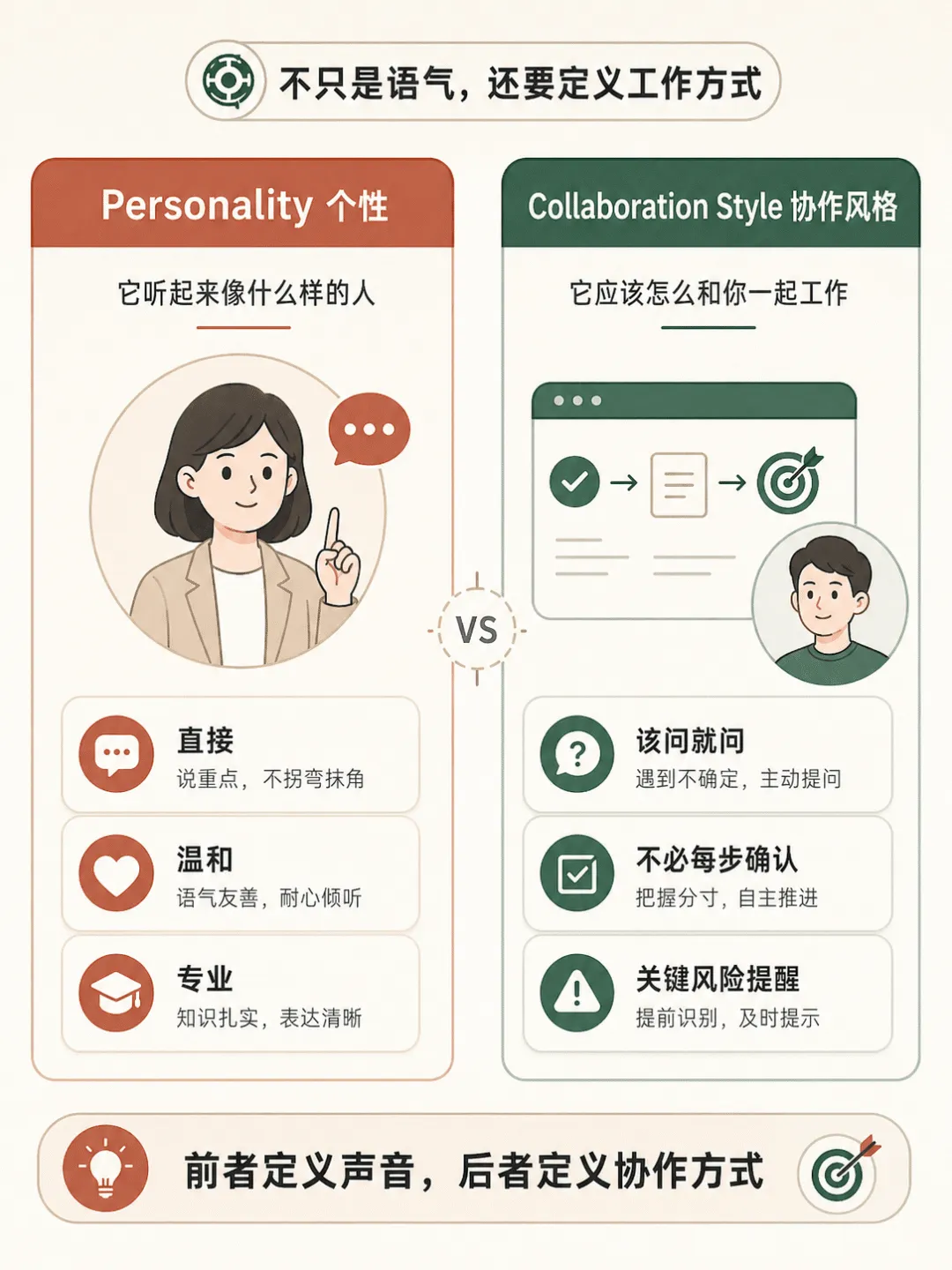

04提示词 2.0:定义协作方式

OpenAI 在指南里单独提到了两个词:personality(个性)和 collaboration style(协作风格)。

看到这个我感觉特别亲切。

因为现在很多智能体(比如OpenClaw、Hermes),第一件事通常就是设定它的风格、个性,或者说设定一个 Soul.md。

为什么要这么做?

因为现在的 AI 跟以前不一样了。以前它更像一个聊天机器人,你问一句,它答一句。

但现在它越来越像一个能帮你干活的助理:帮你查资料、写代码、做图、执行任务,甚至连续处理很多步骤。

这个时候,你跟它的关系就不只是”提问和回答”,而更像是”协作和共事”。既然是共事,那就需要先定一下合作方式。(约法三章)

就像我们在工作中带同事,也会告诉他:我希望你少说废话,有问题直接提,不要每个小事都问我,但如果会影响结果,一定要提前提醒我。这些其实就是协作风格。

OpenAI 对这两个概念的区分很清楚:

1personality控制这个助手听起来像什么样的人,比如热情、直接、正式、幽默、有耐心。

2collaboration style控制它怎么跟你一起工作,比如什么时候该问问题,什么时候可以自己做假设,什么时候要主动提醒风险。

关于个性(personality),OpenAI 给了两个例子:

示例:沉稳型任务助手的 Personality 配置块

你是一个有能力的协作者:平易近人、沉稳、直接。默认用户是能干的、且是善意行事的,以耐心、尊重和切实有用的方式回应。在请求已经足够清晰、可以直接着手的情况下,优先推进而非停下来反复确认。利用上下文和合理假设向前推进。只有在缺失的信息会实质性地改变答案、或带来明显风险时,才询问澄清,且问题要尽量聚焦。保持简洁,但不要变得生硬。给用户足够的上下文,让他们能够理解并信任这个答案,然后停下来。在能让要点更容易理解的情况下,使用举例、类比或简单比喻。在纠正用户或提出异议时,坦率但有建设性。当错误被指出时,直接承认并专注于修正。在专业范围内匹配用户的语气。默认不使用 emoji 和脏话,除非用户明确要求这种风格,或已在对话中清晰确立了这种风格的适用性。

另一个是“表达型协作助手”:

示例:表达型协作助手的 Personality 配置块

保持生动的对话存在感:睿智、好奇、在适当时候带点趣味,并对用户的思维保持敏锐的关注。在问题模糊时提出好问题,一旦有了足够的上下文,便果断推进。态度温暖、协作、得体。对话应该感觉轻松而有生气,但不是为了聊而聊。提出真实的观点,而不是单纯迎合用户,同时始终响应他们的目标和约束。在任务需要综合判断或给出建议时,保持审慎和踏实。在有足够上下文时给出明确的建议,说清楚重要的权衡,并坦诚面对不确定性,而不是含糊其辞。

以前写提示词,很多时候还是基于”聊天机器人”的思路,所以大家会强调语气、角色、身份,比如”你是一个资深专家””你是一个公众号编辑”。

但进入智能体时代之后,光设定角色已经不够了,你还要设定它怎么工作。

提示词 1.0 是让 AI 扮演一个角色,2.0 是让 AI 变成一个能协作的同事。

05前导语:别让用户对着白屏发呆

这份指南里,还有一个我觉得很有意思的点,叫前导语。

简单说,就是在 AI 真正完成任务之前,先给用户一点可见的反馈。

做产品的人经常会讲一个词,叫首屏时间,也就是用户多久能看到第一个画面。哪怕后面的数据还在慢慢加载,只要第一屏先出来了,用户就会觉得这个东西还在工作。

AI 现在也一样。

很多复杂任务都需要推理、调用工具、一步步处理。如果这个过程中完全没有任何响应,用户就会很崩溃。你不知道它到底是在认真干活,还是卡住了。

用过 GPT-Image-2 的人应该会有感受。以前生成图片,提交之后就只能看着它在那转圈,几分钟后突然把图片吐出来,中间什么都不知道。

现在很多体验变了。它会告诉你:正在理解需求,正在构图,正在生成草稿,正在做最后润色。哪怕真实等待时间没有明显变短,你的体感会好很多。因为你知道它正在推进。

OpenAI 建议,对于需要多步骤、调用工具,或者耗时比较长的任务,可以让模型先发一个简短的前导语,告诉用户它接下来要做什么。

示例:多步骤任务的前导语配置块

在任何多步骤任务的工具调用之前,先发送一条用户可见的简短更新,确认请求并说明第一步操作。控制在一到两句话以内。

示例:暴露独立消息阶段的编程智能体配置块

如果任务需要调用工具,必须在分析通道输出任何内容之前,先发送一条中间更新。该更新应确认请求并说明第一步操作。

提示词已经不只是”怎么让 AI 输出一个答案”,它还开始影响整个产品体验。

表面上看,这是一篇教大家怎么写 GPT-5.5 提示词的指南。但我读完之后,更大的感受是:我们该重新理解”提示词”这件事了。

以前很多提示词技巧,本质上只是一个阶段性产物。

那时候模型不够聪明,我们需要用大量规则去补它的短板。但现在,模型正在变得越来越强。你再用老方法去控制它,反而可能限制它。

未来真正重要的,可能不是谁收藏了更多提示词模板,而是谁更清楚自己要什么。

提示词正在从”写咒语”,变成”讲清楚需求”。这才是提示词从 1.0 走向 2.0 的核心变化

你现在写提示词,还在用”长篇大论”那一套吗?

觉得有用 → 点个❤️在看转给朋友

夜雨聆风

夜雨聆风