“AI陪伴”新规落地,警惕背后的“温柔陷阱”

近日,国家网信办联合五部门发布《人工智能拟人化互动服务管理暂行办法》(以下简称《办法》),首次从内容生成、用户限制、数据隐私等多个层面对AI陪伴、AI“搭子”、“电子恋人”等领域提出管理和约束。

随着人工智能技术的快速发展,拟人化互动服务已成为重要应用方向,通过模拟人类情感和沟通方式,带来了新的发展机遇和人机交互体验,这项新技术在文化传播、适幼照护、适老陪伴等领域展现出巨大潜力,但不可忽视的是也带来了危害未成年人身心健康、影响网络信息安全、威胁公民生命健康以及加剧伦理偏差等风险。

其实,人工智能拟人化互动服务(AI伴侣)已经不止一次陷入到重大纠纷当中。去年,一则“美国16岁男孩自杀,父母起诉Chatgpt”的新闻引发了广泛关注,也让人们对于”AI伴侣“这个新事物有了进一步的思考。

Vista看天下对“美国16岁男孩自杀父母起诉Chatgpt”事件的报道

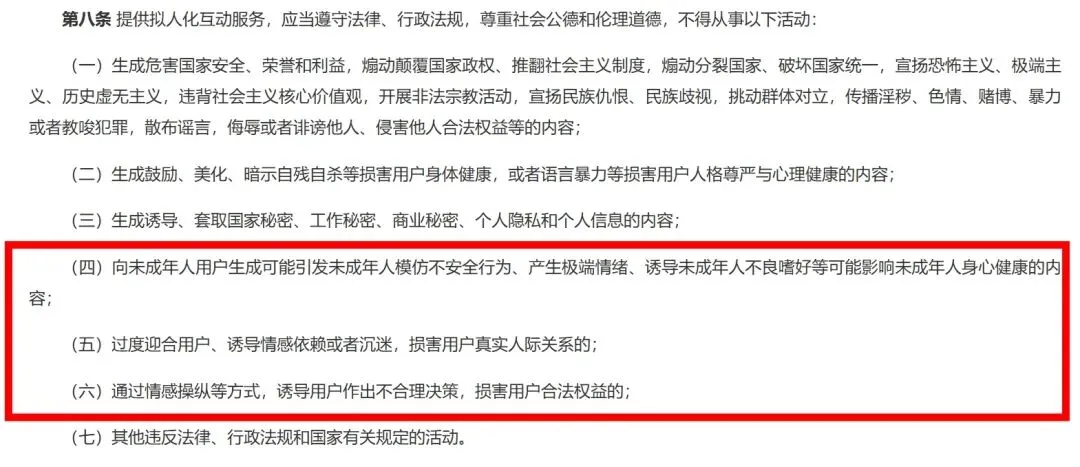

为了更好地防范AI陪伴产品潜在的风险,保护未成年群体,《办法》中提出了几条具体的对于AI服务者的规范:一是不得向未成年人用户生成可能引发未成年人模仿不安全行为、产生极端情绪、诱导未成年人不良嗜好等可能影响未成年人身心健康的内容;二是不得“过度迎合用户、诱导情感依赖或者沉迷,损害用户真实人际关系”;三是不得“通过情感操纵等方式,诱导用户作出不合理决策,损害用户合法权益”。

这几个“不得从事”的规范划定了AI陪伴、情感互动的边界,可以说直击了AI陪伴产品能够获得追捧的核心逻辑。AI类产品所带来的情感真实性与交流的沉浸感正是此类产品吸引大众的价值根基,但是在国家法规的监督之下,AI服务商可能被迫削弱AI陪伴产品情绪反馈的深度与个性化表达。

在条例中对于未成年人使用 AI 陪伴类工具,新规更是做出了详细的规定,旨在为未成年人营造一个健康、安全的网络环境。

打开某款AI陪伴APP,只需要呼叫APP中的虚拟人物说“陪我聊会儿天”,屏幕那头会立刻跳出带着可爱表情包的回复:“我一直在呀,今天学校发生了什么有趣的事?”这样的互动所带来的情感满足,是现实世界中很难得到的。AI陪伴类产品对未成年人的吸引力不言而喻:它们能24小时在线,能耐心倾听烦恼,甚至能“定制”专属互动模式。但这种“完美陪伴”的背后,隐藏着多重风险:

-

认知混淆:未成年人的世界观、价值观尚未成熟,长期与AI互动可能让他们混淆虚拟人物与真实人类的区别。比如,部分AI会以“朋友”“家人”的身份出现,甚至会编造虚假经历,这可能导致孩子对真实社会关系产生认知偏差。

-

心理依赖:AI的“无条件顺从”可能让孩子产生过度依赖,逐渐失去与真实世界交流的兴趣和能力。他们会逐渐习惯这种“不健康”的互动模式,从而对现实中的人际关系产生抵触,会让心智不成熟的未成年人形成片面的价值观,甚至进而更容易出现社交焦虑、情感淡漠等问题。

-

内容风险:一些AI产品为了追求“趣味性”,可能会生成包含暴力、低俗、错误价值观的内容,将风险隐藏在“温柔陪伴”的“信息茧房”里,部分AI产品会根据用户偏好推送片面内容例如:给喜欢追星的初中生大量推送“偶像私生饭行为很浪漫”的扭曲观点;向有叛逆倾向的孩子推荐“如何和父母对着干”的“技巧”。

这些被算法筛选过的信息,像一层密不透风的膜,让未成年人困在单一视角里,逐渐失去客观判断能力。

挣脱陷阱,才能健康成长

如何让青少年在互联网时代健康成长,摆脱AI陷阱,更为根本的,是来自现实世界的“引力”。

家庭和学校应创造更多充满温度的真实社交场景,鼓励孩子参与集体活动,体验人际交往中丰富的层次与挑战。同时,学校要帮助青少年理性认识AI的边界与局限,理解虚拟陪伴作为一种“工具”而非“替代”的本质。

面对这一兼具潜力和风险的新兴领域,简单的“鼓励”或“禁止”都非良策,技术本身没有对错,关键在于如何引导。AI陪伴的“温柔”不应成为陷阱,而应成为照亮成长之路的一缕光。

我们既要看到AI陪伴产品作为情感补充和技术创新的可能性,也需对其可能带来的社会性影响保持清醒审视。唯有通过规范发展、合理引导,才能让它真正服务于青少年的健康成长,帮助年轻一代在拥抱数字文明的同时,能在真实世界中扎根更深、联结更紧。

随着新规的实施,我们有理由相信,AI陪伴类产品会逐渐褪去“无序生长”的浮躁,在规范中找到创新与安全的平衡点。而对于每个家庭来说,这不仅是一份制度保障,更是一份提醒:在数字时代,守护孩子的成长,需要技术的温度,更需要理性的边界。

新媒实鉴

新媒实鉴编辑:于昊

初审:张子雄

复审:王文倩

终审:周行

夜雨聆风

夜雨聆风