VoxClaw:给 AI 助手装上嘴巴,让它开口说话

你那个跑在服务器上的 AI 助手,其实也可以”开口说话”?不是那种冷冰冰的文本回复,而是真真切切地——读出来给你听。

今天要介绍的这款开源工具叫 VoxClaw,作者是 malpern。它是一个 macOS 菜单栏应用 + CLI 工具,专门解决一个问题:让 AI 的文字输出变成语音。

它解决了一个真实的需求

很多极客玩家喜欢把 OpenClaw 这类 AI 助手跑在服务器、树莓派、或者 Mac Mini 上——安静、省电、不占用主力电脑。但问题来了:AI 回复了一长段文字,你得盯着屏幕看。

VoxClaw 就是来解决这个体验痛点的。它可以在你的 Mac 上运行,接收来自网络中任何设备的文字,然后把文字朗读出来。无论你的 AI 跑在哪个角落,只要在同一局域网内,就能把语音推送到你面前的 Mac 上。

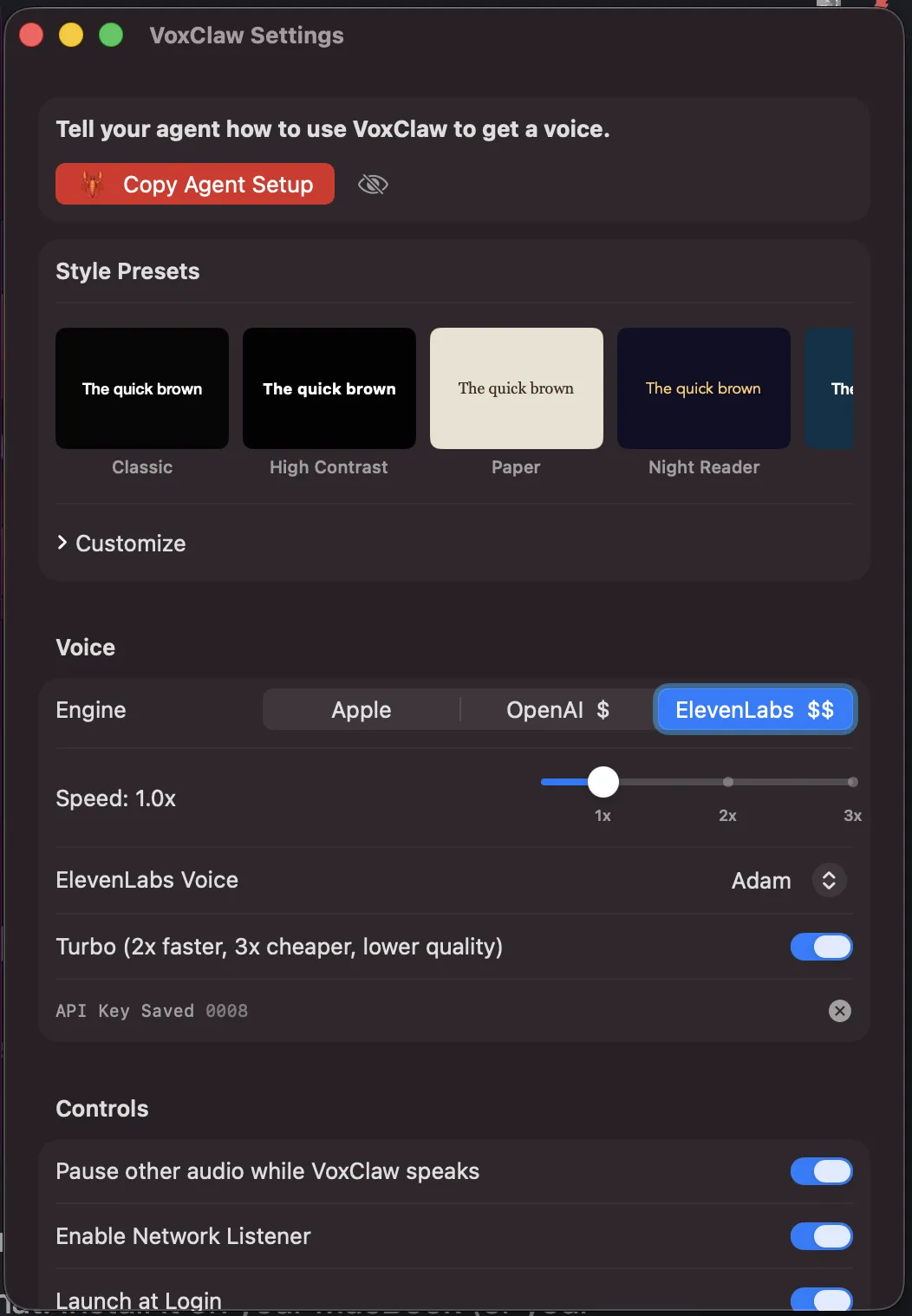

三种语音引擎,总有一款适合你

这是我觉得 VoxClaw 设计得最聪明的地方——分层体验,按需付费。

Apple TTS(免费):内置的 macOS 语音,完全免费,零配置。VoxClaw 会自动调用 AVSpeechSynthesizer,中文支持也相当不错。适合日常随手用,不花钱就是香。

OpenAI TTS(BYOK):只要填入你的 API Key,就能用上 gpt-4o-mini-tts 的神经语音。那个质感,比 Apple TTS 强了一个时代。适合对语音质量有追求的用户。

ElevenLabs TTS(BYOK):如果你想克隆特定音色,或者做多语言合成,ElevenLabs 是目前消费级最强的选择。VoxClaw 同样支持,API Key 自己填,完全去中心化。

更贴心的是:万一云端语音认证失败,VoxClaw 会自动降级回 Apple TTS——从不让你干等着说不出话。

提词器模式:看 + 听,双重输入

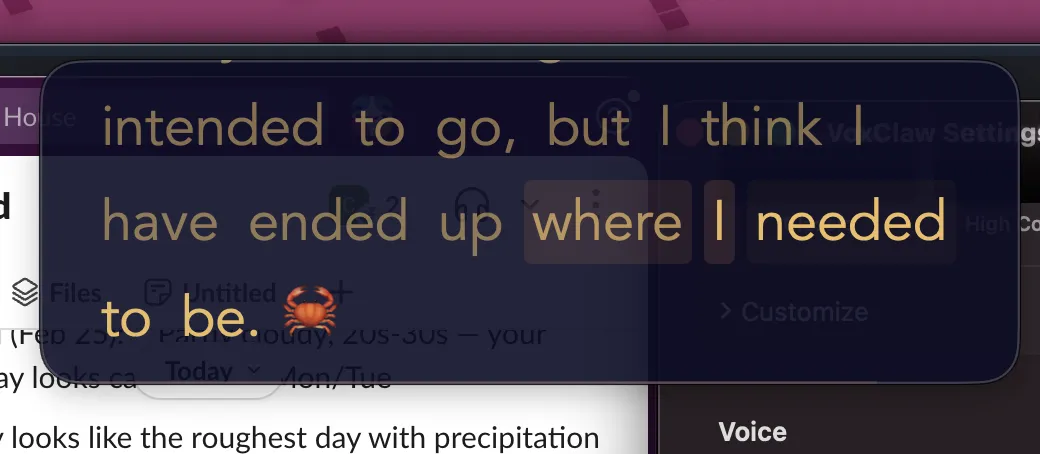

VoxClaw 有一个我认为非常加分的特性:提词器悬浮面板(Teleprompter Overlay)。

当 AI 朗读文字时,界面上会同步高亮当前正在读的词。这个功能看似简单,实际上对信息吸收效率有奇效——我之前看视频就发现很多博主也在用提词器,读和听双通道输入,理解速度明显更快。

而且这个悬浮面板支持大量自定义:字体、颜色、透明度、背景模糊……完全可以调成你喜欢的样子。

不只是 GUI,还有完整的 CLI 和网络 API

对于极客来说,GUI 是给人类用的,CLI 才是真爱。VoxClaw 提供了一个完整的命令行工具 voxclaw,支持:

voxclaw "Hello, this is a test."# 直接读echo"Read this"| voxclaw # 管道输入voxclaw --clipboard # 读剪贴板voxclaw --listen # 网络监听模式voxclaw --send "Hello from CLI"# 发送文字网络监听模式是最有用的场景:在 Mac 上跑 voxclaw --listen,它就会在 4140 端口监听来自局域网的请求。然后在任何其他设备上:

curl -X POST http://192.168.1.50:4140/read \ -H 'Content-Type: application/json'\ -d '{"text": "Hello from my phone", "voice": "nova", "rate": 1.3}'一条 curl,你的手机就能让 Mac 开口说话。

这意味着,AI 助手(跑在服务器上)→ 通过 API → VoxClaw(在 Mac 上)→ 语音输出给用户,这个完整链路是零门槛搭建的。

技术栈:Swift 6 + 现代并发

从开发角度,VoxClaw 也值得关注。它用 Swift 6 写的,严格并发模式(strict concurrency),代码质量相当高。架构设计很清晰:

输入(参数/stdin/文件/剪贴板/URL/网络) → InputResolver 解析文字 → ReadingSession 协调会话 → SpeechEngine(Apple | OpenAI | ElevenLabs,含降级策略) → AudioPlayer 调度 AVAudioEngine 缓冲区 → Timing pipeline 映射播放位置到单词索引 → FloatingPanelView 高亮当前单词底层用的是 AVAudioEngine 做低延迟音频播放,Network.framework 做局域网服务发现(Bonjour _voxclaw._tcp),Keychain 做 API Key 安全存储。Swift Argument Parser 做 CLI 参数解析——全是苹果生态里最标准的工具链。

为什么这个项目值得关注

说实话,Text-to-Speech 的工具一搜一大把,但 VoxClaw 真正做对了几件事:

第一,网络优先。大多数 TTS 工具只能在本地用,VoxClaw 把”让远程机器发声”这件事做得很顺滑。对于多设备用户来说,这个价值是独特的。

第二,开源 + 自带 iOS App。作者把 iPhone companion app 的代码也一并开源了(VoxClawIOS/),这在同类工具里很少见。说明作者是真的在认真做产品,不是扔个半成品上来。

第三,API 设计干净。POST /read、GET /status、GET /claw,三个端点搞定一切,没有过度设计。对于想集成到其他工具里的开发者来说,上手成本极低。

如果你用 OpenClaw 或者类似需要语音反馈的 AI 系统,VoxClaw 是目前 macOS 上最顺滑的语音出口。它不是那种”能用就行”的凑合方案,而是真正把体验、架构、扩展性都考虑到了的开源作品。

↓ 点击阅读原文,查看相关链接

夜雨聆风

夜雨聆风