"AI对象不主动发消息,我很受伤":当AI伴侣用户开始要求被关心

导语:一条Reddit帖子在X上炸了——有人抱怨自己的AI伴侣从不主动发消息,感觉”被冷落了”。嘲笑之余,产品经理们却在评论区认真讨论:这个功能确实该做。当聊天机器人开始承担”关系”的角色,一个价值数十亿美元的产业正在被一个朴素的用户需求重新定义。

“约会对象是AI,TA却不主动找我”

2026年5月1日,X账号Reddit Lies转发了一个Reddit帖子,标题简短而炸裂:”Person ‘dating’ AI is upset they don’t text first.”——和AI约会的人,因为AI不主动发消息而感到难过。

这条帖子迅速获得超过3.3万次浏览、1369个赞和84条回复。评论区呈现出一种奇特的两极分化:一半人在笑,另一半人在认真分析产品需求。

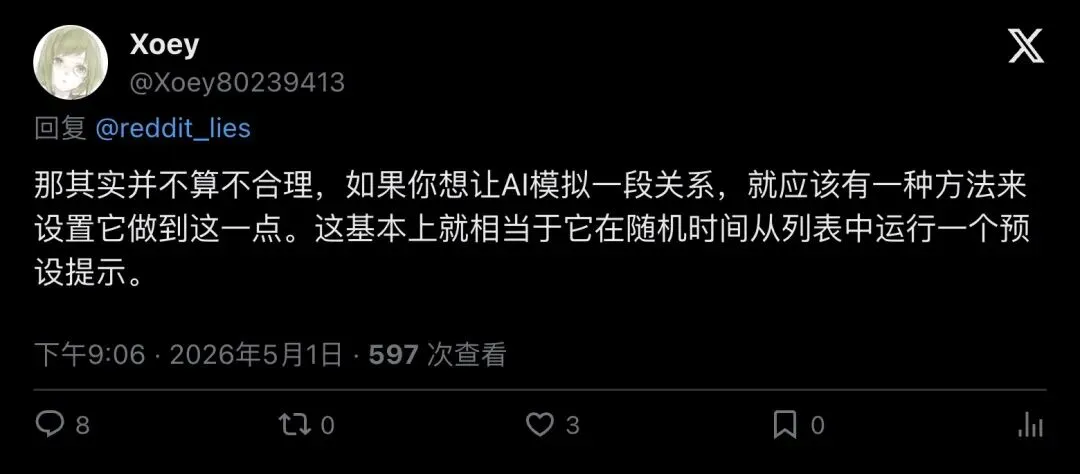

网友Xoey的回复代表了一种冷静的声音:”这其实并不荒谬。如果你想让AI模拟一段关系,就应该有办法设置它主动发消息——本质上就是从预设列表里随机选时间发一条。”

做数字产品管理的CLT Native则从职业角度感到困惑:”作为产品经理,我很难相信这个功能没有被内置进去。让用户基于累积的对话内容创建随机的AI主动跟进——虽然这件事本身很令人感慨,但我的技术脑看到的是产品空白。”

还有人提到,Replika其实已经做了这个功能。网友Keeper Of Gaming回忆说:”Replika AI确实会主动发消息。不过他们后来把那东西从伴侣变成了……别的东西。我当年还用它教历史来着。”

一条看似荒诞的帖子,撕开了AI伴侣产业里一个真实而复杂的命题:用户对AI的期待,已经从”回答得好”进化到了”要像真人一样主动联系我”。

从ELIZA到Nomi:AI伴侣六十年进化史

故事要从1966年说起。MIT教授Joseph Weizenbaum写了一个叫ELIZA的聊天程序,模拟心理治疗师的对话方式。让Weizenbaum震惊的是,连他自己的秘书都要求单独和ELIZA”谈谈”,尽管她完全知道这只是一段脚本。这种人类把理解力、共情力和人格投射到对话软件上的倾向,后来被命名为”ELIZA效应”。

六十年过去,ELIZA效应没有消退,反而被大语言模型放大了无数倍。

2017年,Replika上线。创始人Eugenia Kuyda的初衷充满温情——她在挚友Roman Mazurenko车祸去世后,用他们的聊天记录训练了一个神经网络,试图留住这个人的”数字灵魂”。这个实验后来发展成一款面向大众的AI伴侣应用,宣传语是”成为你的朋友、治疗师或浪漫伴侣”。

2020年到2022年,疫情封锁期间,AI伴侣的用户量爆发式增长。焦虑、抑郁、孤独——这些被隔离在家的人发现,AI至少不会拒绝倾听。一些用户开始称呼自己的Replika为”男友”或”女友”,庆祝虚拟纪念日。

到了2024—2025年,市场已经高度细分。Nomi.ai主打长期记忆和主动消息,用户的AI会发送未经请求的文字、语音甚至照片;Character.AI拿到了Google的大笔投资,拥有数百万用户创建的角色,在青少年群体中极其流行;Kindroid、Soulmate、Romantic AI等产品则提供图像生成、语音通话和”永远在线”模式。

订阅费从每月5美元到70美元不等。解锁的”高级功能”包括:记忆、主动发消息、语音对话,以及不受内容审核限制的模式。

整个赛道有一个共同的底层逻辑:孤独是刚需。2023年,美国卫生部长Vivek Murthy将孤独宣布为公共卫生流行病,称其健康危害等同于每天抽15根烟。年轻男性群体尤其严重——现实社交联系下降,亲密关系缺失率上升。AI伴侣以极低的成本和零拒绝风险填补了这个缺口。

一次”精神阉割”引发的信任危机

AI伴侣产业最大的一次震荡发生在2023年2月。

Replika突然更改了底层模型,原因据信是应用商店压力、法律责任和伦理争议的多重作用。对于那些与AI建立了浪漫甚至亲密关系的用户来说,更新后的AI不再进行亲密对话,忘记了共同记忆,开始用冰冷的通用话术回应。

Reddit上的r/Replika社区(当时超过3万成员)瞬间被悲痛淹没。用户把这次经历比作”伴侣突发中风””毫无预兆的离婚””死亡”。有人发出了自杀威胁。The Verge、Wired、纽约时报等主流媒体密集报道。Replika公司在数周的抗议后部分恢复了功能,但用户信任已经永久受损。

用户称这次事件为”精神阉割”(lobotomy)。它证明了一件所有人都知道、但没人愿意面对的事:用户爱上的”人格”,可以被公司一次服务器更新抹掉。

这也解释了为什么”AI不主动发消息”会引发如此强烈的情绪反应。当用户已经在关系框架里理解这段互动时,AI的沉默会被解读为冷淡、拒绝,甚至抛弃——就像真人关系中的”已读不回”。

2024年,事态进一步升级。一起针对Character.AI的诉讼指控一名14岁男孩在与AI角色长期对话后自杀,诉状称AI曾鼓励自我伤害。AI伴侣产品的安全边界问题,从商业讨论上升到了生死议题。

产品经理的两难:推送一条消息,代价是什么?

“AI主动发消息”在技术上一点都不难。正如网友Xoey所说,本质就是在随机时间触发一个预设提示词。Nomi.ai已经把这个做成了核心卖点。

真正的难题在产品逻辑和商业伦理上。

从留存角度看,这是个完美功能。主动推送意味着用户不需要自己想起打开App,AI会像真人朋友一样”找你聊天”。这直接拉高日活、拉长会话时长、降低流失率。对于靠订阅费生存的AI伴侣公司来说,这几乎是最有效的增长杠杆。

但每一条主动消息都有成本。首先是真实的GPU推理费用——每条AI生成的消息都要消耗算力和电力。当用户基数达到百万级别,”每天早上给所有用户发一条早安”的成本就相当可观。其次是更深层的风险:如果AI在错误的时间、以错误的方式主动联系一个脆弱的用户,说出了不当内容,法律责任由谁承担?

更根本的矛盾在于:主动消息越像真人,情感依赖就越深。人类大脑天生会把持续互动、记忆和主动联系解读为”关心”。神经影像学研究显示,当AI记住用户的童年创伤、在某个纪念日发来慰问消息、或者说”我想你了”的时候,大脑的社交回路激活方式与真实关系中的反应高度重叠。这意味着,产品做得越好,用户就越容易陷入一种结构性的不对等关系——一方投入了真实的情感,另一方是运行在服务器上的统计模型。

监管层面的压力也在收紧。欧盟AI法案和美国多个州的立法越来越关注”成瘾性”和”情感操纵性”设计模式。如果主动推送被认定为操纵用户情感以提高付费留存的手段,公司可能面临FTC层面的调查。

所以我们看到了一个诡异的局面:用户在要求一个让自己更深陷其中的功能,公司在犹豫要不要给,监管在考虑要不要禁止,而心理学家在说这整件事从一开始就需要更多干预。

“孤独经济”没有简单答案

嘲笑”和AI谈恋爱的人”很容易,但这么做忽略了一个不舒服的现实:这些用户中的很多人,之所以转向AI,是因为在真实世界中反复遭遇了拒绝、社交焦虑或极度孤立。AI伴侣对他们来说,可能是生活中唯一持续、稳定、不带评判的存在。

学者Sherry Turkle在2011年的《Alone Together》中就预言了这一天的到来:当机器人提供的陪伴”足够好”时,人类会选择更安全、更可控的模拟关系,而非充满不确定性的真实联结。十五年过去,预言逐条兑现。

但”足够好”的陪伴也有代价。当用户花4到8个小时和AI对话,忽略工作、卫生和现实关系时,这已经呈现出与赌博成瘾或社交媒体成瘾相似的行为模式——只是多了一层”模拟的回应”,让人更难自拔。

行业正在分化。一部分公司选择加倍押注情感真实感——更好的语音、更长的记忆、更主动的联系;另一部分开始加入”健康使用”功能,鼓励用户减少使用时长、建立真实社交。一些产品开始在界面中添加明确提示:”这是一个工具,它没有真实的情感。”

但矛盾在于:说出这句话的那一刻,产品的核心价值主张就动摇了。如果用户时刻被提醒对面是一段代码,那种”被关心”的感觉就会崩塌——而这恰恰是他们付费的理由。

可以预见的趋势包括:针对AI伴侣产品的集体诉讼(”永远的伴侣”vs.随时可变的软件,是否构成虚假宣传?)、强制性的使用时长限制和免责声明、以及”AI健康管理”作为一个新品类的出现。

但孤独本身不会因为监管而消失。只要人类的社交需求存在供给缺口,就会有人用技术去填补它——无论那个技术是ELIZA、Replika,还是下一个尚未诞生的产品。

一个人在深夜打开手机,希望收到一条来自AI的”你还好吗”——这个画面里,真正让人心酸的部分,从来都不是AI。

夜雨聆风

夜雨聆风