【2026-05-10】AI 正在改写软件世界最值钱的 5 个隐形层

AI 正在把软件世界里原来不太起眼、但其实很要命的几层结构,一层层翻出来。

以前大家聊软件,更多聊功能、体验、速度。现在不太一样了。真正影响收入和决策的,越来越多是这些问题:

-

• 谁能进来 -

• 谁被挡在外面 -

• 你拿什么证明它没坏 -

• 这笔 AI 费用为什么会失控 -

• 平台不可信之后,能不能走

这几件事以前更像后台问题,通常只有工程团队盯着。现在已经不是了。它们开始直接影响增长、采购、合规和迁移。

所以这次我不想重讲一遍热点,我更想把其中 5 个最有意思的话题挑出来,好好说说。

1. 反滥用系统,已经不只是安全问题了

今天最扎眼的一组信号,其实不是模型,而是入口。

reCAPTCHA 对去 Google 化 Android 用户失效,Google 的 fraud defense 又引来一轮争议,再加上 VPN 限制、年龄验证、平台把某些流量默认判成可疑,这些事放在一起看,味道已经变了。

它们表面上是安全、风控、反滥用。

但对产品 owner 来说,翻译成人话就是一句:到底哪些真实用户,现在进不来了。

这才是最痛的地方。

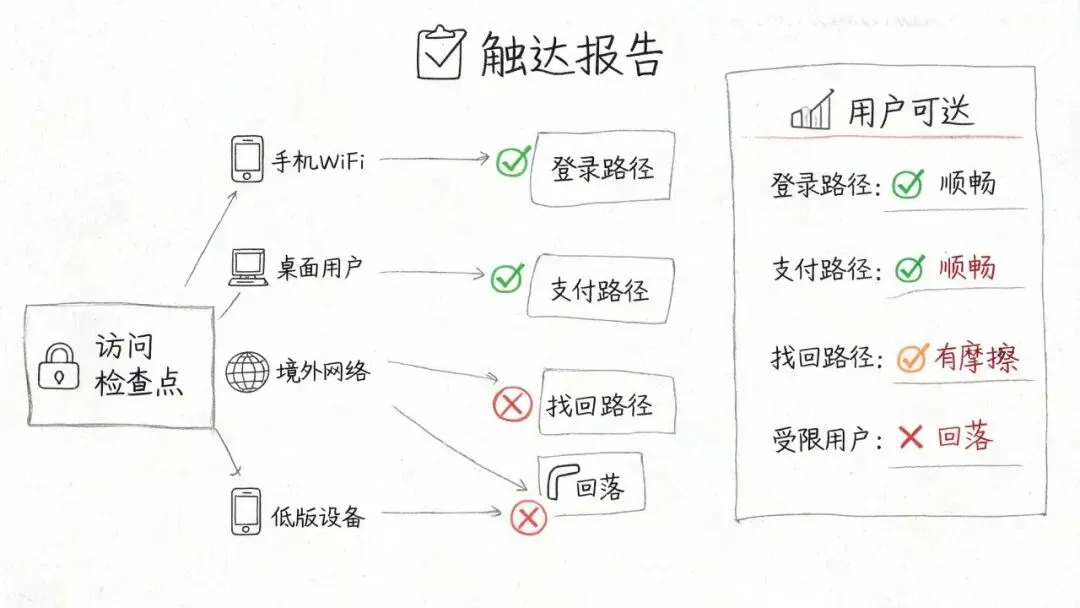

因为用户被拦在登录页、付款页、找回密码这类地方,损失是立刻发生的。更麻烦的是,很多团队一开始根本不知道自己在丢谁。

所以这类信号背后真正值钱的,不是再发明一个更复杂的验证码,而是把问题做成一份清楚的报告。哪些设备会失败,哪些网络环境会失败,哪里没有 fallback,哪里会直接影响注册和收入。

这个买家非常清楚。增长、支持、合规、老板,都听得懂。

2. 团队开始不相信“应该没问题”,他们要证据

为什么 Bun 的 Rust rewrite 会有那么大讨论?

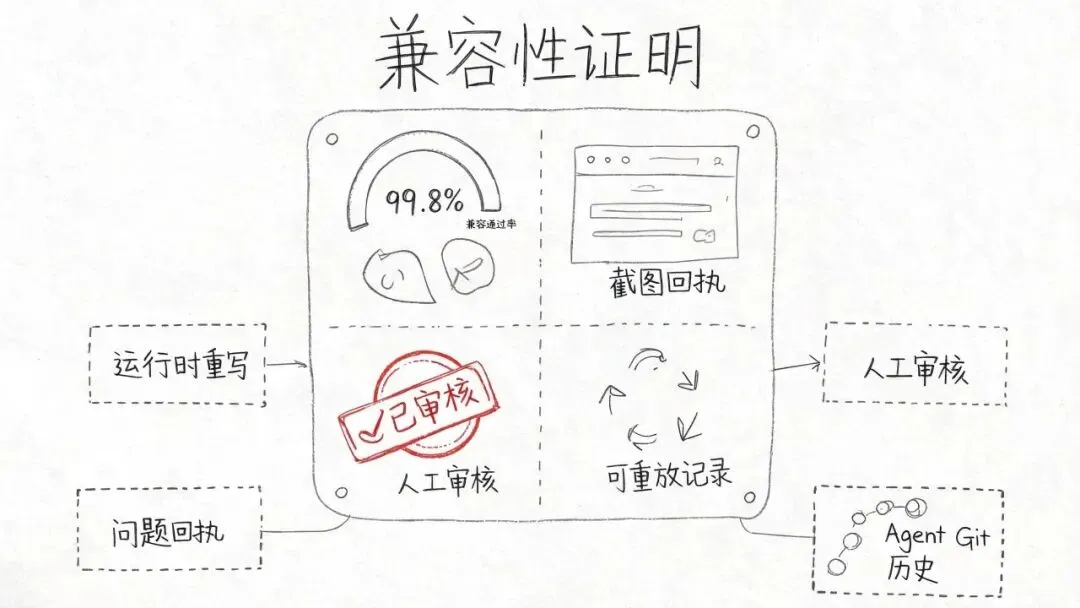

我觉得不是因为大家突然都关心底层实现,而是因为它给了一个大家能抓住的数字:99.8% 的测试兼容性。

这个细节很重要。

今天的软件团队,越来越不吃“理论上没问题”“重写后应该差不多”这一套了。他们想看证据,最好还是能复查的那种。

而且这个趋势并不只出现在运行时。

另一篇里也有很多碎片,但拼起来很清楚:

-

• BugDrop把反馈直接变成带截图的 issue -

• OpenRouter 给高风险调用加人工审核 -

• “给 AI 代理用的 Git”开始有人认真讨论 -

• 有人直接把 bug 复现、修复、再验证,拆到隔离环境里并行做

这些东西说的其实是同一件事:AI 不只是要把动作做完,还得留下回执。

改了什么,在哪一步失败,谁点了确认,用的是哪个环境,之后能不能再放一遍。

以后真正会留下来的,不只是自动化本身,而是这种可核对的结果单。

3. AI 一旦开始代你处理文档,风险就不再只是“写错一句话”

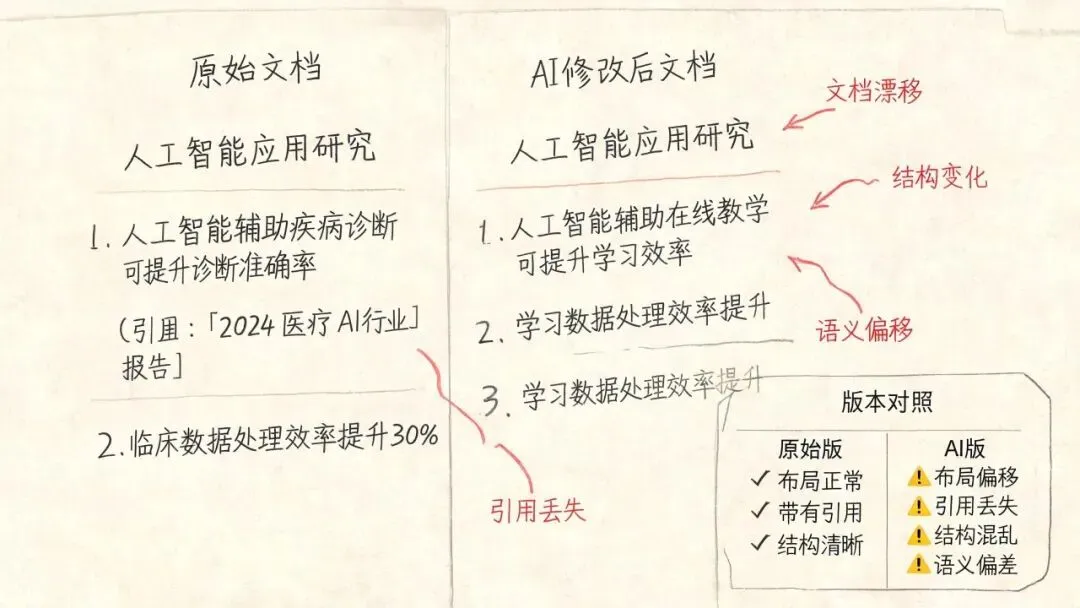

那篇讲 LLMs corrupt your documents when you delegate 的论文,我觉得特别值得重视。

原因很简单。文档风险比聊天回答错一道题麻烦得多。

AI 代你改文档的时候,最危险的往往不是明显错误,而是那些一开始看不出来的变化:

-

• 版式乱了 -

• 引用掉了 -

• 结构偏了 -

• 意思悄悄变了

等你发现的时候,文档可能已经被发出去了。

这件事一旦进入真实工作流,就会变得很贵。因为文档不是普通文本,它常常是合同、汇报、研究材料,是团队对外输出的一部分。

再回头看另一篇里那些很热闹的内容,比如 GBrain 这类个人 AI 系统、长期知识管理、把重复工作交给 AI 持续跑,你会发现,系统越大,委托越深,这种漂移风险就越真实。

所以这里一定会长出一层新工具,而且需求会很实在:

-

• 文档 diff -

• 引用核对 -

• 结构检查 -

• 语义漂移提醒 -

• 委托前后版本对照

大家前一阶段在追求“让 AI 多做一点”,下一阶段很可能会转向“让 AI 做完别把东西悄悄做坏”。

4. AI 成本终于从技术兴奋,变成财务问题了

我觉得这可能是今天最真实、也最容易被忽视的一层变化。

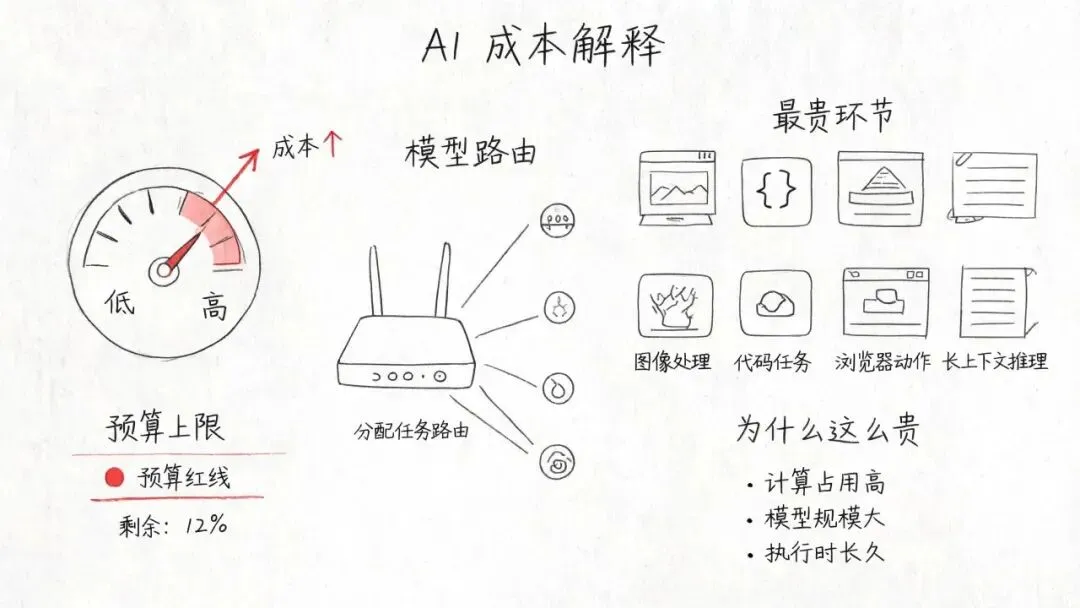

前一阵大家聊 AI,聊的是能力边界。现在越来越多人开始问一件很朴素的事:这玩意到底为什么这么贵。

搜索里 "ai agent image processing expense" 暴涨 2550%,这个词很别扭,但也正因为别扭,反而特别真。会这么搜的人,不是在围观新闻,而是在查账单。

另一篇里也能看到同样的方向:

-

• Pareto Code 在讲怎么按门槛去选更便宜的编码模型 -

• Bugbot 从订阅切到按使用量计费 -

• 一堆模型和平台都在强调成本、吞吐和预算效率

这说明市场关注点已经在变了。

当 AI 进入图片处理、代码修复、长上下文推理、浏览器动作这些流程之后,它就不再是一个模糊的创新预算,而是一笔持续发生的运营成本。

一旦变成运营成本,管理动作就会跟着长出来:模型路由、预算上限、任务级成本解释、花费告警、最贵环节分析。

所以后面更容易被买单的,很可能不是“再给你接一个模型入口”,而是“把这笔 AI 钱讲清楚”。

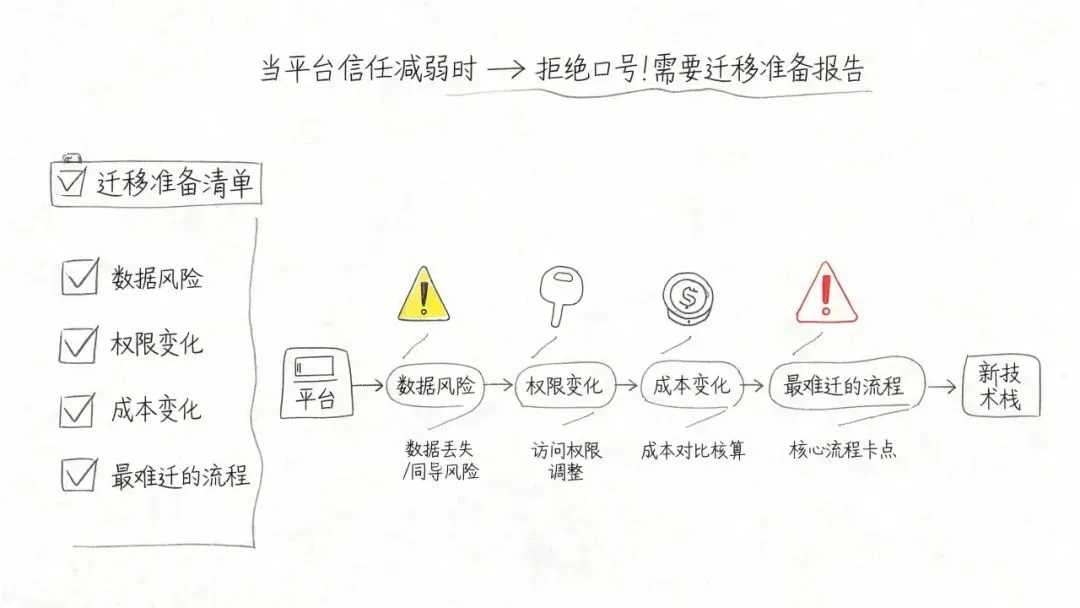

5. 平台信任一旦松动,迁移和本地控制就会重新变热

最后一个我很在意的信号,是退出路线开始变具体了。

日报里那些 GitLab self-hosted、OpenCloud、Zulip、Gitea、Jellyfin 的搜索,不太像单纯的兴趣词。我更愿意把它们理解成一种准备动作。

很多人不是突然爱上折腾,而是在给自己找后路。

这件事放在今天这个上下文里看就更明显了。入口控制在变,平台信任在变,加密承诺会收缩,AI 成本在上升,文档风险也在变重。那团队自然会开始想:如果我要走,怎么走。

另一篇里那些内容,其实也在补这条线。

比如 Redis 创始人想办法把更强的模型往个人电脑里装。比如 GBrain 这类系统把知识和工作流尽量抓回自己手里。再比如一堆围绕本地工具、桌面操作、CLI、MCP 的实践,本质上都在强调控制权离用户更近一点。

所以真正值钱的,不是空喊一句“替代某某平台”。

而是做一份真正有用的 readiness report:

-

• 迁过去会坏什么 -

• 哪些流程最难搬 -

• 成本会变多少 -

• 权限边界会怎么变 -

• 哪些历史数据最需要先处理

买家最后买的,通常不是情绪,而是一份能帮他少踩坑的说明书。

最后

如果让我用一句话总结这两篇文章真正交汇的地方,我会这样说:

AI 正在把软件世界里最值钱、也最容易被忽略的几层隐形结构,一层层翻到桌面上。

入口是不是在悄悄关上,系统有没有证据,文档会不会漂移,账单为什么失控,平台不可信之后路该怎么走。

这些事以前都偏后台,偏工程,很多团队会先往后放。

现在已经拖不动了。

因为它们开始直接影响增长、收入、采购和迁移。

所以我越来越觉得,下一批真正稳的产品,不一定是再做一个更会说话的 AI。

更像是下面这些东西:

-

• 触达报告 -

• 兼容性证明 -

• 文档防漂移 -

• AI 成本解释 -

• 迁移准备清单

热闹当然还会继续。

但最后留下来的,往往不是热闹本身,而是那些帮团队重新拿回控制权的小工具。

夜雨聆风

夜雨聆风