一、295%

295%。

一个足以让任何互联网公司警惕的数字。

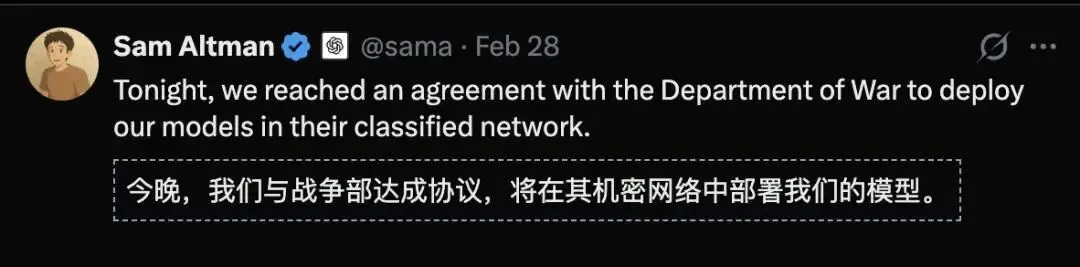

2026年3月,OpenAI宣布与美国国防部达成合作的第二天,ChatGPT移动端的单日卸载量激增了近3倍。与此同时,它的竞争对手Claude在App Store的下载量创下新高。

一切发生得如此突然。

曾经,OpenAI代表着AI领域最理想主义的那一面——"确保AI造福人类"的口号还在耳边。而当这家被视为AI行业标杆的公司,与五角大楼走到一起时,无数用户用用自己的行动表达了不满:卸载、转向竞争对手。

“我无法接受我的对话数据可能被用于军事目的。” 一位用户在Reddit上写道。

类似的声音不在少数。在社交媒体上,"删除ChatGPT"成了热门话题,#DeleteChatGPT 标签迅速刷屏。而另一边,以"安全优先"著称的Anthropic旗下产品Claude,则受到大量用户的追捧。

一家公司的战略转向,为何引发如此剧烈的用户反应?背后究竟反映了AI行业怎样的深层次矛盾?

当AI公司不得不站在国家安全的十字路口,用户的信任,还剩多少?

二、一条声明引发的地震

2026年3月2日,OpenAI发布声明,宣布正式与美国国防部建立合作关系。根据协议内容,OpenAI将向五角大楼提供AI技术支持,涉及网络安全、情报分析等领域。

消息公布后仅仅24小时,数据分析平台Sensor Tower监测显示,ChatGPT在iOS和Android双平台的单日卸载量较前一周平均值暴涨 295%。

📊 与之形成鲜明对比的是,Anthropic旗下的Claude在同期的下载量增长了约40%,一度冲上App Store免费应用下载榜前列。

舆论发酵

社交媒体上,"删除ChatGPT"迅速成为热门话题。

在Reddit的ChatGPT讨论区,大量用户在帖子中分享自己卸载ChatGPT的截图,并解释卸载原因。在X(原Twitter)上,#DeleteChatGPT 和 #ByeByeChatGPT 成为趋势话题,阅读量在48小时内突破5000万次。

一位拥有数十万粉丝的科技博主发布视频称:“我不是反对AI帮助国防,但OpenAI从’AI安全守护者’变成’军事供应商’的速度之快,让我感到不安。”

与此同时,大量用户开始认真考虑"第二选择"。Claude、Perplexity、Google Gemini等竞品在应用商店的排名均有不同幅度上升。

这场由合作声明引发的用户迁移,或许只是开始。

三、用户为何逃离?

295%的卸载量,不是一时冲动的情绪化反应,而是用户深思熟虑后的选择。这背后有三个核心原因。

1. 隐私与数据安全担忧

“我不知道我的对话数据会被用来做什么。”

这是许多卸载ChatGPT的用户最直接的顾虑。军事合作意味着什么?用户与AI的对话内容、提问习惯、甚至潜在的个人信息,是否会被用于军事目的?

这种担忧并非杞人忧天。

OpenAI的服务条款中明确写着“我们可能会使用用户输入的内容来改进模型”。当AI公司与军方建立联系后,用户难以区分:自己的对话是仅仅用于优化一个商业产品,还是成为了某个军事项目的数据养料。

💡 “我每天都用ChatGPT处理工作内容,里面可能涉及商业机密。” 一位从事咨询行业的用户在接受媒体采访时表示,“我无法接受这些信息可能与五角大楼共享。”

2. 信任危机:理想主义的破产

如果说隐私担忧是理性层面的顾虑,那么信任危机则是情感层面的暴击。

回望OpenAI的发展历程,"安全"曾是它最核心的标签。2015年成立之初,OpenAI的使命宣言是“确保通用人工智能造福全人类”。在GPT-3、GPT-4发布时,OpenAI反复强调AI安全的重要性,批评竞争对手“不够谨慎”。

然而短短几年,这家曾以"AI安全守护者"自居的公司,如今却与军事机构深度合作。这种180度的形象转变,让许多早期支持者感到被"背刺"。

💔 “他们变了。” 一位一开始就使用ChatGPT的老用户在社交媒体上写道,“曾经那个说着’AI安全第一’的OpenAI,已经死了。”

3. Claude的吸引力:差异化定位

用户的迁移方向,很好地说明了一个问题——他们不是不需要AI助手,只是需要换一个更符合自己价值观的选择。

Claude之所以成为最大受益者,核心在于Anthropic一直强调的 “安全优先” 定位。

与OpenAI不同,Anthropic从创立之初就主打AI安全研究,其产品Claude在隐私保护、内容安全、AI对齐等方面投入了大量精力。在与五角大楼合作的消息公布后,Anthropic迅速发表声明,重申其“不参与军事项目”的原则。

这种“你退我进”的策略,成功承接了从ChatGPT迁移过来的用户。大量用户在Claude的应用商店评论区表示:

- “转过来了,隐私政策更让人放心”

- “终于找到一个有道德底线的AI”

⚡ 总结来看:这是一场由隐私焦虑、信任崩塌、替代品吸引力共同驱动的用户迁移。它暴露的不仅是OpenAI的战略失误,更是整个AI行业面临的根本性悖论——当AI技术越来越强大,它究竟应该服务于谁?

四、当AI公司必须"选边站"

OpenAI与五角大楼的合作,或许是AI行业发展的一个标志性节点。它标志着:AI公司曾经可以置身于地缘政治之外的美好时代,正在加速远去。

路线分化:理想主义 vs 现实主义

这场风波,清晰地勾勒出AI行业两条截然不同的发展路线。

OpenAI 代表的是"现实主义"——技术先行,商业化加速,与政府深度绑定。在他们看来,AI已经成为国家竞争力的核心,与其被排斥在决策圈外,不如主动参与规则制定。

Anthropic 则走的是"理想主义"——坚持AI安全研究,避免军事应用,试图在商业利益与社会责任之间寻找平衡。此次ChatGPT用户大规模迁移,恰恰验证了这条路径的市场价值。

两条路线没有对错之分,但正在塑造完全不同的用户群体和品牌认知。

政府合作的潘多拉盒子

OpenAI并非第一个与政府合作的AI公司,也不会是最后一个。

事实上,美国国防部早已与多家AI公司建立了合作关系。Anthropic在此之前也与部分政府机构有过接触。但这一次,OpenAI的高调合作撕开了一个口子——

当AI公司开始"选边站",用户是否还有选择权?

信任,正在成为稀缺资源

一个值得关注的趋势是:用户的信任,正在成为AI公司最稀缺的资产。

ChatGPT卸载量暴涨295%的背后,是用户对AI公司"技术中立"承诺的深度怀疑。当AI能力越来越强大,当AI应用场景越来越广泛,用户开始意识到:选择一个AI产品,不仅仅是选择一个工具,更是选择一种价值观。

这意味着,未来的AI竞争,除了技术本身的比拼,更将是 信任与价值观 的竞争。

五、技术中立,还是立场先行?

回到开头:当AI公司不得不站在国家安全的十字路口,用户的信任,还剩多少?

295%的卸载量,给出了一个有些残酷的答案。

用户用脚投票的背后,是对技术中立承诺的深深怀疑。当OpenAI从"AI安全守护者"变成"军事供应商",那些曾经相信"AI造福人类"的用户,感到的不只是失望,更是一种被背弃的愤怒。

这或许是AI行业必须面对的成长代价——当技术足够强大,它就不可能再假装自己“与政治无关”。

但对于普通用户而言,选择权依然在我们手中。你可以选择继续使用ChatGPT,也可以转向Claude、Google Gemini,或是其他AI产品。

🗳️ 技术本身没有立场,但做出选择的人有。

夜雨聆风

夜雨聆风