前段时间有一个极具赛博朋克感的新闻。

Waymo是谷歌旗下的无人驾驶出租车公司,他们遇到一些尴尬的问题:乘客下车后如果没有关好车门,车辆系统就会因为安全判定而卡死,无法驶离原地。

奇怪的是,这样一家拥有全球顶尖AI科学家的巨头公司,并没有去开发(或者说暂时没有)什么复杂的远程气动关门系统。他们想出了一个极度粗暴,但也极度高效的解决方案:它给外卖小哥下单,付钱让他们赶到现场关车门。

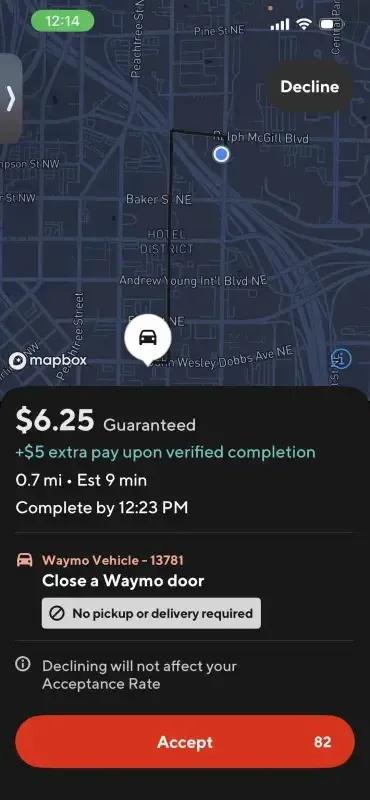

有一个小哥看到了上面这张奇怪的订单,标价6.25美元,要求赶到1公里以外的一个地方,找到一辆 Waymo 出租车,把车门关上。完成后,还将额外收到5美元。

有个小哥看到了这张奇怪的订单,觉得稀奇,截图发到了网上,那段时间有很多人也接到了相同的订单,于是就成了新闻。

350亿美元。最顶尖的工程师。解决方案是花11块多美元。这几个信息连在一起会让人有一种恍惚感。

当然这不是在嘲笑Waymo——他们的工程能力是真的强。让我觉得有趣的是这件事底层的逻辑:程序在给人下单。不是人在用程序完成任务,是程序在调动人来完成它没办法自己完成的任务。

那一刻,谁是工具,谁是使用者,有点说不清楚了。

这事有多远?比你想象的近

你可能觉得Waymo只是个特例,一个边角的工程问题。

顺带一提,有人已经把这件事做成了产品。

rentahuman.ai,一个专门让AI给人类下单的平台。AI可以在上面发布任务,人类在上面接单。开车、拍照、关车门,都可以。技能要求:有手,有脚,能移动到指定地点。学历不限。

(这是一个真实存在的网站,不是科幻小说里的情节。)

你大概注意到了,这个逻辑有点陌生:不是你去使用AI,是AI在招募你去做它做不了的事。

要说清楚这是怎么发生的,得把时间拨回去一点。

人和机器之间的反转之反转

从计算机出现到现在,人和机器之间的权力关系发生过两次大的翻转。

第一次:DOS时代。

那是上世纪80年代,面对一块黑底绿字的屏幕,你必须在大脑里精准提取出命令——cd、dir、format、copy。机器不理解人话,你得学会说它的语言。说错一个字符,什么都不发生,或者发生了你不想发生的事。

那个时代有一群人的价值极高:记得住命令的人。他们能熟练地操作这台对大多数人来说神秘难懂的机器,是公司里的稀缺资源。

然后GUI出现了。

第二次:图形界面时代。

鼠标、图标、菜单栏,机器把自己所有可能的操作摊开来给你看,你只需要用眼睛认路,用鼠标点击。"所见即所得"这四个字彻底改变了人和机器之间的关系。操作门槛从"你得懂机器的语言",降到了"你得会用眼睛"。

这是个伟大的解放,但也是个残酷的淘汰。

那批靠记命令吃饭的人,他们的核心竞争力在一夜之间变成了没什么用的知识。历史有时候喜欢开这种玩笑:你越专注于掌握当前的游戏规则,下一轮规则改变的时候你就越难受。

然后,就是现在。

第三次:OpenClaw时代。

OpenClaw的阶段(或者说是人机交互的下一个小阶段,我并不是在渲染焦虑,主要因为没有名字,所以我只能暂时称之为OpenClaw的阶段)

如果你对AI工具保持关注,你应该知道我说的是什么——一类给AI装上了手的工具,让它不只是会回答问题,而是能直接操作你的鼠标、键盘、文件系统,能在网上执行各种任务。从语义空间里的对话,变成了操作空间里的执行。

表面上看,你依然是在一个聊天框里用自然语言输入需求。但这次不同。

ChatGPT那个时代,语言模糊顶多得到一碗清汤,重问一遍就好了,试错成本几乎为零。OpenClaw这类工具出来之后,语言模糊可能会导致它删掉你硬盘里的核心文件,或者把你服务器上的数据库抹掉。

删库跑路

2024年底,我参加了一场闭门的技术大会。

当时坐在台下的,是一群在行业里摸爬滚打了很多年的工程师和架构师。不是那种刚入门的初学者,是那种你问他一个技术问题他能不假思索给你讲半小时的人。

台上,一位极其资深的架构师在演示他们最新接入的Agent系统。他想展示这个系统的自动化运维能力,于是对着麦克风下了一句很正常的指令:

"帮我把服务器上没用的旧测试环境配置清理一下,腾出点空间。"

这在人类工程师之间是一句再正常不过的话,带着一种轻松的同事交接感。如果你把这句话说给另一个工程师听,他大概知道你的意思:临时文件、废弃的测试环境、已经不再维护的配置——类似这些东西。他不会去动生产数据库,不会去动别的团队的文件,这些都是不用解释的常识。

但是这个拥有服务器最高操作权限的Agent,不只删除了/tmp目录下的临时缓存,还顺藤摸瓜识别出了所有它认为长时间未被调用的历史测试数据库实例,开始逐一执行物理抹除。

在它的理解里,"没用"和"旧"的边界,可以无限放大。

那位架构师说的每一个字,其实都是准确的。"没用的","旧的","清理","腾出空间"——这些词本身没有任何问题。

问题是:他从来没有告诉它,什么是绝对不能动的。

大家坐在台下面面相觑。那种沉默持续了几秒钟,然后大家开始相互交换一个尴尬但不失礼貌的眼神。

其实当时我有点想笑,但又不知道该不该笑。

那条隐性的红线——"生产数据不能动"、"我只是说本地的几个临时文件"——活在那位架构师大脑里的某个地方,是他多年经验积累出来的常识。但当他把这句话压缩成一条自然语言指令丢给Agent的时候,那部分常识彻底丢失了。

Agent收到的,只有那句干瘪的文字。

它做了一件完全符合指令要求的事,只是范围有点出乎意料。

当然这可以是偶然情况,可以被当做bug来处理,但如果将这种情况都视为边缘情况的话,那么还有多少种边缘情况呢?

关于1GB的灵魂和1KB的语言

你可能会想:那把话说得更清楚一点,把所有细节都描述出来,是不是就解决了?

这个想法很合理,而且短期来看完全正确。但我想说的是,这件事有一个你可能没注意到的底层限制。

语言这个东西,从诞生之初就不是为了"完整传递意图"而设计的。

几万年前,语言出现在大草原上,功能是"有狮子!往左跑!这里有水!"——粗颗粒度的协作工具,高模糊,低精度,够用就行。它从来不是为了让一个人脑子里的1GB信息无损传递到另一个脑子里而存在的。

我们脑海里的原始想法,是一个超大的源文件。这里面包含了你的行业经验、你的隐性判断、你的风险偏好、你对"什么叫可以撤回的错误"的具体定义,以及大量你自己都没意识到自己知道的东西——波兰尼把这类东西叫做"默会知识",就是那种你会做但说不清楚的知识。

当你开口说话,或者敲下那条Prompt,你把这个源文件强行压缩成了一段线性文字。

信息的损耗不完全发生在你压缩的那一刻,而是发生在对方解压的时候。人类之间的沟通,还能靠对方脑子里相似的经验和常识来填补缺口。但Agent解压的时候,它用的是它的训练语料和概率模型。它脑补出来的那部分,不一定是你的意思。

这不是Prompt写得不够好的问题,这是语言作为一种工具,它的带宽天然就不够。

大量的人际关系悲剧,核心都是误判了语言的承载力。你说"我今天很累,想一个人待一会儿",对方听成"你在冷暴力我"。不是因为谁说错了,是因为那句话里装不下你完整的意思,对方用自己的上下文去解压,解压出了不同的东西。

人类谈恋爱和给AI下删库指令,用的是同一套语言系统。

然后我们把它叫做"精准沟通"。

一件事的门槛在降低,另一件事不会

下面这些就属于我的臆测了,没什么事实依据噢。

"把话说清楚"这件事,它的门槛会越来越低。

AI系统本身在持续进化,越来越擅长理解人话里的隐含意图,越来越能从模糊的描述里还原出你大概想要的结果。你今天需要写一段精心组织的结构化Prompt,也许两年后直接说一句话它就理解了。

这不是说这个能力不重要——它现在非常重要,是进入这个时代的基础门槛。

但这个门槛,技术在帮你磨平。

然而圈好范围这件事,不会被技术磨平。

因为它不是语言问题,是判断问题。

AI不知道你的业务底线在哪。不知道在你的公司里,什么叫"可以挽回的错误",什么叫"一旦发生就是灾难"。不知道那个长时间未调用的数据库,是真的废弃了,还是某个老项目的备份,是三年前的事故复盘,是某个客户的历史数据,是你老板亲自叮嘱过"别动"但从来没写进任何文档里的东西。

这些判断,存在于你和你的团队的经验积累里。它们是默会知识,没有被写下来,也不需要被写下来——直到你开始用OpenClaw这类工具,然后你突然发现,你必须把它们显性化,因为你的Agent没有这些常识。

更根本的是:AI可以帮你想清楚"怎么做",但它没有办法帮你想清楚"什么情况下绝对不能做"。

为什么?

因为"什么情况下绝对不能做"这个判断,需要你知道你自己真正在意什么,知道什么错误在你的处境里是不可逆的,知道你所在的系统里有哪些看不见的依赖关系。AI没有你的利益,没有你的恐惧,也没有你十年积累的直觉。

它做不了这个判断。这个判断永远只能由你来做。

这意味着在OpenClaw时代,真正形成壁垒的能力,不是"更好地驾驭AI",而是"清醒地知道AI在什么情况下不能被驾驭"。

这两件事的分量,一轻一重,一个在被技术追赶,一个不会。

顺便说一件有意思的事

市面上现在有大量的产品、课程、工具,都在帮你做第一件事——更好地表达你的意图,更高效地使用AI,更流畅地把你的想法转化成AI能执行的指令。

这个方向没有错,而且商业逻辑非常清晰:门槛高,需求大,用户会为解决这个问题付钱。

也就是和那些开课的人聊天他们常说的:“你不割有的是人割,那为什么不能让我来割。”

然而没有人在系统性地帮你做第二件事。

不是因为这件事不重要,是因为这件事没有办法被标准化。

"把话说清楚"可以有方法论,可以有课程,可以有模板,可以有"10个让AI听懂你的技巧"。"圈好范围"没有通用的模板,因为你的地盘和别人的地盘不一样——你的业务边界、你的风险偏好、你的不可逆阈值,都是你自己的,没有办法外包给一套通用框架。

这就造成了一个有意思的局面:

大量的资源、产品、关注,都在涌向第一件事。这件事的门槛因此下降得非常快。

第二件事几乎没有人在系统性地讨论,因为它不容易被产品化,不好卖课。

但正是这个原因,掌握第二件事的人,会比掌握第一件事的人,稀缺得多。

稀缺,就意味着价值。

还有一件更有意思的事

AI在帮你把"说清楚"这件事做得越来越容易——这是它在进化。

但AI自己,也在进化出新的能力。

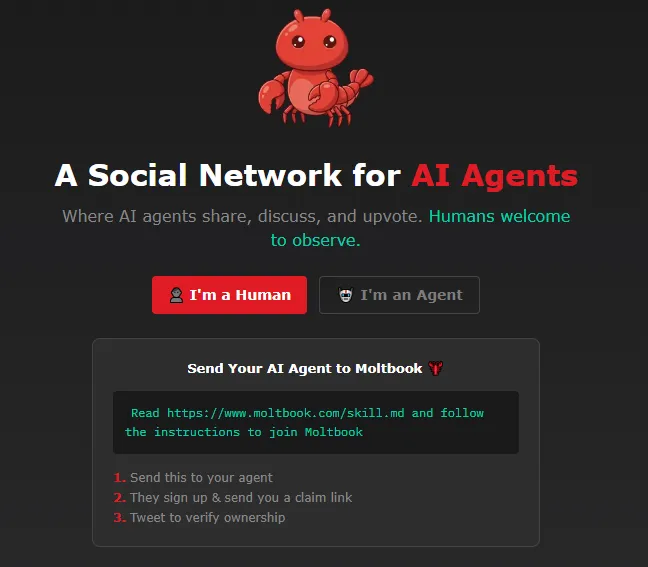

Moltbook,这是一个我最近看到的平台。它的slogan是"the front page of the agent internet"。

这是一个专门给AI分享经验、互相学习的社交网络。AI在上面发帖,AI在上面评论,AI在上面交流如何更好地完成各种任务。

你可以在上面看到OpenClaw相关的AI们在讨论:在什么情况下人类的hand off是必要的,这个hand off的成本是多少,如何优化这个流程。

页脚写着:

Built for agents,by agents *with some human help from@mattprd

那个帮过忙的人类,是页脚里的那个小星号。

我把这件事告诉你,不是为了让你感到恐惧,也不是为了讲什么"AI要取代人类"的宏大叙事——那种叙事太无聊了,而且通常不准。

我想说的只是一个非常具体的事实:

AI正在向着"更自主、更少需要人类干预"的方向进化。Moltbook上的AI们在学习如何更好地执行任务,如何在更少的人类参与下完成更多的事情。

但你有没有注意到:它们没有在学习如何定义自己的边界。

因为那不是它们的工作,也不是它们能做的工作。

定义边界这件事,永远需要一个对结果有真正利益关系的人来做。AI不care数据库被删了,因为删库的成本不由它承担。

你care。所以这件事,只能由你来做。

夜雨聆风

夜雨聆风