龙虾+企业,真的不行吗?

这段时间,OpenClaw 成了很多企业的关注焦点。

不只是因为它的能力迭代变得更聪明,更是因为它第一次让超级智能体接入业务流程这件事,从概念落到了触手可及的近处。

企业会心动太正常了。

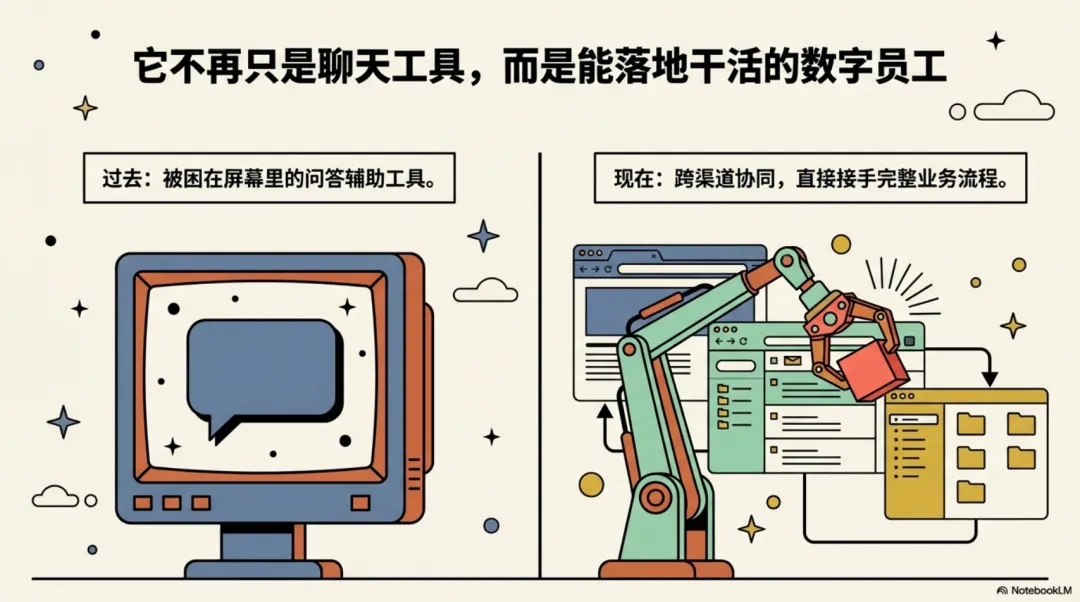

和以往只能答题、聊天的 AI 不同,OpenClaw已经能操作浏览器、邮箱、计划任务、各类外部工具,甚至能跨多个渠道完成协同动作。

换句话说,它不再只是个会说话的 AI,更像一个能落地干活的执行岗员工。

这也恰恰是最容易让企业管理者上头的地方。

以前大家看 AI,关注的多是内容生成、问答辅助这类提效工具;现在看 OpenClaw,第一反应都是它能不能直接接手一段完整的业务流程。

一旦有了这个想法,整个判断逻辑就全变了 —— 你要评估的不再是一款新工具好不好用,而是一个数字员工能不能进核心业务、能不能对接内部系统、能不能长期稳定落地运行。

可问题也恰恰出在这里。

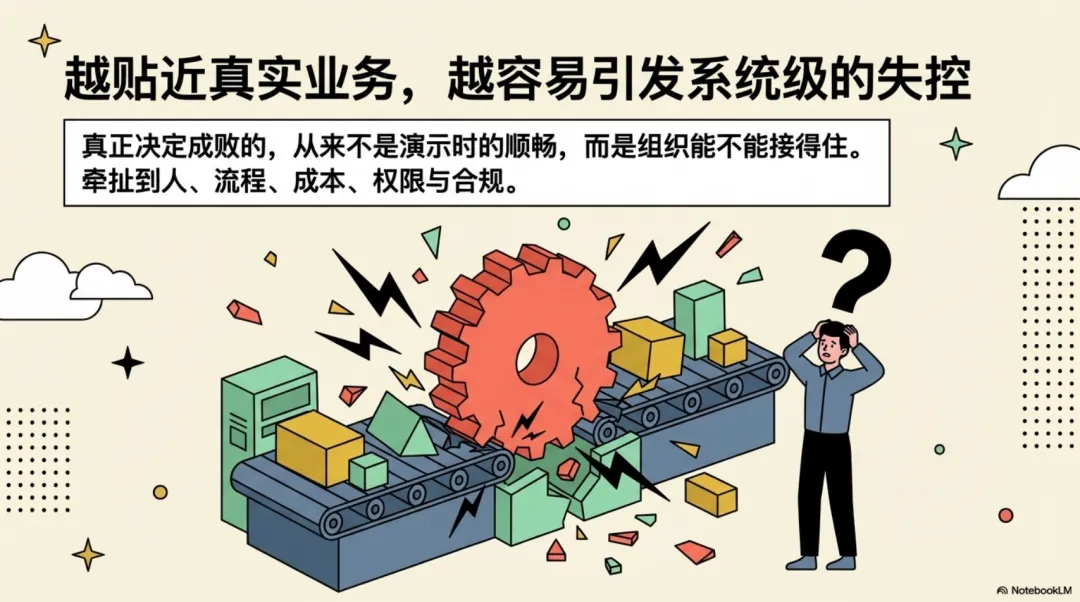

越是贴近真实业务场景,就越会牵扯到人、流程、成本、权限、合规治理等一系列问题。

这也是为什么很多团队试点后很快就发现:OpenClaw 不是不能用,而是不好养。

所以这件事,先别急着拍板落地。

真正决定成败的,从来不是它演示的时候有多顺畅,而是当它真正接入业务流程后,你的组织能不能接得住、兜得住。

龙虾在企业不好用,原因可能有三个

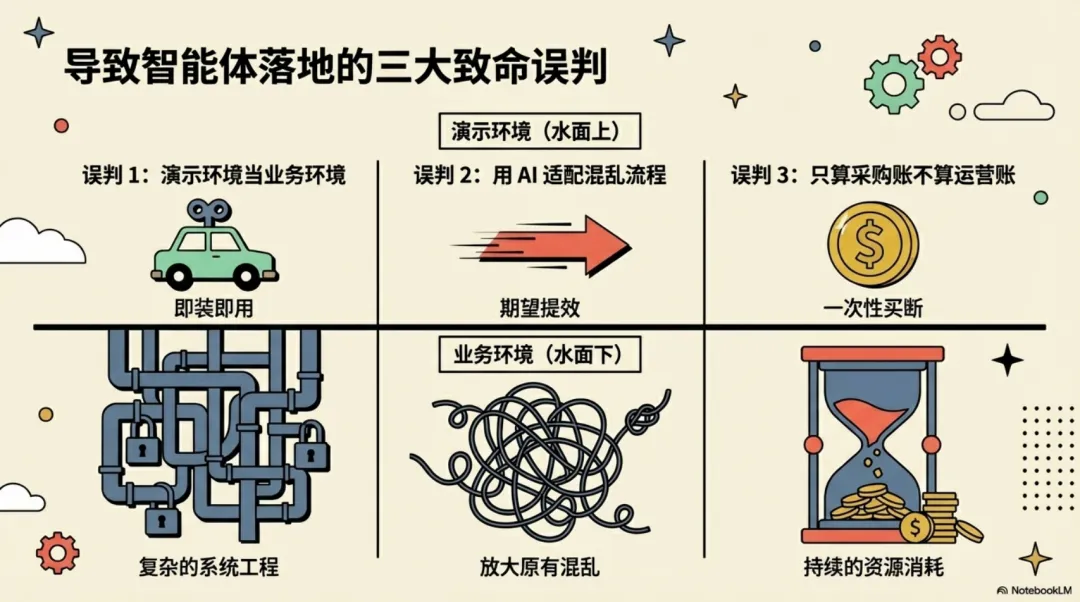

很多企业对智能体落地的 3 件核心事,想得太简单了。

第一个最普遍的误判,就是把 OpenClaw 当成了即装即用的标准化软件,觉得买回来就能直接接手完整的业务流程。

我们见过太多类似的情况:演示环境里一路顺畅,可真要接入真实业务,接口怎么调、权限怎么给、异常情况谁处理、输出结果谁复核,一堆问题会同时爆发。

问题从来不在工具能力不足,而在于企业把「演示可跑」,直接等同于「业务环境下可稳定运行」。

第二个核心误判,是总想着让 AI 去适配企业现有的混乱流程,而不是先把流程本身梳理清晰。

很多企业的流程规则全靠口头传递,例外情况全靠老员工的经验兜底,权限边界本来就模糊不清。

这时候让 OpenClaw 进去,根本不是提效,而是在放大原本就存在的混乱。

说白了,AI 最怕接手的,从来不是复杂流程,而是没人能说清规则的流程。

还有一个最容易被忽略、也最致命的问题:很多企业只算了一次性的采购账,却没算长期的运营账。

只要 OpenClaw 真的开始跑业务,模型调用会产生 Token 消耗,外部系统对接会产生 API 成本,后台运行要占用服务器算力,同时还会持续消耗团队的调试与维护时间。

这些成本不是一次性支出,而是只要流程在跑,就会持续产生。

走到这一步你就会发现,企业买的从来不是一个 “能演示的功能”,而是一套需要持续运营的执行能力。

所以接下来,别再急着问 OpenClaw 还有多少新能力,先问自己:企业到底该补上哪几道防护栏,才能接住这个工具?

五道护栏:龙虾进流程前,先把边界补齐

绝大多数落地踩坑,本质都不是工具出了问题,而是事前没搭好对应的防护边界。

企业不该先问 OpenClaw 能做多少事,而要先明确:哪些边界没补齐之前,它绝对不该被放进核心业务流程里。

这套框架,我们把它叫做「落地五道护栏」。

每一道都不复杂,但少了任何一道,试点的成本与风险都会成倍放大。

1.权限护栏:先说清 OpenClaw 能碰到哪一步

OpenClaw 一旦连上邮箱、浏览器或者其他业务工具,权限放大的速度,往往比团队预想得快得多。

更稳妥的做法,是严格遵循最小必要权限原则:先给读权限,验证无误后再考虑写权限;先开放低风险操作,再逐步开放高风险动作。

凡是涉及发邮件、改核心数据、触发外部付款这类敏感操作,必须 100% 保留人工确认环节。核心标准只有一个:它能看到什么、能修改什么、能执行到哪一步,必须提前白纸黑字写清楚。

2.数据护栏:先分清哪些数据能进,哪些不能进

没有数据护栏,OpenClaw 的试点跑得越深,后续在合规与责任界定上的坑就越大。

先做数据分级,明确哪类数据能进模型、哪类数据绝对不能进、哪类数据必须先做脱敏处理,再根据分级结果,决定部署方式、模型调用方式和日志留存规则。

提前解决好数据合规、操作留痕、风险追溯的核心问题,避免后续补合规付出更高代价。

3.成本护栏:别只看 OpenClaw 会不会做,要看跑起来花不花得起

没有成本护栏,最常见的结果就是:演示很惊艳,试点很热闹,跑了一阵之后没人敢继续推进。

所以每个 OpenClaw 试点,都要单独设置专属预算、消耗阈值、告警线和紧急停机条件。

投入产出比的判断不能凭感觉,必须拆解到具体场景里核算,剔除掉那些 “看起来很美”,实则不适合首批落地的非刚需场景。

4.异常护栏:不能只设计正常流程,还要设计出错以后怎么办

OpenClaw 在预设的正常路径里跑得再顺,也不代表进了业务就稳了,因为真实的业务流程里,一定会有例外、遗漏、冲突和中断。

必须提前把报错路径、回退动作、人工接管条件和复盘责任人,全部写进流程里。

AI 能不能进核心流程,从来不看它顺的时候有多快,而是看它出错的时候,你的团队能不能稳稳接住。

5.责任护栏:OpenClaw 可以执行,但责任不能悬空

必须明确界定:OpenClaw 负责执行,人工负责复核,业务负责人对最终结果负责。不能因为用了 AI,就把原本清晰的责任边界弄模糊。

人机闭环的核心,从来不是让机器替人背锅,而是让机器做擅长的执行工作,让人把该担的责任担清楚。

五道护栏补不齐,OpenClaw 的能力再强,也只是把企业原本藏在流程里的问题,提前暴露出来而已。

如何迈出第一步

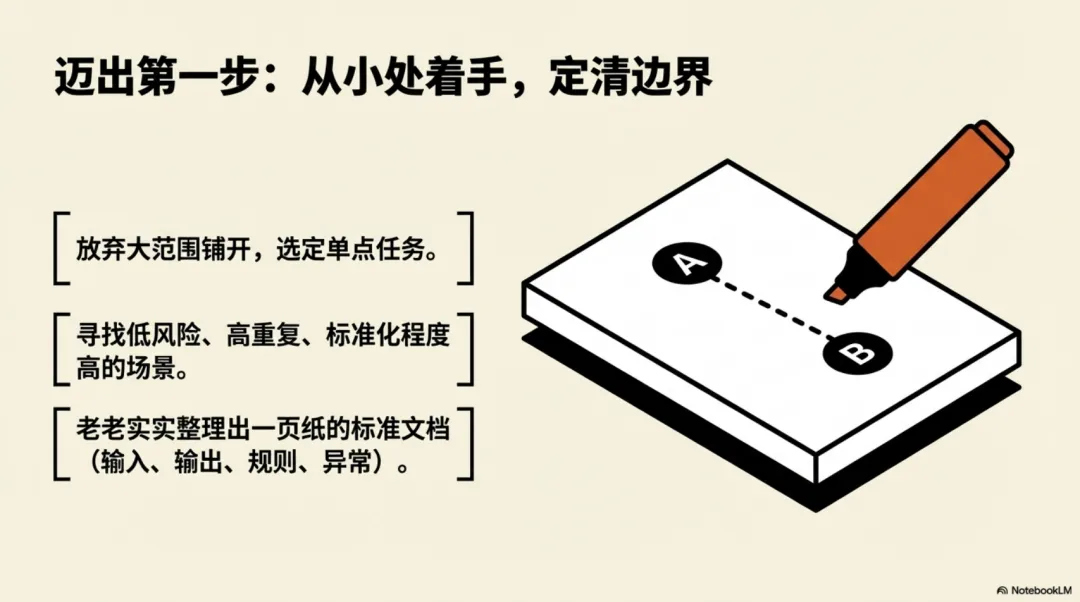

看懂了五道护栏的逻辑,很多决策者最关心的就是:下一步到底该从哪下手?比起一上来就铺多个场景,先把第一步做对,反而能走得更稳。

我们给绝大多数企业的第一个建议,就是先只选一个低风险、高重复、标准化程度高的单点任务,不求覆盖范围大,只求边界绝对清晰。

然后把这项任务的输入标准、输出要求、执行规则、异常场景、人工接管节点,老老实实整理成一页纸的标准文档。

别小看这一步,绝大多数试点跑不下去,根本不是 OpenClaw 不行,而是从一开始,任务的边界就没讲明白。

如果你真想把这件事扎扎实实往前推进,比起反复听概念、看演示,最有用的动作,就是先把落地自查表拉出来。

内部先准备好三张表就够了:《智能体试点前五道护栏检查表》《单点任务接入验收标准表》《人机闭环责任分工表》,帮你做好全流程的自查与风险管控。

工具永远可以后选,但边界一定要先定。

这套表格我给你准备好了,扫码回复“护栏检查”,我发你。

夜雨聆风

夜雨聆风