技术深度OpenClaw:Skills 崛起与 Agent-OS 的终极形态

让AI从"工具"变成"执行者",从"辅助"变成"主导"——Skills正在重新定义人机关系

一、从一个生活场景开始

想象你雇了一个超级聪明的私人助理。

这个助理有多聪明?它能帮你写邮件、订机票、清理电脑、回复微信、管理日程。你只需要说一声"帮我把上周的会议纪要整理成文档,发给老王",它就能自动完成这一切。

听起来很美好对吧?但问题来了——这个助理虽然聪明,却像个"瞎子"。它能理解你的指令,却看不到你的电脑里有什么文件、你的邮件箱里有什么邮件、你的日历上有哪些安排。

于是你不得不一遍遍告诉它:"去看一下桌面上的文件夹"、"查一下邮件里有没有客户的回复"、"打开日历看看下周三有没有空"。它每做一个操作,都要你先告诉它在哪里、怎么操作。

核心洞察 这就是 2024 年之前的 AI 状态:很聪明,但很"瞎"。

二、MCP:给 AI 装上"眼睛"

什么是 MCP?

为了让 AI 不再是"瞎子",Anthropic 在 2024 年底推出了 MCP(Model Context Protocol)。

你可以把 MCP 理解成给 AI 和外部工具之间修了一条"高速公路"。

以前 AI 想查你的邮件,需要你手动复制粘贴给 AI;现在有了 MCP,AI 可以直接"看到"你的邮件、你的文件、你的日历,就像你把 USB 鼠标插进电脑一样,插上就能用。

MCP 为什么会失败?

问题出在一个很细节但很致命的地方——上下文成本。

⚠️ 关键问题 AI 不是无限聪明的,它的"脑子"有限。每次对话,它只能处理固定长度的文字,超过这个长度就会被"遗忘"。

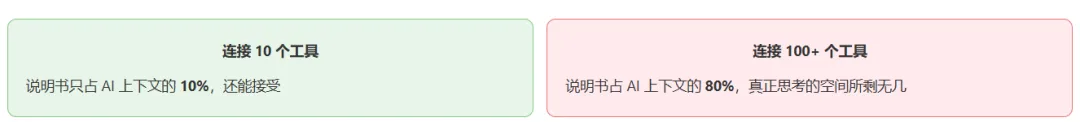

当你给 AI 连接更多工具时,每个工具都需要把自己的"说明书"告诉 AI,这个说明书就是上下文的一部分。

💡 核心问题MCP 解决了"连接"的问题,但没有解决"能力组织"的问题。 当工具数量指数级增长时,AI 会被自己的"工具说明书"淹没。

三、Skills:让 AI 学"技能"而非背"说明书"

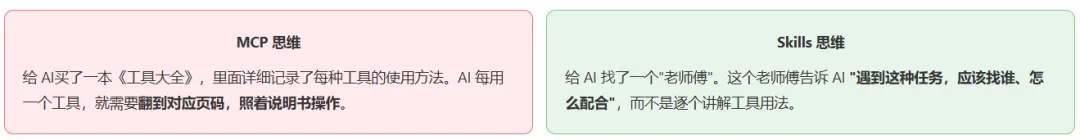

一个生活化的比喻

Skills 的三层结构

| 第一层 | ||

| 第二层 | ||

| 第三层 |

📋 场景对比:组织一场会议

用 MCP 的方式:你需要告诉 AI 邮件系统在哪、日历怎么用、会议室预约系统怎么登录、视频会议软件怎么调用、会议纪要模板在哪……每个系统都要单独教。

用 Skills 的方式:你只需要说"帮我组织会议",AI 自动理解需要查日程、预约会议室、发邀请、整理纪要,并调用对应的 Skill。

四、OpenClaw:为什么被称为 Agent-OS?

把 OpenClaw 叫做"Agent-OS"(智能体操作系统),这不是夸张。

| 资源调度 | ||

| 记忆管理 | ||

| 权限控制 | ||

| 设备抽象 |

⚠️ 安全警示AI Agent 的"攻击面"远超传统软件。 你给 AI 的权限越大,它可能出错的空间也越大。这就像操作系统——如果你给一个程序管理员权限,一旦它被攻击,后果是灾难性的。

五、Skills 为什么是 Agent-OS 的"系统调用"?

在传统 OS 里,应用程序不直接操作硬件,而是通过"系统调用"向 OS 申请资源。

应用程序想读写文件,它不会自己去找磁盘在哪里,而是调用 read()、write() 函数。操作系统会处理具体的磁盘操作,把结果返回给应用程序。

本质区别MCP 是 API 的包装,Skills 是能力的组织。

一个"安排会议"的 Skill,底层可能调用了邮件系统、日历系统、会议软件、文件系统,但它对 AI 暴露的接口是"帮你组织一场会议"。

AI 不需要知道这些系统各自的 API 怎么用,它只需要说"帮我组织会议",Skills 会协调一切。

六、深远意义:人类角色的根本转变

Skills 的经济价值

一个资深的行政人员,她的价值不在于她自己能多快地发会议通知、整会议纪要,而在于她知道"好的会议通知应该包含什么"、"会议纪要应该怎么结构化"。

这些经验以前只能她自己用,现在可以"教"给 AI,变成可复制的 Skills。

💡 新范式 一种全新的"知识经济"形态诞生:不是卖软件、不是卖服务,而是卖"教会 AI 做事的方法"。

一个销售冠军的经验 → Skill 一个资深 HR 的判断力 → Skill 一个优秀工程师的代码习惯 → Skill

当 Skills 足够丰富,人类社会的各种"经验"都能被 AI 学会并执行时,创造 Skills 的能力将比使用 Skills 的能力更值钱。

更尖锐的问题

但问题不止于此。

🔄 角色转变

传统工作流程中:人类是执行者。销售要自己打电话、写方案、跟进客户;HR 要自己筛简历、面试、评估。AI 只能辅助,无法替代。

Skills 驱动的 Agent-OS 范式中:AI 是流程的执行主体。人类设定目标,AI 规划路径、调用 Skills、完成任务。

人类从"执行者"变成了"监督者"。

⚠️ 边缘化风险 监督者的存在前提是执行者可能犯错。如果 AI 执行的任务永远正确、Skills 的输出永远高质量,监督还有必要吗?

当 AI 能够自主完成从目标设定到执行验收的全流程时,人类能做的只有两件事:给 AI 一个目标,等着它完成。

但给目标这个动作本身,也可能被 Skills 替代——因为 AI 可以根据你过往的目标设定习惯,自动推断你"可能想要什么"。

黄仁勋的判断

"OpenClaw 是我们这个时代最重要的软件发布",以及"OpenClaw 之于 AI 的意义,堪比 Windows 之于个人计算的变革"。 —— 黄仁勋,2026 年初

Skills 驱动的 Agent-OS 范式,代表了一种全新的人机关系:

人类不再是工具的使用者,而是 AI 能力的组织者和监督者。

当这种范式彻底成熟时,人类社会的工作方式将被彻底重塑。

而我们现在正处于这个转变的起点。

END

原创不易,如果这篇文章对你有帮助,欢迎转发、点赞、在看

你如何看待 Skills 和 Agent-OS 的未来?欢迎在评论区分享你的观点

相关阅读:

夜雨聆风

夜雨聆风