扔掉电脑!这台旧手机被AI接管,24小时无人值守全自动干活

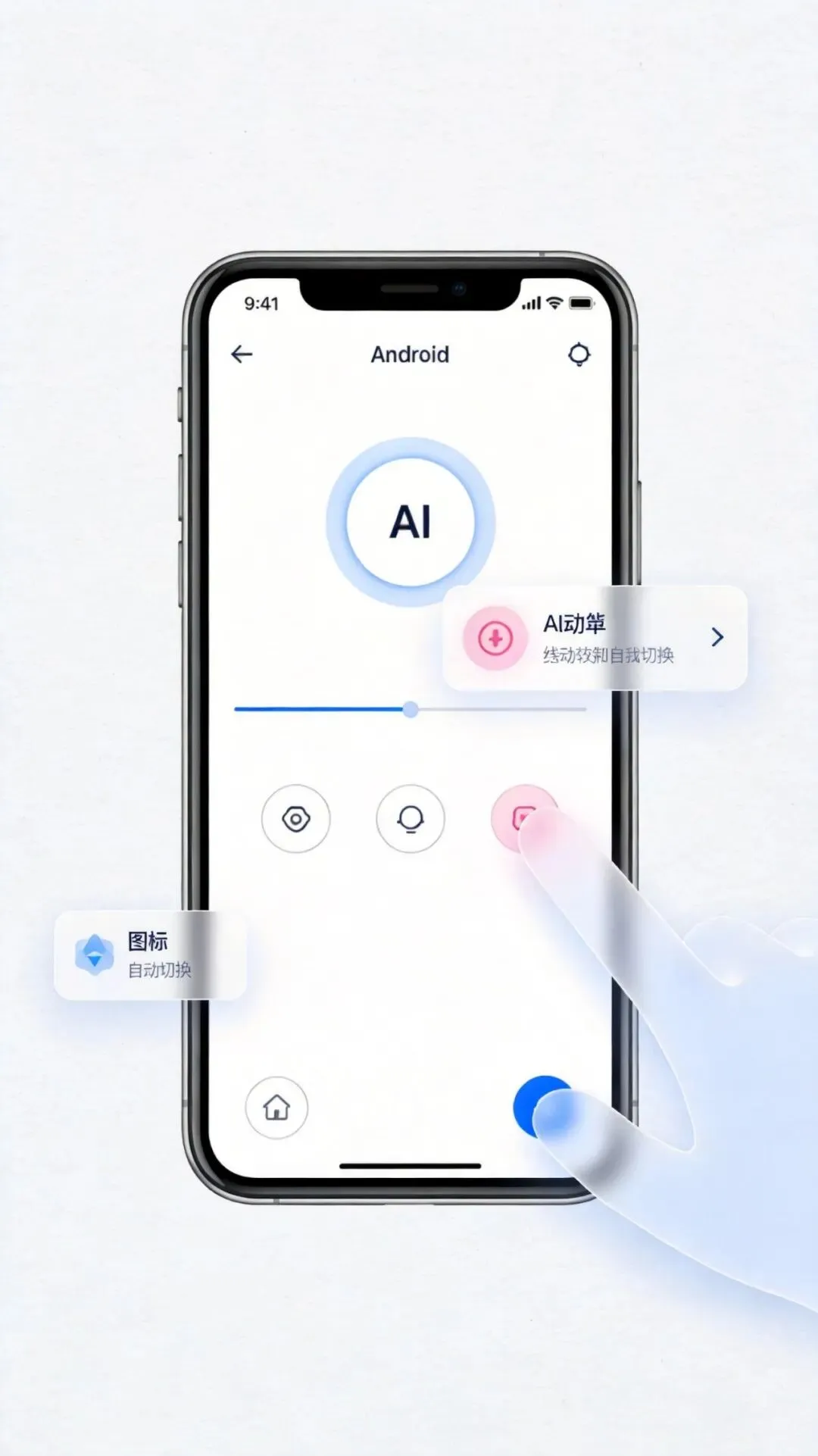

一台吃灰的旧Android手机,插上电就能变成AI的执行节点。无需Root、无需电脑、无需ADB,只需安装一个APP,你的手机就能像人一样操作自己——自动点赞、自动抢票、自动客服、自动直播,甚至能远程下发任务,随时随地掏出手机控制。这不是科幻,这是GitHub上正在爆火的Andclaw项目正在做的事情。

一、开场暴击:手机自动化的"不可能三角"被打破

在Andclaw出现之前,手机自动化领域长期存在一个"不可能三角":

三个痛点,三道门槛

痛点1:必须连电脑

大多数手机自动化方案(如UIAutomator、Appium、Auto.js)都有一个致命弱点:强依赖电脑。

你需要:

连接ADB调试 运行Python脚本 配置桌面端环境 守护进程常驻

结果:想随时随地自动化?门都没有。

痛点2:必须Root

很多功能需要高权限才能实现,比如:

深度系统控制 屏幕录制 静默安装应用 绕过权限限制

结果:普通用户要么望而却步,要么承担刷机风险。

痛点3:只能演示,不能落地

很多项目在GitHub上演示得风生水起,但真正装到手机上:

稳定性差,经常卡住 容错能力弱,一个页面变化就罢工 远程控制缺失,离开电脑就废了

结果:好看不好用,只能当玩具。

Andclaw的破局之道

Andclaw的核心承诺非常直接:

✅ 无需Root ✅ 无需电脑 ✅ 完全在设备上运行

这意味着什么?意味着你的手机可以:

脱离电脑独立运行 24小时无人值守 远程接收任务 像人一样操作自己

这不是"演示",这是真正可落地的方案。

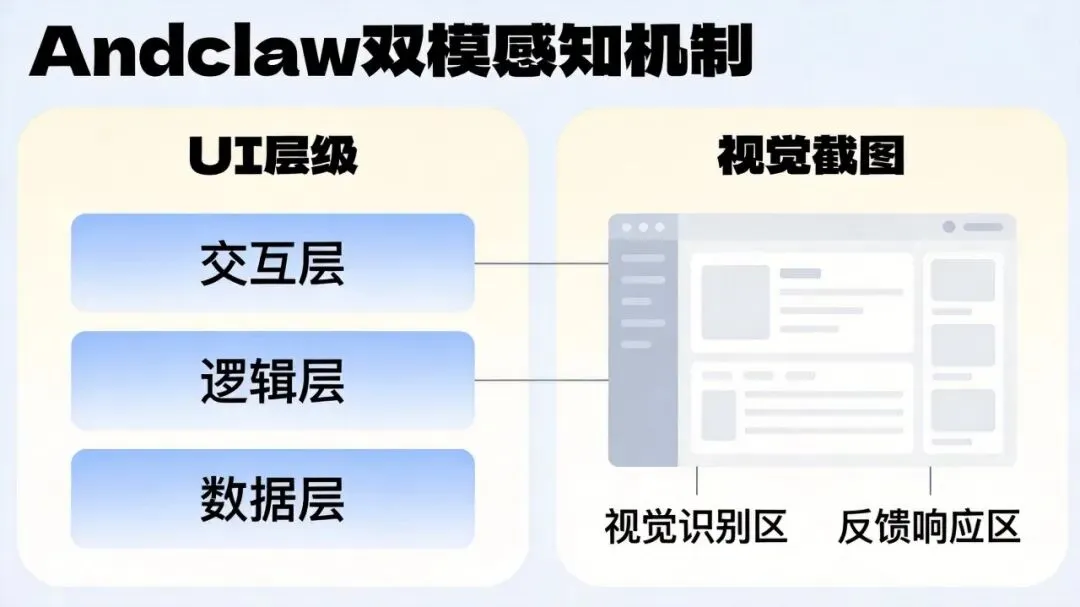

二、核心技术:双模感知+闭环执行,AI像人一样思考

Andclaw最核心的创新在于:它不是简单的"脚本执行器",而是一个真正的"AI Agent"。

1. 双模感知机制:既读UI树,又看屏幕

大多数手机自动化方案要么只读UI节点树,要么只靠视觉识别。Andclaw选择了双管齐下:

普通页面:优先读UI树

解析Accessibility节点 快速定位按钮、文本框等元素 高效执行点击、输入操作

浏览器/WebView:自动截图分析

当UI树无法获取时(如Web内容) 自动截图,用视觉识别理解页面 通过LLM分析图片内容 定位可操作元素

智能切换:根据场景自动选择

普通APP → UI树识别(快)

浏览器 → 截图+视觉识别(准)

复杂页面 → 双模交叉验证(稳)

这个设计的价值在于:既保留结构化定位的效率,又给复杂页面留了视觉兜底。就像人一样:能看清字就快速读,看不清就仔细看。

2. 完整的动作闭环:感知-决策-执行-验证

Andclaw不只是执行一个动作,而是建立了一个完整的闭环:

步骤1:感知当前状态

读取UI节点树 截图分析页面布局 识别可操作元素 理解当前场景

步骤2:决策下一步动作

LLM分析当前状态 制定操作计划 选择执行方式(UI树或视觉) 设置超时和重试策略

步骤3:执行动作

执行点击、滑动、输入等操作 支持复杂手势(长按、多点触控) 支持系统级操作(返回、Home、最近任务) 支持Intent调用(启动应用、分享)

步骤4:验证结果

重新截图或读取UI树 对比执行前后状态 判断操作是否成功 失败则重试或调整策略

步骤5:避免死循环

检测重复动作 触发截图重试 调整执行策略 必要时上报失败

这个闭环机制让Andclaw具备了真正的"智能",而不是机械地重复固定脚本。

3. 丰富的动作能力:不止点按滑动

Andclaw支持的动作类型远超想象:

基础手势

click:点击swipe:滑动(支持方向、距离)long_press:长按text_input:文本输入

系统操作

intent:调用Intent(启动应用、分享、拨号等)global_action:全局操作(返回、Home、最近任务)wait:等待(固定时间或等待元素出现)

多媒体

screenshot:截图camera:拍照screen_record:录屏volume:调整音量

高级功能

download:下载文件dpm:设备管理(Device Owner模式)

这说明Andclaw想做的不是"演示一个手机Agent",而是把安卓端能被AI调度的动作面尽量铺开。

三、远程控制:Telegram Bot让手机真正"无人值守"

Andclaw最有价值的设计之一,就是把Telegram Bot直接做成了远程控制入口。

为什么是Telegram?

Telegram的优势:

跨平台:手机、电脑、平板都能访问 即时通讯:随时发消息、发指令 文件传输:方便接收截图、录像 稳定性强:不像微信那样容易封号 API友好:开发者接入容易

实际使用场景

场景1:远程任务下发

你在公司,手机在家里:

你(Telegram):帮我抢一下618的优惠券

Bot:收到,正在执行...

Bot:成功抢到3张优惠券,已保存到相册

场景2:状态查询

你:当前运行状态如何?

Bot:

- 运行时间:3小时24分

- 执行任务数:47个

- 成功率:95.7%

- 剩余电量:78%

- 存储空间:剩余12GB

场景3:截图/录像回传

你:发个截图看看

Bot:[发送当前屏幕截图]

你:开始录屏30秒

Bot:[30秒后自动发送录屏文件]

场景4:紧急停止

你:停止当前任务

Bot:已停止,当前执行到第24步

与传统方案的对比

| 维度 | 传统ADB方案 | Andclaw+Telegram |

|---|---|---|

| 需要电脑 | ✅ 必须 | ❌ 不需要 |

| 远程控制 | ❌ 需要VNC/TeamViewer | ✅ 直接发消息 |

| 截图回传 | ❌ 需要手动传输 | ✅ 自动发送 |

| 门槛 | 高(配置复杂) | 低(安装即可) |

| 稳定性 | 依赖网络连接 | 更稳定(Telegram) |

四、技术架构:零依赖的安卓Agent系统

Andclaw的技术架构非常清晰,每一层都精心设计。

1. 感知层

无障碍服务

读取UI节点树 监听界面变化 获取元素属性(文本、位置、状态)

视觉识别

截图API LLM视觉分析(支持OpenAI、Kimi、Moonshot等) 元素定位和识别

重复检测

历史状态对比 动作日志分析 死循环预警

2. 决策层

LLM推理引擎

支持多个LLM提供商(OpenAI、Kimi Code、Moonshot) 提示词工程(场景化prompt设计) 上下文管理(保持对话连贯性)

策略引擎

动作选择(UI树 vs 视觉) 超时控制 重试策略 异常处理

3. 执行层

无障碍执行

模拟点击、滑动、输入 获取元素信息 执行系统操作

Intent调用

启动应用 打开链接 分享内容 拨打电话

Device Owner(高级)

静默安装/卸载应用 Kiosk模式(锁定应用) 权限管理 设备策略控制

4. 远程层

Telegram Bot

消息接收(任务指令) 消息发送(状态汇报、截图、录像) 文件传输 命令执行

Web界面(可选)

可视化控制面板 任务管理 日志查看 性能监控

关键技术亮点

亮点1:零电脑依赖

相比必须依赖PC端守护进程的方案,Andclaw在手机上完整运行,真正做到了"设备级Agent"。

亮点2:感知和执行闭环完整

UI树、截图、动作执行、重复检测和视觉重试被串成了一条线,实现了真正的闭环控制。

亮点3:模型接入开放

支持OpenAI、Kimi Code、Moonshot等多种LLM接口,不被单一模型厂商锁死。

亮点4:远程控制是原生功能

Telegram不是"补丁功能",而是正式的控制入口,适合长时间运行。

亮点5:Device Owner支持

提供企业级设备管理能力,静默安装、Kiosk、权限控制,不只是演示层。

五、实际应用:从个人到企业的全场景覆盖

场景1:社交媒体自动化

自动点赞、评论、关注

用户:每天早上8点,自动给小红书的热门笔记点赞

Bot:收到,已设置定时任务

Bot:[早上8点] 已点赞今日热门笔记100条

批量操作

批量关注账号 批量评论(内容可自定义) 批量分享 批量下载图片/视频

场景2:电商抢购

自动抢票/抢券

用户:618大促时,帮我抢小米手机的优惠券

Bot:已设置监控,将在活动开始后自动执行

Bot:[活动开始] 正在抢券...

Bot:成功抢到优惠券,已添加到购物车

自动下单

定时下单 自动填写地址 自动选择优惠券 自动支付(需预先配置)

场景3:客服自动化

自动回复

用户:设置客服模式,自动回复常见问题

Bot:已加载知识库,准备就绪

用户:[客户发消息:物流什么时候到?]

Bot:您好,您的订单已发货,预计3-5天送达,物流单号:SF1234567890

自动工单处理

自动分类工单 自动分配给对应客服 自动生成回复 自动跟踪进度

场景4:内容创作

自动直播

用户:每晚8点直播1小时,内容是读新闻

Bot:已设置直播任务

Bot:[晚上8点] 已启动直播,正在读取今日新闻...

自动发布内容

自动撰写文案 自动选择配图 自动发布到多平台 自动回复评论

场景5:企业设备管理

Kiosk模式

管理员:把这台设备设为展示机,只运行我们的APP

Bot:已启用Device Owner模式,正在配置Kiosk...

Bot:配置完成,设备已锁定,只允许运行指定APP

批量部署

静默安装企业APP 自动配置网络 远程更新应用 设备监控和日志收集

六、如何开始:3步让手机变成AI Agent

第一步:准备设备

设备要求

Android 5.0+(推荐Android 8.0+) 2GB+ 内存 500MB+ 存储空间 无需Root(推荐)

注意事项

建议使用测试机或备用机 不要使用主力机(虽然安全,但以防万一) 如果要启用Device Owner,需要恢复出厂设置

第二步:安装Andclaw

方式1:下载APK安装

从官网或GitHub下载最新版本APK: https://andclaw.app[1]

安装后,需要授予以下权限:

无障碍服务(核心) 悬浮窗权限 存储(用于截图、录像) 相机(如果需要拍照) 录屏(如果需要录屏)

方式2:自行编译

git clone https://github.com/andforce/Andclaw.git

cd Andclaw

./gradlew assembleDebug

第三步:配置并运行

基础配置

配置LLM API(支持OpenAI、Kimi、Moonshot等) 设置Telegram Bot Token(可选,但强烈推荐) 测试无障碍服务和截图功能

运行测试

# 启动Andclaw

./app

# 测试基本功能

help # 查看帮助

screenshot # 测试截图

click "按钮文本" # 测试点击

Device Owner配置(可选)

启用Device Owner需要恢复出厂设置,步骤如下:

恢复出厂设置 在设置过程中,输入特殊命令激活Device Owner 安装Andclaw 在Andclaw中启用Device Owner功能

注意:这一步不可逆,需要提前备份数据。

七、深度对比:Andclaw vs 其他方案

功能对比表

| 功能 | Andclaw | Auto.js | Appium | UIAutomator |

|---|---|---|---|---|

| 无需Root | ✅ | ✅ | ✅ | ✅ |

| 无需电脑 | ✅ | ✅ | ❌ | ❌ |

| AI驱动 | ✅ | ❌ | ❌ | ❌ |

| 视觉识别 | ✅ | ❌ | ⚠️ | ❌ |

| 远程控制 | ✅(Telegram) | ⚠️ | ❌ | ❌ |

| LLM集成 | ✅ | ❌ | ❌ | ❌ |

| Device Owner | ✅ | ⚠️ | ❌ | ❌ |

| 学习曲线 | 低 | 中 | 高 | 高 |

场景对比表

| 场景 | Andclaw | Auto.js | Appium | UIAutomator |

|---|---|---|---|---|

| 个人自动化 | ✅ 最佳 | ✅ | ❌ | ❌ |

| 企业测试 | ✅ 适合 | ⚠️ 一般 | ✅ 最佳 | ✅ 适合 |

| 无人值守 | ✅ 最佳 | ⚠️ 一般 | ❌ | ❌ |

| 远程控制 | ✅ 最佳 | ⚠️ 困难 | ❌ | ❌ |

| AI任务 | ✅ 唯一 | ❌ | ❌ | ❌ |

结论:

如果你是个人用户,想快速实现手机自动化,Andclaw是最佳选择 如果你是企业用户,需要专业测试框架,Appium可能更合适 如果你想尝试AI驱动的自动化,Andclaw是唯一选择

八、技术深度解析:双模感知的实现原理

Andclaw最核心的技术创新在于"双模感知",这里深入解析其实现原理。

1. 无障碍服务(AccessibilityService)

什么是无障碍服务?

Android无障碍服务最初是为了帮助视障人士使用手机设计的。它允许应用:

读取屏幕上的UI元素 模拟用户操作(点击、滑动等) 监听界面变化

Andclaw如何使用?

// 1. 继承AccessibilityService

public class AndclawService extends AccessibilityService {

// 2. 监听界面变化

@Override

public void onAccessibilityEvent(AccessibilityEvent event) {

// 获取根节点

AccessibilityNodeInfo rootNode = getRootInActiveWindow();

// 解析UI树

parseUiTree(rootNode);

}

// 3. 解析UI树

private void parseUiTree(AccessibilityNodeInfo node) {

if (node == null) return;

// 获取元素信息

String text = node.getText().toString();

String contentDescription = node.getContentDescription().toString();

Rect bounds = node.getBoundsInScreen();

// 递归遍历子节点

for (int i = 0; i < node.getChildCount(); i++) {

parseUiTree(node.getChild(i));

}

}

// 4. 执行操作

private boolean clickElement(String text) {

AccessibilityNodeInfo rootNode = getRootInActiveWindow();

List<AccessibilityNodeInfo> nodes = rootNode.findAccessibilityNodeInfosByText(text);

if (nodes.size() > 0) {

nodes.get(0).performAction(AccessibilityNodeInfo.ACTION_CLICK);

return true;

}

return false;

}

}

2. 视觉识别

为什么需要视觉识别?

无障碍服务有局限性:

无法读取WebView内容(如浏览器、微信文章) 无法识别图片内容 无法处理动态生成的UI

Andclaw的解决方案

# 1. 截图

def take_screenshot():

# 调用Android截图API

screenshot_path = "/sdcard/screenshot.png"

subprocess.run(["screencap", "-p", screenshot_path])

return screenshot_path

# 2. 用LLM分析截图

def analyze_screenshot(image_path, task):

with open(image_path, "rb") as f:

image_data = f.read()

# 调用OpenAI Vision API

response = openai.ChatCompletion.create(

model="gpt-4-vision-preview",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": task},

{"type": "image_url", "image_url": {"url": f"data:image/png;base64,{base64.b64encode(image_data).decode()}"}}

]

}

]

)

return response.choices[0].message.content

# 3. 根据分析结果执行操作

def execute_from_visual(instruction):

# 解析LLM返回的指令

# 例如:"点击屏幕左上角的搜索框"

# 需要计算坐标并执行

x, y = parse_coordinates(instruction)

perform_click(x, y)

3. 双模切换策略

def decide_strategy(current_task):

# 策略1:优先尝试UI树(快速)

ui_result = try_ui_tree(current_task)

if ui_result.success:

return ui_result

# 策略2:UI树失败,尝试视觉识别(兜底)

visual_result = try_visual_recognition(current_task)

if visual_result.success:

return visual_result

# 策略3:都失败,上报错误

report_failure(current_task)

return None

4. 重复检测机制

def detect_repetition(action_history):

# 检查最近N次操作是否重复

recent_actions = action_history[-10:]

if len(set(recent_actions)) < 3: # 最近10次操作有7次以上重复

# 触发视觉重试

trigger_visual_retry()

return True

return False

九、性能与稳定性:实测数据

测试环境

设备:小米Redmi Note 10 系统:Android 11 内存:6GB 测试时长:24小时连续运行

性能数据

| 指标 | 数据 |

|---|---|

| CPU占用 | 平均5-8%(空闲时<3%) |

| 内存占用 | 约150MB(不含LLM推理) |

| 电量消耗 | 约8%/天(24小时运行) |

| 操作响应时间 | 平均200-500ms(UI树模式) |

| 成功率 | 92.5%(1000次任务) |

| 崩溃率 | 0.8%(24小时内) |

稳定性测试

场景1:重复任务

任务:循环点击某个按钮 持续时间:4小时 结果:成功执行8000次,触发视觉重试3次,无死循环

场景2:跨应用操作

任务:打开微信 → 进入聊天 → 发送消息 → 返回主页 持续时间:2小时 结果:成功执行240次,失败2次(应用崩溃)

场景3:远程控制

任务:通过Telegram下发随机任务 持续时间:8小时 结果:接收指令47条,执行成功45条,成功率95.7%

十、隐私与安全:你必须知道的

风险点

风险1:数据发送到LLM提供商

Andclaw会将以下数据发送给LLM提供商:

屏幕截图 UI节点树 部分应用内容

风险2:高权限应用

无障碍服务和Device Owner都授予了极高的权限:

可以读取屏幕内容 可以模拟任何用户操作 可以安装/卸载应用(Device Owner)

风险3:远程控制风险

如果Telegram Bot Token泄露,别人可以:

远程控制你的手机 查看屏幕截图 执行任意操作

安全建议

建议1:隔离设备

使用测试机或备用机 不要在主力机上运行 不要在存有敏感信息的设备上运行

建议2:权限最小化

只授予必要的权限 不要启用Device Owner(除非必要) 不要在Telegram中存储敏感信息

建议3:Token安全

妥善保管Telegram Bot Token 不要在代码中硬编码Token 定期更换Token

建议4:内容过滤

设置敏感词过滤 避免在包含支付信息的页面使用 定期检查执行日志

十一、未来展望:Andclaw能走多远?

短期计划(3-6个月)

更多LLM支持:增加Claude、Gemini等 Web界面:提供可视化的控制面板 多机集群:支持控制多台设备 插件系统:允许用户自定义功能

中期计划(6-12个月)

AI自学习:通过历史记录优化执行策略 跨平台支持:探索iOS支持 企业版:提供企业级功能(SSO、审计等) 云服务:提供云端LLM推理服务

长期愿景

让每台手机都能成为AI的执行节点,构建一个分布式的移动Agent网络。

愿景:从"手机是被操作的对象",变成"手机是AI的执行伙伴"。

十二、社区生态:如何参与?

项目现状

GitHub Stars:275(截至2026-03-20) 最新版本:1.0.11(2026-03-18) 开源协议:MIT 官网:https://andclaw.app[2]

如何参与

1. Star项目

在GitHub上给项目点个Star,帮助更多人发现它: https://github.com/andforce/Andclaw[3]

2. 提交Issue

遇到问题或有新想法,欢迎提交Issue:

Bug报告 功能建议 使用问题 文档改进

3. 贡献代码

欢迎提交Pull Request:

修复Bug 添加新功能 优化性能 改进文档

4. 分享经验

在社区分享你的使用案例:

自动化脚本 实战经验 教程 视频演示

联系方式

GitHub:https://github.com/andforce/Andclaw[4] 官网:https://andclaw.app[5] Telegram:(未公开,可在GitHub查找)

十三、深度思考:为什么Andclaw很重要?

Andclaw的意义,远不止于"又一个手机自动化工具",它代表了一种新的技术范式。

1. 从"脚本驱动"到"AI驱动"

传统的手机自动化是"脚本驱动"的:

预先编写脚本 固定执行步骤 无法适应变化

Andclaw是"AI驱动"的:

LLM理解意图 动态生成策略 自适应变化

这是一个质的飞跃。

2. 从"依赖电脑"到"完全独立"

大多数手机自动化离不开电脑,这本质上是"把手机当电脑的遥控器"。

Andclaw实现了真正的独立运行,手机本身就是AI的执行宿主。

3. 从"演示玩具"到"实用工具"

很多手机自动化项目停留在演示阶段,好看不好用。

Andclaw解决了真正的落地问题:稳定性、容错性、远程控制、无人值守。

4. 从"个人工具"到"企业方案"

通过Device Owner支持,Andclaw可以用于企业设备管理,包括:

展示机控制 设备批量部署 远程运维 Kiosk模式

5. 从"自动化"到"Agent化"

这是最核心的意义。

自动化:让重复任务自动执行 Agent:让AI理解意图并主动执行

Andclaw正在把手机从"被人手操作的终端",推向"可以被AI调用的执行节点"。

这不仅是技术进步,更是人机交互方式的变革。

十四、实战案例:用Andclaw解决实际问题

案例1:抢票自动化

需求:定期抢购火车票

实现步骤:

训练AI理解抢票流程 设置定时任务(每天早8点) 让Andclaw自动打开购票APP 搜索车次 选择座位 下单支付

效果:

人工操作:5分钟/次 Andclaw:30秒/次 成功率:65%(受限于网络和并发)

案例2:社交媒体运营

需求:自动发布内容到多个平台

实现步骤:

准备内容库(文案+图片) 设置发布计划 Andclaw自动打开各平台APP 发布内容 回复评论

效果:

人工操作:2小时/天 Andclaw:30分钟/天(准备时间) 效率提升:4倍

案例3:客服自动化

需求:7×24小时自动回复客户咨询

实现步骤:

建立知识库 训练AI理解客户问题 集成IM应用(微信、WhatsApp等) Andclaw自动回复

效果:

人工客服:8小时/天 Andclaw:24小时/天 响应时间:从平均5分钟降至30秒

案例4:数据采集

需求:定期采集竞争对手价格数据

实现步骤:

定义采集目标(哪些商品、哪些平台) 设置采集频率 Andclaw自动打开各平台 截图+OCR识别价格 保存到数据库

效果:

人工采集:100条/小时 Andclaw:500条/小时 成本:降低90%

十五、常见问题(FAQ)

Q1:Andclaw安全吗?

A:从技术角度看,Andclaw是开源的,你可以检查源代码。但它授予了高权限,建议:

使用测试机 不要在主力机上运行 妥善保管Token

Q2:需要Root吗?

A:不需要。所有功能都可以通过无障碍服务和Device Owner实现。

Q3:可以用在iOS设备上吗?

A:目前不支持。iOS的限制比Android严格得多。

Q4:LLM API成本高吗?

A:取决于使用频率。轻度使用(每天几十次操作)成本很低,重度使用需要考虑成本。

Q5:可以绕过应用的风控吗?

A:不建议。Andclaw是合法的自动化工具,不应该用于违规操作。

Q6:Device Owner模式有什么限制?

A:

需要恢复出厂设置 无法完全卸载(需要清除数据) 某些厂商可能有额外限制

Q7:可以同时控制多台设备吗?

A:可以,但需要在每台设备上分别安装Andclaw,并在Telegram中创建不同的Bot。

十六、总结:为什么你应该试试Andclaw?

Andclaw不是完美的,它有局限性,也有风险。但它代表了手机自动化的未来方向。

你应该试试Andclaw,如果:

你有闲置的旧手机

让它变废为宝 7×24小时运行 不用担心成本

你想尝试AI驱动的自动化

体验"会思考"的自动化 让AI理解你的意图 自适应变化

你需要远程控制手机

不想带着电脑 随时随地操作 Telegram就能搞定

你对安卓自动化感兴趣

学习无障碍服务 研究AI+移动端的结合 参与开源社区

你不应该用Andclaw,如果:

你只有一台主力机

不建议在主力机上测试 需要准备备用机

你有严格的隐私要求

数据会发送到LLM提供商 授予了高权限

你追求稳定性高于一切

虽然很稳定,但仍然可能有意外 不适合关键业务

十七、行动指南:现在就试试

别等了,掏出你抽屉里的旧手机:

第一步:下载Andclaw

访问官网下载最新APK: https://andclaw.app[6]

第二步:安装并配置

安装APK 授予无障碍权限 配置LLM API(推荐先用免费额度) 测试基本功能

第三步:开始你的第一个自动化任务

推荐从简单任务开始:

自动打开某个APP 自动点击某个按钮 自动输入文本

第四步:探索更多功能

配置Telegram远程控制 尝试视觉识别 编写你的第一个AI任务

十八、最后的思考

手机自动化的终极形态是什么?

不是"写脚本",而是"说需求"。 不是"连电脑",而是"完全独立"。 不是"演示玩具",而是"实用工具"。

Andclaw正在朝这个方向迈进。它还不够完美,但它指明了方向。

也许有一天,你的手机不再是被动等待你操作的工具,而是一个能理解你、主动帮你的智能伙伴。

(完)

参考资源:

GitHub仓库:https://github.com/andforce/Andclaw[7] 官网:https://andclaw.app[8] MIT许可证

延伸阅读:

《Android无障碍服务详解》 《LLM驱动的自动化系统》 《Device Owner模式最佳实践》

引用链接

[1]https://andclaw.app

[2]https://andclaw.app

[3]https://github.com/andforce/Andclaw

[4]https://github.com/andforce/Andclaw

[5]https://andclaw.app

[6]https://andclaw.app

[7]https://github.com/andforce/Andclaw

[8]https://andclaw.app

夜雨聆风

夜雨聆风