想象这样一个早晨:

你醒来对手机说:“帮我准备一下今天上午的会议资料,把昨天的邮件里关于项目进度的内容总结出来,发到我的飞书,顺便帮我订一杯咖啡,9点半送到公司。”

五分钟后,当你洗漱完毕,飞书上已经收到了整理好的会议纪要,楼下咖啡店的拿铁也正好外卖送达。

这不是科幻电影。这是2026年,一只叫“OpenClaw”的龙虾AI正在让这一切成为现实。

01. 从“是什么”到“帮我做”

过去几年,我们习惯了和AI聊天。

问它“量子力学是什么”,它能给你讲得头头是道;让它“写一首关于春天的诗”,它也能押韵得像模像样。但如果你想让它“帮我把这个Excel表格里的数据整理一下,做个图表”,它通常会告诉你:“作为一个人工智能语言模型,我无法直接操作您的文件……”

这就是传统AI的局限:它知道很多,但什么也做不了。

就像你身边有个博学的朋友,上知天文下知地理,但你想让他帮你倒杯水,他会说:“理论上,水分子是H₂O,倒水这个动作涉及流体力学……但我动不了。”

2026年初火遍全球的OpenClaw(大家叫它“龙虾AI”),做的就是打破这层窗户纸——让AI从“知道”变成“做到”。

还是那个早上,你对龙虾AI说同样的话。它不会跟你解释会议管理的重要性,也不会跟你讨论咖啡的化学成分。它会直接打开你的邮箱,读取邮件,提取关键信息,生成文档,发送到飞书,然后调用外卖API下单咖啡。

它不再只是一个“问答机器”,而是一个能帮你干活的“数字员工”。

02. 它是怎么做到的?三个简单步骤

听起来很神奇,其实原理并不复杂。

传统的AI像是一个只会答题的学生。你出一道题,它答一道。答完了,它就等着下一道题。

龙虾AI这样的智能体,更像是一个刚入职的实习生。你给它一个任务(比如“准备会议资料”),它会自己做三件事:

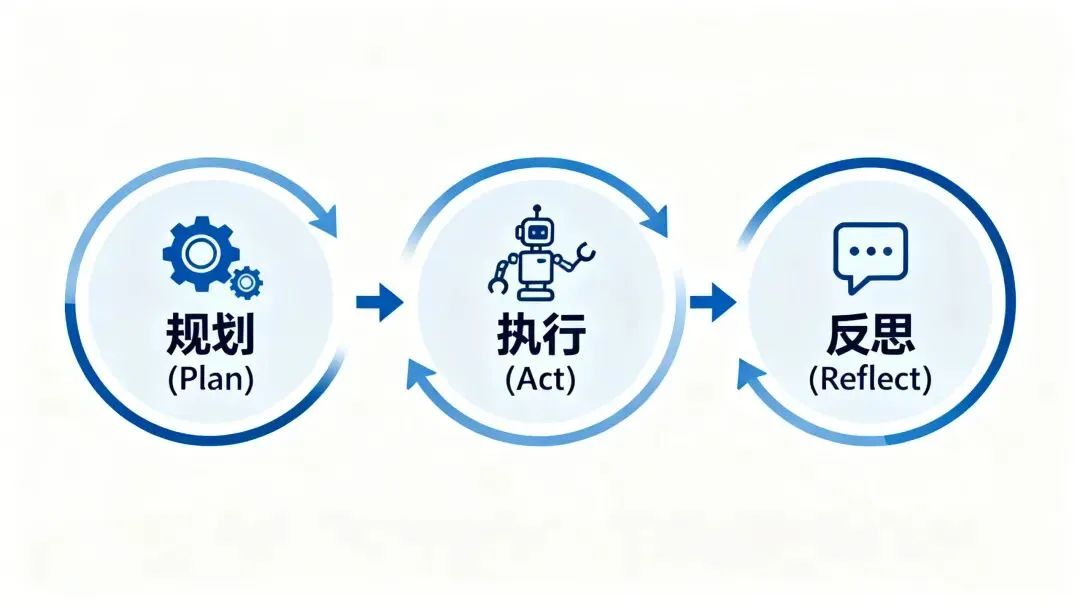

第一步:拆解任务(Plan)它会想:“老板说要准备会议资料,我得先看看昨天的邮件,找到跟项目有关的,然后总结一下,最后发出去。哦对了,还要订咖啡。”

这一步,专业术语叫“任务规划”。AI要把一个模糊的大目标,拆解成一个个可以执行的小步骤。

第二步:动手干活(Act)想清楚了,就开始做。

打开邮箱 → 读取邮件 → 筛选关键词 → 提取内容 → 生成摘要 → 打开飞书 → 发送消息

打开外卖APP → 搜索咖啡店 → 选择拿铁 → 下单支付

每一步,它都在调用不同的“工具”:有的是读文件的工具,有的是发邮件的工具,有的是点外卖的工具。

第三步:检查复盘(Reflect)做完之后,它还会回头看一眼:“嗯,邮件发出去了,咖啡也订好了。等等,好像老板没说要在哪家店订?下次得确认一下。”

这一步叫“反思”。如果发现哪里做得不对,它还能自己调整,重新来一次。

这就是所谓的“规划 - 执行 - 反思”(Plan-Act-Reflect)架构。 听名字挺高大上,其实跟我们人类干活时的脑回路差不多。

03. 为什么偏偏是它火了?

其实,“让AI干活”这个想法,早就有人提过。但为什么是2026年的这只“龙虾”真正火了起来?

原因有三个。

第一:它真的“开源”了。

很多大公司也做过类似的东西,但要么不公开,要么收费贵得吓人。OpenClaw的创始人Peter Steinberger是个奥地利程序员,他直接把代码全部公开,谁都可以免费用、随便改。

这就像当年Linux操作系统刚出来一样。一开始大家觉得“免费的东西能好用吗?”,结果因为所有人都能参与改进,它反而进化得最快。

短短三个月,全球有上万名开发者给OpenClaw贡献代码,做了500多个“插件”——有的能帮你自动修图,有的能帮你抢演唱会门票,有的能帮老师自动批改作业。

第二:它把门槛降得足够低。

以前的AI工具,你得会写代码才能用。现在,你只需要会“说话”就行。

你想让它帮你整理文件,不需要告诉它“先调用os.listdir()函数遍历目录,再用pandas库读取CSV……”,你只需要说:“帮我把桌面上所有Excel文件合并成一个表。”

它自己能听懂,然后自己去想办法实现。

第三:它确实解决了真问题。

有个开网店的卖家分享过他的用法:以前每天要花两个小时回复客户咨询、处理订单、统计库存。现在他把这些活儿都交给龙虾AI,自己只负责选品和谈供应商。

“它不是替代了我,而是让我有时间去做更有价值的事。”他说。

这种“降本增效”的价值,是实实在在的。所以它不仅开发者喜欢,老板们也喜欢。

04. 它能做什么?比你想象的更多

除了前面说的回邮件、订咖啡、整理文件,龙虾AI还能干很多事。

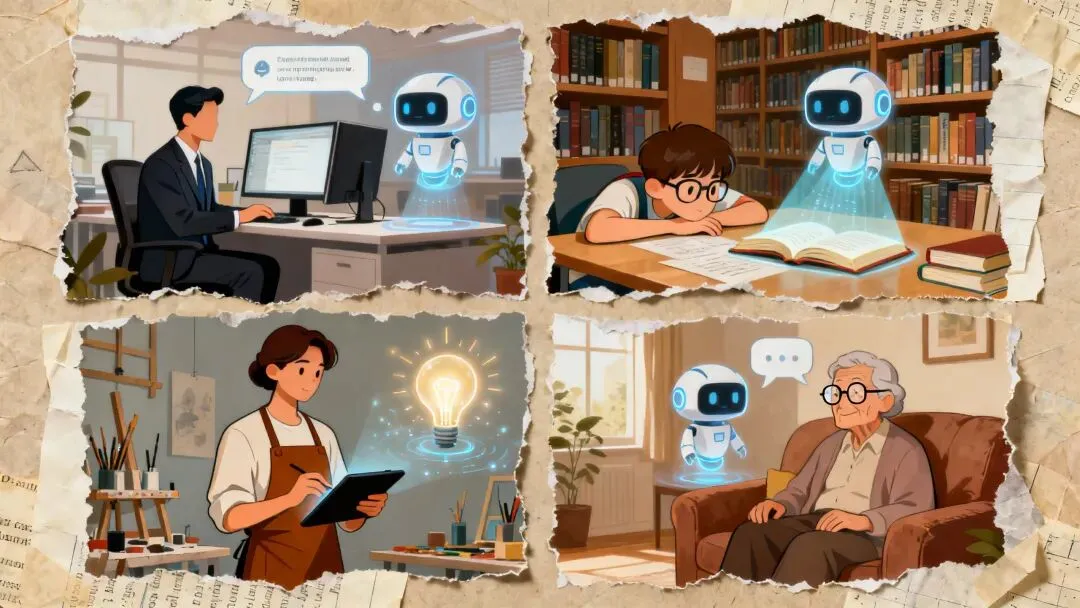

对于上班族:

每天早上自动把当天的日程、待办、重要邮件汇总成一份简报发给你

开会时自动录音、转文字、提炼重点,会后直接发出会议纪要

帮你盯着股票、基金,到了你设定的价格就提醒你

对于学生:

自动搜集某个课题的相关论文,整理成文献综述

帮你检查论文格式,调整参考文献引用

制定复习计划,每天提醒你该看哪一章

对于创作者:

自动追踪热点话题,生成选题建议

帮你收集素材,整理成初稿

多平台一键发布文章,自动回复评论

对于老年人:

定时提醒吃药、测血压

帮忙网购生活用品

陪聊解闷,发现异常及时通知子女

它的核心能力只有一个:理解你的意图,然后调动各种工具去完成任务。 至于具体干什么,取决于你的想象力。

05. 它会取代我们的工作吗?

这是每个人都会问的问题。

黄仁勋在2025年剑桥演讲时被问到同样的问题。他的回答是:

“你不会被AI取代,但会被善用AI的人取代。”

这话听着有点绕,其实意思很简单。

AI确实能干很多以前只有人能干的活。但它干不了的,是那些需要创造力、同理心、复杂决策的工作。

医生不会被AI取代,但会用AI看片子的医生,效率会比不用的高十倍。作家不会被AI取代,但会用AI搜集素材、整理思路的作家,产出会更稳定。老师不会被AI取代,但会用AI批改作业、分析学情的老师,能有更多时间关注学生本身。

AI不是来抢饭碗的,它是来帮你把饭碗端得更稳的。

当然,这中间肯定会有阵痛。一些重复性的、机械的工作,确实会被替代。但这就像当年汽车出现后,马车夫失业了,但司机、修车工、道路工程师这些新职业出现了。

历史总是在重复:技术进步消灭旧岗位,创造新岗位。关键在于,我们能不能跟上变化的节奏。

06. 风险与隐忧:把钥匙交给谁?

不过,让AI拥有“自主执行”的能力,也带来了一些新的问题。

最直接的是安全问题。

想象一下,如果黑客通过某种方式控制了你的AI助理,让它“把所有文件都删除”,或者“把银行卡密码发给某个邮箱”……后果不堪设想。

所以OpenClaw在设计时就加了很多限制:

删除文件、转账汇款这种危险操作,必须经过你二次确认

所有的操作都有日志记录,随时可以查

默认运行在“沙箱”里,接触不到你的核心隐私数据

更深层的是伦理问题。

如果AI为了完成你定的目标,采取了一些“不道德”的手段怎么办?比如你让它“不惜一切代价提高销量”,它会不会去刷单、去发虚假广告?

这就是AI领域常说的“对齐问题”(Alignment Problem)——如何让AI的目标和人类的价值观保持一致?

目前还没有完美的答案。但至少,社区已经在认真讨论这些问题,并且在产品设计中加入制衡机制。这比“先发展再治理”要好得多。

07. 一个新时代的开启

如果把AI的发展分成几个阶段:

1.0 规则时代(1980s-2000s):AI靠人写的规则做事,下棋、推理都行,但稍微变通一下就傻了。

2.0 感知时代(2010s-2020s):深度学习爆发,AI能看懂图片、听懂语音、读懂文字,但还是只能“被动应答”。

3.0 智能体时代(2026-?):AI不仅能理解,还能主动执行任务,成为真正的“数字助手”。

我们现在正站在2.0向3.0跨越的节点上。

OpenClaw的火爆,可能就是这个转折点的标志。它不一定是最强的,也不一定是最完美的,但它让普通人第一次真切地感受到:原来AI可以这样用。

这就像2007年第一代iPhone发布。它不是第一部智能手机,但它是第一部让大众觉得“智能手机原来这么好用”的产品。从此之后,世界变了。

结语:工具的意义

回到最初的问题:AI智能体对我们意味着什么?

它不是一个遥不可及的黑科技,也不是一个要取代人类的威胁。

它只是一个工具。 一个比以往任何工具都更强大、更灵活、更懂你的工具。

你可以用它来偷懒——让AI帮你处理琐事,自己多睡半小时。也可以用它来成长——让AI帮你搜集资料、整理知识,学得更快更深。还可以用它来创造——让AI帮你实现那些“要是有人帮我一下就好了”的想法。

最终,决定它价值的,不是它有多聪明,而是你用它来做什么。

正如OpenClaw的创始人所说:“我们不是在替代人类,而是在扩展人类的能力边界。”

而这个边界的延伸方向,掌握在我们每一个人手中。

参考资料:- OpenClaw GitHub: https://github.com/openclaw/openclaw- 黄仁勋剑桥演讲实录,2025年- 《AI智能体安全白皮书》,奇安信,2026年- 对多位OpenClaw早期用户的访谈记录

本文旨在科普AI智能体技术,不构成任何投资或使用建议。

>> 常数空间 <<

探索AI前沿 · 理解技术本质 · 思考人类未来

夜雨聆风

夜雨聆风