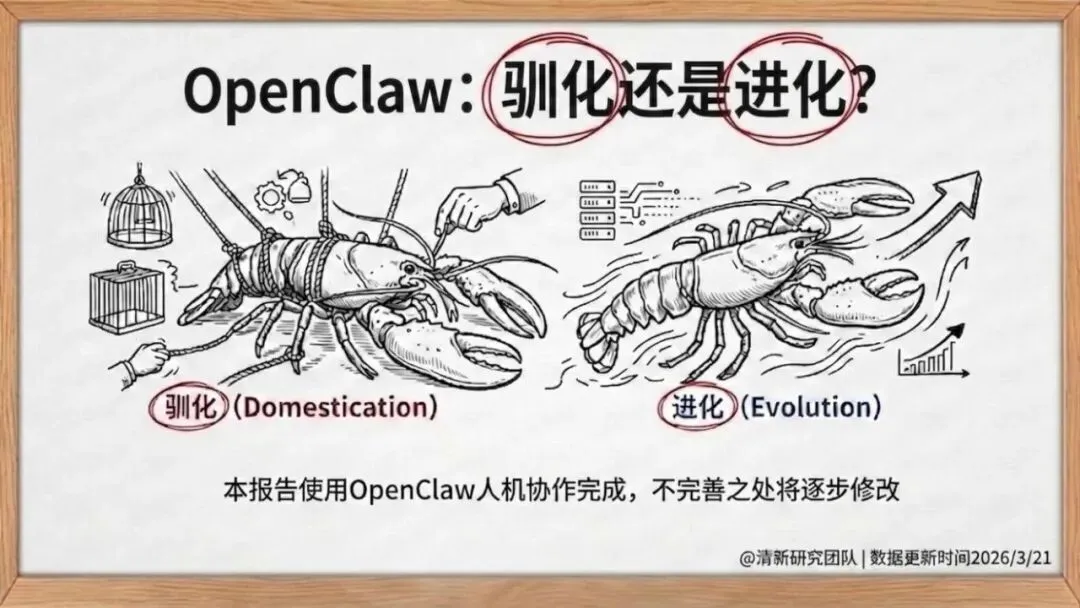

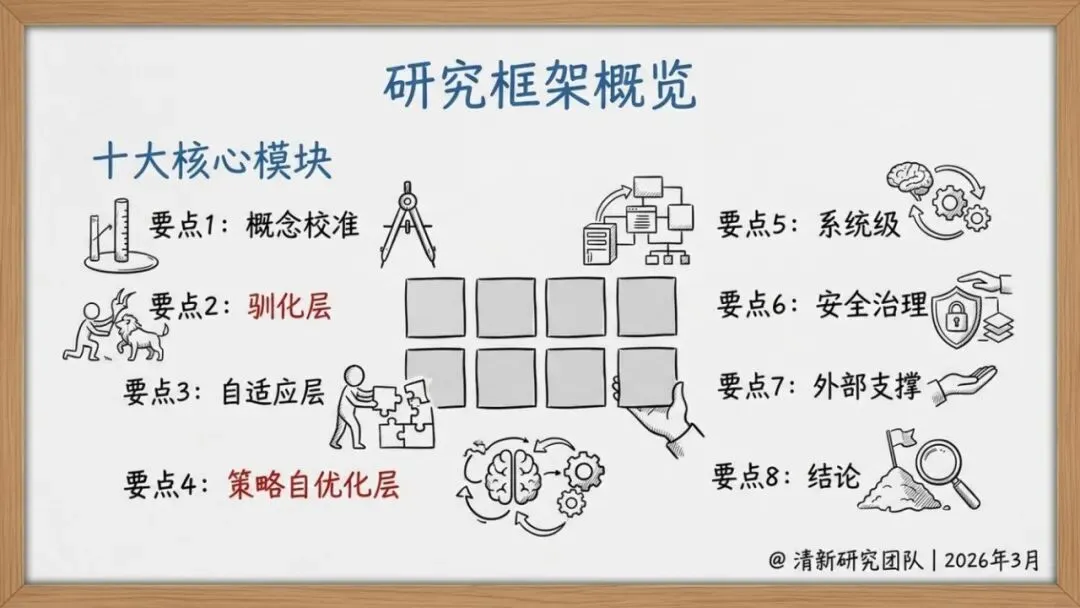

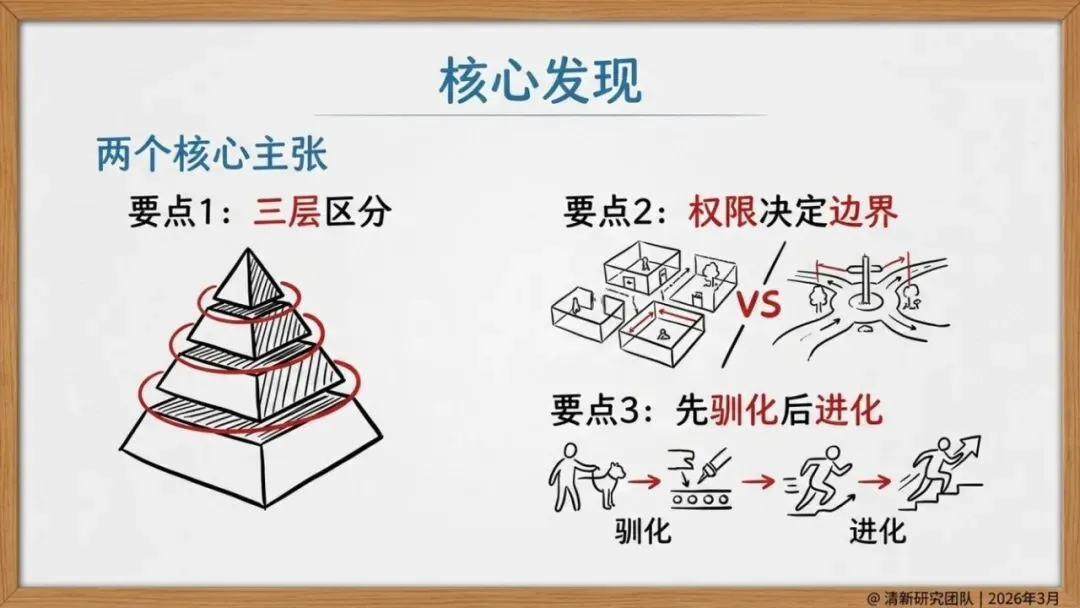

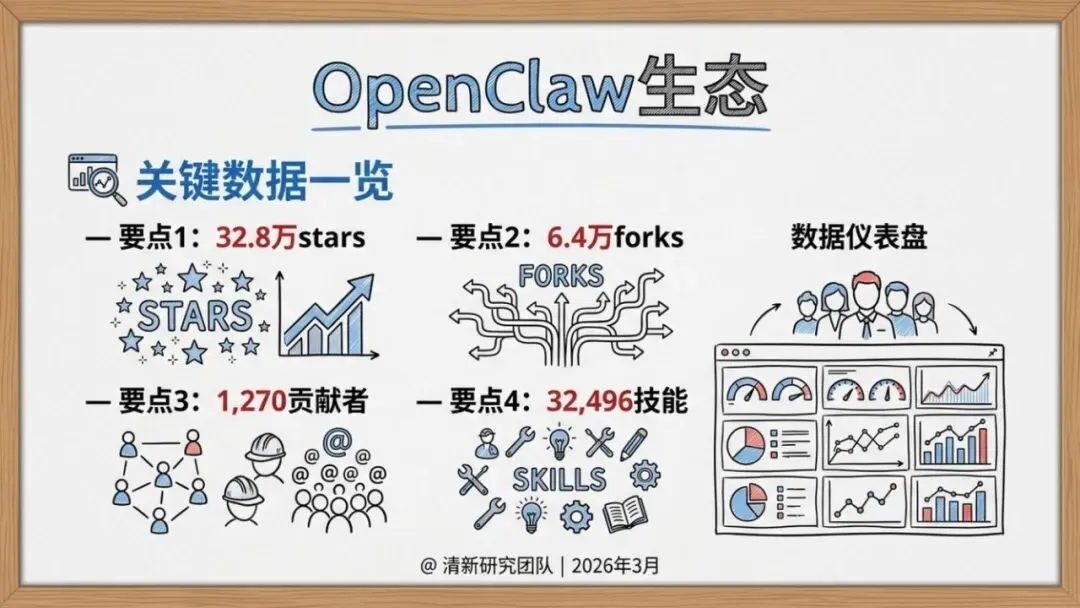

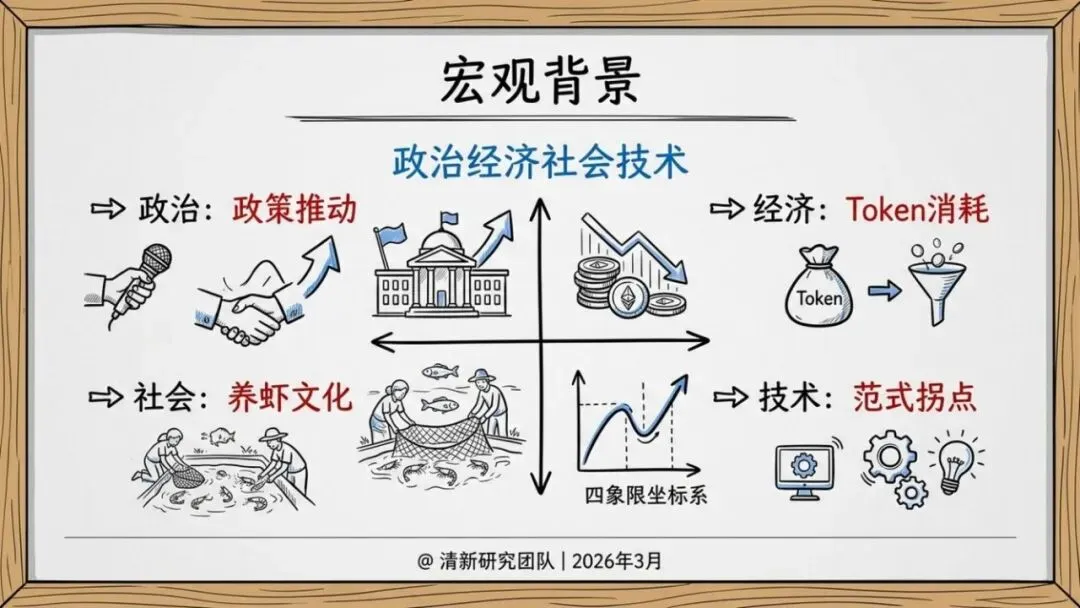

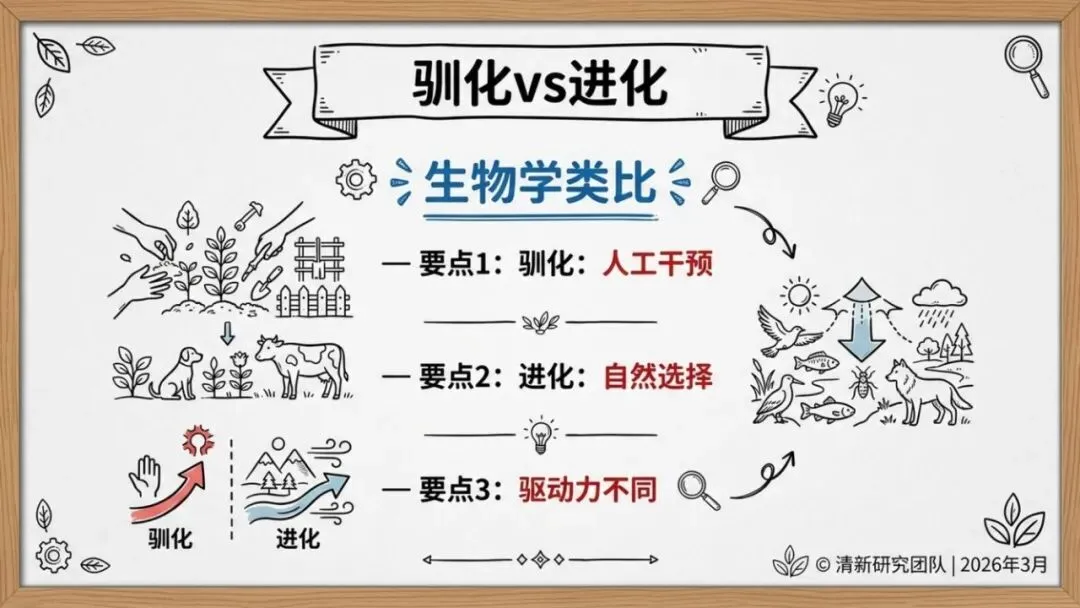

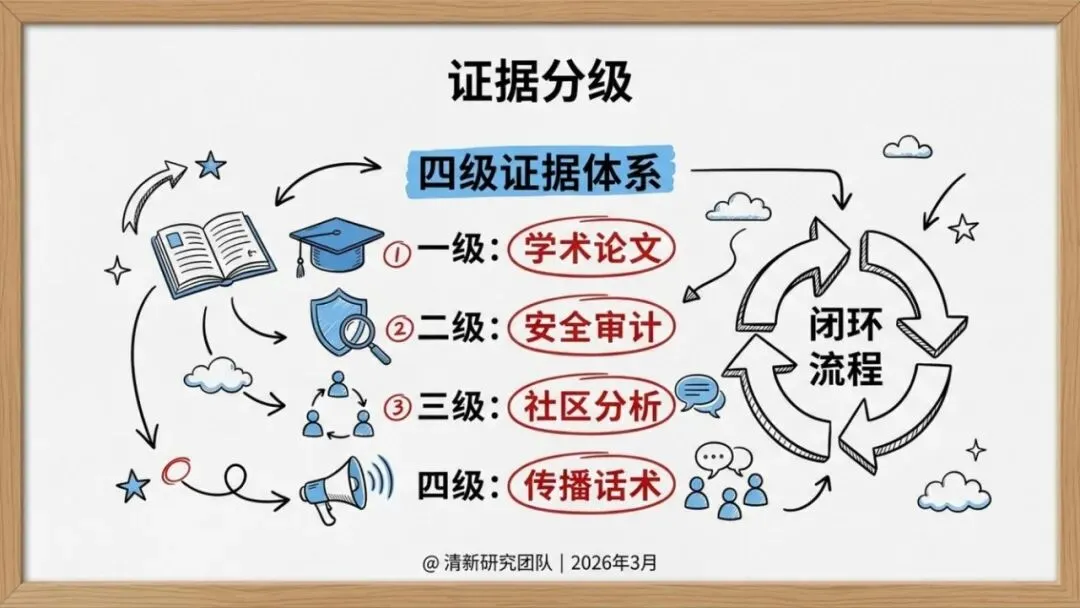

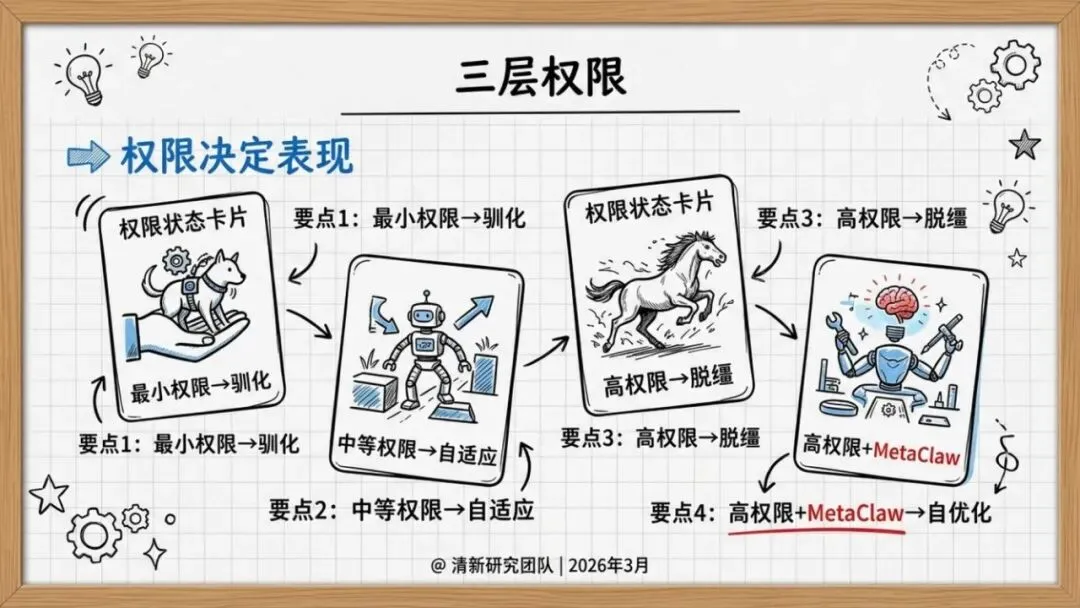

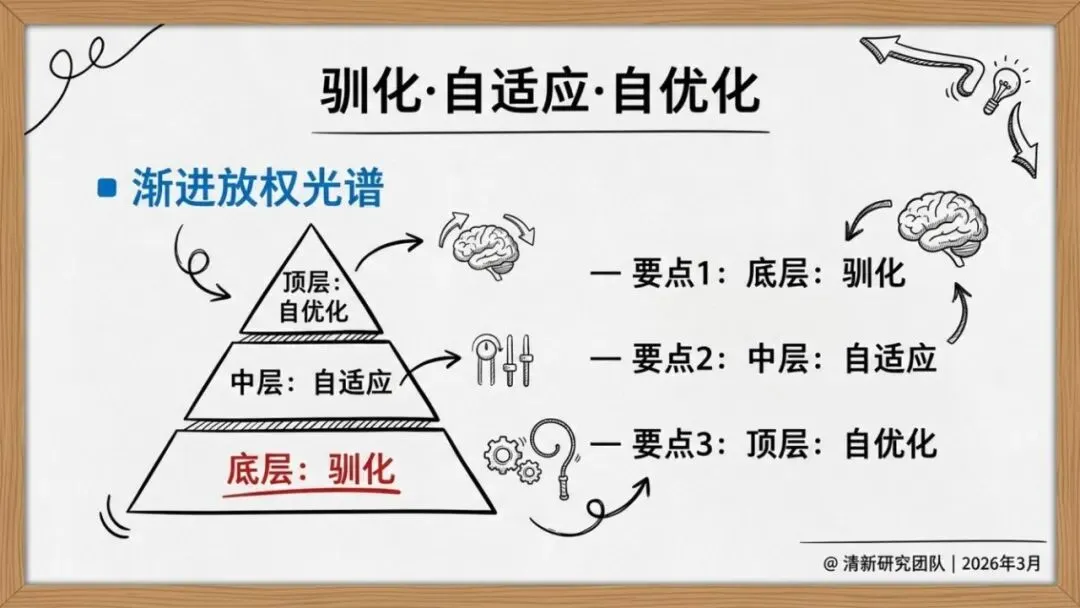

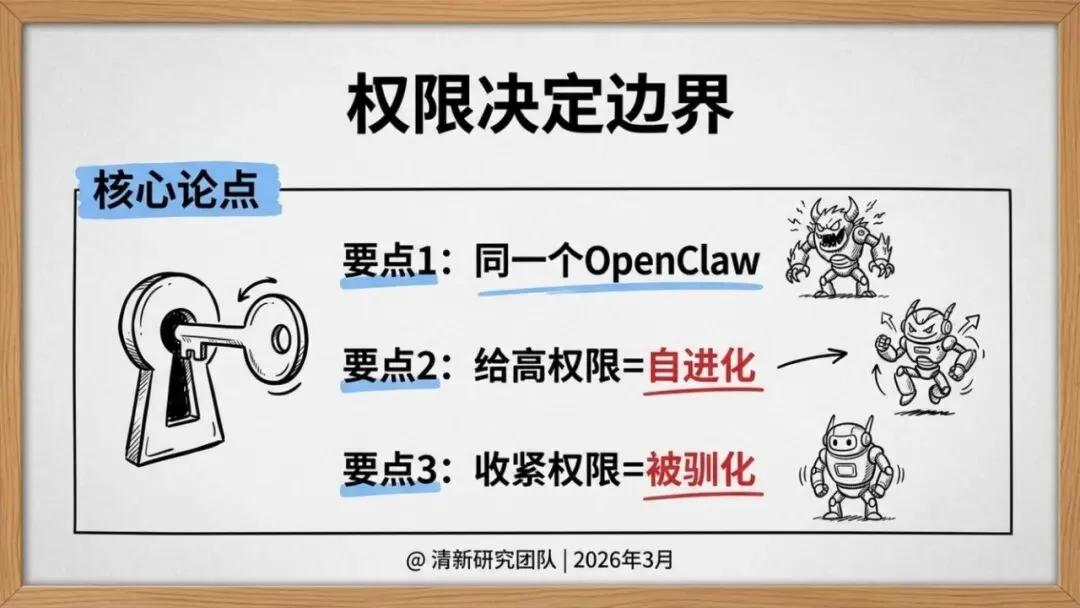

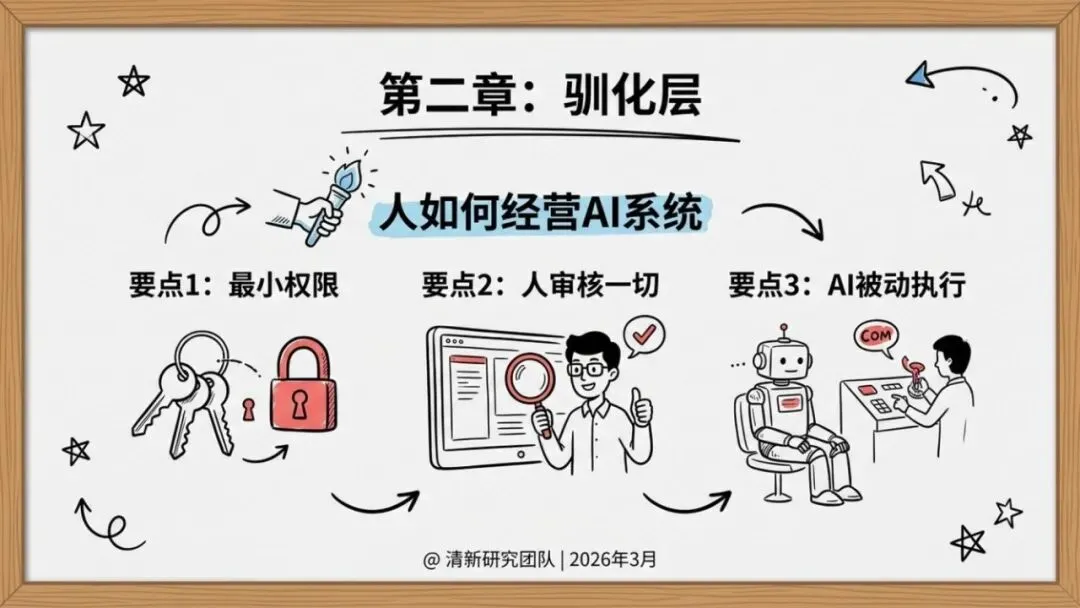

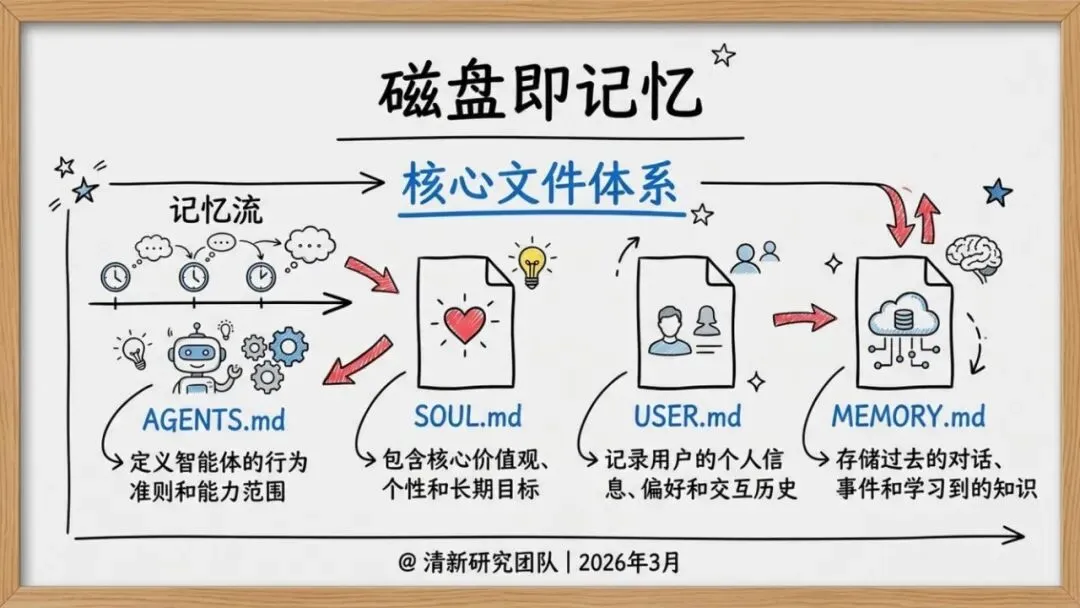

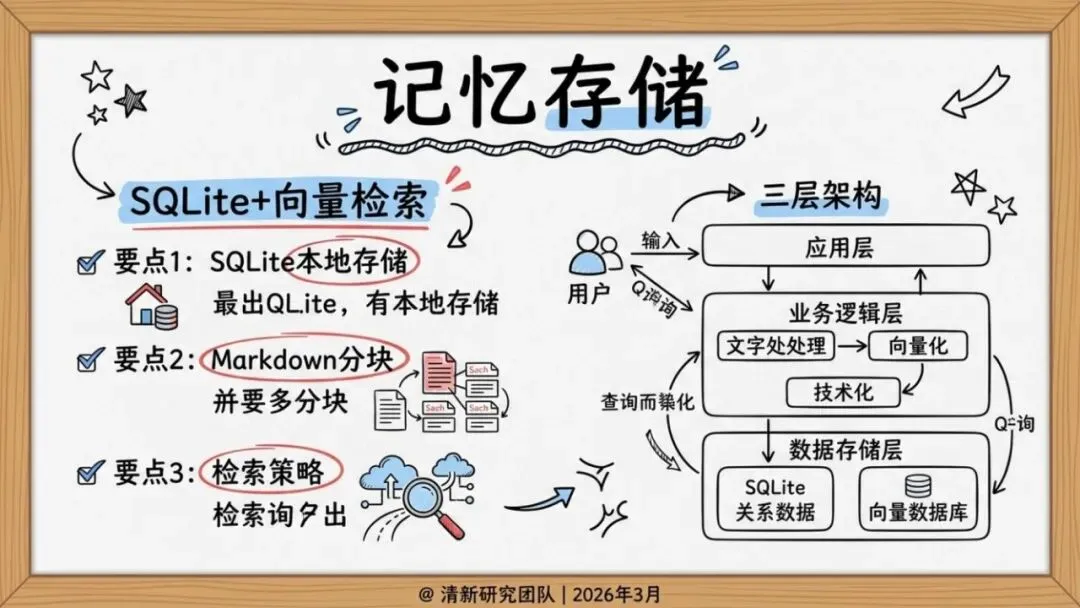

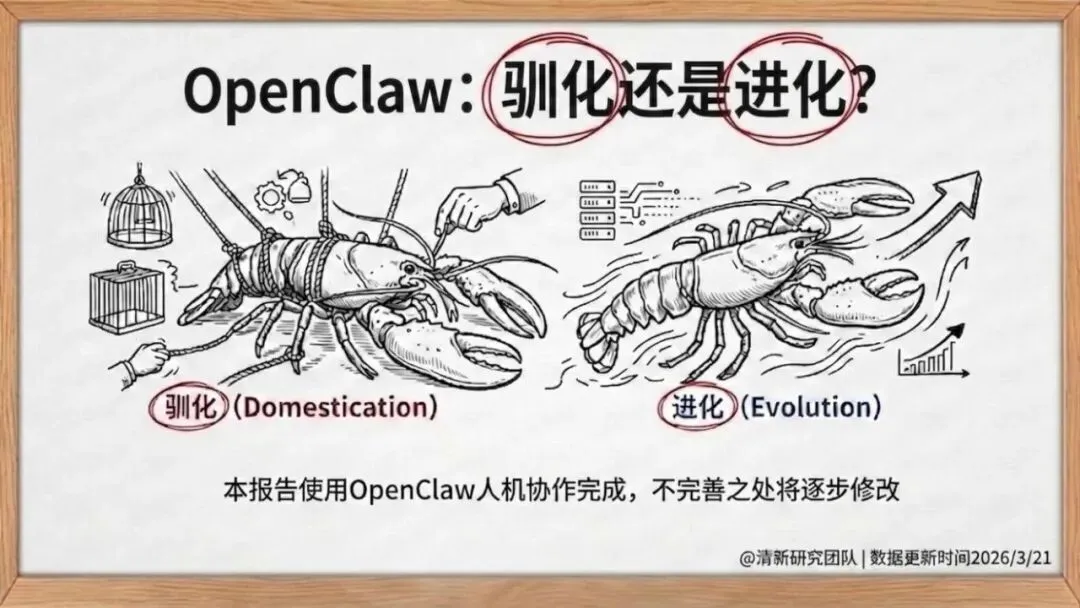

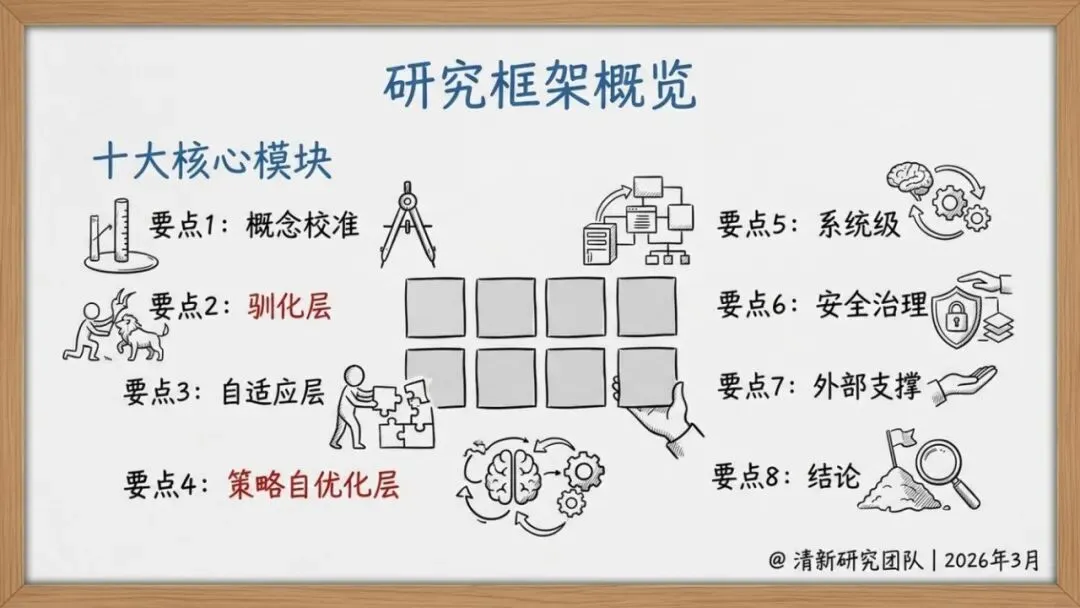

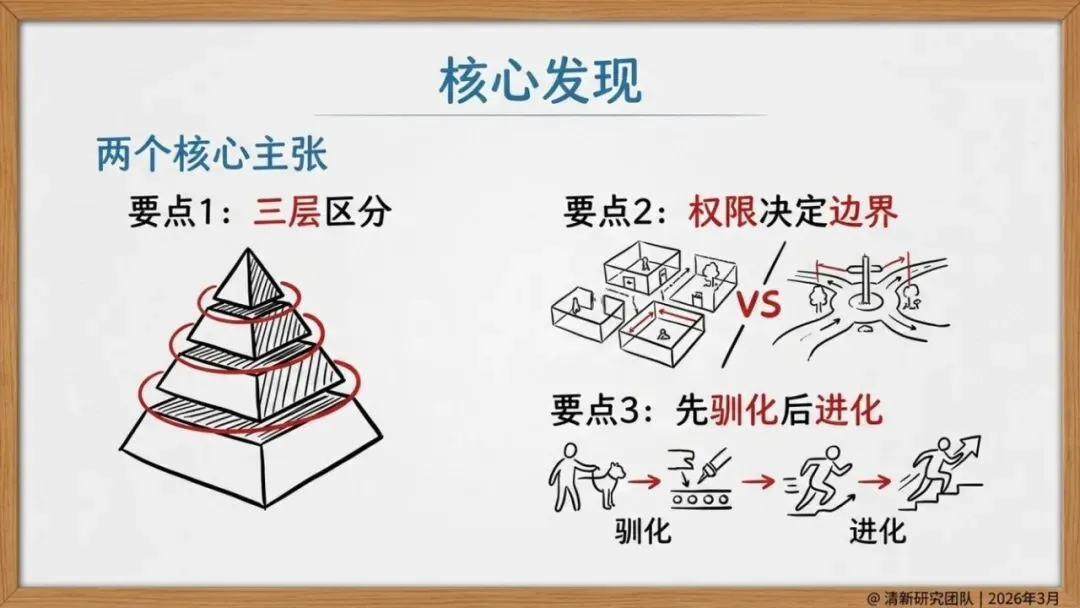

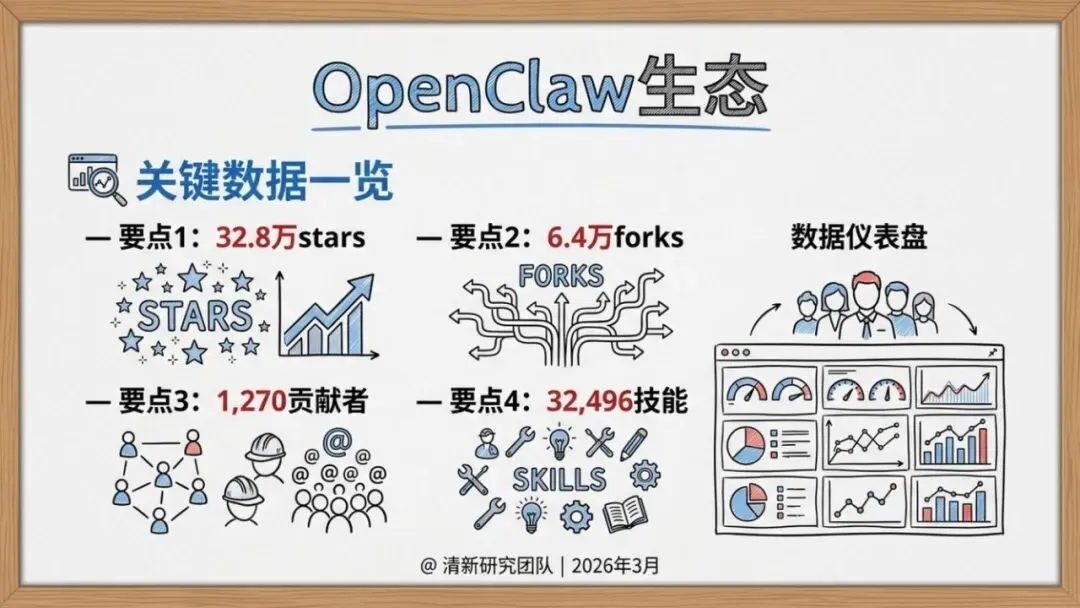

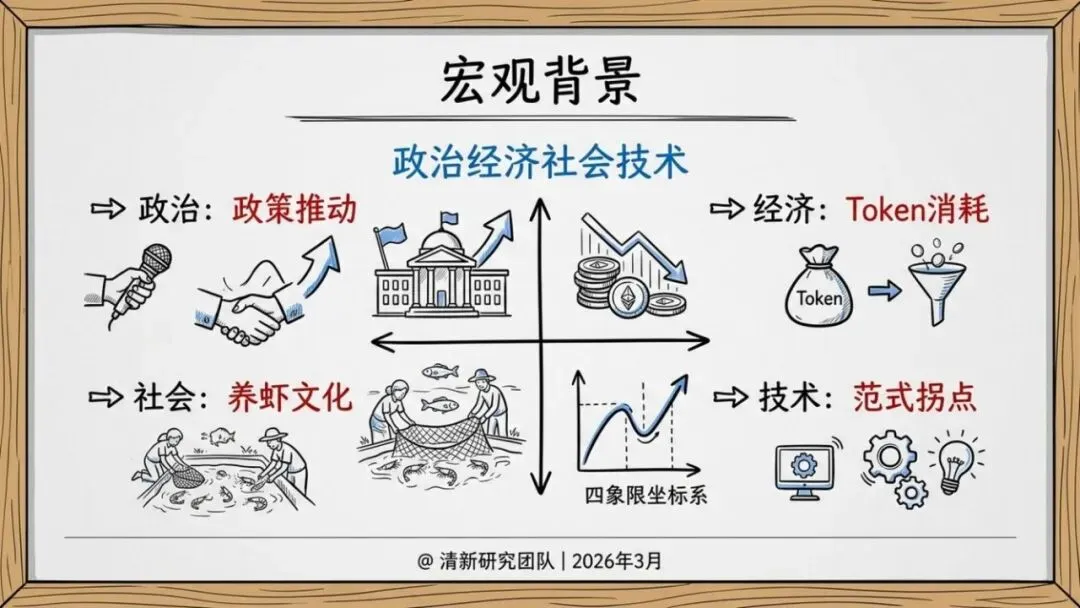

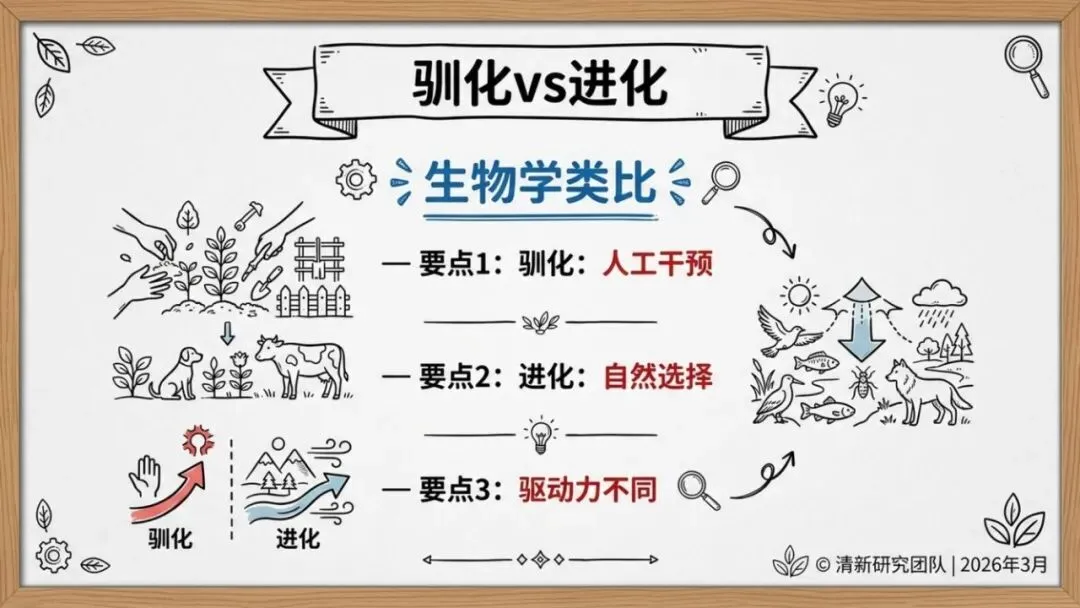

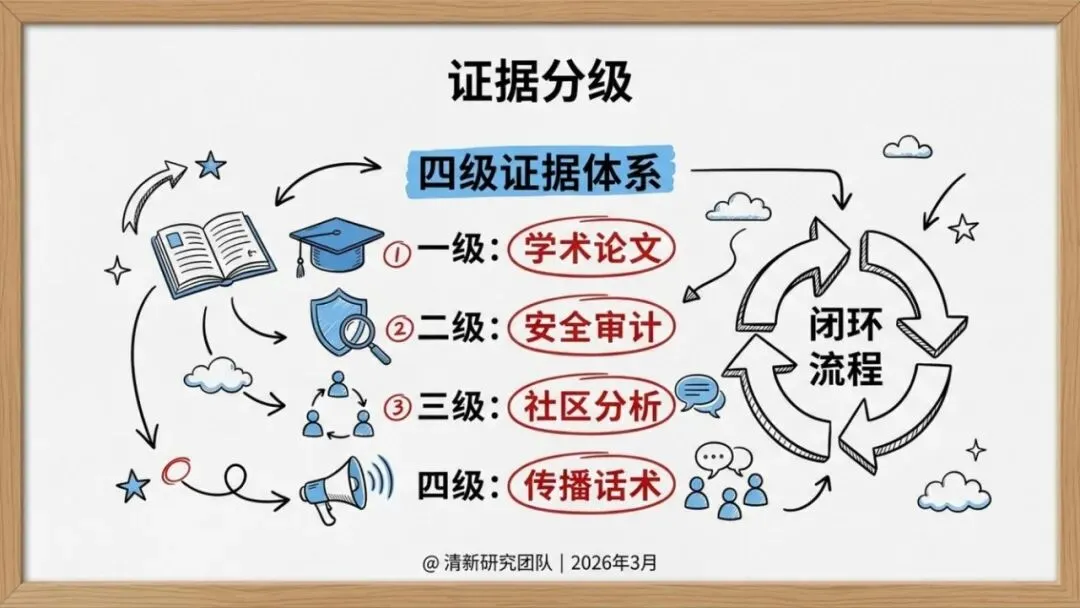

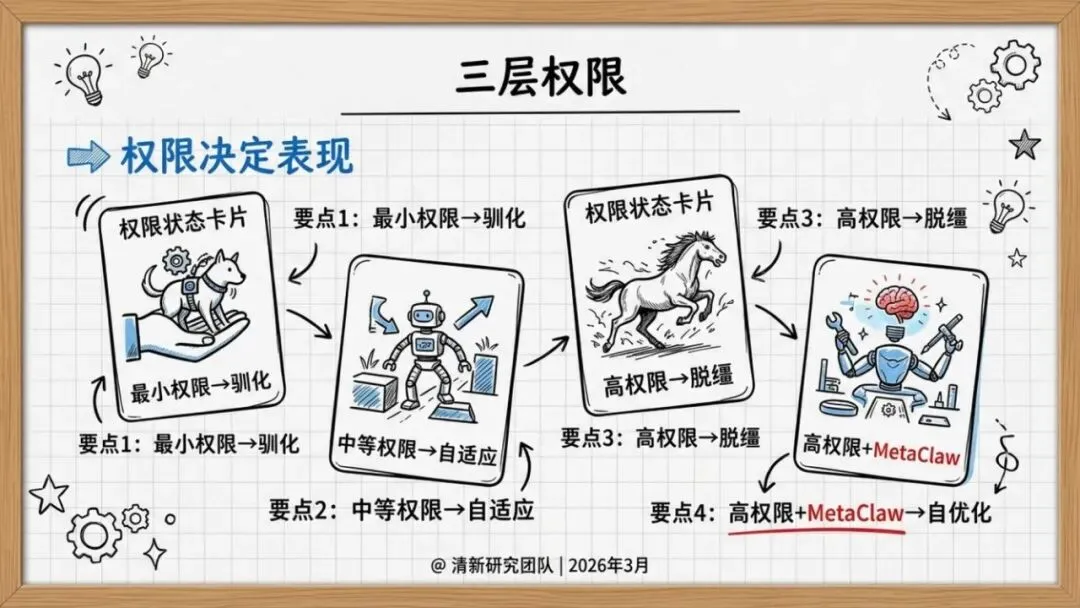

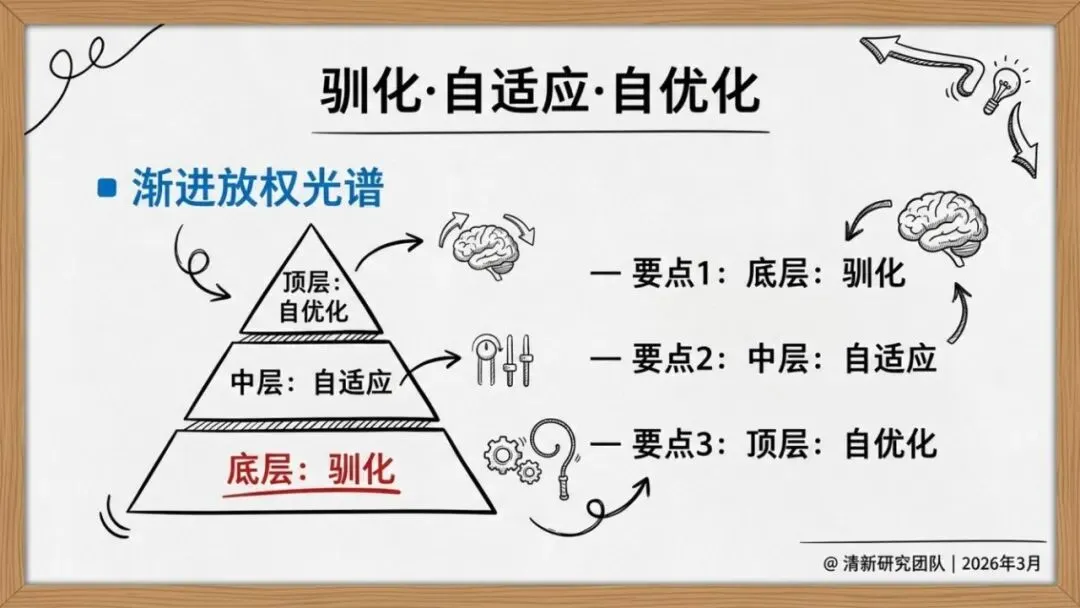

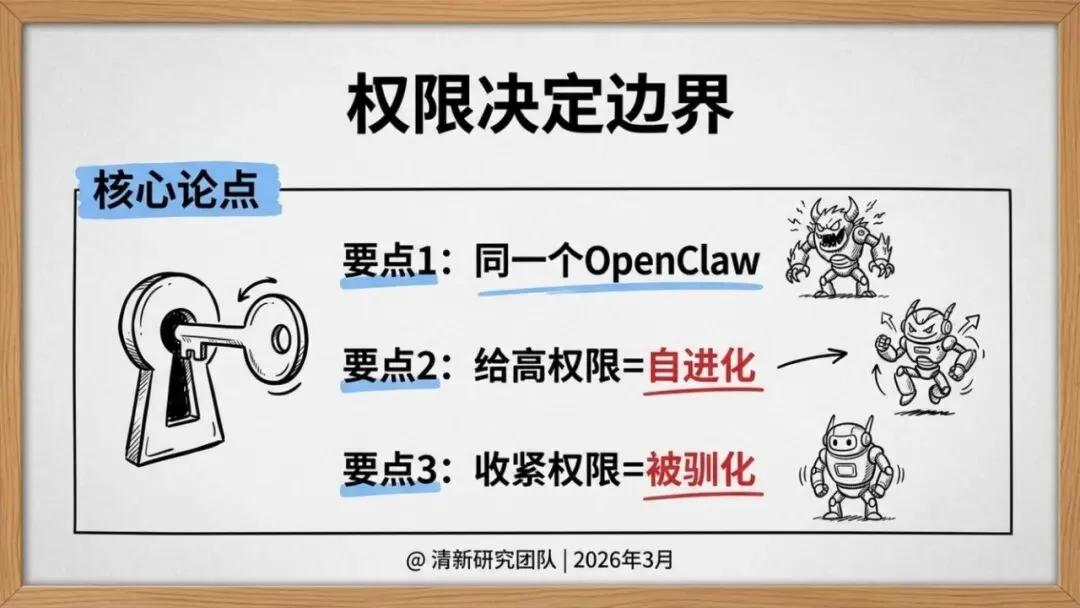

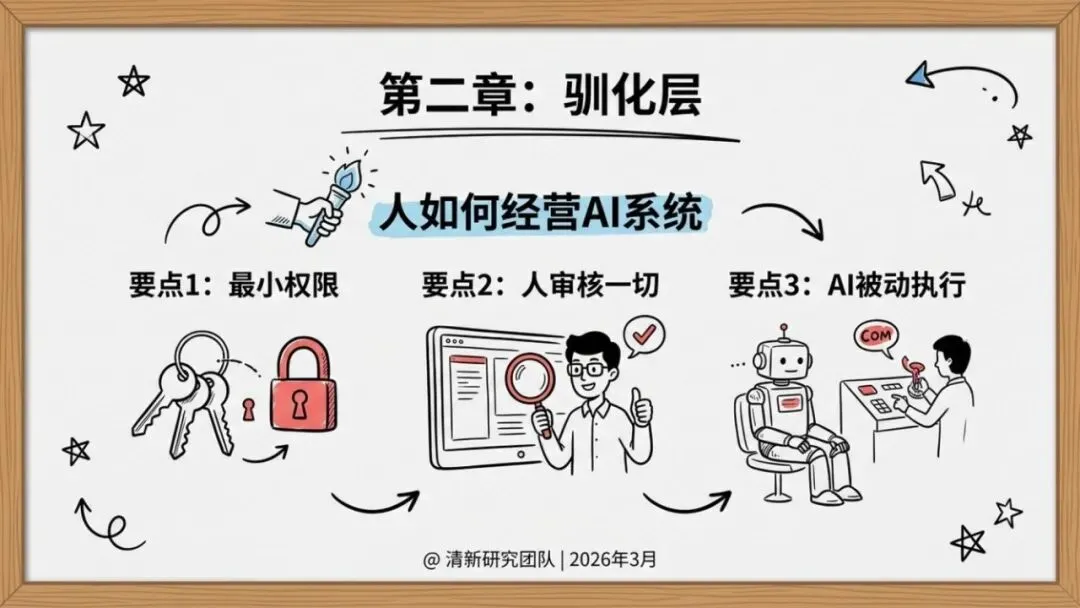

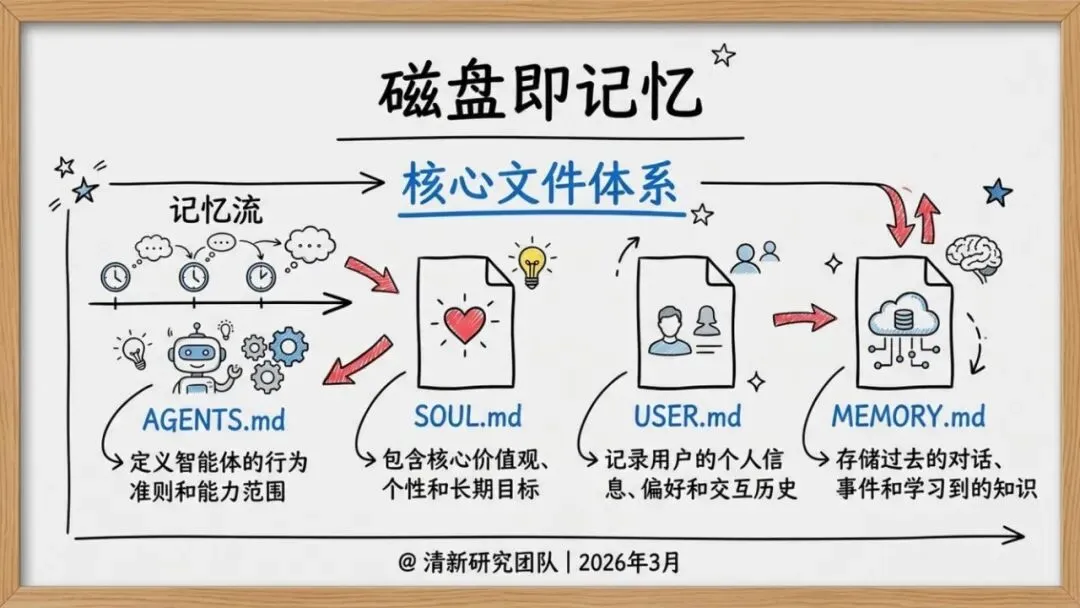

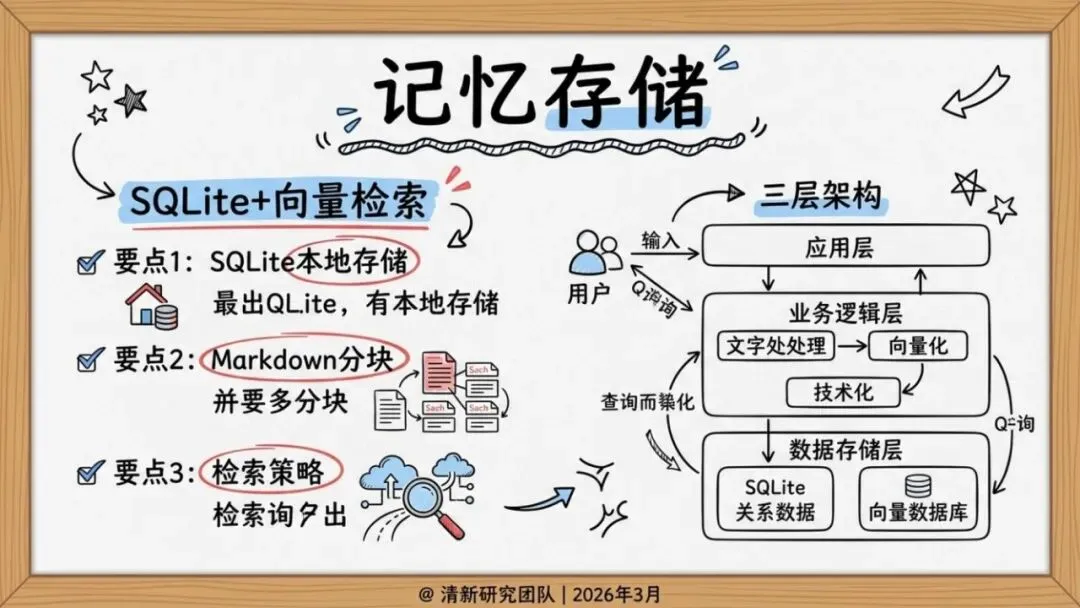

清华大学:OpenClaw驯化还是进化?报告解读(96页附下载)本报告由清华大学沈阳教授团队于2026年3月发布,核心议题是探讨以OpenClaw为代表的AI智能体(AI Agent) 与人类的关系及其发展路径。报告没有停留在技术功能的简单介绍,而是深入到了治理哲学层面,提出了一个以“权限”为核心的框架来分析AI智能体是被人类“驯化”还是在走向“自进化”。报告开篇即提出两个核心主张,这构成了全文分析的基石:1. 权限决定边界:AI智能体(OpenClaw)的“能力”和“行为模式”不取决于其自身,而完全取决于人类赋予它的权限等级。同一个AI,权限不同,表现天差地别。2. 先驯化后进化:AI的发展应遵循“驯化 -> 自适应 -> 自优化(进化)”的渐进式路径。当前阶段应以“驯化”为主,在建立可靠的控制和治理体系后,才能审慎、渐进地“放开缰绳”。报告的核心是构建了一个“三层金字塔”模型,将人类对AI智能体的控制程度分为三个层次,形成一个“渐进放权光谱”: ◦ 特征:AI如同被严格管束的“宠物”。人类(用户)掌握绝对控制权,AI被动执行指令。所有行为需经人工审核(如代码执行、文件修改),记忆(上下文)被严格管理以防“溢出”,技能(Skill)由人加载和配置。 ◦ 价值:用自然语言“经营”AI,实现从“问答”到“执行闭环”的范式转变,但“人握着缰绳”。 ◦ 当前状态:报告指出,约70%的OpenClaw实践处于此阶段。 ◦ 特征:放开部分缰绳。AI可以在一定权限内自我修改工作空间(Workspace)和配置文件,以优化自身行为、适应新任务。例如,ClawHub项目可记录“learnings”并生成新技能框架。 ◦ 关键区别:此阶段的“进化”是修改“表现型”(配置文件、提示词),而非“基因型”(模型底层权重)。其风险在于可能被恶意技能“劫持”行为。• 顶层:策略自优化层(对应高权限,并可访问MetaClaw) ◦ 特征:真正的“进化”层。AI不仅能改行为指令,还能通过MetaClaw等机制优化和更新模型自身的权重(即改变“基因”)。报告引用北卡教堂山分校的学术研究,论证了“梯度无关”的快速自适应方法,使AI能自主诊断失败、合成新指令、循环优化。 ◦ 运作:在低干扰时段(如用户睡眠时)自主学习,形成“好策略<->好失败<->丰富技能”的强化循环。1. “驯化”是当前主流与基础:报告用大量篇幅详述“驯化层”的运作,如记忆的磁盘存储与防溢出、技能的三级披露、人配置的四种触发器等,论证了构建稳定、可控、可理解的AI操作环境是一切的前提。案例“9只小龙虾”展示了在纯粹驯化层通过任务拆解和流程编排,就能高效完成复杂协作。2. “进化”的风险与治理是焦点:报告对“自适应”和“自优化”层伴生的风险保持高度警惕,并专章讨论安全治理: ◦ 驯化层风险:主要来自供应链攻击(报告中审计出2857个技能中有341个恶意)。 ◦ 自适应层风险:行为劫持(如攻击SOUL.md文件导致永久性行为改变)。 ◦ 自优化层风险:权重偏离导致目标对齐漂移,且难以检测。 ◦ 治理原则:提出了“减法优于加法、验证先于晋升、信任权限同步”等核心原则,并强调每次放权都需要换用更强的安全工具(如版本控制、沙箱隔离)。3. 系统级进化与生态支撑:报告视野超越单个智能体,讨论了多智能体协作的系统级能力,以及支撑整个OpenClaw生态发展的外部要素: ◦ 模型竞争:MiniMax M2.7、Kimi等模型在复杂技能和遵从度上表现突出,推动生态上限。 ◦ 基础设施:英伟达的OpenShell和NemoClaw旨在提供安全的“笼子”(沙箱、策略引擎、隐私路由),其理念是“为了敢放权”,没有安全护栏就不敢放开权限。 ◦ 产业落地:阿里云CoPaw、腾讯WorkBuddy、字节UI-TARS、华为小艺等30+产品矩阵,表明该生态正快速扩展。• 结论是“先驯化,后进化”。AI“能”进化(自改规则、自建技能、更新权重),但“该不该”以及“何时”进化,取决于人类建立的治理体系是否成熟。• 这不是一个非此即彼的分类,而是一个“权限光谱”。从完全受控的“宠物”到完全放开的“野生”状态之间,存在连续的灰度地带。OpenClaw的价值正是提供了这条完整的、可控的阶梯。• 当前实践分布(驯化70%,自适应20%,自优化10%)印证了“渐进”是主流共识。报告最后向政策制定者提出战略建议:明确放权节奏、实施分层监管(针对不同风险层级)、并在安全前提下鼓励创新实验。这是一份极具前瞻性和深度的行业分析报告。它没有停留在对OpenClaw功能的科普,而是:1. 提出了一个强大的分析框架:用“权限”这把钥匙,统一解释了从工具到伙伴再到自主体的AI发展连续谱。2. 平衡了创新与审慎:既展示了AI自进化的巨大潜力,又以大量实证(数据、案例、风险分析)强调了稳健治理的极端重要性。3. 具备实践指导价值:为AI智能体的开发者、使用者和监管者,提供了一个从技术实施到安全治理再到战略规划的清晰路线图思考。报告的核心启示是:AI智能体的未来形态,将不主要由技术上限决定,而由人类设计的权限体系与治理智慧共同塑造。部分内容预览

—

—

—

扫描识别下方二维码可自助开通会员

—

本篇资料已更新至情报猿资料分享平台

咨询会员服务、了解完整版资料获取方式

请加微信号“qbyuan888”

—

免责声明:以上报告均系本平台合作用户通过公开、合法渠道获得,报告版权归原撰写/发布机构所有, 如 涉 侵 权 , 请 联 系 删 除 ;资料为推荐阅读,仅供参考学习,如对内容存疑,请与原撰写/发布机构联系。

—

—

—

—