这篇文章来自 Xbotics-robot-openclaw-awesome-work 的 external-projects 最近新增内容整理。

目标很简单:把四个项目讲清楚,尤其是「它到底解决什么问题」「优势具体在哪」「哪些做法可以直接复用」。

你会看到,这四个项目都在做同一件事:把 OpenClaw 从聊天界面带到真实机器人里。不同的是,它们分别选择了不同的工程路径。

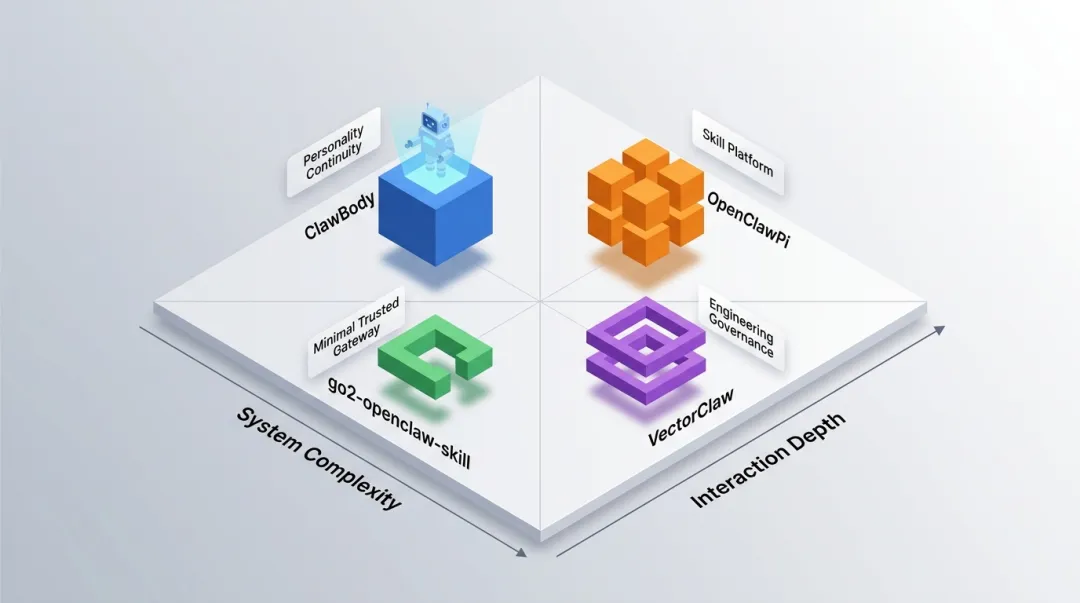

该怎么选:看你的当前目标

优先做交互体验:先看 clawbody优先打通控制闭环:先看 go2-openclaw-skill优先做标准化治理:先看 VectorClaw优先建长期技能平台:先看 OpenClawPi

图注:四个OpenClaw机器人项目的定位矩阵

1) ClawBody:把“人格连续性”做进实体交互

项目地址:https://github.com/tomrikert/clawbody平台:Reachy Mini定位:让 OpenClaw 的上下文记忆、语音能力和机器人动作真正连成一个系统

很多机器人 demo 的问题不在“能不能说”,而在“是不是同一个助手”。用户在网页里聊过的事,到机器人这边就断了,这会直接影响真实使用体验。

ClawBody 的关键做法是:

启动时向 OpenClaw 拉取 Agent 上下文(身份、用户关系、近期对话); 每轮对话结束后,把本次交互回写到记忆侧; 本地执行低延迟动作工具,复杂任务再转发给 OpenClaw。

这一套机制带来的效果是:机器人不是一个临时声卡,而是同一个 Agent 的具身入口。

为什么这个项目值得抄

上下文连续:跨端一致(网页、IM、机器人); 动作系统成熟:100Hz 控制循环,主动作与偏置动作分层; 视觉交互自然:人脸跟踪不是单点控制,而是扫描、跟踪、等待、回中的状态机; 降级策略完整:本地视觉失败时有云端和桥接兜底,不会直接断功能。

适合谁

需要做“对外演示效果好”的具身项目团队; 关注多模态交互而非纯动作控制的开发者; 希望先仿真后实机、降低试错成本的团队。

实践提醒

依赖 Realtime 语音链路,断线重连要做扎实; 视觉模型可选项多,部署前先做算力预算; 动作和语音并行时要重点测稳定性(回声、抖动、阻塞)。

2) go2-openclaw-skill:最小网关,把语言变成可靠动作

项目地址:https://github.com/dongsheng123132/go2-openclaw-skill平台:Unitree Go2定位:用最小 HTTP 网关把 OpenClaw 指令映射到四足动作

这个项目的价值在于“克制”。它没有追求复杂系统,而是先把最小闭环做稳:能查状态、能执行动作、能急停、能约束风险。

核心接口只有五个:

GET /statusGET /batteryPOST /movePOST /stopPOST /action

这种接口面非常适合快速对接和后续治理:鉴权、审计、日志都能围绕这层做。

为什么这个项目值得抄

接入轻: FastAPI + unitree_sdk2py,不依赖完整 ROS2;边界清晰:上层做语义,下层做执行,中间契约明确; 安全前置:限速、限时、后空翻电量阈值都在网关层固化; 技能可执行: SKILL.md中自然语言到 API 的映射可直接落地。

适合谁

目标是两周内跑通机器人 PoC 的团队; 想先做“可信动作链路”再扩复杂行为的团队; 希望减少中间件复杂度的个人开发者。

建议的推进顺序

先打通网络与 /status;再做“站/坐/停”三动作闭环; 补齐阈值、错误码和日志; 再进入长流程任务编排。

这条路径的好处是:每一步都可验证、可回退。

3) VectorClaw:标准化能力层,适合长期维护

项目地址:https://github.com/danmartinez78/VectorClaw平台:Anki Vector定位:通过 MCP Server 暴露机器人工具,强调本地优先与工程治理

如果说前两个项目更偏“快速打通”,VectorClaw 更像“可持续维护的基座”。它把工具注册、输入 schema、调用分发、连接管理、文档体系都搭起来了。

为什么这个项目值得抄

Tool Registry 完整:新增工具有固定入口和约束,不会越改越乱; 连接管理稳健:单例、线程安全、指数退避重试; 能力分级透明:稳定能力与实验能力分开标注; 安全文档扎实:威胁模型、信任边界、凭据与网络风险写得很具体; 交付链路完整:Setup、API 文档、Smoke 检查、CI、发布流程一应俱全。

适合谁

需要多人协作、长期迭代的项目组; 希望把“机器人能力”纳入标准工具治理的团队; 对隐私和本地部署有明确要求的场景。

一个常被忽视但很重要的点

VectorClaw 的文档会明确告诉你“不稳定的地方在哪里”。这比“看起来功能很多”更有价值,因为集成阶段最怕的是错误预期。

4) OpenClawPi:从功能堆叠走向技能资产化

项目地址:https://github.com/vanstrong12138/OpenClawPi平台:AgileX 相关场景定位:把机械臂、抓取、视觉、语音等能力做成可复用技能模块

OpenClawPi 的重点不在单一炫技功能,而在“可复用能力沉淀”。这条路线更接近平台建设思路:模块清晰、按需组合、支持扩展。

公开信息中提到的模块包括:

agx-arm-codegengrab_skillvl_vision_skillvoice_skill

为什么这个项目值得抄

模块边界清楚:有利于多人分工和独立调试; 场景覆盖完整:动作、感知、语音三条链路都考虑到了; 强调接口规范:新增技能可以按模板接入,扩展成本更低。

适合谁

在做课程/实验室平台建设的团队; 需要长期积累技能库而非一次性 demo 的组织; 希望形成“可交接、可复用、可治理”能力资产的团队。

实践建议

先选一个技能做“样板模块”; 样板跑通后再扩第二个技能,验证模板可复制性; 最后再做多技能编排,避免早期复杂耦合。

总结

这四篇文章合在一起,本质上是同一件事:如何把AI Agent的能力,稳定、可靠、可扩展地落到真实机器人身上。

没有一条路线是“标准答案”。但每一条路线上,都有值得直接抄的工程细节。

如果你也在做机器人+AI Agent的落地,欢迎去Xbotics-robot-openclaw-awesome-work仓库里翻翻。这里的项目不是“看个热闹”,而是真的可以拿来改、拿来用、拿来沉淀的工程资产。

-END-

往期回顾

Xbotics-robot-openclaw-awesome-work:把“OpenClaw × Robot”方向上出现的项目、教程、活动和实践资料,整理成一个统一入口

OpenClaw + Robot 项目专栏:当AI学会「动手」

仿真平台的新战场:OpenClaw × Simulation × RL,把“会做事”的能力自主训练出来

Vbot + OpenClaw:把“行动型 AI Agent”装进家庭机器狗的落地探索

Ask Me Anything|提问箱

❝对文章有疑惑,或想聊更深?欢迎把你的问题丢给我们:技术方案、实操踩坑、课程与资料、项目合作、职业发展,都可以问。

怎么问:在评论区留言,或私信公众号

我们会做什么:每周集中整理高质量问题并公开回复,重点问题邀请作者或嘉宾深度解答;典型问题会加入知识库并持续更新。

提问小提示:尽量说明「你的目标—当前做法—期望产出」,附上必要信息(硬件/软件版本、数据规模等),能更快获得有用答案。

一起把问题变成知识,推动社区进步 🚀

夜雨聆风

夜雨聆风