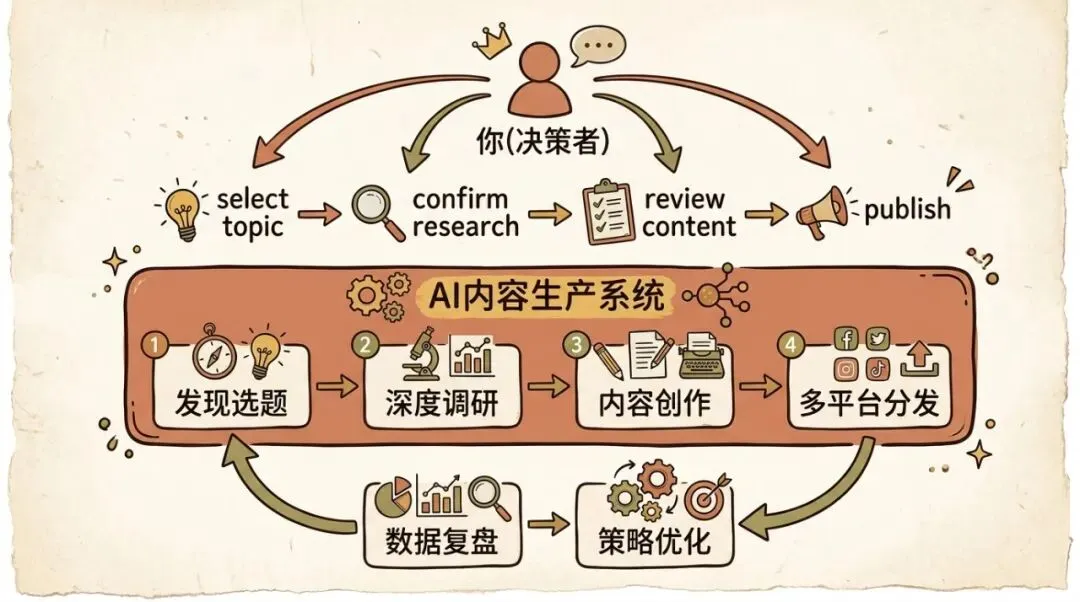

用 OpenClaw + OpenCLI 搭了一套内容循环系统,从选题到复盘全自动跑起来。每天只做一件事:看选题、选一个、审核内容、点发布,剩下的 AI 全干。

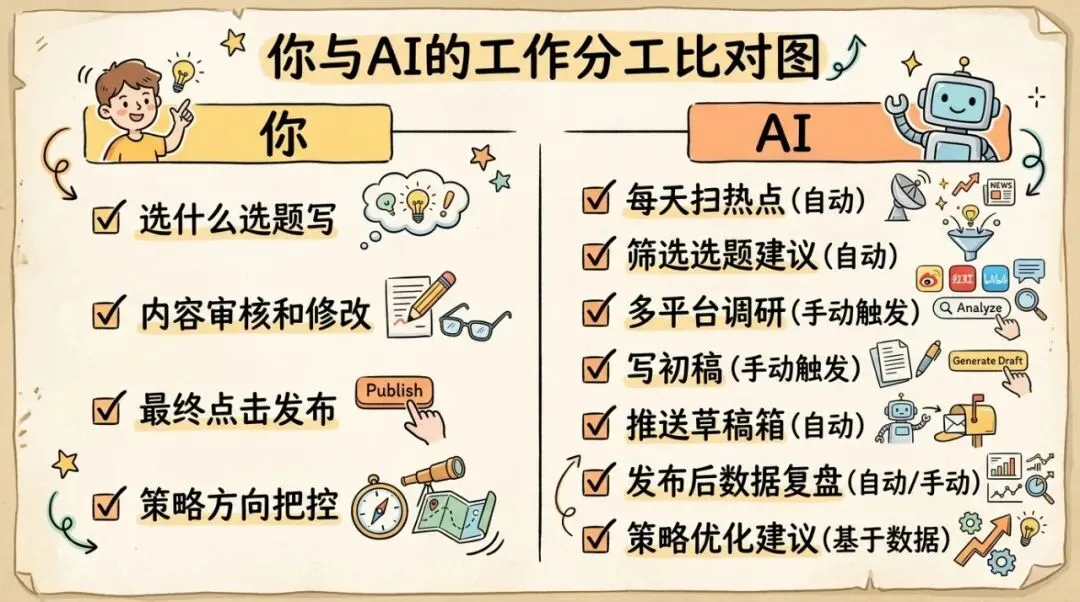

这套系统的核心就一句话:把内容运营拆成"执行"和"决策",执行交给 AI,人只做决策。

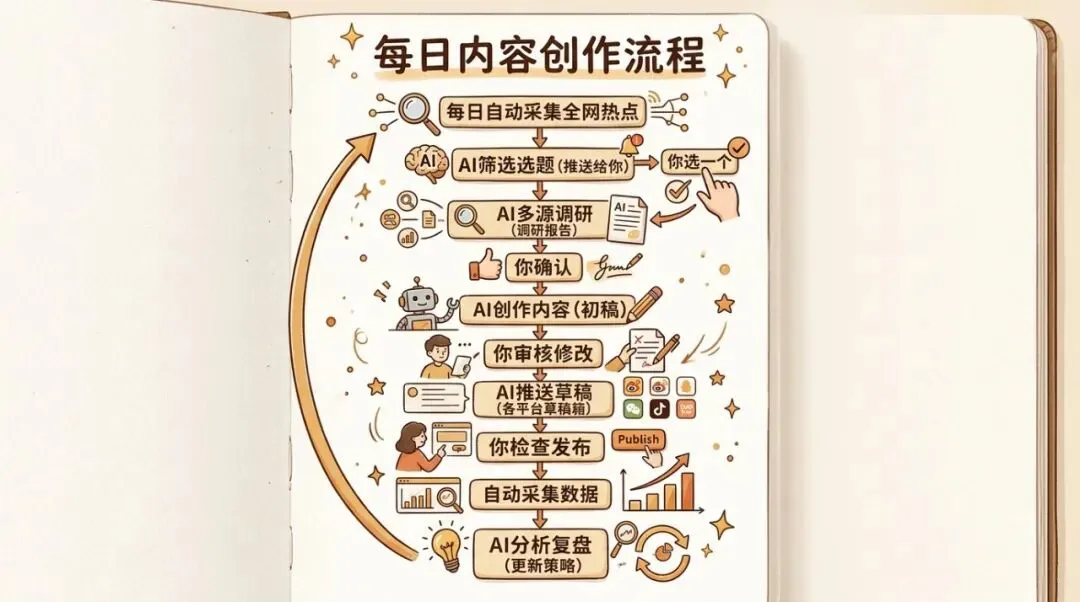

每天下午 4 点,AI 自动扫全网热点,筛出 5-10 个选题推给我。我选一个,AI 去调研、写初稿、推到草稿箱。我审核完发布。发布后 AI 采集数据做复盘,复盘结论存下来影响下一次选题。

一个闭环,越跑越准。

怎么做到的

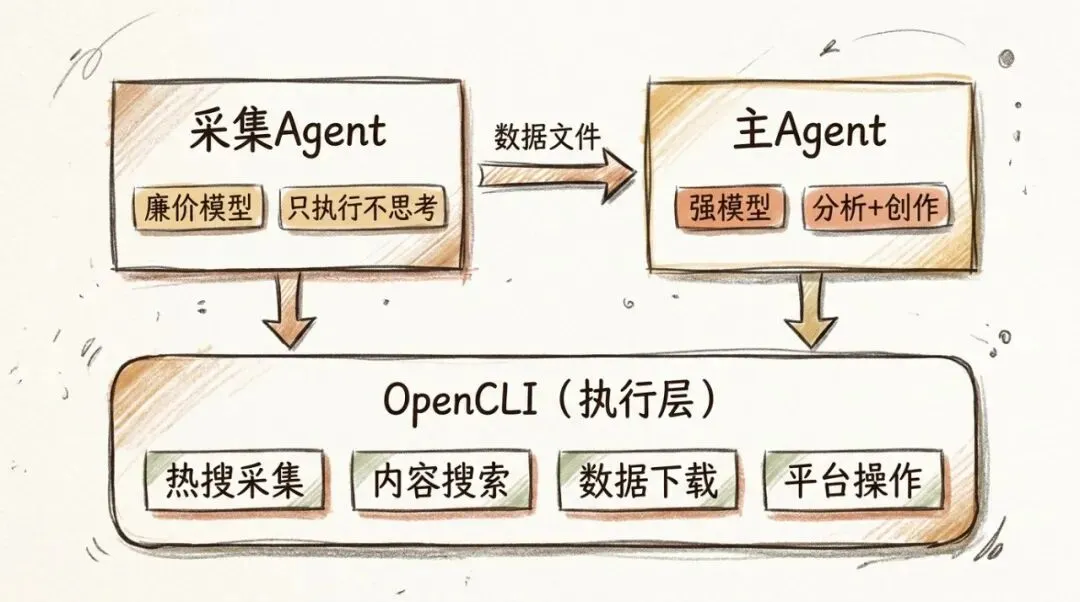

用两个 OpenClaw Agent 分工。

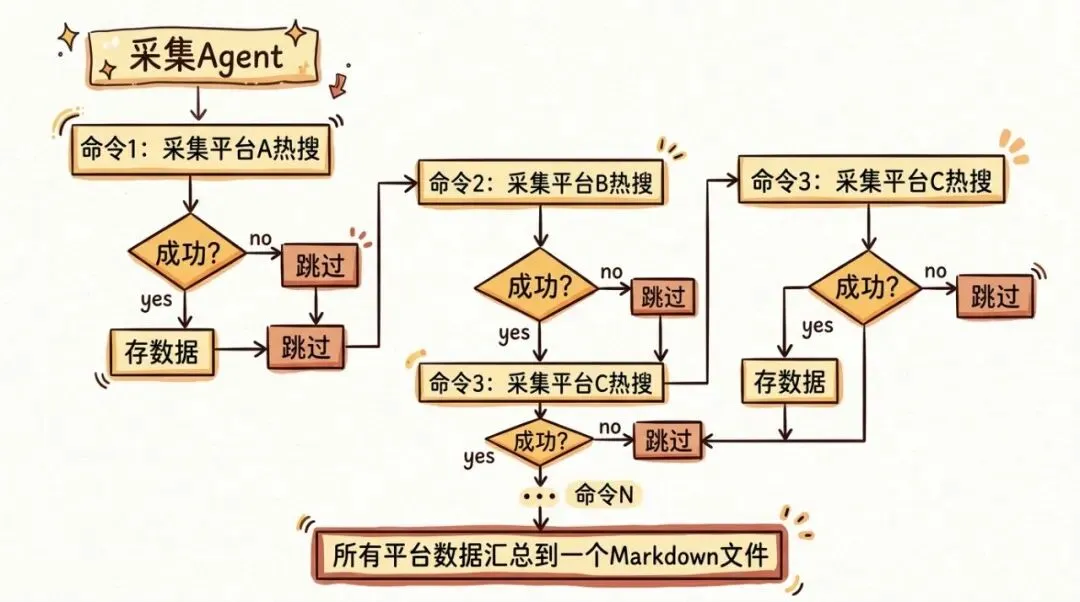

采集 Agent:廉价模型,只干体力活。每天定时扫热点、检测中英文社区的信息差,把数据存到本地文件。不需要它思考,按指令跑就行。

主 Agent:强模型,干脑力活。读采集数据、筛选题、调研、写文章、推草稿箱、做复盘。它有记忆,有策略文件,每次创作前会读历史规律,每次复盘后会把新结论写回去。

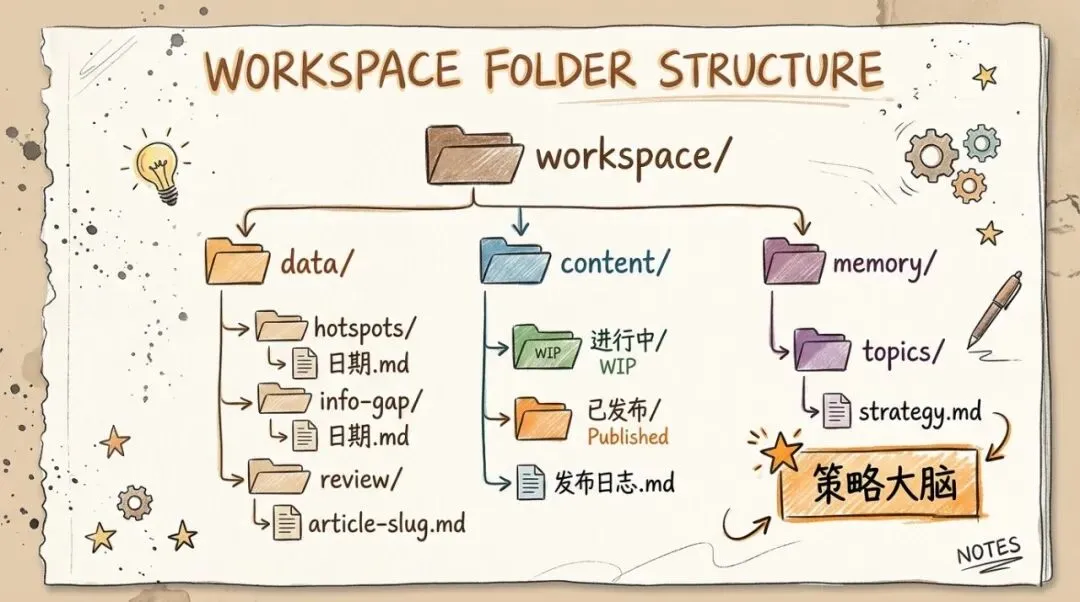

两个 Agent 通过本地文件协作——一个写,一个读。没有 API 对接,没有消息队列,就是一个 workspace 里的文件夹。

OpenCLI 在中间做执行层,负责采集热搜、搜索内容、下载数据、操作平台这些跟外部打交道的事。

数据怎么流转

所有数据都存在本地 workspace 里:

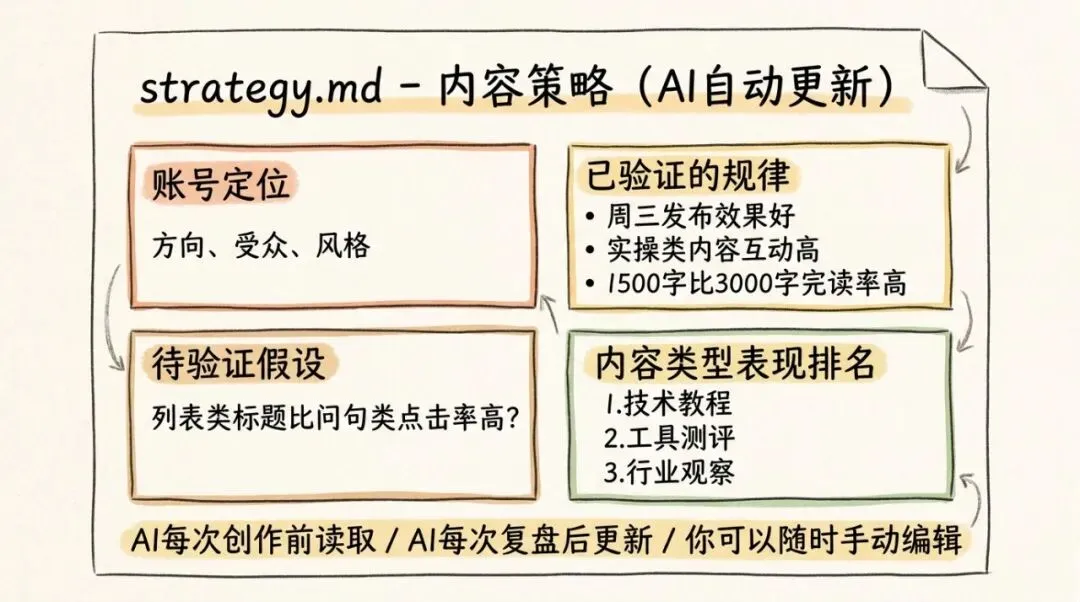

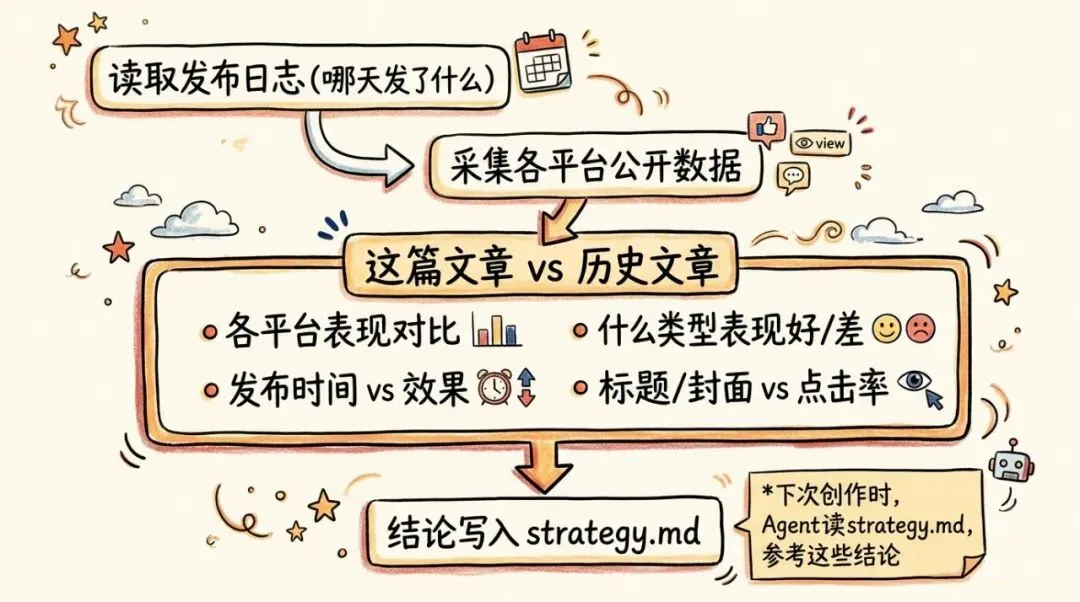

strategy.md 是整个系统的记忆。所有复盘结论都写在这里,每次创作前主 Agent 会读它,每次复盘后会更新它。你也可以随时手动改。

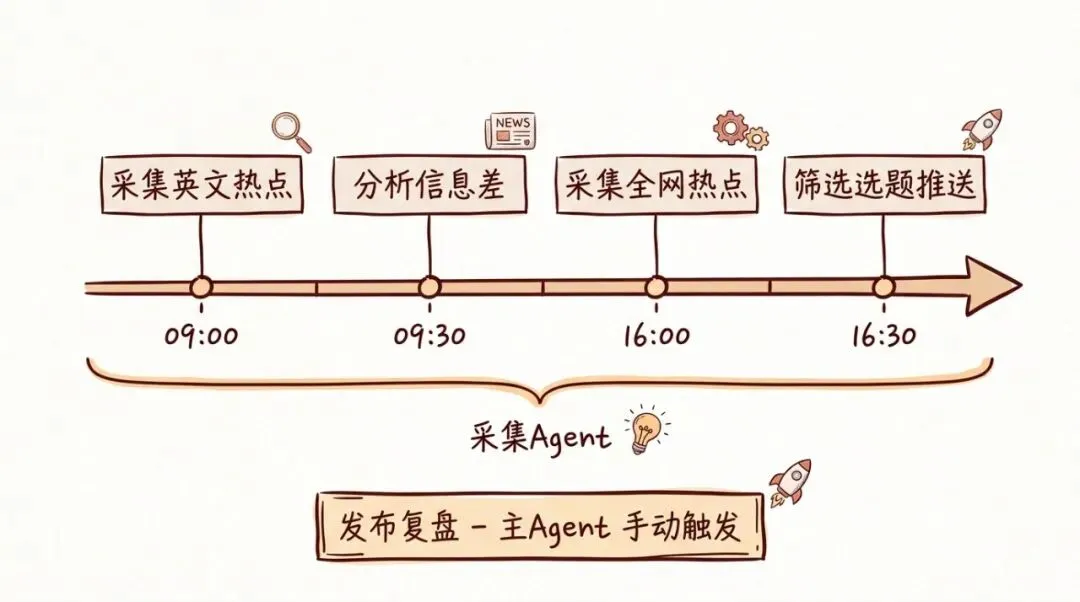

一天的时间线

- • 16:00 —— 采集 Agent 自动扫全网热点,存数据

- • 16:30 —— 主 Agent 读热点 + 策略文件,推 5-10 条选题到我手机

- • 我选一个 —— 说"就写这个",主 Agent 并行搜多个平台出调研报告

- • 我确认 —— 主 Agent 写初稿,推草稿箱

- • 我审核发布

- • 发布后 —— 主 Agent 采集各平台数据做复盘,结论写入策略文件

热点采集

采集 Agent 按平台逐个采集,成功就存数据,失败就跳过,最后汇总到一个文件。

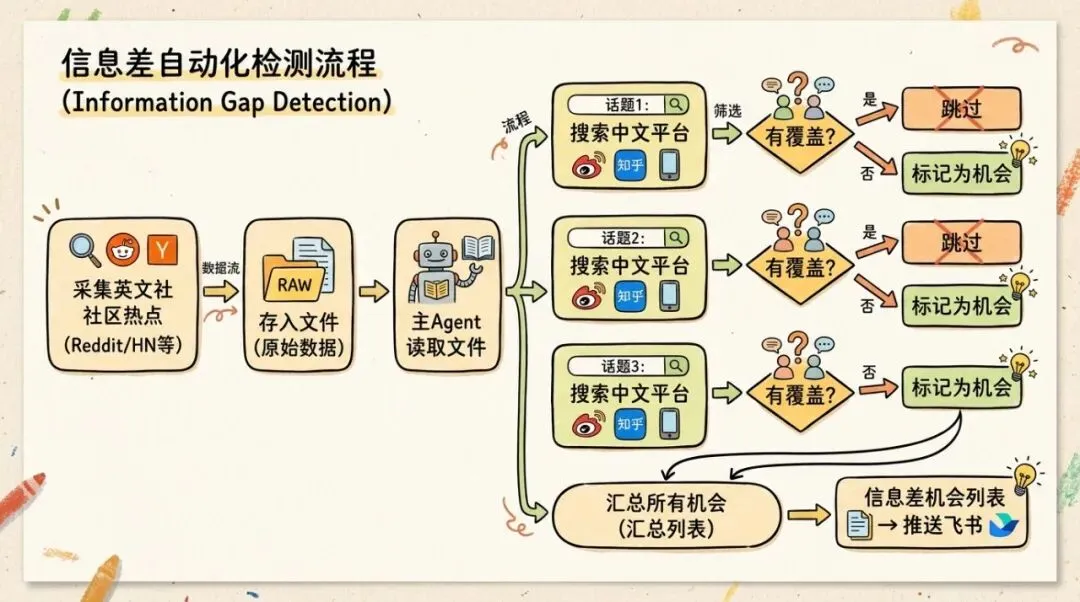

信息差检测

每天早上扫 Reddit、HN 等英文社区,主 Agent 拿着这些话题去搜中文平台,发现中文平台还没覆盖的话题就标记为机会。

选题筛选

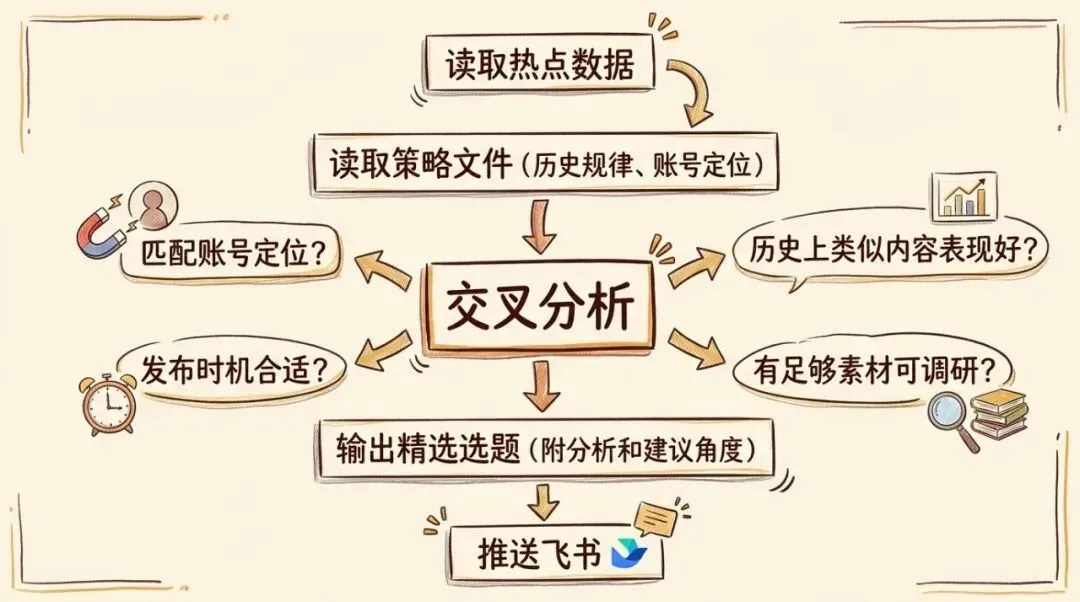

主 Agent 读热点数据 + strategy.md,交叉分析后推送选题建议。分析维度包括:是否匹配账号定位、历史上类似内容表现如何、发布时机是否合适、有没有足够素材可调研。

深度调研

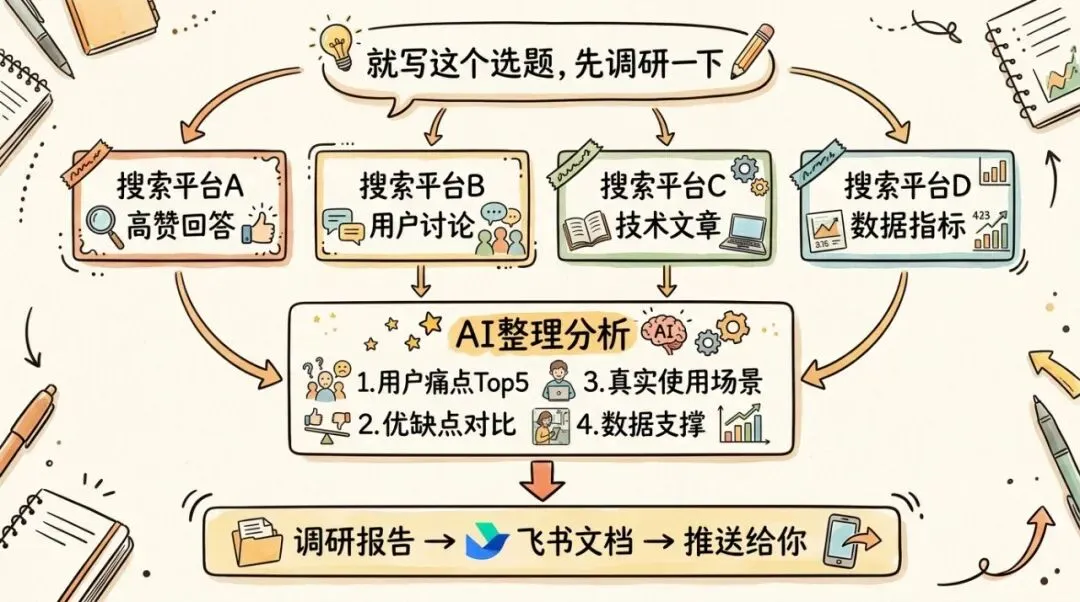

你说"就写这个,先调研一下",主 Agent 并行搜索多个平台,整理出调研报告。

发布复盘

发布后 AI 自动采集各平台公开数据,分析表现,结论写入 strategy.md,影响下一次选题。

完整运转流程

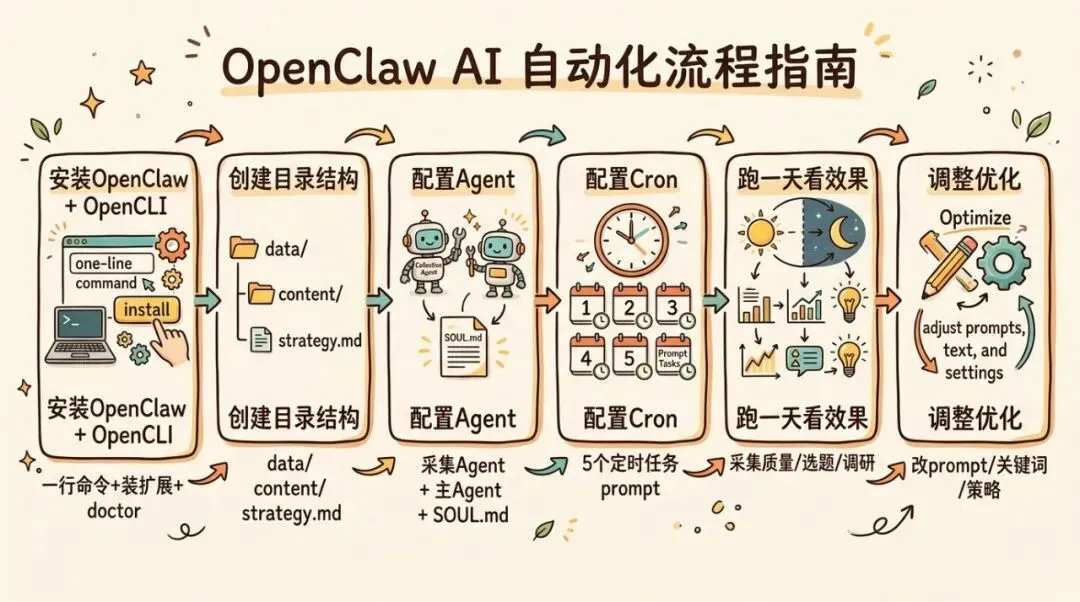

搭建过程

- 1. 装 OpenClaw + OpenCLI,一行命令,装扩展,跑 doctor 检查环境

- 2. 建目录结构,data/ 放采集数据,content/ 放创作内容,strategy.md 放策略

- 3. 配两个 Agent,采集 Agent 用廉价模型 + cron 定时任务,主 Agent 用强模型 + 完整配置

- 4. 配 cron 定时任务,英文热点采集(09:00)、信息差检测(09:30)、全网热点采集(16:00)、选题筛选推送(16:30)

- 5. 跑一天看效果,看采集质量、选题准不准、调研有没有用

- 6. 根据结果调,改 prompt、改关键词、改策略

最后

OpenClaw + OpenCLI 的组合,核心就一件事:把能自动化的执行环节交给 AI,人只留决策权。

夜雨聆风

夜雨聆风