从一个真实的问题说起

假设你已经深度依赖 AI 助手工作了一段时间,它能很好的帮你整理思路、写代码、做决策。

但有一天,你在外面,拿着手机,临时需要让 AI 帮你查一段代码、或者起草一封邮件。

你打开了 WhatsApp、Telegram 或者微信,习惯性地找"联系人"——然后愣住了:

你的 AI Agent,不在这里。

你能用的,要么是打开专属 App(ChatGPT、Claude.ai)——切换 App、重新找对话、丢失上下文;要么是把需求拷贝到剪贴板再粘贴过去——繁琐而割裂。

更麻烦的是,会话上下文无法跨设备同步——AI 像是"失忆"了,它不知道你"刚才在 WhatsApp 群里讨论了什么"。

这就是 OpenClaw 想要解决的核心问题:

如何让你的私人 AI Agent,真正住在你的消息渠道里,而不是住在某家公司的 App 里?

现有方案为什么解决不了这个问题?

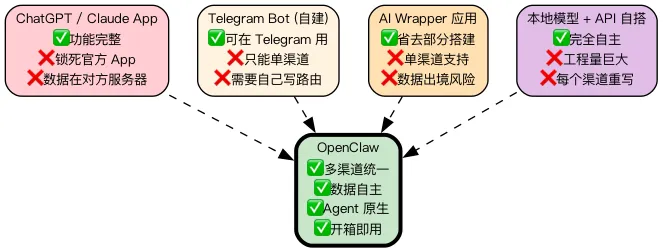

在讨论 OpenClaw 之前,先快速看看当前主流选项为什么都差一口气:

上面这些方案,本质上都是在特定层次上"有限解决"——要么牺牲渠道自由,要么牺牲数据自主,要么需要大量重复的工程投入。

OpenClaw 的切入点是:做一个统一的 Agent 消息网关层,把这三个问题一起解掉。

OpenClaw 的回答:自托管 AI Agent 消息网关

OpenClaw 是一个自托管的多渠道 AI Agent 消息网关(self-hosted multi-channel AI agent gateway)。

用最朴素的话说:

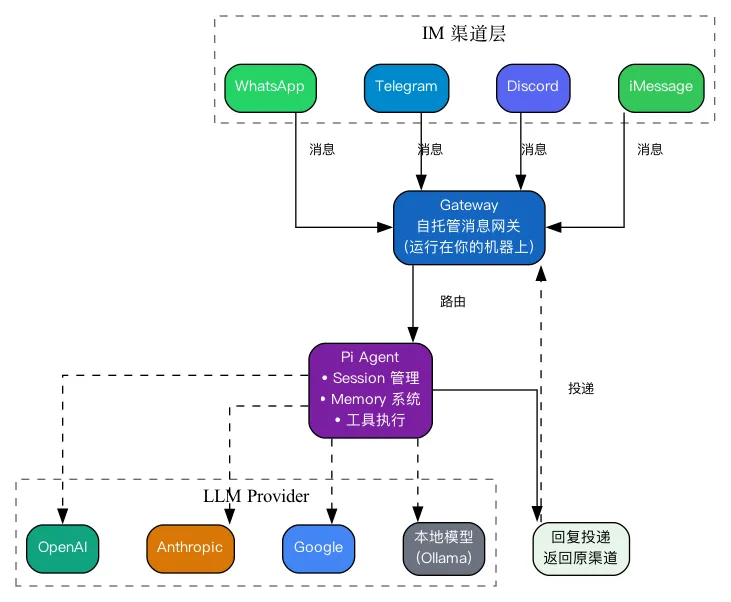

你在自己的机器(或服务器)上跑一个叫 Gateway 的进程。这个进程同时接上 WhatsApp、Telegram、Discord、iMessage 等你用的消息渠道。你在任何渠道发消息,AI Agent 都能收到并回复——就像你在给一个真实的联系人发消息一样。

下面是 OpenClaw 架构的最简示意:

整个链路的关键词是:你自己运行,数据不经过第三方服务,渠道随意接。

三个典型使用场景

场景 1:手机随时聊 Agent

你用 WhatsApp 或 Telegram 是日常习惯,不想为了"问 AI"专门切 App。OpenClaw 让你直接在这些 App 里和 AI Agent 对话,Session 全程保持,上下文不断线。

示例对话

用户(WhatsApp):"把刚才那个 Python 脚本里读取 CSV 的部分改成用 pandas 实现。"

Agent:"好的,我找到了你昨天在电脑上创建的

data_loader.py,已修改并保存。需要我把改动发给你吗?"

场景 2:群组里让 Agent 参与

你有一个工作用的 Discord 频道或 Telegram 群。你希望群组成员能通过 @机器人名 触发 AI 助手——OpenClaw 的群组 Mention 路由机制正是为此而生。不同群甚至可以路由到不同的 Agent(不同人设、不同工具权限)。

示例对话

用户(Discord 群组):"@Agent 帮我查一下为什么 Nginx 返回 502"

Agent:"已检查日志,发现是后端 PHP-FPM 进程数不足导致。当前配置

pm.max_children = 5,建议增加到 15。需要我帮你修改配置并重启吗?"

场景 3:个人知识库 + 多渠道统一入口

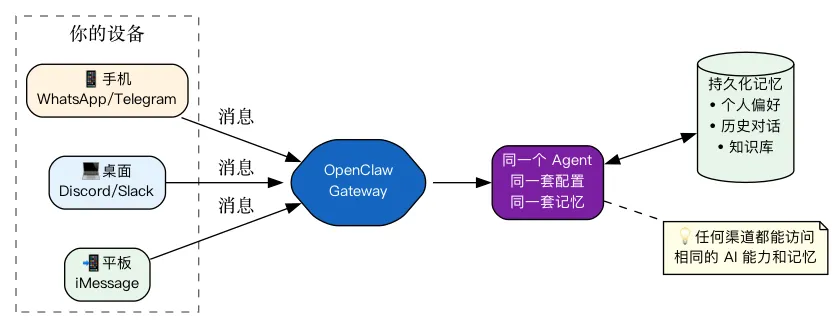

你有精心维护的 Agent 配置(workspace、SOUL.md、工具权限),这套配置定义了你的个人 AI 助手的行为方式。OpenClaw 让这套配置在所有渠道上一致生效——WhatsApp 里的对话和 Telegram 里的对话,访问的是同一个 Agent、同一套记忆。

示例对话

用户(Telegram):"上周关于项目 A 的会议纪要里有哪些关键结论?"

Agent:"检索到 3 份相关文档。关键结论:1) 产品上线时间定在 Q3;2) 需要增加两名前端开发;3) API 接口设计需重新评审。需要我发送完整纪要吗?"

社区真实用例:OpenClaw 正在解决哪些具体问题?

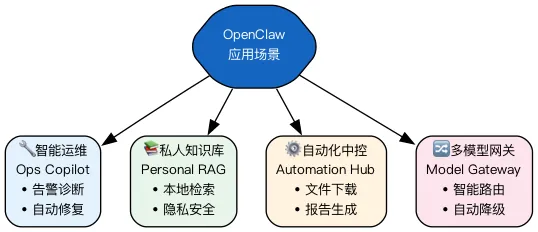

OpenClaw 的价值远不止"聊天"。根据当前社区的使用反馈,它正在被广泛应用于以下四个高价值领域:

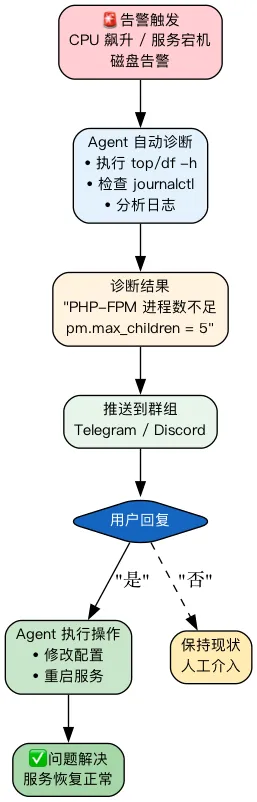

1. 智能运维(Ops Copilot)

背景:很多开发者、运维人员使用 Telegram 或 Discord 作为团队沟通工具。当服务器出现异常时,通常需要登录服务器执行命令,或等待告警系统发送通知,再手动处理。

OpenClaw 方案:将 OpenClaw 接入群组,AI Agent 常驻后台。当 CPU 飙升、磁盘告警或服务宕机时,Agent 可以:

自动执行诊断命令( top、df -h、journalctl -n 50)将关键日志和错误信息直接推送到群组 询问用户"是否需要重启服务?",用户回复"是",Agent 直接执行重启 真正实现 7x24 小时在线,从"被动告警"变为"主动诊断 + 半自动化处理"

典型提问:"帮我查一下为什么 Nginx 返回 502" → Agent 自动检查日志、服务状态,返回分析结果。

2. 私人知识库助手(Personal RAG)

背景:许多人拥有大量的本地文档、笔记、电子书,但难以快速检索。使用公有云服务(如 ChatGPT 上传文件)存在数据隐私顾虑。

OpenClaw 方案:将 OpenClaw 与本地向量数据库结合,构建一个"住在 IM 里的第二大脑":

所有文档、笔记存储在本地,AI 通过嵌入模型检索相关内容 在 WhatsApp/Telegram 中直接提问,如"上周关于项目 A 的会议纪要里有哪些关键结论?" Agent 检索本地文件后,直接回复摘要或发送文件 数据完全不出境,隐私安全有保障

3. 自动化中控(Automation Hub)

背景:很多重复性任务(下载文件、整理资料、发送报告)需要手动操作,或者需要编写复杂的脚本。

OpenClaw 方案:利用 OpenClaw 内置的 Shell 执行能力,将自然语言转换为自动化动作:

家庭场景:在 Telegram 发"下载最新一期的播客",Agent 自动调用 yt-dlp 下载音频,完成后推送文件到手机 工作场景:在群里 @Agent 说"生成本周销售周报",Agent 从数据库查询数据,调用 Pandas 生成图表,将 PDF 发送到群组 开发场景:"给当前 Git 仓库打 tag v1.2.3 并推送到远程" → Agent 自动执行 git 命令

4. 多模型统一网关(Model Gateway)

背景:重度 AI 用户可能同时使用 OpenAI、Claude、Gemini 以及本地 Ollama 模型,不同模型各有优势,但 API 不兼容,手动切换麻烦。

OpenClaw 方案:OpenClaw 作为智能路由层,根据规则自动选择最优模型:

长文本任务(>100k tokens)自动走 Claude 简单问答(如"今天天气")走本地便宜模型 当某个 API 限流或故障时,自动降级到备用模型 用户无感知,始终保持服务可用性

核心差异点

相比"找个现成的 AI 产品用",OpenClaw 的四个本质差异:

1. 自托管,数据自主

Gateway 运行在你自己的机器上。消息在你的机器上被处理,再转发给 LLM Provider(OpenAI/Anthropic 等)。整个路径中,没有第三方中间服务持久化你的对话内容。

对于处理敏感信息(代码、商业决策、个人隐私)的用户,这一点至关重要。

2. 多渠道,一个进程

一个 Gateway 进程,同时桥接 WhatsApp、Telegram、Discord、iMessage 以及更多(通过插件扩展:Mattermost、Matrix、Feishu、Slack 等)。

你不需要为每个渠道单独维护一套 Bot 逻辑——OpenClaw 把渠道差异抹平为统一的消息抽象。

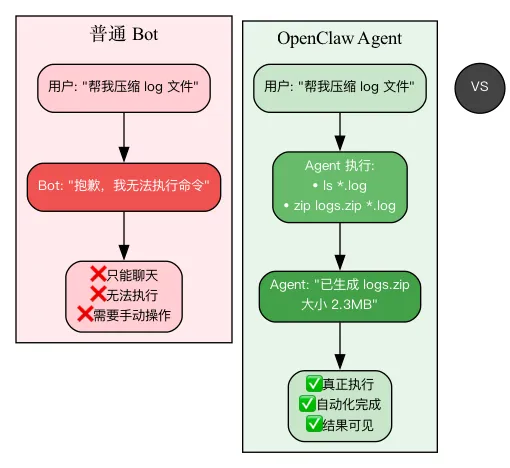

3. Agent 原生,不是 Chatbot 包装

OpenClaw 的核心不是"把 ChatGPT API 包一层",而是内置完整的 Agent 运行时(Pi Agent):

Session 管理:每次对话有独立的持久化上下文,不会"每次都从零开始" Memory 系统:跨 Session 的持久化知识,AI 能记住你的偏好、背景信息 工具执行:文件读写、Shell 命令、浏览器自动化、Web 搜索——AI 不只是聊天,它可以干活 多 Agent 路由:不同渠道/群组可以路由到配置和能力完全不同的 Agent

这正是 OpenClaw 区别于普通 Bot 的关键——它不只是"回复消息",而是真正"执行任务"。对比一下:

4. MIT 开源,社区驱动

OpenClaw 完全开源(MIT 协议),代码透明可审计。社区持续贡献新渠道支持、工具扩展、Skill 技能包。

适合谁?

OpenClaw 适合:

开发者:有能力在本机或服务器运行 Node.js 服务,想要高度可定制的 AI 助手 高级用户 / Power User:已经在用多个 IM 工具,希望统一 AI 入口 团队内部使用者:在公司/团队的 Discord/Slack/Mattermost 里部署私有 AI 助手 AI 实验者:想深度定制 Agent 行为(workspace、prompt、工具权限、Skill),不满足于开箱即用的 AI 产品

典型用户画像:目前 OpenClaw 的用户包括独立开发者用它作为个人运维助手、小团队用它来共享 AI 知识库、技术博主用它搭建自己的 AI 工作流。

不适合谁?(能力边界)

以下情况,OpenClaw 可能不是最好的选择:

不愿维护服务的普通用户:OpenClaw 需要你自己运行一个服务进程,并维护其稳定性(重启、升级、排查故障)。如果你只想"用 AI"而不想"维护 AI",直接使用 ChatGPT 或 Claude.ai 更合适。 期望它"更聪明"的用户:OpenClaw 本身不提升 AI 的推理能力,它的价值在于"接入"和"路由"——AI 有多聪明,取决于你选的模型,与 OpenClaw 无关。 需要企业级 SLA 的场景:OpenClaw 是社区开源项目,没有商业支持,生产可用性由你自己保障。 期望零配置开箱即用:首次启动需要配置 API Key、渠道认证等。虽然 Onboarding Wizard 大幅简化了流程,但仍需要一定的技术操作能力。

一句话总结

OpenClaw 不是更好的 AI,而是让你的 AI 真正属于你——住在你的消息渠道里,跑在你的机器上,记住你想让它记住的,做你想让它做的事。

夜雨聆风

夜雨聆风