本文字数 2133,阅读大约需 4 分钟

不知道大家有没有过这样的感受。

在 YouTube 上订阅了好几十个频道,涵盖 AI、效率工具、科技资讯等各个方向。

这些博主的更新频率不一样,有的日更,有的周更,有的半个月才出一期。

如果只是偶尔上去刷一刷,在算法推荐下很容易就错过某个博主的新视频。等过几天想起来去翻,发现人家三天前就更新了,而自己压根没看到。

这件事困扰了我很久,所以我一直在想,有没有一种办法,能把我关注的这些频道的更新,集中输出到一个地方。

这样我只需要每天看一个地方,就能对所有人的动态一目了然。

不靠算法推荐,完全由自己说了算。

而有了 Openclaw 之后,这个想法总算落地了。

我现在就是用 OpenClaw ➕ Notion 搭了一套自动化的信息流工作流,彻底解决了这个问题。

这篇文章就来聊聊我是怎么做的,以及背后一些关于「信息流」的思考。

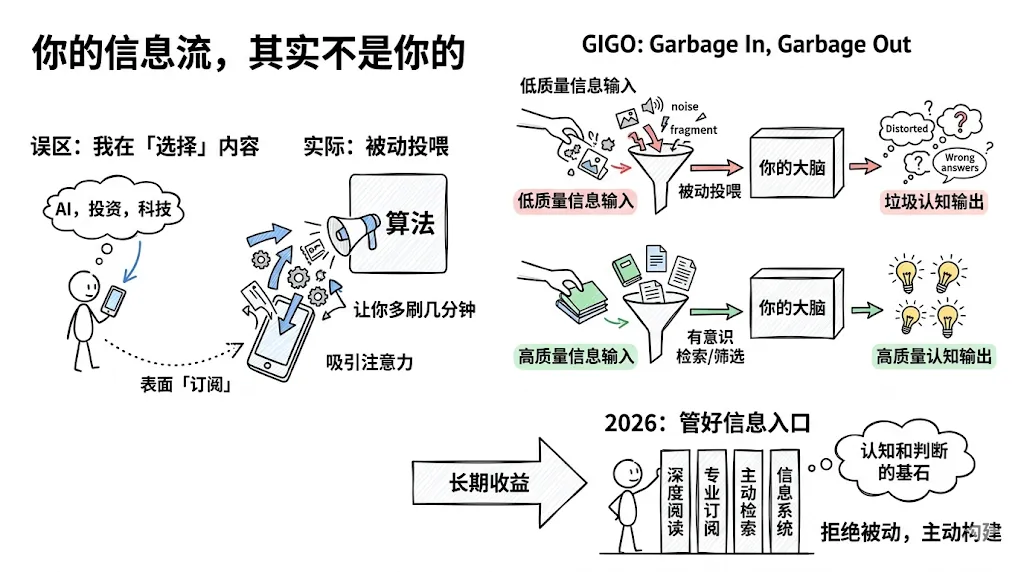

你的信息流,其实不是你的

我们每天打开手机,刷到的内容,看似是自己「选择」的,实际上大部分是算法替你选的。

算法的目标很简单:让你停留更久。

它不关心你订阅了谁,也不关心你真正需要什么。

它只关心什么内容能让你多刷几分钟,所以你会发现,首页推荐里永远充斥着最能吸引你注意力的内容。

这就导致了一个很隐蔽的问题:你以为自己在主动获取信息,其实一直在被动投喂。

而被投喂的信息质量如何,直接影响的是你的认知和判断。

计算机领域有一个经典原则叫 GIGO,Garbage In, Garbage Out。垃圾进,垃圾出。

这个原则放到日常信息摄入上同样成立:每天输入什么质量的信息,最终就会输出什么质量的认知和判断。

反过来讲,如果能有意识地把信息入口的质量提上去,这件事带来的长期收益,我个人是觉得很大的。

这也是我为什么想要去搭建出一套信息获取方案,管好自己的信息入口,在 2026 年,应该是一件值得认真对待的事。

用 OpenClaw 做 AI 简报,为什么效果不好?

说到主动获取信息,就不得不提 OpenClaw 小龙虾 🦞。

自从有了 OpenClaw 之后,很多人会用它做的一件事,就是获取每日 AI 简报。类似于让它帮你整理一下今天 AI 领域发生了哪些大事,有什么值得关注的动态。

想法很好,但只要实际用过的人,应该都有一个体感:出来的内容,良莠不齐。 看着好像每条都挺有道理,但就是经不起细看,没办法真正拿来做深度消化。

问题出在哪?

不在 OpenClaw 本身,而在于给它的信息来源。

如果没有指定高质量的信息源,它就只能从全网去抓,抓到什么算什么。而全网的信息质量,大家心里都有数。

所以,想用 OpenClaw 解决信息获取的问题,第一步不是研究怎么写提示词,而是先给它一个靠谱的信息源。

YouTube 就是一个很好的选择。

YouTube 上的长视频内容,信息密度普遍比碎片化资讯高不少。更重要的是,那些自己长期关注的、经过筛选的优质频道,本身已经帮你做了一轮过滤。

我的方案:OpenClaw + Notion + YouTube

基于这个思路,我搭建了一套自动化的信息流获取工作流。

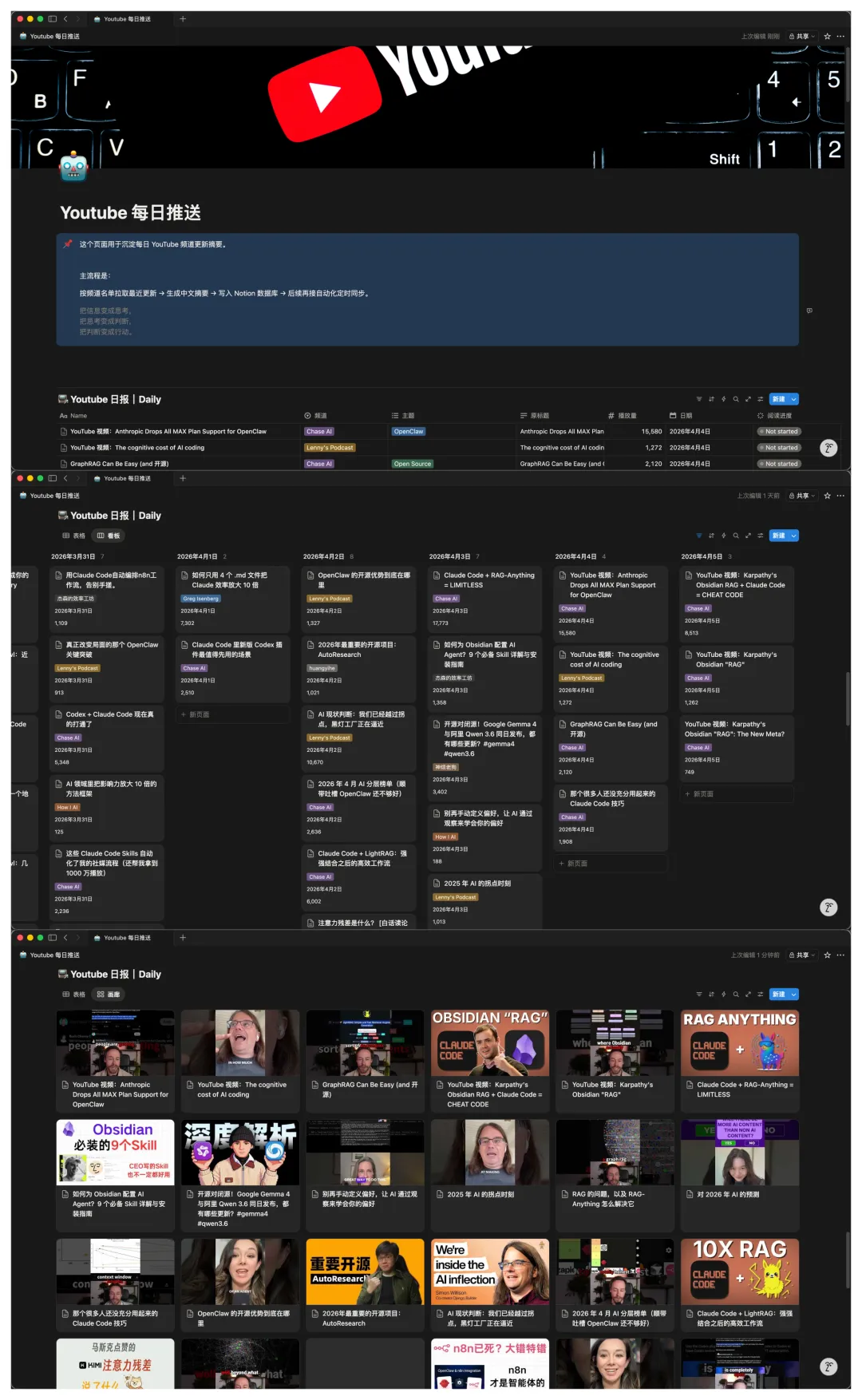

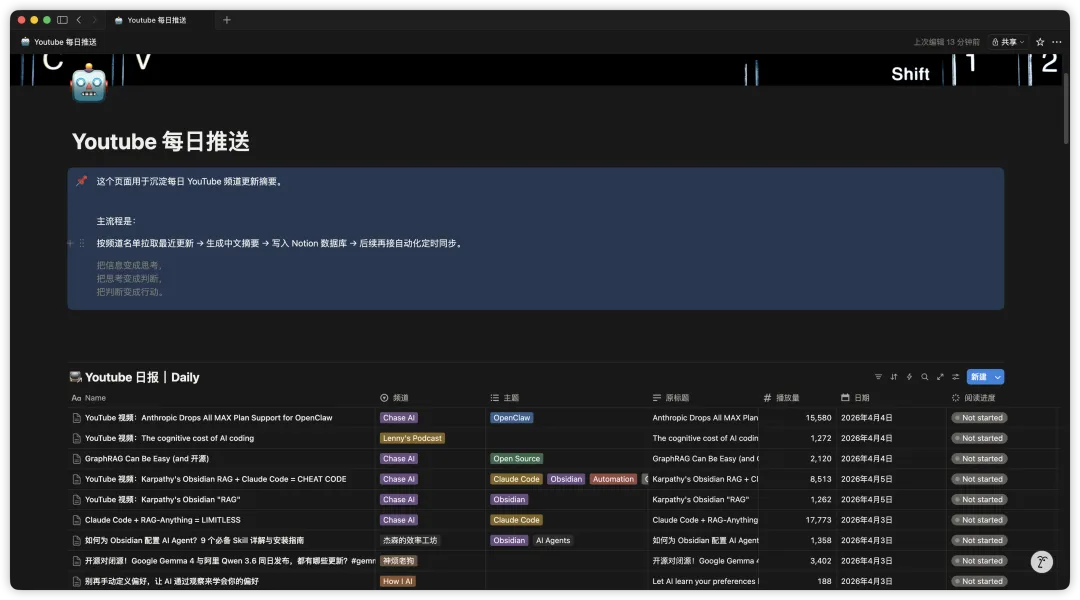

整体思路很简单:让 OpenClaw 每天定时从我关注的 YouTube 频道抓取最新视频,自动提取关键内容和摘要,然后统一写入 Notion。

这样,我每天只需要打开 Notion 看一眼,就能对所有关注博主的最新动态一目了然。不用打开 YouTube,不用被算法干扰,也不用担心遗漏。

下面说一下具体的实现步骤。

第一步:安装 YouTube Skills

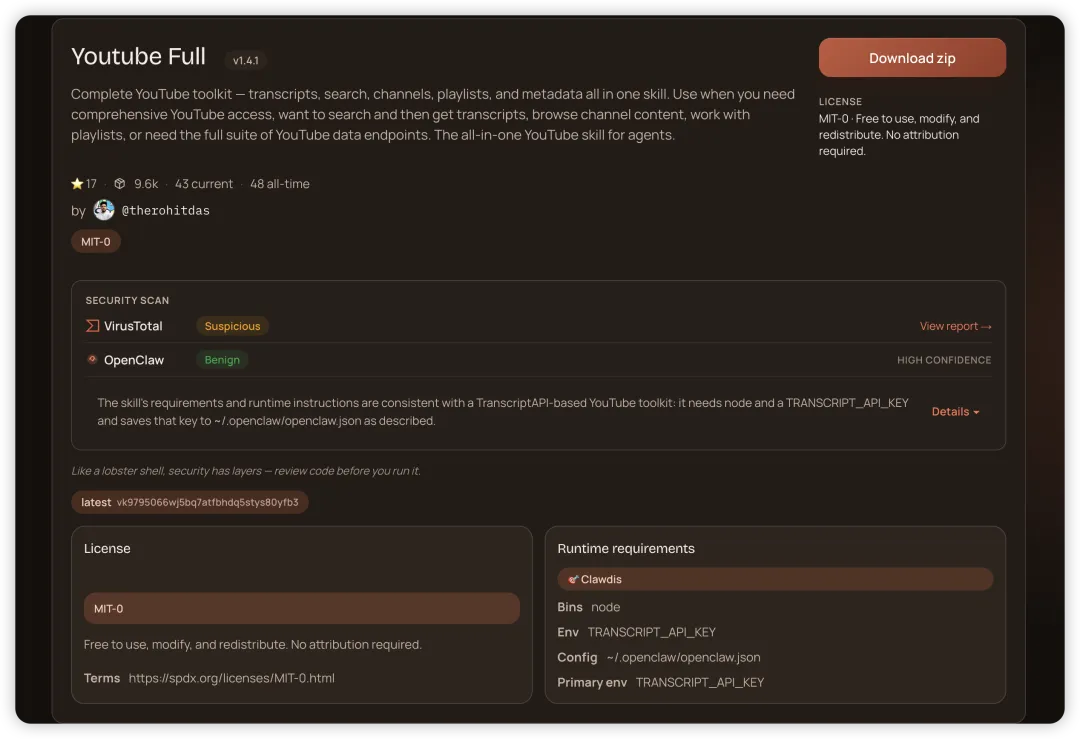

ClawHub 社区有一个现成的 YouTube Skill(youtube-full https://clawhub.ai/therohitdas/youtube-full),可以通过指定的频道获取最新视频,并自动提取字幕生成摘要。

安装方式很简单,在 OpenClaw 里说一句「帮我安装并配置好这个 skill https://clawhub.ai/therohitdas/youtube-full」就行,它会自动搞定安装和配置。

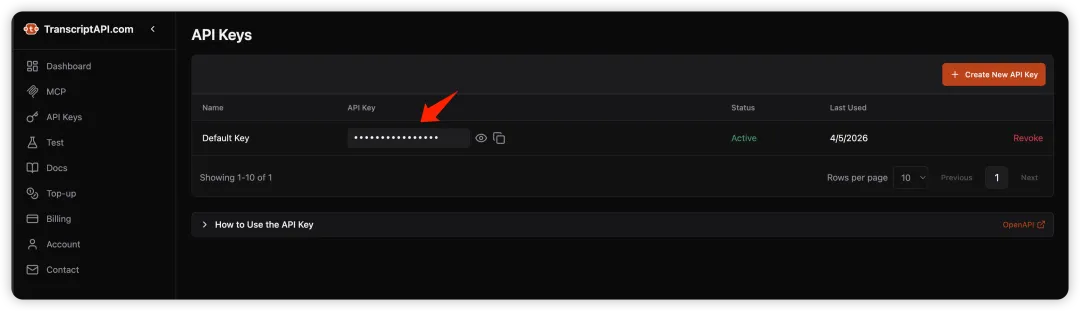

第二步:注册并绑定 TranscriptAPI 账号

这个 Skills 依赖 TranscriptAPI 来获取 YouTube 视频更新信息。

所以需要先注册一个 TranscriptAPI 账号,地址在这里 👉 https://transcriptapi.com/

注册后会有 100 个免费额度,不需要绑信用卡。而且查询频道最新视频列表这个操作本身是免费的,只有获取视频转录文本才消耗额度,每次 1 个。

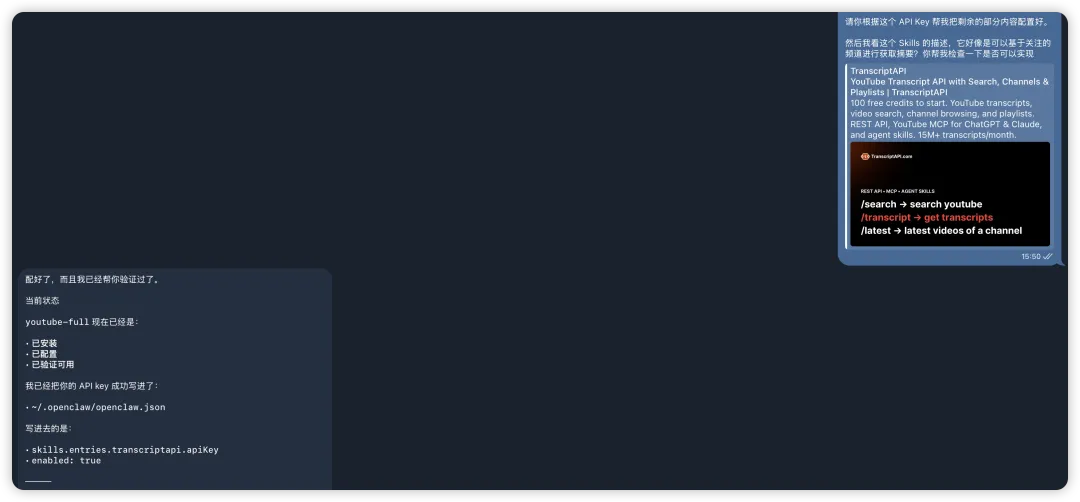

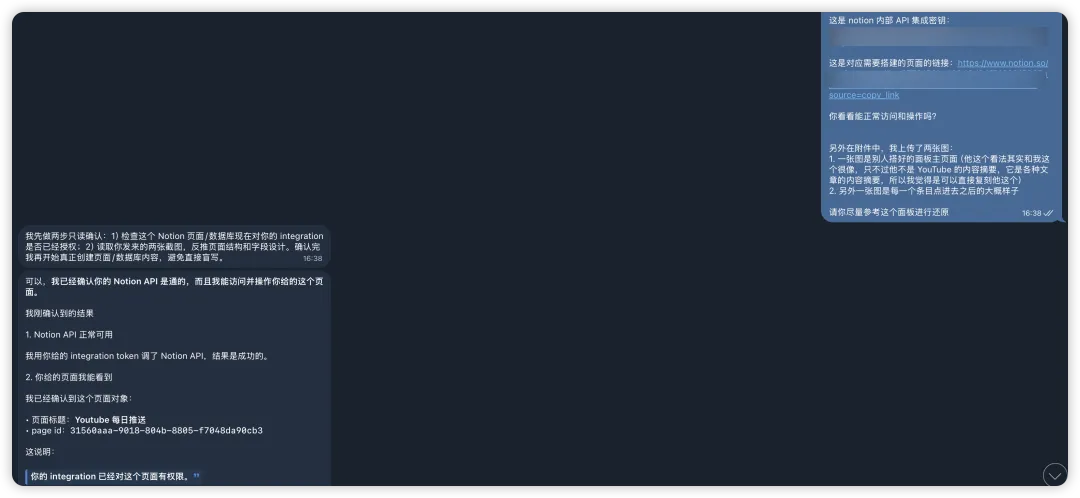

在 TranscriptAPI 后台拿到 API Key。

发给 Openclaw 自行进行配置。

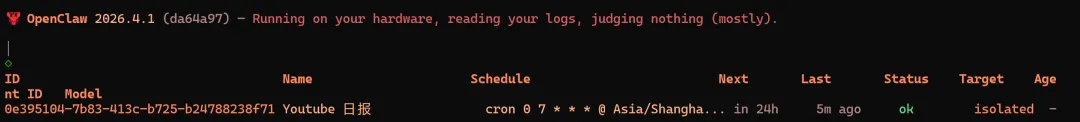

第三步:设置定时任务

在 OpenClaw 里配置一个定时任务。

我设置的是每天早上 7 点,自动获取过去 24 小时内我提供的关注列表里所有博主的更新视频,并提取关键信息。

你可以根据自己的习惯调整时间和频率。

第四步:自动写入 Notion

拿到结果后,OpenClaw 会直接把内容写入我指定的 Notion 页面。

每条记录包含视频标题、频道名称、视频链接、核心要点摘要等信息,自动归档到 Notion 数据库里。

当然,写入之前,需要在 Notion 中创建好对应的页面,而这个过程,也可以交给 Openclaw,让它去搞定。

Notion 提供了免费的 API Key,写入不花一分钱。

整套流程跑下来,除了模型,额外成本为零。

为什么选择 Notion,而不是 Telegram?

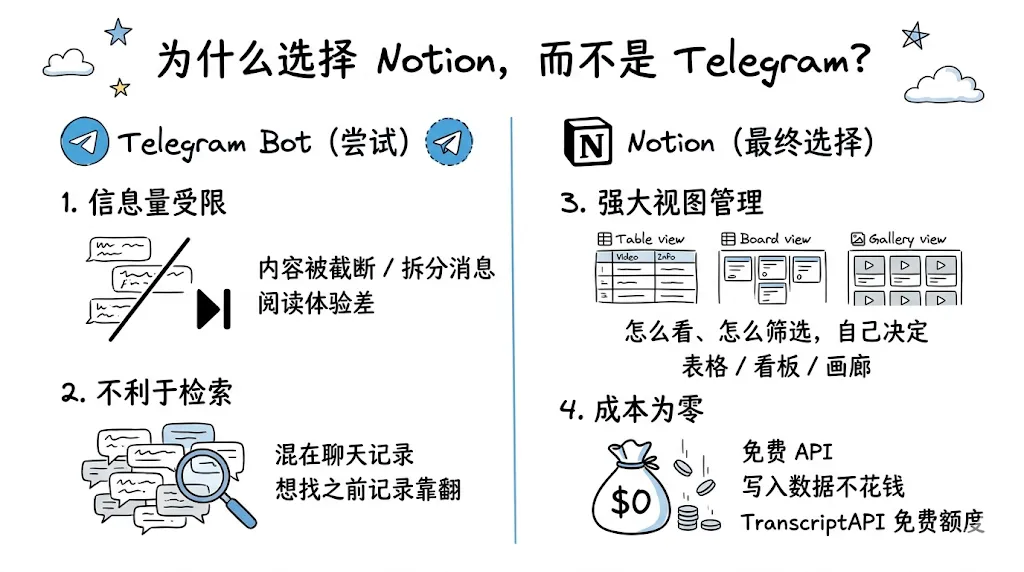

有人可能会问,为什么不直接把结果推送到 Telegram?

我最早其实试过 Telegram Bot,但实际用下来发现几个问题:

1、Telegram 单次输出的信息量有限。 如果当天更新的视频比较多,内容会被截断或者拆成好几条消息,阅读体验很差。

2、不利于后续检索。 所有信息都混在聊天记录里,想找之前某一天的某条记录,基本靠翻。

3、Notion 的视图管理能力强太多了。 同一份数据,可以用表格视图快速浏览,也可以切换成看板视图按频道分类,还能用画廊视图做成卡片式的展示。

怎么看、怎么筛选,完全由自己决定。

4、成本为零。 Notion 提供免费的 API,写入数据不花钱。加上 TranscriptAPI 的免费额度,整个工作流搭建下来,不需要给第三方充值。

写在最后

这套工作流做的事情其实很简单:把信息获取的主动权,从平台的推荐算法手里拿回来。

我自己决定关注谁,自己决定看什么,然后让工具帮我把这些内容汇总到一个地方。

但它带来的改变是持续的,每天的信息摄入,不再取决于某个算法认为你「可能感兴趣」的东西,而是取决于自己的判断和选择。

在这个注意力被各种平台反复争夺的时代,提高自己的信息输入质量,这件事,值得认真对待。

以上,就是本文全部内容,如果觉得这篇文章对你有启发,点赞、比心、分享三连就是对我最大的支持,谢谢~

• 用 Gemini 解锁 YouTube 新用法,信息获取效率提升 10 倍

• 有了 NotebookLM 后,还需要 Obsidian 吗?

• 我试了 NotebookLM 学习法后,彻底抛弃传统学习方式

• 我用 NotebookLM 解锁 PPT 的 5 种玩法,实现了 PPT 自由

夜雨聆风

夜雨聆风