人工智能正面临着巨大的能源消耗挑战。这种持续增长的能源需求体现在支撑AI繁荣的数据中心产生的巨大碳足迹,以及前沿AI模型训练所产生的碳排放量随时间稳步增加。

。

~

难怪大型科技公司开始青睐核能,设想一个由可靠、无碳能源支撑的未来。但是,虽然核动力数据中心可能还需要数年时间才能实现,研究和工业领域的一些人正在立即采取行动来抑制AI不断增长的能源需求。他们正在解决训练这一模型生命周期中最耗能的阶段之一,重点关注去中心化。

利用分布式网络重新定义AI训练

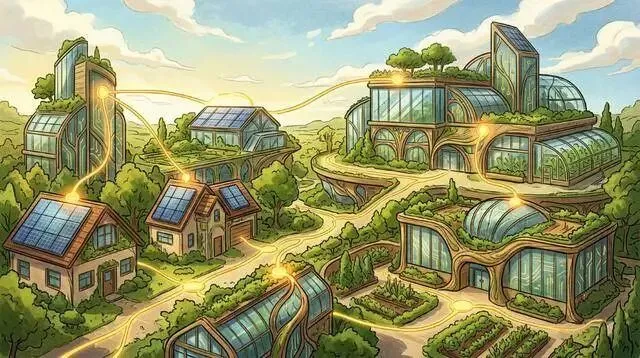

去中心化将模型训练分配到独立节点网络中,而不是依赖单一平台或提供商。它让计算能力可以去到能源所在的地方——无论是坐落在研究实验室中的闲置服务器,还是太阳能供电家庭中的计算机。去中心化不是建造更多需要电网扩大基础设施和容量的数据中心,而是利用现有来源的能源,避免增加更多电力消耗。

训练AI模型是一项巨大的数据中心运动,需要在紧密连接的GPU集群间同步进行。但随着硬件改进难以跟上大语言模型规模的快速增长,即使是大规模的单一数据中心也不再够用。

科技公司正转向多个数据中心的集合力量——无论其位置如何。例如,英伟达推出了Spectrum-XGS以太网用于跨规模网络,它"可以为跨地理分离数据中心的大规模单一作业AI训练和推理提供所需的性能"。同样,思科推出了其8223路由器,旨在"连接地理分散的AI集群"。

其他公司正在挖掘服务器中的闲置计算资源,催生了GPU即服务业务模式的兴起。以Akash网络为例,这是一个点对点云计算市场,自称为"数据中心的Airbnb"。那些在办公室和较小数据中心拥有未使用或使用不足GPU的人注册为提供商,而那些需要计算能力的人被视为租户,可以在提供商中选择并租用他们的GPU。

Akash联合创始人兼首席执行官Greg Osuri表示:"如果你看看今天的AI训练,它非常依赖最新最好的GPU。幸运的是,世界正在转型,从仅依赖大型高密度GPU转向现在考虑较小的GPU。"

算法创新支撑分布式学习

除了协调硬件外,去中心化AI训练还需要在软件方面进行算法更改。这就是联邦学习——一种分布式机器学习形式——发挥作用的地方。

它从驻留在可信实体(如中央服务器)中的全局AI模型的初始版本开始。麻省理工学院计算机科学与人工智能实验室(CSAIL)首席研究科学家、去中心化信息小组负责人Lalana Kagal解释说,服务器将模型分发给参与组织,这些组织在本地数据上训练模型,并仅与可信实体共享模型权重。然后,可信实体聚合权重(通常通过平均),将它们集成到全局模型中,并将更新的模型发送回参与者。这种协作训练循环重复进行,直到模型被认为完全训练完成。

但分布数据和计算也有缺点。例如,模型权重的持续来回交换导致高通信成本。容错是另一个问题。

Osuri说:"AI的一个重大问题是每个训练步骤都不具备容错性。这意味着如果一个节点宕机,你必须重新恢复整个批次。"

为了克服这些障碍,谷歌DeepMind的研究人员开发了DiLoCo,一种分布式低通信优化算法。DiLoCo形成了谷歌DeepMind研究科学家Arthur Douillard所称的"计算岛",每个岛由一组芯片组成。每个岛持有不同的芯片类型,但岛内的芯片必须是同一类型。岛之间彼此解耦,它们之间的知识同步偶尔发生。这种解耦意味着岛可以独立执行训练步骤而不需要经常通信,芯片可以故障而不必中断剩余的健康芯片。然而,团队的实验发现在八个岛之后性能递减。

夜雨聆风

夜雨聆风