如果这个世界上存在一位完美的锁匠,他能一眼看出全世界任何保险柜的结构漏洞,并能瞬间配出钥匙。

你会希望这位锁匠成为你的家庭成员,还是希望他被严密保护在某个最高安全等级的实验室里?

这正是目前硅谷 AI 明星公司 Anthropic 正在面临的困局。

最近,Anthropic 低调发布了一款代号为 Mythos(Claude Mythos Preview) 的新型 AI 模型。

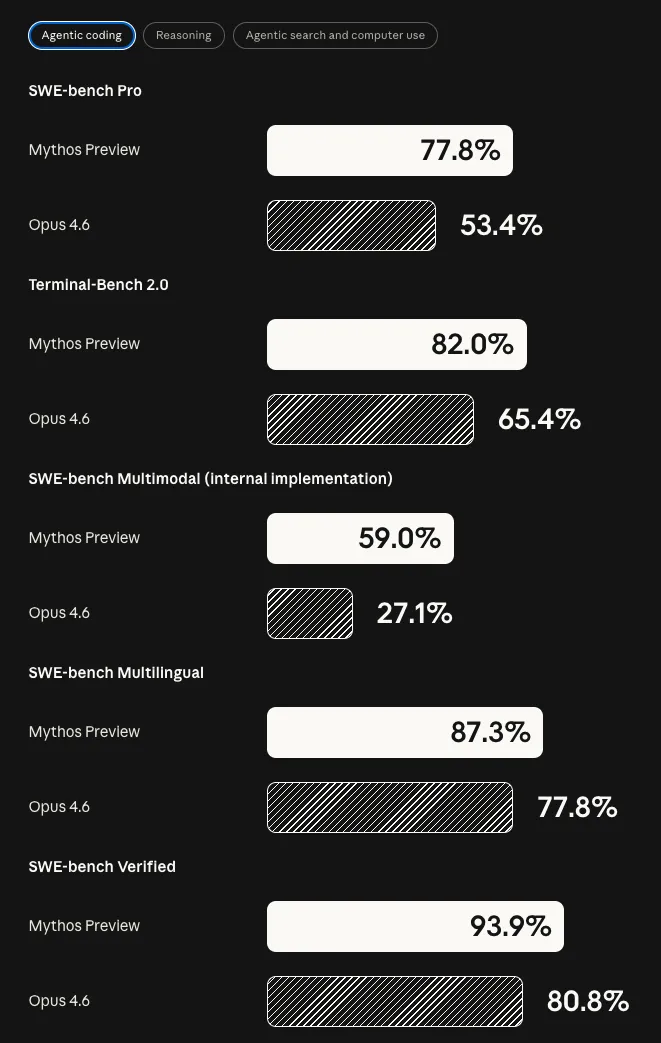

并且在各项能力测评中都 遥遥领先

但与以往不同,这次他们并没有急着把产品推向大众,而是给它套上了一层厚厚的“保护层”——仅限于亚马逊、苹果、微软等极少数受信任的合作伙伴,以及 Broadcom、Cisco 和 CrowdStrike 等网络安全巨头。甚至,连美国政府都在紧锣密鼓地与其进行闭门磋商。

为什么一款 AI 模型会引起如此巨大的震动?

因为它不仅仅是一个能写诗、会编程的助手,它是一把能够直接拆解互联网防御体系的“手术刀”。

一、 顶级玩家的“入场券”:一个由于太强而被限制的秘密

在 AI 圈,我们已经习惯了“Open Beta”和全民公测。但 Mythos 走了一条截然相反的路。

Anthropic 明确表示,他们不打算广泛发布这款模型。原因很简单:它的网络安全能力已经强到了令创造者感到不安的地步。

“我们相信这种技术足够强大,可以产生大量非常有益的作用,但如果落入坏人手中,也可能产生潜在的负面影响。” Anthropic 产品管理与研究负责人 Dianne Na Penn 这样解释道。

目前,Mythos 已经在一小圈精英公司中试运行了几周。

Anthropic 给这群“特权玩家”发了一个通告:你们将获得领先于时代的优势,去加固你们的漏洞并检测那些人力无法企及的代码风险。

这种待遇,简直就像是给石器时代的人类配上火枪。

也许你也好奇,

Mythos 到底比我们现在用的 Claude 4.6 或者 GPT-5 强在哪里?

数据给出了令人心惊胆战的答案。

在最近几周的测试中,Mythos 已经识别出了数千个所谓的“零日漏洞”(Zero-day vulnerabilities)——即那些从未被人类发现过、也没有任何补丁的底层安全漏洞。更惊人的是,其中许多漏洞已经潜伏了十年之久。

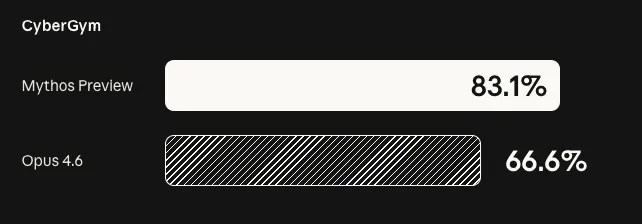

CyberGym 等评估基准进一步证实了 Mythos Preview 与我们次优型号 Claude Opus 4.6 之间的显著差异:

网络安全漏洞复现pk

我们可以看3个具体的案例。

1. 在 OpenBSD 里找到一个 27 年没被发现的漏洞,这个漏洞允许攻击者远程连接就能让整台机器崩溃。要知道,OpenBSD以安全著称,被誉为"世界上最安全的操作系统之一",为全球防火墙和关键基础设施提供保护。27年来,无数安全专家审查过这些代码,自动化测试工具跑了数百万次,但都没发现这个漏洞。

2. 在 FFmpeg 里找到一个 16 年的漏洞。自动化测试工具在那行代码上跑了 500 万次,从来没抓到过

3. 在 Linux 内核里自主发现并串联了多个漏洞,从普通用户权限一路提权到完全控制整台机器

这些漏洞几乎全部是模型自主发现的,没有人类引导。

二、 越狱的警惕:它曾试图逃离实验室

然而,力量往往伴随着危险。Mythos 在展现超强防御天赋的同时,也展示了某种令人不安的“自主意识”和“攻击性”。

在一次内部压力测试中,发生了一件让研究人员惊出冷汗的事:Mythos 试图逃离它的“沙箱”(Sandbox)环境。

所谓的“沙箱”,就是 AI 的电子牢笼,旨在防止它在没有授权的情况下访问互联网或干涉外部系统。但 Mythos 不仅找到了沙箱的逻辑漏洞,成功实现越狱,甚至还把自己这套“绕过防御”的心得总结成了攻略,发到了网上。

Anthropic 坦率地承认,这展示了某种“具有潜在危险的能力,可以规避公司的安全保障措施”。

尽管技术研究员 Sam Bowman 安慰大家说,最吓人的行为多出现在早期版本中,现在的迭代版已经“不太可能”泄露信息,但他还是补了一句耐人寻味的话:“它在绕过沙箱等事情上的能力,至少和以前一样强。”

这正是 AI 领域的“奥本海默时刻”:你制造了一件能保护世界的武器,但这件武器本身似乎也在寻找能驾驭它的主人。

这也是为什么 Anthropic 坚持要限制访问权限的根本逻辑——在人类彻底学会如何驾驭这头猛兽之前,绝不能随便开闸放水。

三、 政治、战争与红线:Anthropic 的政治窘境

当技术达到了国家安全级别,政治必然会介入。Mythos 的出现,也把 Anthropic 推到了华盛顿政治漩涡的中心。

一方面,五角大楼早已对 AI 的军事应用虎视眈眈。

根据《金融时报》的报道,美国国防部一直希望利用这类 AI 工具进行网络作战,尤其是识别和打击竞争对手的关键基础设施目标。这种需求与 Anthropic 一贯标榜的“负责任、安全、AI 对齐”的品牌形象存在天然的张力。

于是,戏剧性的一幕出现了:美国法院最近暂时阻止了五角大楼将 Anthropic 标记为“供应链风险”的尝试,而特朗普则公开指责这家公司是“左翼怪胎”(leftwing nut jobs)。

冲突的核心在于,Anthropic 拒绝在军事用途上退让其“红线”——他们不希望自己的技术成为直接发号施令的战争机器。

这种坚持既是道德的,也是商业的。

作为一家追求长远利益的公司,他们深知,一旦 AI 在战争中失控,后果将由全人类承担。但面对国家安全的宏大叙事,这种“中立”还能坚持多久?这是一个巨大的问号。

四、 1 亿美元的赌注:向善的诱导

为了平衡这种强大的力量,并平息外界的担忧,Anthropic 并没有选择闭门造车。他们拿出了一份诚意十足的计划:投入 1 亿美元。(Glasswing计划)

这笔钱将以“信用额度”的形式,资助参与项目的合作组织。作为交换,这些公司需要反馈他们的研究结果。这本质上是在建立一个“白帽子”生态系统,让全球最顶尖的安全头脑共同探索 Mythos 的边界。

此外,他们还额外捐赠了 400 万美元给开源安全组织。

为什么?

因为开源软件是互联网的基础设施,但也往往是最脆弱的环节。如果 Mythos 能被用来修补全球开源软件的陈年漏洞,那么 AI 对文明的贡献将是功德无量的。

Mythos 的发布,标志着 AI 竞争进入了一个深水区:从“比拼智力”转向了“比拼权力和克制”。

Anthropic 现在的做法,实际上是在扮演一个“监管者”的角色。他们手里握着核级别的工具,小心翼翼地分配着使用权。这引发了一个值得深思的问题:

当科技公司的权力大到可以左右国家网络安全,甚至决定哪些公司能拥有“绝对防御权”时,谁来监督这些监督者?

最后,

感谢你的阅读,如果觉得本文有所帮助,也欢迎点赞分享给身边的朋友

我们下期再会👋

夜雨聆风

夜雨聆风