论文题目:A Unified Foundation Model for All-in-One Multi-Modal Remote Sensing Image Restoration and Fusion with Language Prompting

论文链接:https://arxiv.org/pdf/2604.05629

论文代码:https://github.com/yc-cui/LLaRS

核心矛盾:遥感图像退化五花八门:有云遮、有雾霾、有噪声、有条带、分辨率不够、传感器不匹配……传统做法是每个问题训练一个专用模型,像“头痛医头、脚痛医脚”。

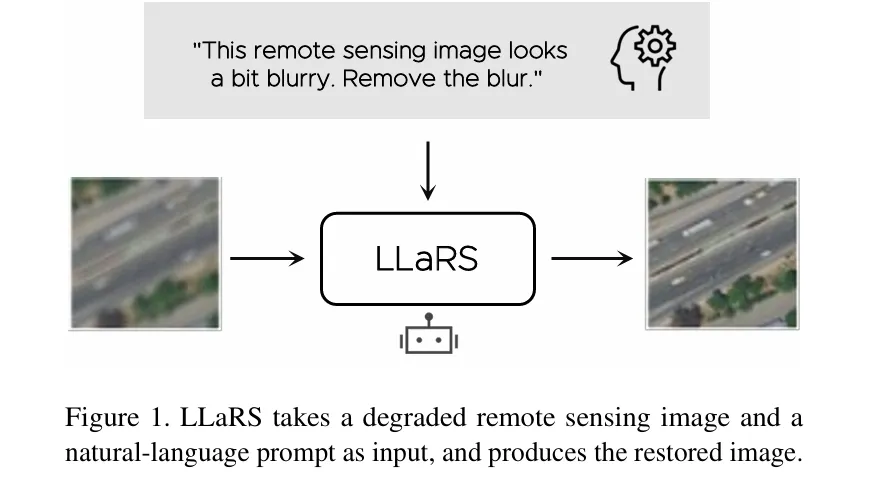

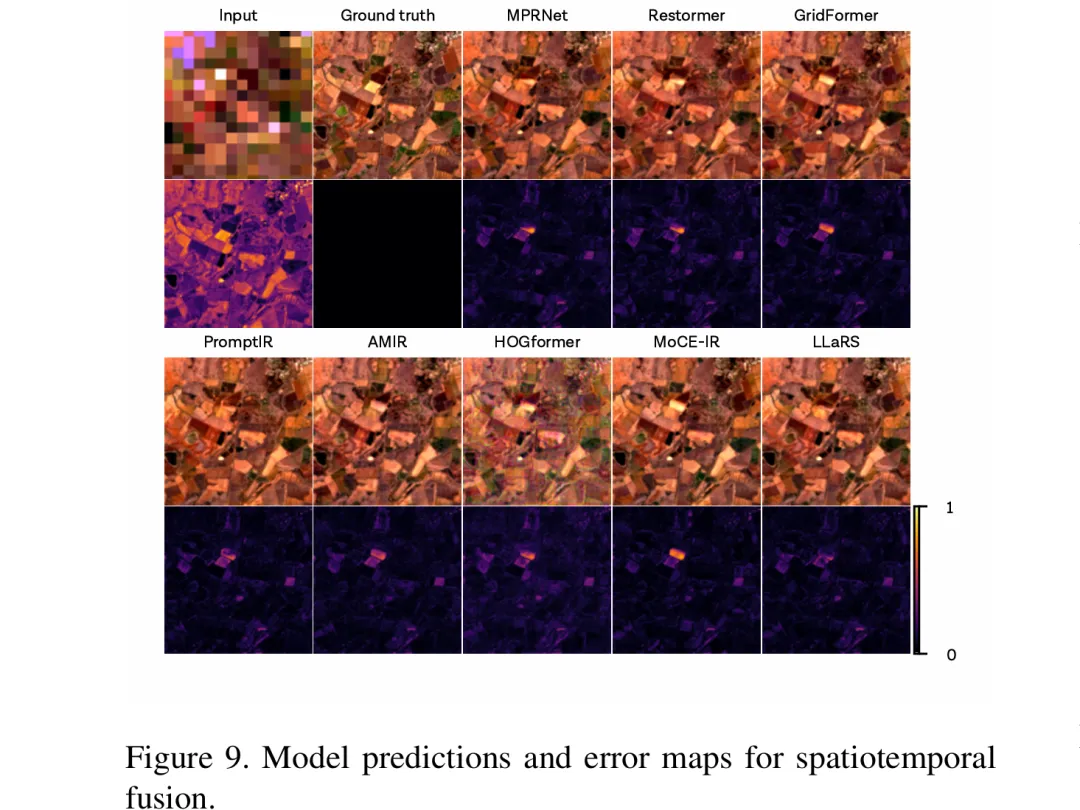

新思路:中科院空天信息创新研究院的研究团队提出LLaRS:一个统一的遥感图像修复基础模型。只需要给模型一张退化图像,再配一句自然语言指令(比如“把云去掉”或“提高分辨率”),就能自动理解任务类型并输出修复结果。在11个修复任务上全面超越7个强基线,且参数高效微调只需调整不到5%的参数就能逼近全量微调效果。

一、核心

遥感图像退化五花八门:有云遮、有雾霾、有噪声、有条带、分辨率不够、传感器不匹配……传统做法是每个问题训练一个专用模型,像“头痛医头、脚痛医脚”。结果就是代码库越堆越多,数据集越分越散,换个任务就得从头开始。

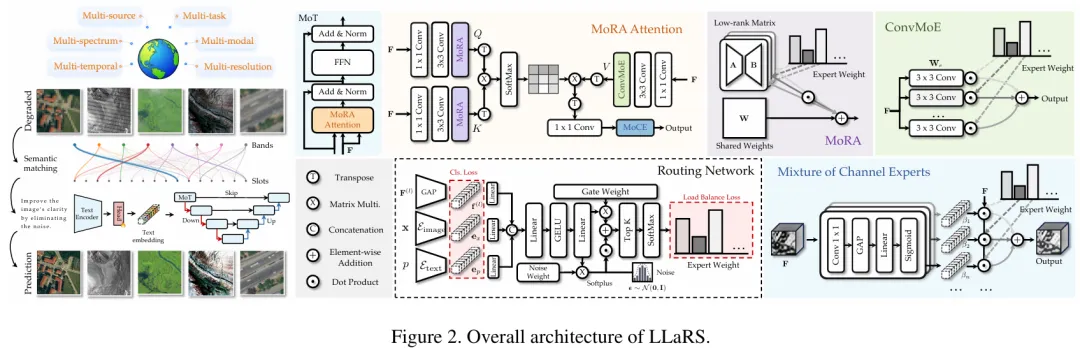

研究团队提出了 LLaRS,一个统一的遥感图像修复基础模型。核心设计有三板斧:

- 语言条件化路由:用户输入的文本提示和退化图像一起编码,动态决定激活哪些“专家模块”。去云和去噪走的是不同计算路径,互不干扰。

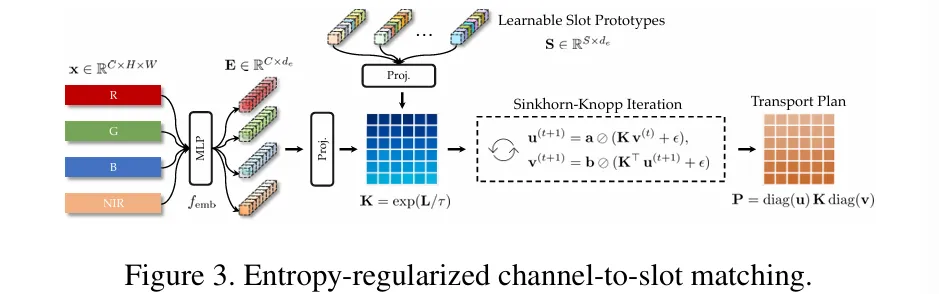

- 最优传输对齐异构波段:不同卫星传感器的波段数量和物理意义各不相同(有的4波段RGB+NIR,有的8波段多光谱)。LLaRS用Sinkhorn-Knopp最优运输算法,将任意通道数的输入软匹配到32个可学习的“语义槽位”上,让下游网络看到的是语义一致的通道,而不是混乱的原始索引。

- 三类专家互补 + 动态权重调整:卷积专家抓空间纹理,通道专家保光谱fidelity,注意力专家(带LoRA低秩适配)建模全局上下文。三者通过任务路由权重融合,且用前向动态权重调整替代传统的梯度操作,解决11个任务联合训练时的梯度竞争问题。

二、亮点

- 自然语言作为统一接口:让模型“听懂”任务

传统多任务模型要么用隐式条件向量(难以解释),要么用任务ID硬编码(不灵活)。LLaRS直接用自然语言:测试时写“Clear the clouds from this satellite image”,模型就知道该走云去除路径;写“Increase the image's resolution”,就走超分路径。研究团队做了t-SNE可视化:不同任务的提示词在嵌入空间中形成紧凑且分离的簇——云去除和去雾虽然语义相近但依然可分,超分和全色锐化因为共享“分辨率”词汇而自然靠近。 - 最优传输做波段对齐:让异构传感器“说同一种语言”

初始化32个可学习的“槽位原型”,每个槽位在训练中逐渐学会代表某类光谱特征。用Sinkhorn迭代求解通道→槽位的最优运输问题,强制每个通道和每个槽位都有“责任”。实验中也展示了训练过程中的对齐演化:初期分配还比较分散,中期开始按任务类型聚团,晚期稳定成清晰的task-specific模式。 - 融合版MoE:专家虽多,计算不爆炸

LLaRS在U-Net的每个阶段嵌入了三类MoE模块。关键技巧在于:专家的权重在路由层就融合了,而不是分别计算再加权求和。ConvMoE:多个卷积核按路由权重线性组合成一个等效卷积核,计算量≈单次卷积。MoCE:多个通道注意力向量加权融合成一个向量。MoRA用LoRA的低秩适配器模拟不同专家的Q/K偏移。 - 动态权重调整:不反向传播也能平衡多任务

多任务联合训练的老大难:去雾收敛快但去云慢,如果等权重,模型会偷懒只学简单的。梯度类方法需要每个任务单独反向传播,11个任务就是11倍显存。LLaRS的DWA策略只在前向计算:记录每个任务的EMA损失,计算当前损失相对于EMA的比值r_m——r越大说明任务越“停滞”,就给更高权重。 - 参数高效微调:不到0.25%参数就能超越基线

在4个模型上对比BitFit、LoRA、DoRA、Adapter、SSF。LLaRS在只训练0.22%参数(SSF方法,约184K参数)时,平均性能已超过Restormer全量微调。这意味着LLaRS可以作为基础模型,下游用户只需极低成本就能适配到自己的特定传感器或地理区域。

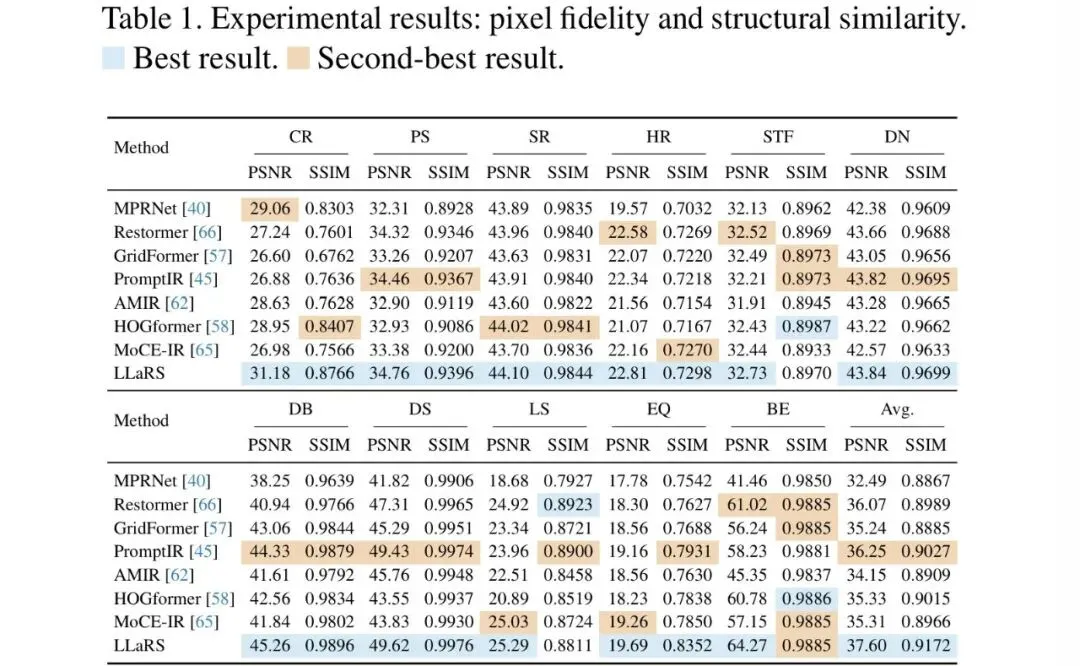

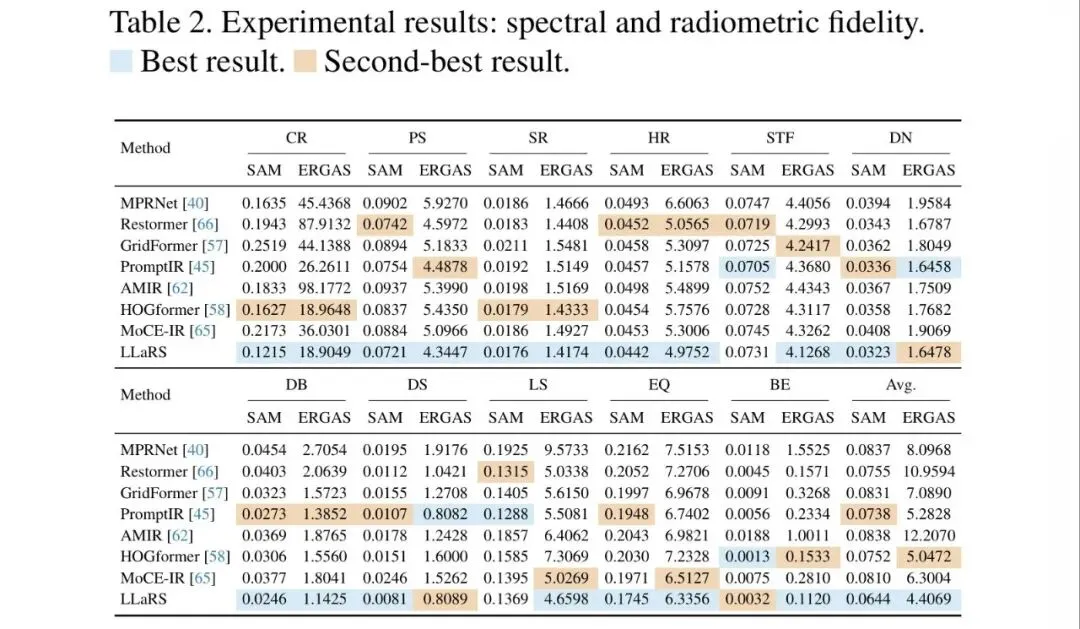

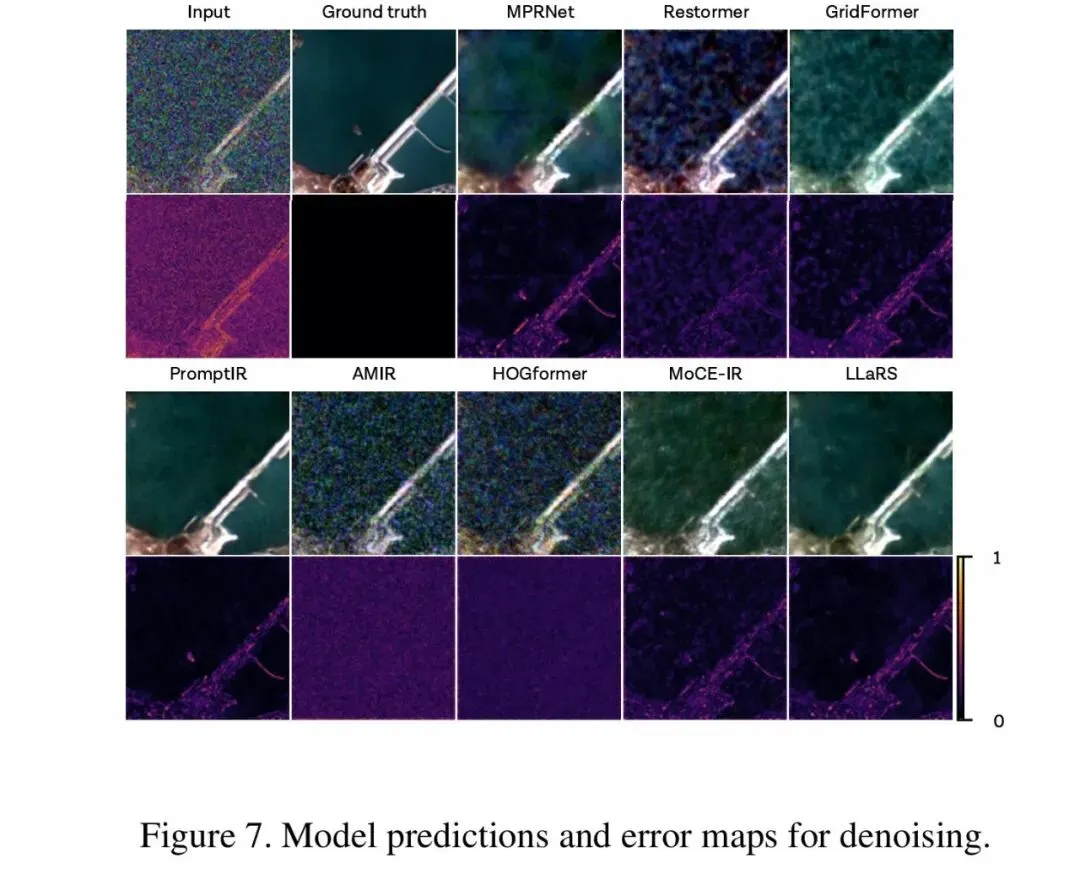

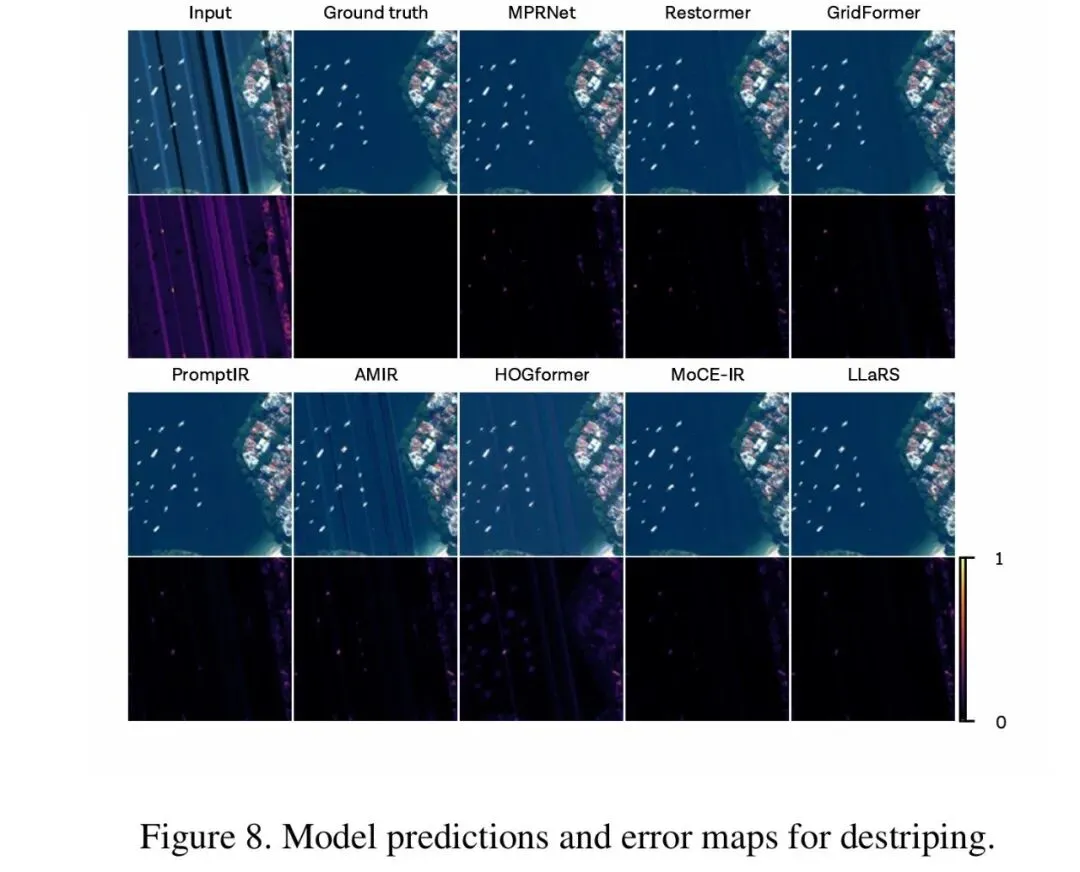

三、实验表现

更多图表和详细数据请参阅原论文。

四、美中不足

- 推理延迟偏高

—— 虽然FLOPs控制得不错,但实际A100上推理耗时比Restormer和PromptIR慢。原因是动态路由引入了不规则的内存访问模式,GPU的并行优势被削弱了。对实时性要求高的场景(如灾害快速响应),可能需要蒸馏成更确定的网络。 - 最优运输的近似性质

—— Sinkhorn迭代在log空间做数值稳定,但理论上是近似解(有限次迭代)。虽然8次迭代在实践中够用,但当通道数极端不均时(如SAR单通道 vs 多光谱8通道),分配矩阵的稀疏性可能不够理想。 - 生成式缺失信息恢复能力有限

—— LLaRS目前是重建式模型:对于云遮挡区域,它通过邻近像素和跨模态信息来“填补”,但当云层完全覆盖且无SAR辅助时,恢复效果会下降。论文的结论中提到了这一点,指出未来可以探索扩散模型做生成式修复。 - 任务覆盖仍有盲区

—— 虽然号称11个任务,但主要是光学影像内部的各种退化。SAR影像只出现在去斑点和作为云去除的辅助输入,没有涵盖SAR的几何校正、辐射定标等专属修复任务。另外,热红外、高光谱等特殊模态也未涉及。

五、启发

这篇工作让我看到一种值得借鉴的设计哲学:用“语义对齐”替代“格式统一”。以往做多源遥感融合,第一反应是把所有数据resample到相同分辨率和波段数,然后用同一个backbone硬啃。但LLaRS换了个思路——用最优运输做软对齐,让网络自己去学“哪个通道对应什么语义”,而不是强行把异质数据压成同质。这种思路对多源、多尺度、多时相融合任务都有迁移价值。

另外,前向动态权重这个小技巧很实用。很多做多任务学习第一反应就是上PCGrad或CAGrad,但11个任务的反向传播确实扛不住。DWA用损失比值做启发式权重,虽没有理论最优性保证,但在工程上足够好用且零额外显存——这种“务实”的选择值得推广。

最后,自然语言作为任务接口正在成为遥感基础模型的新趋势。LLaRS证明了在低层视觉(像素级修复)上,语言提示同样能有效路由。未来如果能和视觉-语言模型(如GeoRSCLIP)结合,或许能实现“用户画个圈、说句话,模型就知道要修什么”的更智能交互。

📚 参考文献

[1] Yongchuan Cui, Peng Liu. A Unified Foundation Model for All-in-One Multi-Modal Remote Sensing Image Restoration and Fusion with Language Prompting. , 2026.

免责声明:本文内容基于个人理解,并结合AI辅助整理而成。由于个人分析能力有限,文中观点仅代表个人见解,仅供参考。如有疏漏或不足之处,敬请谅解。论文版权归原期刊或出版方所有,本账号不提供全文下载服务。如发现任何版权问题,请及时联系,将尽快处理。第三方如需转载,请保持内容完整并注明出处。对于第三方内容的准确性及其转载行为的合法性,本账号不承担任何责任。

夜雨聆风

夜雨聆风