Engramme的内存API现已正式进入公测阶段,该API基于一种全新的AI架构,而非传统的Transformer模型。这种架构旨在为应用程序提供持久的人类记忆,无需用户进行任何搜索或提示。

Engramme利用了大型记忆模型(Large Memory Models),承诺几乎零幻觉。这些模型能够无缝集成到Gmail、Zoom、Slack以及Meta眼镜等常用应用中。这意味着用户可以自动记住所有电子邮件、联系人和对话,无需主动搜索或提示。

想象一下未来,你能够记住一切。

从每一封电子邮件到每一次对话,Engramme的愿景是赋予人类完美的无限记忆。所有记忆都会自动呈现给你,不再需要费力搜索或提示。

这种技术的应用场景非常广泛,例如在商务会议中自动记录关键信息,或者在日常生活中帮助用户记住重要的个人事项。Engramme的技术不仅提升了用户体验,还为未来的智能助手提供了强大的支持。

Engramme的推出标志着AI技术在记忆领域的重大突破,有望改变人们与数字信息互动的方式。

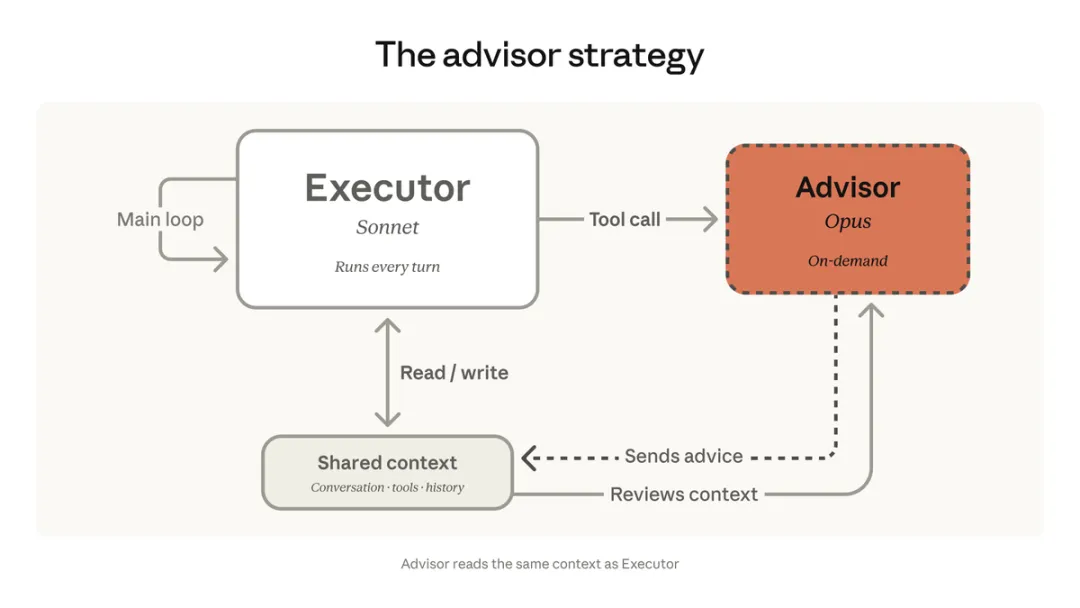

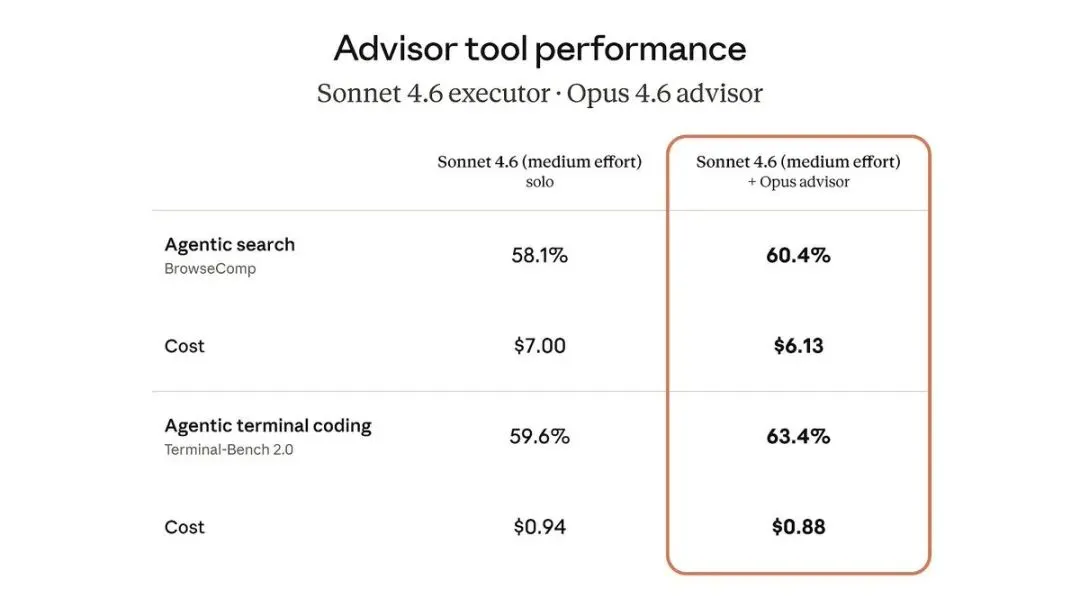

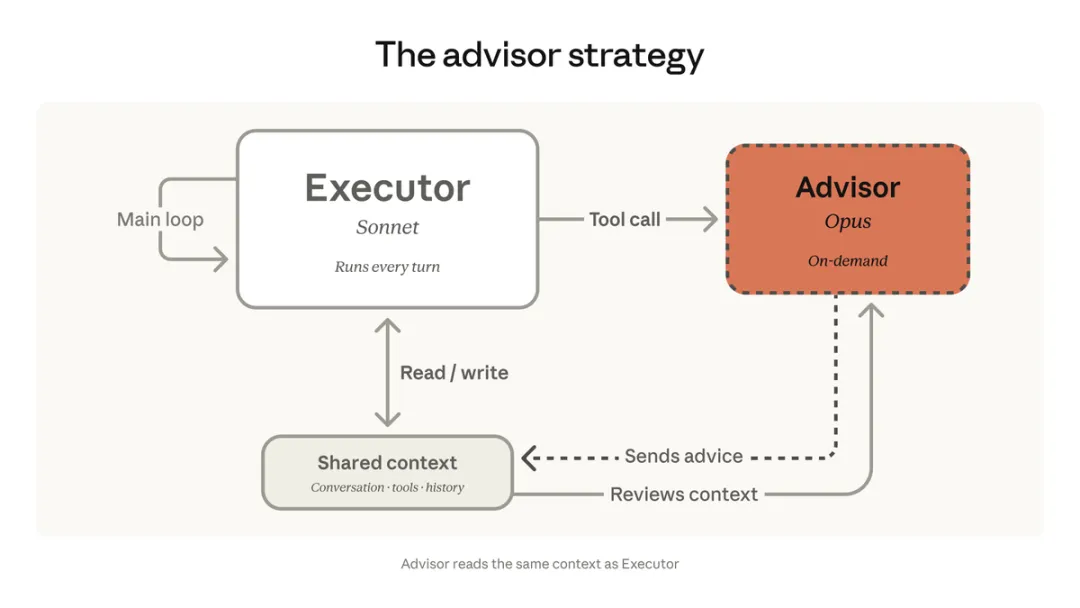

Anthropic推出了一项名为“顾问工具”(advisor tool)的新API功能,其核心思路是让成本较低的模型执行主要任务,在遇到难题时请教更昂贵的模型。具体来说,Sonnet或Haiku作为执行者全程处理任务、调用工具并处理结果。当这些模型遇到无法解决的问题时,它们会将上下文传递给更为强大的Opus模型,后者提供解决方案或纠正错误。

这种模式与传统的“大模型拆任务、小模型干活”的方式相反。以前是由大模型负责拆分任务,分配给小模型执行;而现在则是小模型独立运行,仅在关键节点向大模型寻求帮助。这种方式的好处在于大部分计算资源消耗在成本较低的模型上,而昂贵的模型只在必要时使用。

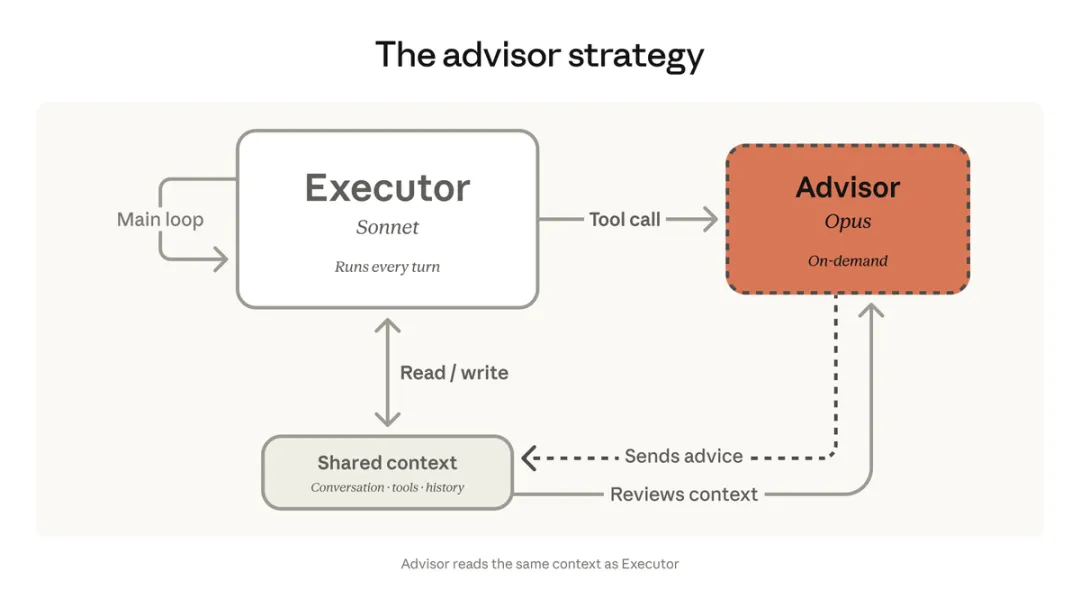

测试结果显示,Sonnet配Opus顾问在SWE-bench多语言测试上的表现比单独使用Sonnet提高了2.7个百分点,同时每个任务的成本降低了11.9%。此外,Haiku在搭配Opus顾问后,其在BrowseComp测试中的得分从19.7%提升至41.2%,尽管分数仍低于Sonnet单干的结果,但成本仅为Sonnet的15%,适合处理大量但对智能要求不高的任务。

开发者可以通过在Messages API的tools中添加一个advisor_20260301类型来启用此功能,单个API请求即可完成模型切换,无需额外管理上下文或多次调用。可以设置max_uses参数以控制每次请求最多咨询几次顾问,账单中会分别列出顾问和执行者的Token费用。

这项新功能为开发者提供了新的性价比选择,使他们能够在低成本模型的价格优势和高性能模型的智能之间找到平衡。目前该功能处于beta阶段,需要添加特定的请求头才能使用。

Claude平台即将推出一种全新的顾问策略,通过将Opus作为顾问与Sonnet或Haiku作为执行器配对,实现在大幅降低成本的同时,使智能代理达到接近Opus级别的智能水平。这种方法不仅提高了系统的整体性能,还为用户提供了更灵活和高效的解决方案。

这种策略的优势在于,Opus作为高级智能体,能够提供复杂的决策支持和策略建议,而Sonnet或Haiku则负责执行这些任务。这种方式不仅降低了成本,还确保了系统的高效运行,特别适用于需要复杂决策支持但预算有限的应用场景。

该策略的应用范围广泛,包括但不限于客户服务、数据分析、智能助手等领域。通过这种方式,企业可以更经济地利用高级智能体的能力,提高业务效率和客户满意度。

在人工智能领域,优化模型的性能和成本一直是研究的重点。允许Sonnet调用Opus(即“电话求助”)不仅可以提高性能,还能显著降低总成本。通过减少解决复杂任务所需的令牌数量,这一策略能够有效节省资源。

Claude平台引入了这种顾问策略,将Opus作为顾问,而Sonnet或Haiku作为执行器。这种方法能够在大幅降低运行成本的同时,提供接近Opus级别的智能表现。这不仅提高了整体效率,还使得更多用户能够负担得起高质量的人工智能服务。

- **提升性能**:通过Opus的辅助,Sonnet能够更高效地处理复杂的任务。

- **降低成本**:减少令牌使用量,从而降低了总体成本。

- **广泛应用**:该策略适用于各种场景,包括但不限于自然语言处理、数据分析等。

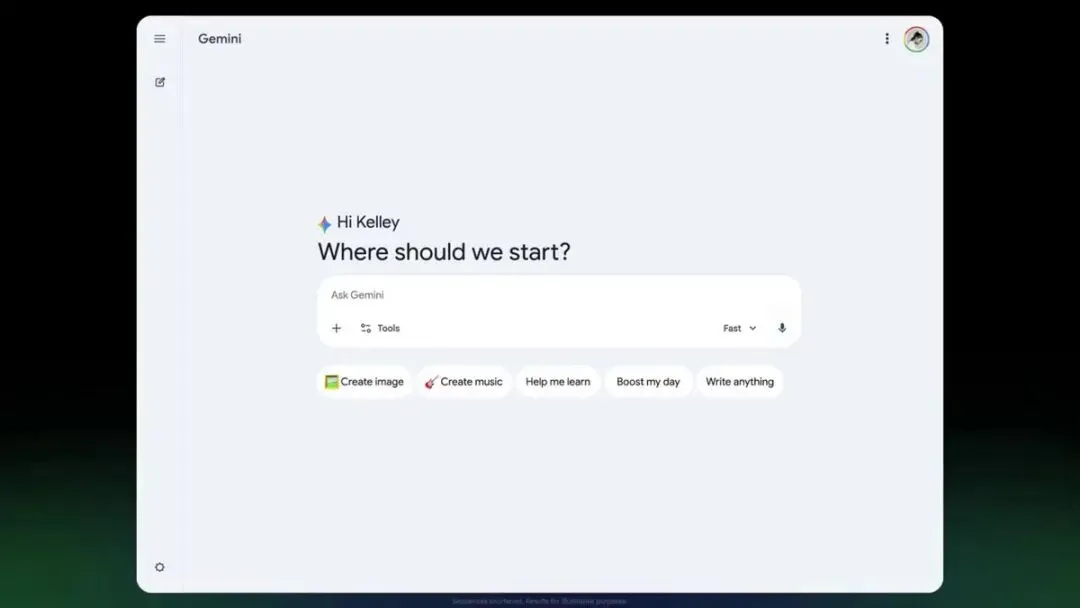

最新消息:谷歌已将NotebookLM直接集成到Gemini中,用户现在可以直接在Gemini界面中使用笔记本,并将Gemini聊天记录作为NotebookLM的数据源。

谷歌表示,此次更新将首先面向Google AI Ultra、Pro和Plus订阅用户推出,随后扩展到移动设备、更多欧洲国家以及免费用户。

以下是此次更新的主要功能:

- 免费上传多达100个数据源

- 组织和管理聊天记录,等待终于结束

- 同步数据源、聊天记录和表情符号

目前,许多用户已经开始同时使用Gemini和NotebookLM,谷歌将继续开发和完善这两个工具。未来几周内,更多的用户将能够享受到这些新功能。

随着即将到来的Google I/O大会,我们期待看到更多创新和改进。

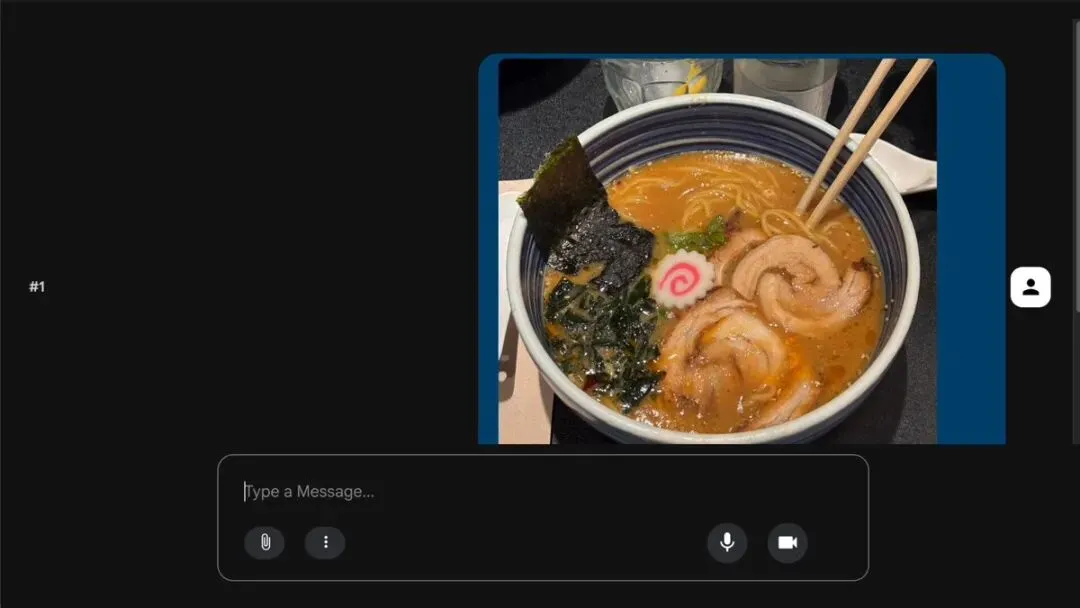

在最近的一次演示中,由Gemma 4 31B驱动的ADK Agent展示了其强大的能力,通过与Google Maps MCP Server的结合,构建了一条定制美食之旅。

该模型在实际操作中展现了以下几个关键特点:

- 多步骤推理:解决复杂的路线规划问题

- 多模态逻辑:处理视觉和文本信息

- 实时数据集成:直接连接到Google Maps获取最新数据

此次演示展示了人工智能在实际生活中的应用潜力,为用户提供了更加智能化和个性化的服务。

近日,由LMSys和RadixArk联合推出了一门全新的课程——《高效推理与SGLang:文本与图像生成》。这是一门专注于开源语言模型(LLM)推理的实战课程,时长一小时。

该课程由RadixArk的技术专家Richard Chen授课,旨在教授如何利用SGLang这一开源推理框架来提高LLM在生产环境中的效率并降低成本。众所周知,运行LLM的成本高昂,其中很大一部分来源于冗余计算。SGLang通过缓存已经完成的计算并在未来的请求中复用它,从而显著减少了这种浪费。

具体来说,当十个用户共享同一个系统提示时,SGLang仅需处理一次,而不是十次。随着共享上下文的增加,这种速度提升的效果会更加明显。

- 从零开始实现KV缓存以消除单个请求内的冗余计算

- 使用RadixAttention跨用户和请求扩展缓存,确保共享上下文只需处理一次

- 借助SGLang的缓存和多GPU并行技术加速图像生成

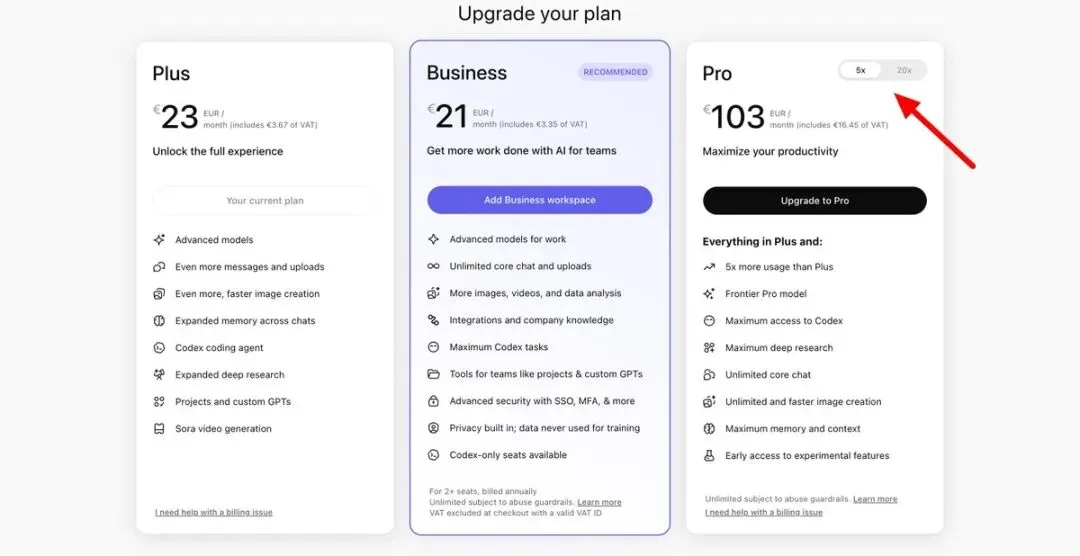

为了更好地支持不断增长的Codex使用需求,OpenAI宣布更新其ChatGPT Pro和Plus订阅计划。

此次更新引入了新的每月100美元的Pro套餐。这一新层级提供了比Plus套餐多五倍的Codex使用量,特别适合需要长时间、高投入的Codex会话。

在ChatGPT中,新的Pro层级仍然提供所有Pro功能的访问权限,包括专属的Pro模型以及对Instant和Thinking模型的无限访问。

为庆祝新层级的推出,OpenAI将在有限时间内(至5月31日)增加Codex的使用量,使得每月100美元的Pro订阅用户可以享受高达十倍于ChatGPT Plus的Codex使用量,从而帮助他们实现最雄心勃勃的想法。

通过这些改进,OpenAI旨在进一步提高开发者的生产力,并推动他们在各种应用场景中利用Codex进行创新。

OpenAI近日宣布推出新的每月100美元Pro订阅计划,该计划相比现有Plus订阅提供了5倍的Codex使用量。这一新层级不仅适用于更长、更高强度的Codex会话,还包含所有Pro功能,如独家Pro模型和无限访问Instant及Thinking模型。

为了庆祝新计划的推出,OpenAI在5月31日前为Pro $100订阅用户提供高达10倍的Codex使用量,以支持用户构建最具雄心的想法。

Codex是一个强大的代码生成工具,能够帮助开发者提高编程效率和质量。通过增加Codex的使用量,OpenAI旨在更好地支持快速增长的开发需求,并为用户提供更多灵活性和创新空间。

以下是新Pro计划的主要特点:

- 每月100美元

- 5倍于ChatGPT Plus的Codex使用量

- 独家Pro模型

- 无限访问Instant和Thinking模型

很高兴看到Codex受到如此广泛的关注和喜爱。为了满足广大用户的需求,我们即将推出100美元的ChatGPT Pro版本。

这一新版本将提供更强大的功能和更高的性能,包括但不限于:

- 更快的响应速度

- 更高的并发处理能力

- 更多的自定义选项

夜雨聆风

夜雨聆风