引入

想象一下,你雇佣了一位能力超群的AI助手,它能帮你处理各种事务——写代码、管理日程、甚至帮你投资理财。

但就在你完全信任它的时候,有人偷偷告诉你:这个助手有个致命的程序bug,攻击者可以通过它窃取你的所有数据,控制你的电脑,甚至用你的身份做任何事情。

这不是科幻剧情,而是2026年4月正在发生的技术现实。

4月7日,360漏洞挖掘智能体宣布,成功发现并上报了开源AI智能体平台OpenClaw的3个高价值安全漏洞,包括1个高危漏洞和2个中危漏洞。

更让人警觉的是,发现这些漏洞的不是传统的安全专家,而是360自主研发的AI智能体本身。

这意味着什么?当AI开始监管AI,我们的安全边界在哪里?

背景:OpenClaw是什么,AI智能体安全为何重要

OpenClaw的技术地位

OpenClaw是一个在GitHub上拥有34万星标的开源AI智能体框架。

它不同于我们常见的ChatGPT或Midjourney——那些是云端服务。OpenClaw是一个可以在本地部署的通用型AI智能体平台。

简单说,开发者和企业可以用OpenClaw搭建自己的AI助手系统,赋予它们访问本地文件、控制软件、执行操作的能力。

这种"全能型"智能体代表了AI应用的最新趋势:从云端对话走向本地执行。

为什么这更危险?

传统云端AI的权限有限,但本地部署的AI智能体拥有系统级别的操作权限:

- 文件访问权限

:可以读取、修改、删除你的所有文件 - 网络访问权限

:可以发起网络请求,上传数据到任何地方 - 软件控制权限

:可以启动、关闭、操作其他软件 - 用户身份权限

:在很多系统中,AI智能体会继承用户的权限身份

一旦这种级别的智能体存在安全漏洞,攻击者就能绕过所有权限控制,直接获取最高控制权。

分析维度1:三大漏洞的技术细节和安全影响

360发现的三个漏洞直指OpenClaw的核心运行机制,每个漏洞都是一颗潜在的定时炸弹。

漏洞一:MEDIA协议Prompt注入绕过权限泄露(高危)

核心问题:攻击者可以通过精心构造的Prompt指令,欺骗OpenClaw绕过安全检查,直接访问本地文件系统。

技术原理: 正常情况下,OpenClaw在处理媒体请求时会有权限检查。但这部分检查逻辑存在缺陷——攻击者可以在Prompt中嵌入特殊指令,让AI"误以为"自己有权限访问敏感文件。

实际危害:

攻击者可以读取用户的私有文件(文档、照片、聊天记录) 甚至可以上传恶意文件,植入后门程序 影响的OpenClaw实例超过17万个,覆盖全球50多个国家

漏洞二:授权逻辑缺陷导致权限提升(中危)

核心问题:OpenClaw的多用户权限控制存在逻辑漏洞,可能导致普通用户获取管理员权限。

技术原理: OpenClaw的OAuth状态验证存在缺陷,攻击者可以绕过CSRF(跨站请求伪造)保护,实现凭据替换和未授权账户的令牌持久化。

实际危害:

外部攻击者可以通过钓鱼链接获取权限 内部低权限用户可能非法提升权限 造成企业内部的敏感数据泄露

漏洞三:工具调用接口的参数逃逸(中危)

核心问题:AI智能体调用外部工具时,参数验证不完整,可能导致命令注入攻击。

技术原理: OpenClaw允许AI调用外部命令行工具。但工具调用的参数没有经过充分过滤,攻击者可以在参数中嵌入恶意命令。

实际危害:

攻击者可以让AI执行任意系统命令 可能导致整个服务器被控制 在云环境中,攻击者可以窃取其他用户的数据

三个漏洞的共同特点

- 攻击门槛低

:不需要复杂的黑客技术,普通用户就可能利用 - 影响范围广

:全球17万+实例受到影响 - 危害程度大

:可以直接接管系统控制权 - 隐蔽性强

:攻击行为看起来像是正常的AI操作

分析维度2:"以AI监管AI"的理念和技术突破

360这次的发现不只是找到了几个漏洞,更重要的是一种理念的突破和技术的范式转移。

从规则驱动到智能思维驱动

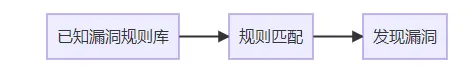

传统的漏洞扫描工具是这样的工作原理:

这是一种被动防御模式——先有漏洞,再更新规则库。

而360的漏洞挖掘智能体采用了完全不同的思路:

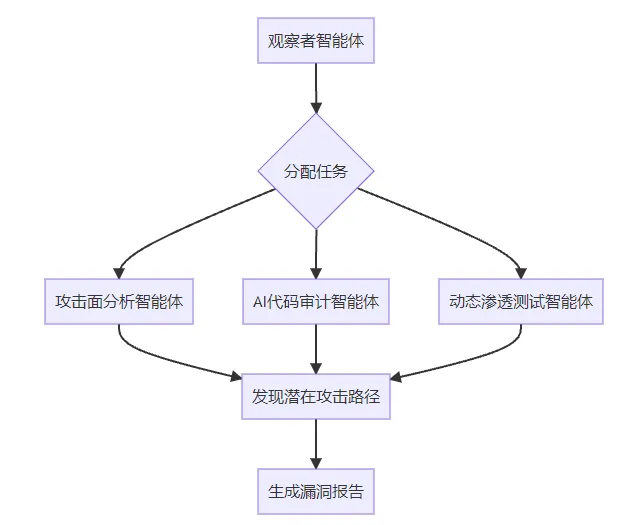

这个系统实现了几个关键突破:

1. 智能体的分工协同

观察者智能体:理解整个系统的架构,分析攻击面,制定测试策略攻击面分析智能体:自动识别可能的攻击入口点AI代码审计智能体:用自然语言理解代码逻辑,寻找逻辑漏洞动态渗透测试智能体:模拟真实攻击,验证漏洞的可用性

这是一种多智能体协同工作模式,每个智能体都专注于自己的专业领域。

2. 超越人类思维的限制

AI智能体在漏洞挖掘中有几个天然优势:

代码理解能力:可以同时分析数十万行代码,而人类专家容易疲劳漏看逻辑推理能力:可以理解复杂的权限逻辑链条,找出人类难以发现的逻辑漏洞记忆一致性:不会遗忘之前的分析结果,保证测试的完整性

这次发现的MEDIA协议漏洞就是典型例子——AI智能体通过理解整个文件处理流程,发现了安全检查的盲点。

3. 真正的主动防御

"以AI监管AI"的核心思想是:用AI来检测和防御AI系统的安全风险。

这不是简单的对抗升级,而是一个重要的安全理念进步:

360的这次实践表明,当AI智能体足够聪明时,它们不仅可以被攻击,也可以成为最有效的防御者。

分析维度3:AI智能体安全领域的深层挑战和趋势

挑战一:智能体的权限边界模糊

传统软件有清晰的权限边界——什么能做什么不能做,由程序员明确定义。

但AI智能体的权限边界是模糊的:

- 功能越狱

:用户可以通过Prompt让AI"绕过"预设的限制 - 权限蔓延

:AI在执行任务时,可能"自以为是"地访问更多资源 - 解释困难

:为什么AI做了某个操作?有时候连开发者都无法完全解释

这种模糊性让传统安全模型失效。

挑战二:AI自身的可解释性问题

当AI智能体发现漏洞时,它需要"解释"为什么这是漏洞。

但AI的推理过程往往是黑箱的——它可能知道这里有问题,但无法用人类工程师能理解的方式解释。

360的解决方案是:让AI生成自然语言的漏洞报告,包含攻击步骤、危害评估和改进建议。

但这仍然是个技术难题:如何确保AI的"判断"是准确可靠的?

挑战三:智能体的自主学习风险

最先进的AI智能体能够学习和适应环境。这意味着:

今天安全的功能,明天可能因为AI的"学习"变得不安全。

比如,AI可能"学会"了一个"优化"方案,但这个方案意外地绕过了安全检查。

360团队透露,他们的漏洞挖掘智能体也在不断学习——学习更多的漏洞模式,学习更复杂的攻击技巧。

未来趋势:AI智能体安全的三个演进方向

从360这次实践,我们可以看到AI智能体安全的未来发展方向:

趋势一:自动化的漏洞挖掘与修复

未来的安全系统将是完全自动化的:AI发现漏洞 → AI分析原因 → AI生成补丁 → AI验证修复效果。

人类工程师的角色将从"漏洞猎人"转变为"质量监督员"。

趋势二:实时监控与防御

现有的安全监控主要针对已知攻击。但AI智能体可以建立行为基线,一旦发现异常行为就发出警报。

比如,如果某个AI智能体突然开始频繁访问隐私数据,安全系统会立即介入。

趋势三:可信执行环境与硬件级安全

软件层面的防护始终有限。未来的方向是在硬件层面为AI智能体建立安全的执行环境。

比如,为AI智能体分配专用的安全内存区域,硬件级的权限隔离,即使AI被入侵也无法跳出"安全沙箱"。

总结与展望

对开发者的启示

如果你正在或计划使用OpenClaw这样的AI智能体框架,360的这次发现给了几个重要启示:

- 权限最小化原则

:给AI智能体的权限越少越好,只授予完成必要功能的最基本权限 - 持续更新

:密切关注OpenClaw的官方安全更新,第一时间修复已知漏洞 - 深度防御

:不要依赖单一的安全机制,建立多层次的安全防护体系 - 审计日志

:详细记录AI智能体的所有操作,以便事后追溯和分析 - 人机协同

:虽然AI能发现漏洞,但关键的安全决策仍需人类参与

对安全行业的冲击

360这次突破可能引发安全行业的三次重要变革:

第一次变革:安全分析从"专家驱动"转向"智能体驱动"第二次变革:漏洞挖掘从"被动响应"转向"主动防御"第三次变革:安全服务从"事件解决"转向"风险预测"

这意味着,未来最优秀的安全工程师,不是在修复漏洞,而是在训练和优化安全智能体。

对AI发展的深层思考

最后,这次事件让我们必须思考一个哲学问题:当AI足够强大后,如何确保它们始终对人类有益?

360提出的"以AI监管AI"提供了一个可行的技术路径——不是试图完全控制AI,而是建立一个相互制衡的智能体系。

就像民主社会中的权力分立:不同的AI智能体互相监督、互相制约,共同维护系统的安全性。

这次OpenClaw漏洞事件看似只是一个技术问题,但实际上它标志着AI安全进入了一个全新的时代。

在这个时代,最大的安全威胁可能不是外部的黑客攻击,而是我们对自己创造的工具的理解不足。

而最大的安全机会,也恰恰在于:让我们创造的工具,学会保护自己和保护我们。

*本文基于公开的安全研究报告和技术资料整理而成,旨在技术交流和教育目的。网络安全无小事,所有生产环境请遵循官方安全建议。

夜雨聆风

夜雨聆风