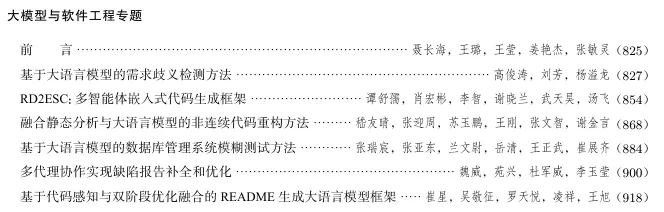

近年来,大语言模型(LLM)取得了突飞猛进的发展,将人工智能推向了一个新的高度,使更多不同的应用和工业领域获得了智能,并增强了能力。人机交互更加自然高效,各行业出现新的服务和业务模式,科学研究也得到加速。大模型背后是超大的参数规模、海量的训练数据和强大的计算资源,但软件能力提升的同时其质量保障也越来越困难。相比传统软件工程,大模型时代的软件工程需要面临更多的挑战:大模型支撑系统与框架的潜在缺陷,不断变化的基础设施导致系统演化困难,大模型行为本身缺乏可解释性与可信性,数据质量问题诱发的模型质量问题,伦理、道德和法律的约束使得软件应用困难。在这种局面下,亟需从软件工程的角度系统性地审视大模型时代下的软件质量保障方法,从而更好应对这一新兴领域中的新挑战。“大模型与软件工程”专题立足于软件工程领域,探讨在大模型时代软件工程技术的新发展与新趋势,特别是基于大模型的需求分析、设计和如何利用大模型技术进行自动代码生成、测试和形式化验证等,同时研究如何利用软件工程理论和方法保证基于大模型的软件系统的质量和安全。

本专题公开征文,共收到投稿51篇。稿件经初审、复审、ChinaSoft 2025会议宣读和终审4个阶段,历时6个月,最终有以下6篇论文入选本专题。本专题主要面向软件工程、系统软件、形式化、人工智能和大模型等多领域的研究人员和工程人员,反映了我国学者在大语言模型、人工智能和软件工程等领域相互赋能最新的研究进展。希望本专题能够对与大语言模型相互赋能的软件工程、系统软件与形式化等相关领域的研究工作有所促进。

聂长海(南京大学)

01

基于大语言模型的需求歧义检测方法

扫码可获取全文

02

RD2ESC:多智能体嵌入式代码生成框架

大语言模型(LLM)在软件工程中的应用日益广泛,但目前自动化代码生成研究主要集中于通用功能代码,缺乏针对嵌入式系统特殊需求的有效解决方案。

文章提出了RD2ESC(requirements documents to embedded system code)方法,通过基于提示词的微调技术使LLM能够理解嵌入式代码与需求文档之间的复杂关系,并构建了多智能体协同的代码生成框架,能够利用需求文档和参考代码快速生成高质量的嵌入式代码。实验结果表明,RD2ESC相比GPT-4o基线模型在Pass@1指标上从0.15提升至0.71,测试通过率达到0.75,编译通过率达到0.95;敏感性分析显示该方法对参考代码质量存在一定依赖性,在10%~50%扰动条件下Pass@1从0.68降至0.47,完全无参考代码时降至0.25,但仍保持基础代码生成能力;消融实验证实了多智能体间的协同效应,完整系统相比单一组件展现出显著的性能提升。该研究为嵌入式代码自动生成提供了有效的技术框架,提升了嵌入式系统开发效率。

【引用】

谭舒孺, 肖宏彬, 李智, 谢晓兰, 武天昊, 汤飞. RD2ESC:多智能体嵌入式代码生成框架[J]. 计算机研究与发展, 2026, 63(4): 854-867. DOI: 10.7544/issn1000-1239.202550663

Tan Shuru, Xiao Hongbin, Li Zhi, Xie Xiaolan, Wu Tianhao, Tang Fei. RD2ESC: Multi-Agent Embedded Code Generation Framework[J]. Journal of Computer Research and Development, 2026, 63(4): 854-867. DOI: 10.7544/issn1000-1239.202550663

扫码可获取全文

03

融合静态分析与大语言模型的

非连续代码重构方法

随着大语言模型(LLM)在软件工程领域的广泛应用,通过其强大的代码理解与生成能力进行自动化代码重构,已成为提升软件质量与开发效率的关键方向。然而,对于由语句交错、重排等导致的非连续代码克隆,LLM在重构时面临着语义上下文分散、关键依赖捕捉困难以及易产生“幻觉”错误等核心挑战。

为应对这些挑战,文章提出了一种融合静态分析与LLM的非连续代码克隆重构方法。该方法首先通过结合程序切片与代数分类器,高效精准地识别非连续克隆;然后,通过一种基于上下文信息的重构机会识别算法,为LLM确定最佳重构目标;最后,利用思维链少样本提示策略引导LLM生成高质量的“提取函数”重构建议,并利用蜕变关系验证机制,对生成结果进行语义和结构一致性验证。所提出的重构方法在Junit等真实项目中减少了66%~71%的克隆代码。此外,在开源数据集Google Code Jam和BigCloneBench上的实验表明,所提出的检测方法F1值较现有主流工具提升了2%~18%,在Community Corpus-A重构机会识别基准上,F1值达到了0.415,超越先进工具GEMS 7.5%,提升了软件质量。

【引用】

嵇友晴, 张迎周, 苏玉鹏, 王刚, 张文智, 谢金言. 融合静态分析与大语言模型的非连续代码重构方法[J]. 计算机研究与发展, 2026, 63(4): 868-883. DOI: 10.7544/issn1000-1239.202550688

Ji Youqing, Zhang Yingzhou, Su Yupeng, Wang Gang, Zhang Wenzhi, Xie Jinyan. Non-Contiguous Code Refactoring: A Hybrid Approach of Static Analysis and Large Language Model[J]. Journal of Computer Research and Development, 2026, 63(4): 868-883. DOI: 10.7544/issn1000-1239.202550688

扫码可获取全文

04

数据库管理系统(database management system,DBMS)作为数据管理与存储的关键软件,其可靠性直接影响数据密集型系统的安全稳定运行。近年来,模糊测试因其具备人工成本低、测试效率高等特点,成为DBMS测试方法之一。然而现有的DBMS模糊测试方法面临测试用例覆盖能力不足与多DBMS适配性差两大问题,限制了测试的效果和泛用性。

为此,CLCC(curated LLM case construct)是一种基于大语言模型(large language model,LLM)的DBMS模糊测试方法。该方法在模糊测试前,利用LLM对初始种子进行构建,并在模糊测试过程中,根据边覆盖情况筛选种子,引导LLM生成测试用例。与SQUIRREL、SQLRight和ParserFuzz进行的对比实验表明,CLCC测试SQLite、MySQL、MariaDB、DuckDB和PostgreSQL的边覆盖数量比SQUIRREL增加了14.96%~49.31%;测试SQLite、MySQL和PostgreSQL的边覆盖数量比SQLRight增加了6.09%~17.10%;测试SQLite、MySQL和MariaDB的边覆盖数量比ParserFuzz增加了17.95%~41.20%。

【引用】

张瑞宸, 张亚东, 兰文尉, 岳清, 王正武, 崔展齐. 基于大语言模型的数据库管理系统模糊测试方法[J]. 计算机研究与发展, 2026, 63(4): 884-899. DOI: 10.7544/issn1000-1239.202550692

Zhang Ruichen, Zhang Yadong, Lan Wenwei, Yue Qing, Wang Zhengwu, Cui Zhanqi. Large Language Model Based Fuzz Testing Approach for Database Management System[J]. Journal of Computer Research and Development, 2026, 63(4): 884-899. DOI: 10.7544/issn1000-1239.202550692

扫码可获取全文

05

多代理协作实现缺陷报告补全和优化

扫码可获取全文

06

基于代码感知与双阶段优化融合的

README生成大语言模型框架

随着开源软件生态的蓬勃发展,使用开源已成为当前开发的主流模式。其中,README是理解、复用开源软件的关键要素。然而,部分开源软件存在README文件缺失、信息不全以及结构不清晰等不规范问题,导致开发者难以理解和使用,降低开发效率。研究人员提出了多种README自动生成、补全方法,但这些方法仍然面临跨语言适用性不足、忽视代码结构信息、生成结果存在幻觉和主观性等挑战。

因此,文章提出结合大语言模型与代码结构建模的双阶段README自动生成框架RMancer。第1个阶段中,RMancer设计了基于提示引导的结构化信息抽取方法,结合静态分析生成高质量训练数据,提升模型对文件级功能摘要、依赖关系和主程序入口等结构要素的感知能力。第2个阶段设计了基于调用图的拓扑排序策略,重构模块间的执行逻辑顺序,以构建结构化文档生成的上下文信息;同时,引入多任务监督机制,引导大模型联合学习文档段落结构与内容生成,提升输出文本的逻辑一致性与客观性;最后,RMancer通过标准化约束策略对生成结果进行格式规整与内容审校,确保文档的规范性与准确性。在包含 16692 个开源软件的测试集中,RMancer 在信息抽取与 README 生成2个子任务上均显著优于现有方法,具体而言,在信息抽取任务中,其在calls、entry和description 字段的 F1-score 相较最佳基线模型平均提升2.34%;在文档生成任务中,BLEU、METEOR 和 ROUGE-L三项指标相较最佳基线模型平均提升幅度为1.37%。此外,RMancer在AlignScore和G-Eval两种自动评估指标上表现最佳。同时,在内容客观性与冗余控制等关键维度上,RMancer仍保持领先表现,进一步验证了其结构感知与多任务优化策略的有效性。

【引用】

崔星, 吴敬征, 罗天悦, 凌祥, 王旭. 基于代码感知与双阶段优化融合的README生成大语言模型框架[J]. 计算机研究与发展, 2026, 63(4): 918-942. DOI: 10.7544/issn1000-1239.202550698

Cui Xing, Wu Jingzheng, Luo Tianyue, Ling Xiang, Wang Xu. An LLM-Based README Generation Framework via Code-Aware Representation and Dual-Stage Optimization[J]. Journal of Computer Research and Development, 2026, 63(4): 918-942. DOI: 10.7544/issn1000-1239.202550698

扫码可获取全文

点击文末“阅读原文”可以登录网站阅读全文。

夜雨聆风

夜雨聆风