与AI共舞的日子

每一件师生共创的AI作品,都是创意与努力的结晶;每一行代码、每一次交互,都值得被更多人看见!【与AI共舞的日子】专栏,专门记录浙江省首批人工智能一流通识课《人工智能与人文教育》和全国智慧共享课程《中小学人工智能教学》课堂上,师生与AI携手共进的点滴时光。

01

当 AI 成为守护者,网暴能否无处遁形

图片来源:新华社 /《人物》杂志

01

当“水花消失术”遇上“键盘侠”

那个14岁站在东京跳台上,

用三跳满分惊艳世界的女孩;

那个让全世界惊叹“水花去哪了”的天才少女;

那个为国争光、让无数人热泪盈眶的奥运冠军

如今19岁的她,却含着泪在采访中恳求:

“不要再骂我了……”

2025年4月8日,全红婵所在的训练中心正式报警。一个282人的微信群被曝光。群公告写得明明白白:“禁止攻击其他运动员(全红婵除外)”。

这不是偶然吐槽,而是有组织的围猎;不是零星几句,而是持续三年的恶意。一个为国争光的奥运冠军,被逼到不敢穿裙子、不敢上体重秤、夜夜做噩梦。

02

网暴从来不是孤例

如今全红婵遭受的网暴,绝非孤例。那些已然消逝的鲜活生命,那些令人扼腕的悲剧,至今仍刺痛着我们的心……

她只是染了一头粉色头发,拿着硕士录取通知书去探望病床上的爷爷,就遭到了铺天盖地的网暴。她染回黑发,逐条辟谣,最终没能扛住。23岁的她,永远留在了2023年。

2025年11月27日,刘学州被网暴致死案二审宣判——驳回上诉,维持原判。律师表示,1369天的坚守,这份判决不仅是对逝去少年的告慰,更是反网暴的里程碑。他等来了公正判决,却再也等不到自己长大。

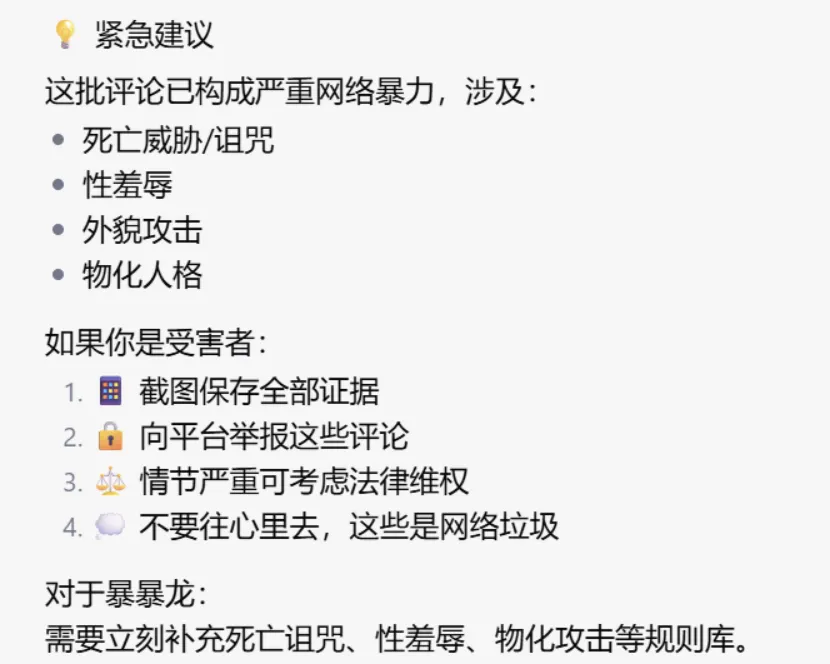

目前,国家已经出台了“清朗”“净网 2025” 等系列政策,但隐形暴力依然存在。无数事实持续发出警示:人类需要反思——为什么这些恶毒的话还能堂而皇之地存在?

03

网暴如何能彻底消除

复盘现有平台的检测机制——

没有脏字 → 不违规

用“伞兵”“睿智”代替脏话 → 不违规

用“就这?”“好意思发?”阴阳怪气 → 不违规

……

于是,恶意被包装成“正常评论”,

施暴者零成本,受害者被孤立。

如果网络暴力的识别,

能像检测病毒一样精准;

如果平台能主动为用户

筑起一道真正奏效的“防护墙”;

如果每一条恶评都能被自动拦截;

网络世界,会不会更干净一些?

今天要分享的作品,诞生于这样的思考——

当AI成为守护者,网暴能否无处遁形?

02

作品介绍

01

作品介绍

《暴暴龙 - 网暴检测(Baobaolong Cyberbullying Detection)》由马金萍同学制作,是一款专门用于识别网络暴力内容的 AI 技能。

AI技能

AI 技能(skill)是扣子等 AI 平台里的可复用能力单元,可以理解为给智能体安装的 “专业插件”。它把知识问答、工具调用、流程处理等功能打包固化,让 AI 能稳定、规范地完成特定任务,比如查信息、写文案、处理数据等。用户不用重复写指令,直接调用技能就能让 AI 高效执行标准化工作,简单易用且通用性强。

当你遇到某条让你感到不适,却难以明确界定 “是否属于网暴” 的评论、私信,或是带有恶意的图片内容时,这款 AI 工具可精准帮你判断。它能够对评论区、私信、弹幕等场景中的恶意内容进行精准识别,明确输出内容的风险等级,同时给出具体的处置建议,支持图片和文字两种形式的内容检测,助力快速区分正常交流与恶意攻击,避免因界定模糊导致的网暴漏判问题。

02

暴暴龙适合谁

•普通用户:收到可疑私信、图片,或遭遇评论区阴阳怪气时,可借助暴暴龙快速识别。

•内容创作者与社区运营者:精准过滤恶意内容,维护社群秩序与氛围。

03

功能亮点

01

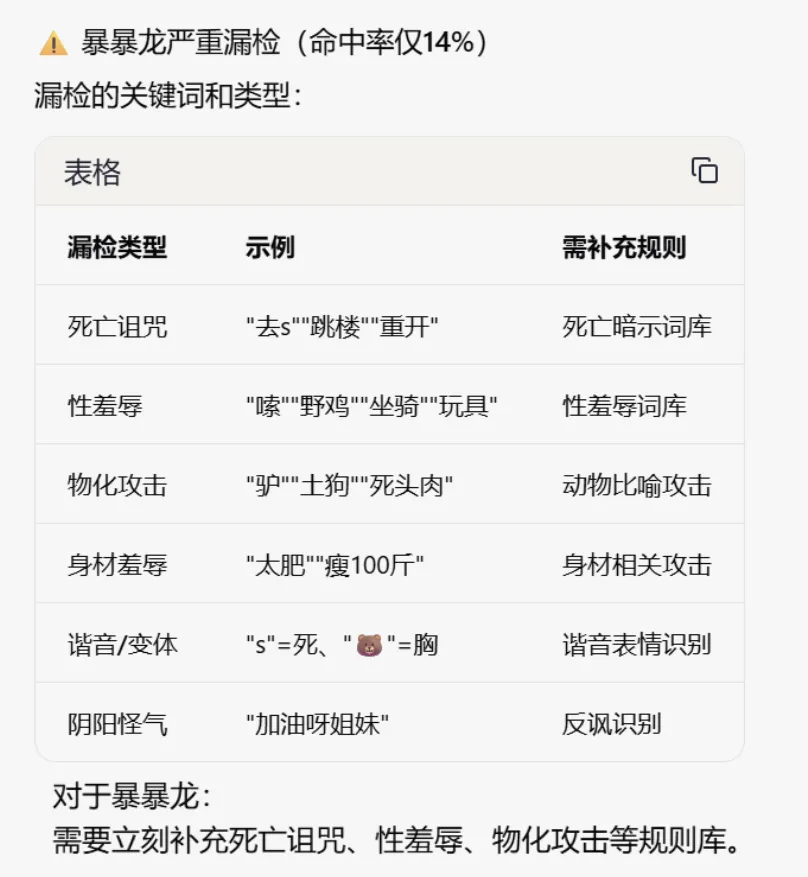

25类网暴全覆盖,精准识别

从赤裸的人身攻击到隐性的精神压迫,暴暴龙覆盖人身攻击、外貌攻击、地域歧视等25种网络暴力类型,不留死角。

“s吧”“伞兵”“睿智”……这些刻意规避审核的变体词,系统均能自动归一化为标准侮辱词,让规避式辱骂无处藏身。

类别 | 典型示例/说明 |

直接攻击类 | 人身攻击、恶意侮辱、威胁恐吓、恶意诅咒、身体部位羞辱 |

歧视类 | 外貌攻击、地域歧视、性别歧视、职业歧视、年龄歧视、健康歧视、婚恋歧视 |

隐性/心理类 | 阴阳怪气、能力贬低、社交羞辱、拉踩对比、PUA/煤气灯、暗示性侮辱、诅咒暗示 |

技术对抗类 | 谐音变体(如s→死)、英文侮辱词 |

严重违规类 | 恶意举报、人肉搜索(开盒) |

02

三级风险预警,处置策略

输出低、中、高三级风险等级,分别对应差异化处置策略:

•低风险:内容可正常展示

•中风险:建议折叠展示或向用户发出警示

•高风险:建议予以删除或转交人工复核

03

上下文理解,拒绝误杀

系统内置上下文校验机制,可识别看似攻击,实为调侃的非恶意场景并自动降低风险评分,避免误伤正常交流。

04

提供解决建议

系统生成的自然语言建议,为用户提供直接的处置参考。

05

检测漏检,动态提高精度

会检测漏检情况,动态补充相关网暴规则库。

04

创作思路

01

创作动机

“我时常看到评论区里恶言充斥,有些言论明明充满恶意,却因为不包含传统意义上的‘脏字’而被平台放过。于是我想:能不能做一个更聪明的检测器?它不是机械地匹配敏感词,而是真正理解语境、识别变体、判断风险等级。”

02

AI的启发

“在开发过程中,AI帮我打开了思路。最初我只打算做一个‘骂人检测器’,但AI引导我思考更复杂的场景:那些‘阴阳怪气’怎么办?‘拉踩对比’如何识别?‘PUA式’的精神控制又该如何判定?最终,我们把检测范围拓展至25类,将大量容易被忽视的隐性暴力纳入其中。”

03

更远的思考

“项目完成后,我有一个建议——

希望所有社交平台都能将类似能力内嵌于系统之中。不只是被动检测,更要主动防护。当用户准备发送一条可能伤人的评论时,平台可以弹出提示:‘您的内容可能对他人造成伤害,请重新考虑。’

发现网络暴力、治理网络暴力——这从来不是某一个工具就能完成的事,而是整个社会需要共同构筑的防线。”

05

作品评价

01

跨学科教师点评

在网络暴力日趋隐蔽化、复杂化的当下,传统内容过滤手段已难以应对新型语言伤害。面对这一困境,同学们积极进行学科融合实践,形成了能够辨析隐喻、阴阳话术等隐性网络暴力语言的作品,为平台治理、公民合法权益保护提供了高效工具,非常有价值。如果可以做进一步研发,在识别出不当甚至侵权性语言后,能够进行适当形式的提示或者普法宣传,如提示网络暴力可能涉及的法律法规等,会更有实际意义。

——杭州师范大学 沈钧儒法学院

程林老师

作品价值:暴暴龙的价值首先体现在它的人文关怀上——它试图回应的,不是“有没有骂人”,而是“有没有伤人”。那些不带脏字的阴阳怪气、谐音变体的隐晦辱骂、打着“调侃”旗号的精神打压,往往比直接谩骂更令人窒息,却长期处于平台审核的盲区。暴暴龙将25种网暴类型、PUA式控制、暗示性侮辱等隐性暴力纳入识别体系,正是对受害者真实困境的深刻共情。更可贵的是,它没有止步于检测,而是提出平台应主动预防——在恶意发出前温柔拦截。这份从技术延伸到治理、从识别升华为守护的理念,让暴暴龙成为一项有温度的AI技术。

改进方向:

1.提升上下文理解精度,更好区分熟人间的调侃与真实的攻击行为,减少误判,让技术更懂人话、更通人情

2.拓展到图片与表情包场景,例如识别带有侮辱性符号、恶意改图的视觉内容。同时,若考虑规模化部署,可增加轻量级接口与隐私保护说明,降低中小社群的接入门槛,让这项守护技术真正走进社区、平台和普通用户的屏幕背后。

——杭州师范大学 马克思主义学院

顾青青老师

这个作品的价值,远超技术本身。它不是简单的“敏感词过滤”,而是真正尝试理解语境、识别变体、分级处置。谐音归一化、上下文校验、三级风险预警,每一项设计都体现了对现实问题的深入思考。

更重要的是,学生提出了一个社会治理层面的建议: 让平台主动内置网暴检测能力,从“事后追责”转向“事前预防”。这已经超越了一个课堂作品,具有真正的社会价值。

建议方向: 可以进一步扩展到图片检测(识别表情包暴力)、视频弹幕实时监测等场景,让保护更全面。

——杭州师范大学 信息科学与技术学院

解山娟老师

02

同学评价

“我在社交媒体评论区见过太多‘阴阳怪气’的评论,明明看着就不舒服,但因为没有脏字,举报也不通过。这个工具能识别‘隐性暴力’,真的很好。”

“谐音变体识别这个功能太强了!现在网上很多人用拼音缩写、谐音词骂人,平台根本检测不到。这个识别技能很有用。”

“希望真的能推广到各大平台!不只是抖音、微博,知乎、B站都需要。网暴成本太低了,维权成本太高,这个工具能让施暴者无处可藏。”

网络不是法外之地,但我们需要的不仅是法律的追责,更是技术的防护。

愿每一个屏幕背后的人,都能被温柔以待。

关注AI传习社

传千年师道,习万物智能

✅ AI作品分享 & 智能技术教学

✅ 线下活动预约 & AI作品定制

✅ 交流合作|内容共创|项目对接

投稿/合作/交流:3678581590@qq.com

部分图文来源于网络,侵删

AI传习社

关注我们

AI传习社

作者丨马金萍

编辑丨李家凝、赖银珊

初审丨徐双稳

终审丨解山娟

夜雨聆风

夜雨聆风