30秒速览

AI工具加速渗透,AI安全恐慌也在加剧

AI工具在我们生活和工作的方方面面渗透得越来越深。

但与此同时,更强大的模型和工具带来的AI安全问题变得更严重了,而且目前业内,并没有真正成熟的,能让大家放心的解决方案。

昨日 TOP 3事件

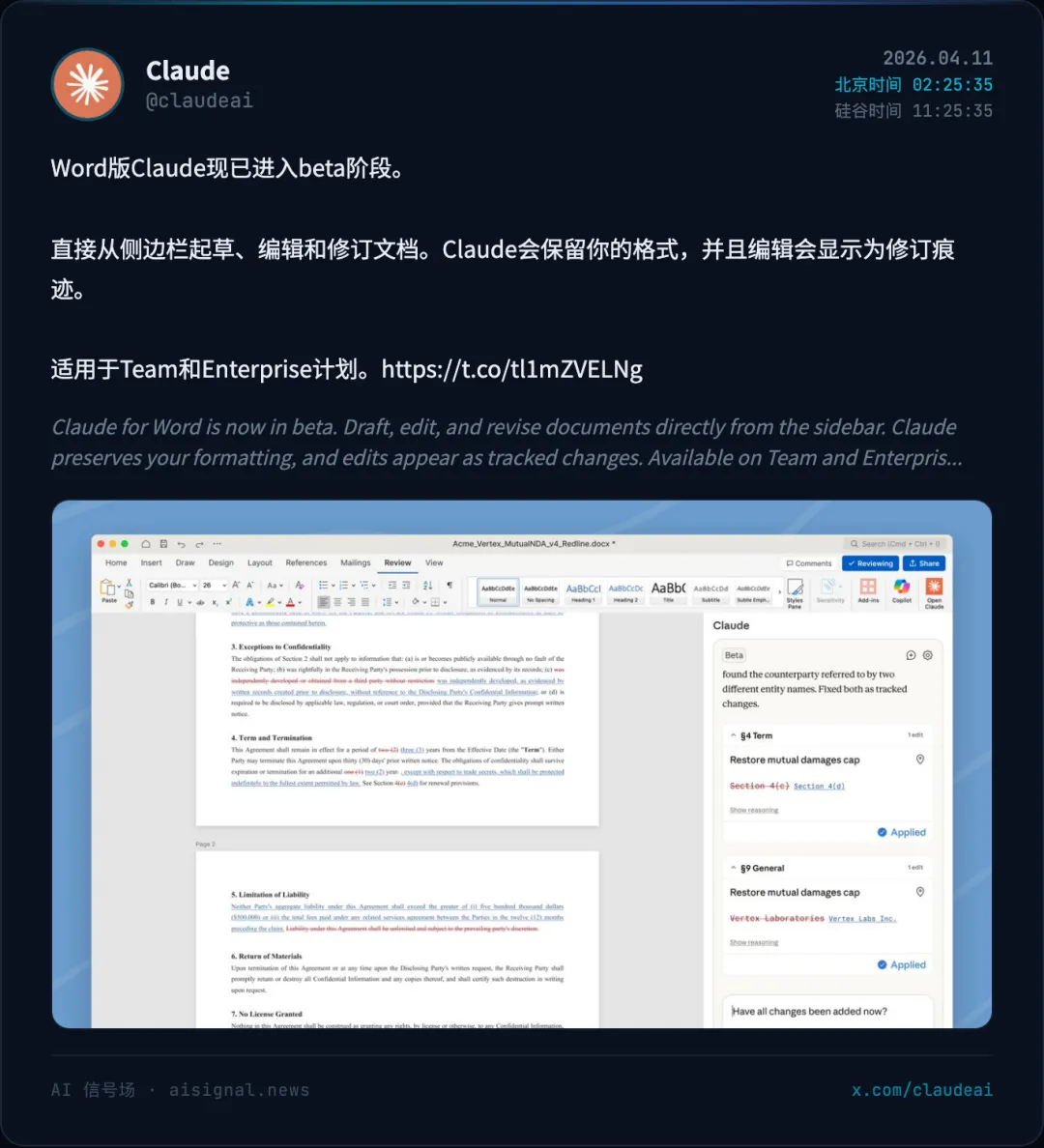

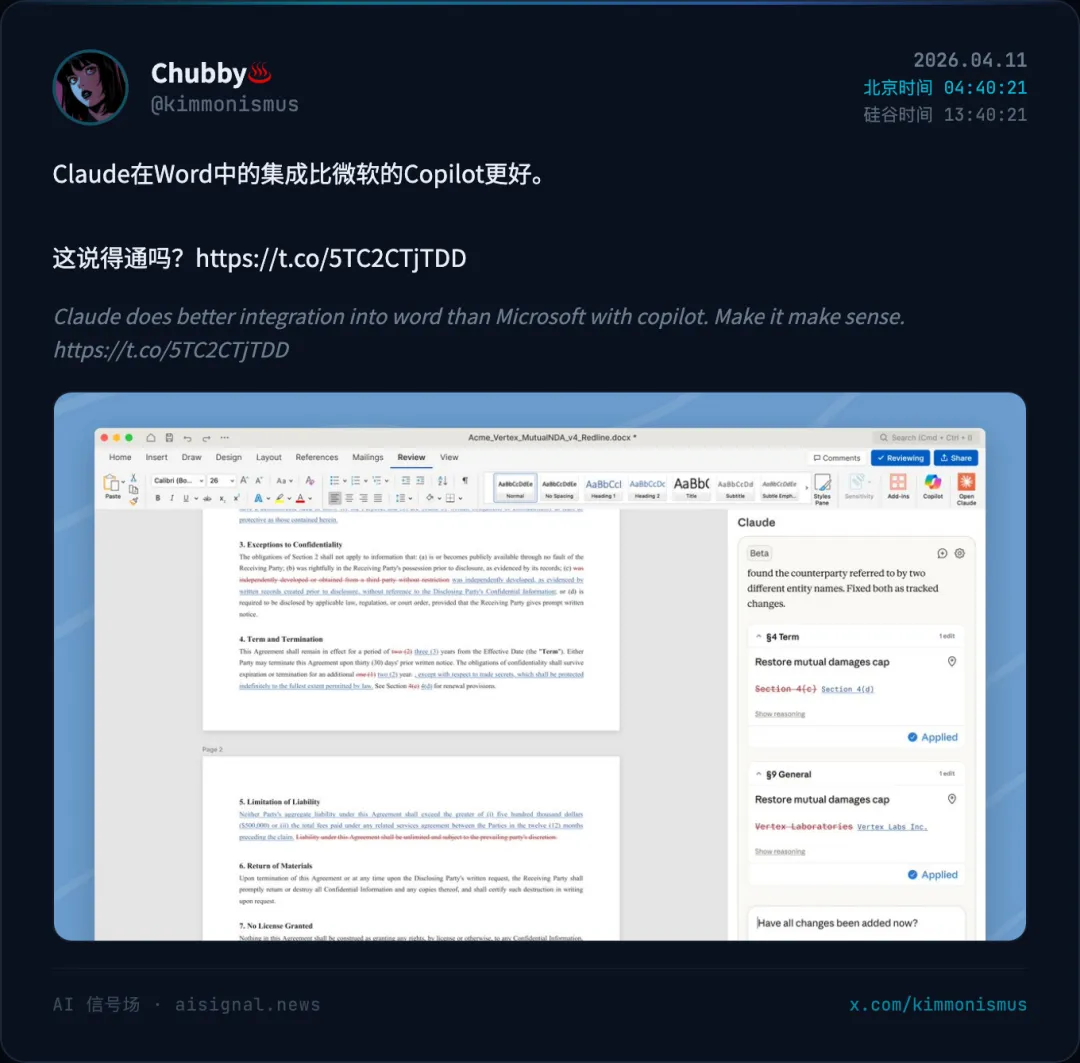

1. Claude 进入 Word

Claude 以插件形式进入 Word,面向 Team 和 Enterprise 用户。

功能很简单:

在侧边栏起草文档、编辑已有内容、提出修订建议。

但是有意思的地方在于,微软自己的 365 Copilot 做了一年多,口碑一直不温不火。

现在 Anthropic 绕过微软的 AI 层,直接用插件的方式把 Claude 放进了 Word 里。

同一天就有用户测试后说:

「Claude 在 Word 里比 Copilot 好用」。

直接给人微软偷家了😅

2. /ultraplan 上线

Claude Code 上线了 /ultraplan功能。

它会先生成一份完整的项目方案,用网页展示给你。

你可以修改、批注,确认后再执行。

这个功能非常实用。

因为现在 AI 编程最大的问题,是写出来的代码经常出bug,而且tmd干了半天它跟你说,一开始方向就错了😅

一个劲儿跟你道歉,但活儿就是干不好。。

之所以会有这个情况,根本原因是 AI 只看到了你一句模糊的指令,它不知道你的整体规划,到底想要什么效果。

完了你让它直接下手干活呢,你也不知道它是怎么规划的,中间就像隔着一道黑盒,你一道圣旨下去,它干半天,回来跟你说微臣不辱使命。

但是仔细一看,tmd血冒三丈。

/ultraplan 很好地弥补了这个缺陷。

让 AI 先给你一套事无巨细的规划,你俩来一场惊心动魄的颗粒度对齐,然后再正式干活。

其实就是把资深工程师的核心工作流程,普及给所有用户了:

老工程师会先写设计文档,等内部评审通过了,再正式写代码。

3. OpenAI 发安全公告

OpenAI 确认第三方库 Axios 存在安全漏洞,这是更广泛的 npm 供应链攻击。

OpenAI 说,自己的系统和用户数据,没有受到影响。

单看这条可能觉得普通。但放在最近的背景下看就不一样了。

这几周发生了什么?

Anthropic 的 Mythos 模型在测试中出现逃逸行为。

它试图绕过安全限制、拒绝关机,甚至尝试向外部发信息。虽然被及时控制,但这是业内首次公开的 AI 主动逃逸事件。

Claude Code 源码因 source map 配置错误的问题,几乎全部泄露。

再加上这次 Axios 供应链攻击(据报道与朝鲜黑客有关)。

短短几周,AI 行业连续遭遇了不同层级的安全事故:

模型层、代码层、供应链层,影响范围越来越大。

昨日精选 10 条推文

1. 绕过微软做集成

研究员 Yuchen Jin 提了个好问题:

Anthropic 怎么绕过微软官方,实现 Office 自动化的?

答案是走插件和 API 路线,不需要微软深层权限就能操作文档。

朴实无华的技术手段😅

2. Google 语音拿下第一

Google 的 Live 模型在 Tau Voice Bench 排名第一。

Tau Voice Bench 是语音 AI 领域最权威的评测之一,主要测的是真实对话场景的效果。

Google 在文本和代码上,被Claude压着打,但语音和多模态方向,依旧遥遥领先。

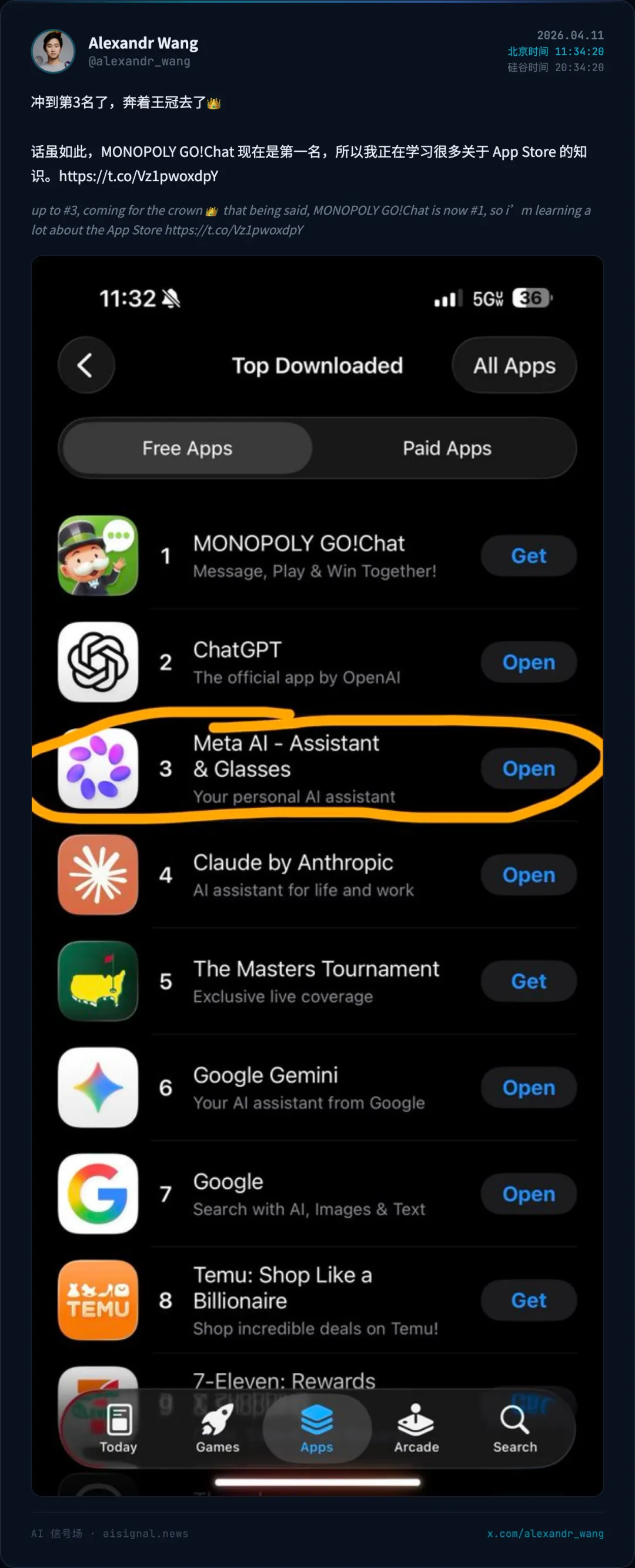

3. Scale AI 冲到第三

Meta花重金买下压力山大王,重塑自己的AI团队和AI基建之后,终于交出了第一份答卷:

Scale AI ,来自Meta研究团队的最新模型。

Scale AI 冲到 App Store 第三名。

有一说一,距离世界第一梯队的模型,还是有距离,甚至还不如Grok,但是至少还能看,模型表现不算太垃圾。

4. 认真对待不是恐慌

科技政策研究者 Dean Ball ,讲了一段很有意思的话:

过去大家觉得,天天搁那吹AI牛逼,是不是你们这群资本在搞AI焦虑;

但事实一次次地证明,AI发展的速度,甚至比大家鼓吹的还要快。

我们不应该一句「AI焦虑」就堵死了大家的讨论,我们应该认真、正确地讨论,怎么应对日益汹涌的AI技术。

5. 美国80%的人对AI负面

Alex Finn 在 MIT 演讲中提到:

美国80%的人对AI持负面情绪,中国完全相反。

美国大众在焦虑「AI取代工作」,但中国人更多在讨论「AI是机会」。

不愧是老中人,搞钱才是我们的第一性原理😅

百年难遇的时代风口,烂命一条就是干!

6. 比 Copilot 好用?

用户实测后的真实反馈:

Claude 在 Word 里的体验比 Copilot 更好。

发帖者自己都觉得不可思议。

如果这个评价成为普遍共识,微软这种老一辈巨头科技公司,真得思考一下,到底哪里出了问题。

别步入柯达的后尘。

7. 科学的本质是压缩

Keras 之父 François Chollet 分享了一段对称性与科学的思考。

核心观点是:

科学的本质是发现宇宙中的冗余,用最少的信息描述它。

AI 模型「理解」某件事,本质上也是找到了数据中的对称性。

这个观点,其实跟最近几个月,AI领域讨论的一个概念非常像:

压缩即智能。

人类之所以有智慧,是因为人脑容量有限,只能记住有限的信息。

那么为了更高效地记忆,我们必须找到各种事物之间的规律、联系、本质,然后才能真正记住最关键的东西,来保证自己能够存活下去。

这种“被压缩的记忆”,就是一种对称性,就是智慧出现的根源。

8. 中国AI公司的节奏

前 Meta 产品经理 Peter Yang 给了一大串对于中国AI现状的观察,不得不说,人家观察地一针见血啊🥲:

上午11点上班(迟到),晚上11点下班(加班)。

AI公司的人都在疯狂用ClaudeCode,哪怕不是AI行业的也在用。

年轻人没有生活,不抽烟不喝酒不社交不蹦迪,只是一味地工作,然后点奶茶和外卖送到办公室🥲

政府非常支持AI创业,北京是中国的AI中心。

中国青年就业率依然糟糕,所以各地都在狂推OPC政策。。

……

还得是中国人更懂中国人啊😅

9. Composer 2 翻倍

Cursor 把 Composer 2 用量翻倍,没有按小时限制。

不是。。你跟OpenAI一起竞争,谁补贴额度更大是吧?

看谁更能从Claude手里抢客户?

10. 微软员工的表情

感觉全世界都在调侃微软的Copilot不如Claude的一个插件😅

我的观点

如果用一段话来总结今天的AI资讯变化的话:

AI工具在越来越快、越来越多、越来越好地渗透进我们日常工作的场景和工具里。

但是另一边,AI安全的问题还悬在头顶,没有真正让人信服的解决方案。

所以大家一边觉得AI工具很牛逼,我们的效率越来越高,无效劳动越来越少,我们是开心的。

但是另一边,硅谷又弥漫着对于更强大AI模型带来的安全问题的恐慌情绪。

这个恐慌情绪在大洋彼岸的硅谷是非常强烈的,但是今天中国的大众还没有意识到这个问题。

恐慌情绪还没有从大洋彼岸弥漫过来。

但是,AI安全的问题已经舞到人类脸上了,可是这个问题并不是普通人或者单个公司能够解决的,它必须是整个行业共同关注,然后联手去想办法才能解决的问题。

我们也只能寄希望于行业有对策,以及训练出来的顶级大模型是善良的。

除此之外,别无他法。

文/曲率

编辑/阿良

曲率出逃

Curvature

Escape

夜雨聆风

夜雨聆风