20分钟吃透AI核心:这20个关键概念,直接拉开你和90%人的差距!

很多人第一次接触 AI 时,都会有一种强烈的割裂感:

术语听不懂,模型看不透,别人聊得轻松,你却连基本逻辑都抓不住。

不是你不够聪明,而是大多数内容,从一开始就讲复杂了。

真正的转折点,不在于你学了多少工具,而在于你是否看懂了底层逻辑。

这篇文章不讲炫技,不堆概念,而是把 AI 的关键机制拆开,用一条清晰的路径重新拼起来。

当你把这 20 个核心概念串起来,很多看似“高深”的技术,其实只是顺理成章。

别再只会用AI:先搞懂它是怎么“学会理解”的

1. 神经网络(Neural Network)

可以把神经网络理解为一条逐层加工的数据流水线:

输入层 → 多层隐藏层 → 输出层

每一层都会对信息进行一次“加工”,不断逼近最终结果。

例如图像识别:

前几层:识别边缘、纹理

中间层:识别形状、结构

深层:识别具体物体

核心在于“权重(weight)”:

每条连接都有一个权重,决定信息影响力。

训练的过程,本质就是不断调整这些权重,让输出越来越准确。

2. 迁移学习(Transfer Learning)

从零训练模型成本极高:

数据量巨大

训练时间长

计算资源昂贵

迁移学习的思路是:

不重新造轮子,而是在已有模型上继续优化

类似:

会骑自行车 → 更容易学摩托车

这也是现代 AI 的主流方式:

大模型由大厂训练,开发者基于其做微调或应用。

别再只会调接口:理解 Transformer 的核心机制

3. 分词(Tokenization)

AI 不直接理解“句子”,而是拆成更小单位:

单词

子词

字符片段

例如:

playing → play + ing

原因很简单:

语言变化太快,无法穷举所有词。

通过拆分,模型可以理解“结构”,而不是死记单词。

4. 向量化(Embeddings)

文本不能直接计算,必须转成数字。

每个 token 会变成一个向量:

"doctor" → [0.12, -0.98, ...]

这些向量构成一个“语义空间”:

相似词更接近

不相关词距离远

例如:

doctor ≈ nurse

doctor ≠ mountain

AI 并不理解“定义”,而是理解“距离关系”。

5. 注意力机制(Attention)

同一个词,在不同语境中含义不同:

Apple(水果) vs Apple(公司)

Attention 做的事情是:

让每个词动态关注句子中“最相关的部分”

例如:

She bought shares in Apple

模型会重点关注:

bought

shares

从而判断 Apple 是公司。

6. Transformer 架构

Transformer = Token + Embedding + Attention 的组合体。

核心特点:

不按顺序处理(并行计算)

全局理解上下文

多层堆叠逐步优化

可以理解为:

文本 → Token → 向量 → 多层 Attention → 结果

这也是 GPT、Claude、Gemini 等模型的基础架构。

别再只会聊天:搞懂大模型到底在做什么

7. 大语言模型(LLM)

本质只有一句话:

预测下一个 token

训练数据:

书籍

代码

网页

训练目标:

输入:The sky is

输出:blue

当这个过程被重复数万亿次后,模型就“学会”了语言规律。

8. 上下文窗口(Context Window)

模型的“短期记忆容量”。

决定:

一次能处理多少内容

是否能理解长对话

问题:

越大越贵

中间信息容易被忽略(lost in the middle)

9. 温度(Temperature)

控制输出风格:

| 温度 | 特点 |

|---|---|

| 低 | 稳定、保守 |

| 高 | 多样、发散 |

本质是:

是否只选最可能答案,还是探索更多可能

10. 幻觉(Hallucination)

AI 有时会“自信地胡说”。

原因:

它的目标不是“真实”,而是:

生成最可能出现的文本

解决思路:

引入外部知识

强制引用来源

使用 RAG

别再只会用模型:理解它是如何被“调教”的

11. 微调(Fine-Tuning)

在预训练模型上继续训练:

法律

医疗

金融

缺点:

成本高

需要 GPU 集群

12. RLHF(人类反馈强化学习)

让模型更“像人”:

流程:

生成多个答案

人类排序

模型学习偏好

结果:

更礼貌

更安全

更有用

13. LoRA

轻量级微调方案:

冻结原模型

只训练小模块

优势:

成本低

易部署

14. 量化(Quantization)

让模型“变小”:

减少参数精度

降低内存占用

效果:

可以在本地运行

性能损失有限

别再只会问问题:掌握与AI沟通的方式

15. 提示工程(Prompt Engineering)

同一个问题,不同问法,结果差异巨大。

示例:

差:解释 API

好:用示例解释 REST API 如何做鉴权

本质:

你给的信息越清晰,输出越精准

16. 思维链(Chain of Thought)

让模型“分步骤思考”。

例如:

不要直接给答案 → 先拆解问题 → 再推导

适用于:

数学

逻辑

推理

别再只会调模型:理解AI系统是如何构建的

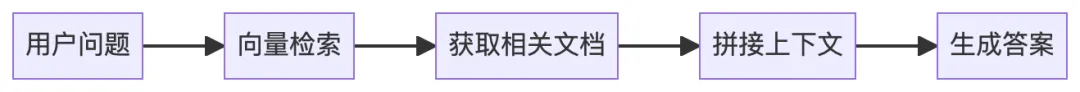

17. RAG(检索增强生成)

核心流程:

用户问题向量检索获取相关文档拼接上下文生成答案

本质:

先查资料,再回答问题

优势:

降低幻觉

可实时更新知识

18. 向量数据库(Vector DB)

存储的是“语义”,不是文本。

流程:

文本Embedding向量存储问题向量化相似度搜索

常见路径示例:

/data/ai/vector-db/qdrant

/data/ai/vector-db/weaviate

19. AI Agent

让模型具备“行动能力”。

基本循环:

观察决策执行

能力包括:

调用 API

写代码

自动执行任务

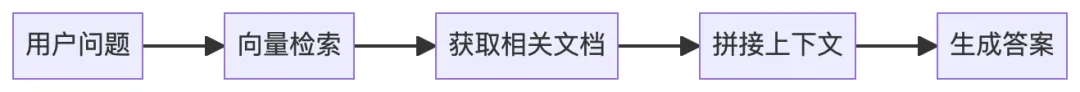

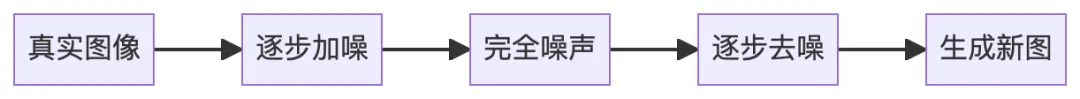

20. 扩散模型(Diffusion)

图像生成核心逻辑:

先加噪声,再去噪声

过程:

真实图像逐步加噪完全噪声逐步去噪生成新图

应用:

图像生成

视频生成

3D 建模

别再只会收藏:把知识变成你的能力

如果你把这 20 个概念串起来,会发现一条清晰路径:

神经网络 → Transformer → LLM → Prompt → RAG → Agent

这不是零散知识,而是一整套体系。

很多人卡在“不会用 AI”,其实问题不在工具,而在认知结构。

真正拉开差距的,从来不是你用过多少工具,而是你是否看清了工具背后的运行逻辑。

当你理解了这些概念,AI 不再是黑箱,而是你可以驾驭的系统。

今天就讲到这里,如果有问题需要咨询,大家可以直接留言或扫下方二维码来知识星球找我,我们会尽力为你解答。

快速搭建属于您的专属官网,就上TechWisdom(www.techwisdom.cn)!

提供100+ 精美模板,支持二级域名和独立域名配置,可根据需求进行个性化定制开发。首次上线还有专业团队协助上传内容,轻松打造高效、专业、吸睛的官网!立即访问网站,选择您心仪的模板,开启建站新体验吧!

作者:路条编程(转载请获本公众号授权,并注明作者与出处)

夜雨聆风

夜雨聆风