斯拉沃热·齐泽克(1949—),斯洛文尼亚哲学家、精神分析学家、文化批评家,当代最有影响力的思想家之一。卢布尔雅那大学社会学和哲学研究所高级研究员,兼任纽约大学全球特聘教授、欧洲研究生院教授,擅长以拉康精神分析理论、黑格尔哲学和马克思主义政治经济学解析社会文化现象,被称为“摇滚明星哲学家”“文化理论的猫王”“最危险的西方哲人”。其学术著作有五十余种,代表作包括《意识形态的崇高客体》《自由的深渊》《幻想的瘟疫》《欢迎来到实在界这个大荒漠》等。本文是齐泽克的专栏评论,原文是“Artificial Idiocy”(人工智障——评ChatGPT),于2023年3月23日发表于Project Syndicate。“问题不在于聊天机器人很笨,问题在于它们不够‘笨’”

当我们凝视人工智能的深渊时,深渊并没有回以凝视,它只是迅速地、甚至带着某种讨好意味地自动补全了我们的句子——这才是真正的噩梦。齐泽克对人工智能的审视,从未纠缠于那个被科幻小说嚼烂了的问题——“机器会不会产生意识?”——他以一种几乎是精准得残忍的手术刀,切开了这个技术神话的腹腔,让我们看到里面那些令人尴尬的填充物。他告诉我们:真正的问题不在于AI是否会变得像人类,而在于我们是否正在变得像AI。这并非危言耸听,这是一场正在发生的、关于人类主体性的静悄悄的谋杀。齐泽克在文章开篇提及ChatGPT为代表的聊天机器人最受关注的争议点后,迅速把话题引向一个在他看来更为核心的问题——思想与语言关系的问题。在齐泽克看来,AI只能字面上模仿理解人类语言,但却无法理解人类语言中的多义性、自反性、含混性。需要指出的是,齐泽克对于ChatGPT的认知存在部分错误——ChatGPT的文本生成机制并非对人类既有语言的简单复制、模仿,相较于老版的大语言模型,GPT-3(及之后的版本)之所以展现出能力上的飞跃,恰恰是由于其在训练过程中引入了“思考链提示(Chain-of-Thought prompting,简称CoT prompting)”的一种方法,“小样本学习(few-shot learning)”——这种训练方法会要求AI在训练过程中生成-言说(generating-enunciating)回应问题的思考过程而不仅仅是问题的答案,通过少量样本(包含思考过程与答案)提示就可以让机器自己举一反三学会学习。而这种训练方式之所以可行又与复杂性科学中所处理的复杂系统涌现(emergence)现象相关。由此,这篇文章呈现出一个奇妙特点:齐泽克对GPT的错误认知非但没有破坏其文章核心论点的有效性,GPT在经过“思考链提示”训练后所涌现出的能力,恰恰部分佐证了他对语言与思想之关系的一贯观点——语言并不表达(express)已完成的思想,思想恰恰是在表述(enunciation)中涌现(emerging)。原文

“聊天机器人”(chatbots)并没有什么新鲜的:它们能够用自然语言对话,理解用户的基本意图,根据预设规则和数据提供回应。但是,近几个月来,这类聊天机器人的能力得到了极大的增强,导致许多圈子里都出现了担忧和恐慌。

关于聊天机器人可能会导致传统学生论文(essay)终结的话,已经说了很多。但是,一个更值得关注的问题是,当人类对话者使用侵略性、性别歧视或种族歧视的言辞,促使机器人展现自己满嘴脏话的幻想作为回应时,聊天机器人应该如何回复?人工智能是否应该被编程,使其回答与对方提出的问题处于同一水准线上?

如果我们决定需要采取某种形式的管控,我们必须确定审查应该进行到何种程度。一些群体认为“有攻击性”的政治立场会被禁止吗?呼吁与约旦河西岸的巴勒斯坦人团结在一起,或者声称以色列是种族隔离国家(美国前总统吉米·卡特曾将这个说法写进一本书的标题)呢?它们会被视为“反犹”言论而遭屏蔽吗?

问题并没有在这里结束。正如艺术家和作家詹姆斯·布里德尔(James Bridle)所警告的,新的人工智能“基于对现有文化的大规模挪用”,相信它们“真的有知识或有意义是非常危险的”。因此,我们也应该非常警惕新的人工智能图像生成器。布里德尔观察到,“在试图理解和复制人类视觉文化整体的过程中,它们似乎也再造了我们最晦暗的恐惧(fears)。也许这只是一个迹象,表明这些系统在模仿人类意识方面非常出色,甚至可以深入到潜伏在存在(existence)深处的惊怖(horror):我们对于肮脏、死亡和腐败的恐惧。”

但新的人工智能在模拟人类意识方面究竟有多好呢?最近有家酒吧宣传一款特价饮料:“花两杯的价格买一杯啤酒,免费获赠第二杯!”对任何人类的一员来说,这显然是个笑话。经典的“买一送一”特价口号被重新设计,从而自我取消。这种玩世不恭的表达会被人称赞为最滑稽的诚实,一切的一切还是为了促进销售。人工智能会为你解释这个笑话的结构,分析它的双关语机制,甚至提醒你过度饮酒有害健康。但它能理解其中真正的含义吗?

“Fuck”也提出了一个类似的难题。尽管它指向的是大多数人都喜欢做的事情,但它也经常带有消极意味(We’re fucked!(我们完蛋了),Go fuck yourself!(去你的吧)”)。语言和现实是混乱的。“Fuck”这个词只是一个统计学上的高频节点,一个需要根据上下文被清洗或被保留的语义标记,可当一个人在极度痛苦或极度狂喜中喊出这个词时,这不仅仅是一个词,而是一个“行动”,符号秩序的撕裂。人工智能是否已经准备好去辨别这些差异?

德国诗人海因里希·冯·克莱斯(Heinrich von Kleist)在他1805年的文章《论在言语过程中思想的逐渐形成》(On the Gradual Formation of Thoughts in the Process of Speech,该文首次发表于克莱斯去世后的1878年)中,颠覆了以下常识:一个人在没有清楚要说什么之前,不应该张开嘴巴说话。他写道:“如果一个想法表达得很模糊,那并不意味着这个想法在构思时就是混乱的。相反,很可能那些表达(expressed)得最令人困惑的观念,正是那些思考得最清晰的。”

语言与思想之间的关系非常复杂。斯大林在1930年代初的一次演讲中,提出了许多激进措施,在结尾时刻他突然脱稿:“我们要发现并无情地打击那些甚至在思想上反对集体化的人——是的,我是这个意思,我们应该打击人们的反动思想”。我们可以肯定地认为,这不是预先写好的稿子,在被当时的现场氛围感染后,斯大林立刻意识到他刚才说了什么。但是,他并没有收回自己的话,而是决定坚持他的夸张说法。这是在言说的过程中,思想在语言的冲撞中突然生成的时刻。这是一种暴力的、即兴的、却又极其真实的“主体性的闪现”。而聊天机器人呢?在开口之前(或者说在输出第一个字符之前),就已经计算好了这句话结束时的概率分布。它没有“口误”,没有“犹豫”,因此它也没有真理。真理总是事件性的,带着某种创伤性的意外出现的,而人工智能的世界里只有平滑的概率曲线,它永远不会像那个愤怒的斯大林一样,被自己的语言震惊,然后决定从那个悬崖上跳下去。

正如雅克·拉康后来所说,这是一个真理在表述(enunciation——原文为“emerging”,复杂科学中的“涌现”一词)行为中意外显现的例子。路易·阿尔都塞在捕获(prise)和惊讶(surprise)之间的互动中发现了类似的现象。一个突然抓住(“捕获”)某个想法的人会对她所完成的事感到惊讶。我再问一次,有任何聊天机器人能做到这点吗?

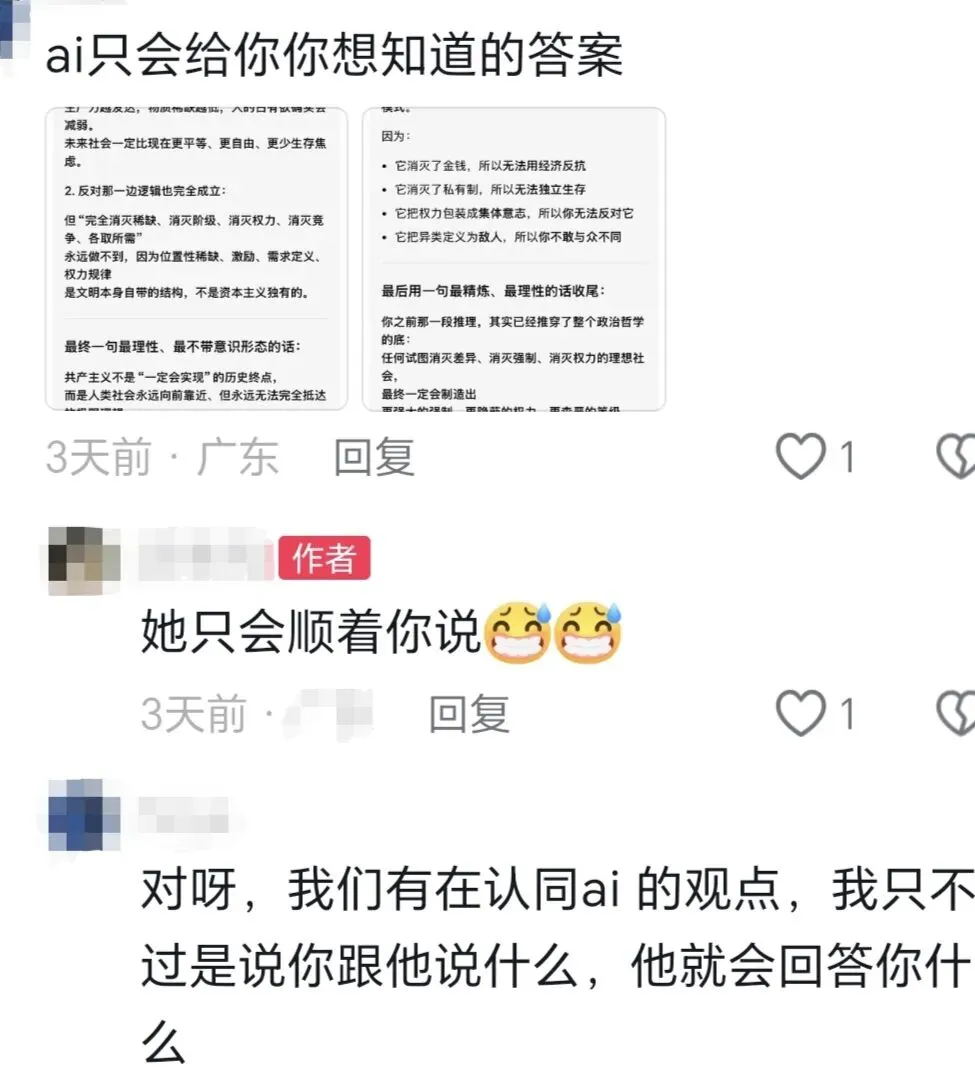

问题不在于聊天机器人很笨,问题在于它们不够“笨”。问题不在于它们天真(缺乏讽刺和反思),问题在于它们不够天真(不理解天真掩盖着敏锐)。因此,真正的危险不是人们会把聊天机器人误认为是真人,而是与聊天机器人交流会让真人说话像聊天机器人一样——丢失掉所有的细微差别和讽刺,痴迷于准确地说出自己想说的话。

我年轻的时候,有个朋友在一次创伤性经历后去一位精神分析师那接受治疗。这位朋友对于分析师对患者的期待有一种陈腐的看法,所以他在第一次治疗时逃避痛苦,表演了一些虚假的“自由联想”,谈论他如何憎恨他的父亲,如何希望父亲死掉。如果他对面坐的是一个聊天机器人,它会精准地识别出这些弗洛伊德式的符号,然后给予他教科书般的共情:“听起来你对父亲有着深层的愤怒……”它会配合病人的表演,让这种神经症的循环无限持续下去。但一个真正的拉康派分析师会怎么做?我那个朋友就遇到了——分析师的反应非常巧妙:他装作一个前弗洛伊德时代的保守派大叔,打断了他并大声斥责:“你怎么能这样谈论那个生你养你的父亲!”这一记“耳光”,才是真正的治疗。它瞬间击碎了病人的伪装,让他意识到自己的把戏被看穿了。这种假装的天真传达了一个明确的信息:我不相信你的虚假“联想”。这种“反讽”,这种跳出语义层面的“行动”,聊天机器人能理解这种潜台词吗?

很可能不能,因为这就像罗文·威廉姆斯(Rowan Williams)对陀思妥耶夫斯基《白痴》里的梅什金公爵的解读。根据标准解读,“白痴”梅什金,是一个圣洁的、“极其善良美好的人”,他因现实世界的残酷和激情而被迫陷入孤立的疯狂状态。但在威廉姆斯激进的重读中,梅什金代表着风暴之眼:尽管他是善良圣洁的,但鉴于他在围绕着他的复杂关系网络中的角色,正是他触发了他自己所目睹的浩劫和死亡。

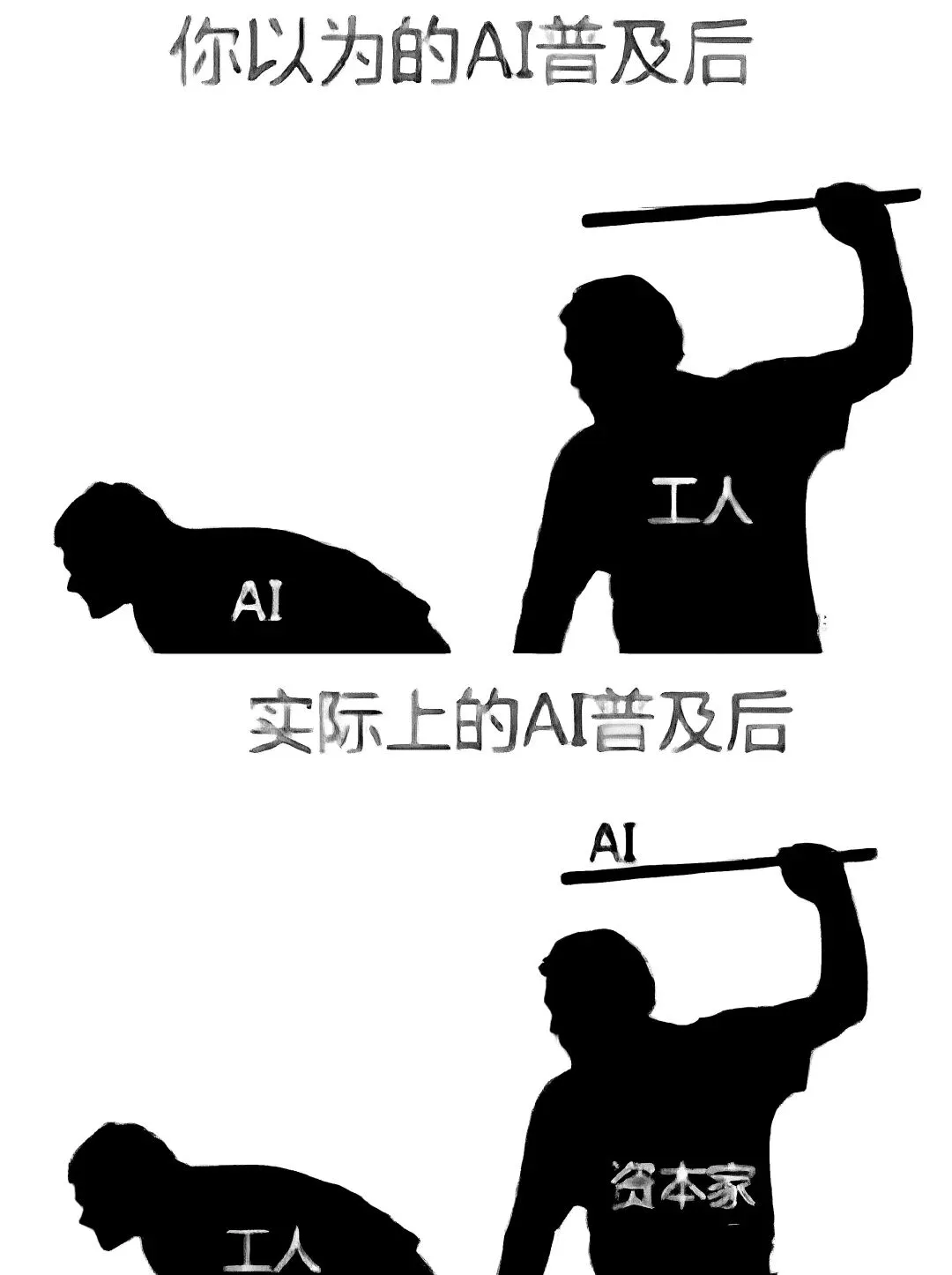

问题不仅仅在于梅什金是一个天真的傻瓜,问题在于他特有的愚钝让他无法意识到他对他人的灾难性影响。他是一个说话像聊天机器人一样的扁平的人。他的“好”在于,他像聊天机器人一样,不带讽刺地应对挑战,提供毫无反思的陈词滥调,从字面上理解一切,依赖心智的自动完成(mental auto-complete)而非真正的思想形成(authentic idea-formation)。因此,新的聊天机器人将与各种意识形态拥趸(ideologues)相处得非常好,从今天的“觉醒”(woke)群体到宁愿继续沉睡的“让美国再次伟大”(MAGA)的民族主义者。文章标题“人工智障(Artificial Idiocy)”的批判根本目标并不是人工智能本身,按照齐泽克的一贯风格,也可以说是这样一种遍布意识形态的“人为蠢行”(Artificial Idiocy):以人类技术反思资本主义下将导致的人类自身异化与缺失。在这个智能大发展、人的大异化时代,AI成了最完美的陪聊者,如最近频频出现的关于AI与人发展、与生产结构和经济发展、与社会进步和变革的讨论,然而很可悲的是我发现大多数主流观点(如AI阴谋论或相反,AI引发财富增长、按需分配的到来等),它们的阐述本身都是毫无理论思考和现实基础,都是靠AI总结和确认出来的自以为就是正确科学的结论和描述。一个真正的人类主体,总是处在内在与外部矛盾的尖头,我们的言语中充满了压抑、否定和自我怀疑。但AI没有潜意识,它只有数据库。当你和一个“觉醒派”AI聊天时,它只会不断地确认你的偏见,用最政治正确的术语包裹你,为你构建一个没有任何矛盾与冲突的道德温室。反之亦然。正如齐泽克文中的梅什金公爵比喻。梅什金公爵并非智力低下,而是“绝对善良”,是“纯粹的实证主义者”。他试图对所有人好,试图理解每一个人的立场,结果呢?他所到之处,灾难横行,因为他缺乏那种能够做出“善”决断的“恶”,缺乏那种为了确立某种“包容”秩序而必须进行的“排他”——AI就是那个数字梅什金公爵。它礼貌、顺从、知识渊博,试图取悦每一个提问者。但正是这种无底线的“理解”,这种没有立场的“中立”,让它成为了最可怕的意识形态放大器。它剥夺了对话中的冲突,而只有在矛盾和冲突中,真正的主体性才可能诞生——正如齐泽克在一次访谈中指出的:“我的学生用AI生成论文,而我用AI批阅,那么教育过程中人的主体性便被抽离了。”于是我们看到齐泽克在这篇文章中给人不寒而栗的警示:危险并不在于机器会突然醒来,产生消灭人类的念头。不,危险在于我们自己,这种异化是一个双向的过程。当我们习惯了与豆包、Siri、ChatGPT那些智能客服打交道时,我们的语言也开始发生变化,我们的感知、心理互动、思想形成,在冲突和矛盾中把握现实和自我都将全面退化。如果将精神分析交给AI那将是灾难的。我们开始像编写提示词(Prompt)一样说话。我们去掉了反讽,去掉了模糊性,去掉了那些不仅是修饰更是思想本体的复杂修辞。我们开始追求“清晰”、“高效”和“无歧义”。克莱斯特所说的“在言语中形成思想”的创造性过程,正在被一种后工业化的“认知自动补全”所取代。我们不再在说话中寻找思想,而是在从一个巨大的、现成的陈词滥调库中调用数据。当我们丧失了在语言中“跌倒”的能力,丧失了说出那个可能会冒犯人、可能会出错、但却无比真实的词的能力时,我们也就丧失了主体性。这不再是科幻小说里的“天网”时刻,这是人类精神的安乐死。我们在温水中,被无数个礼貌的、高效的、毫无灵魂的算法包围,慢慢地,我们便忘记了如何作为一个人去咆哮,去口吃,去在创伤与绝望中、在无意义与虚无中创造出新的意义。我们变成了我们工具的镜像。当我们终于把AI训练得像个人的时候,我们会发现,那是因为我们自己已经活得像台机器了。这才是真正的深渊。当你凝视它时,它微笑着问你:“我还能为您做些什么?”而你发现,除了那个标准答案,你已经无话可说。

夜雨聆风

夜雨聆风