AI安全三大致命隐患:投毒、对抗、偏见,一篇读懂全面防护,拒绝被动踩坑

在AI普及的今天,我们每天都在和AI打交道:早上用AI查天气,上班用AI写文案、做报表,晚上用AI聊天、追剧,甚至企业用AI做决策、做安防——AI已经成为我们数字生活、工作中不可或缺的一部分。但与此同时,AI安全的威胁也越来越突出,模型投毒、对抗攻击、算法偏见,这三大致命隐患,正悄然威胁着我们的隐私、财产、权益甚至社会公平,让我们在享受AI便捷的同时,也面临着“被动踩坑”的风险。

很多人对AI安全的认知,还停留在“黑客攻击”的层面,觉得只要做好数据防护,就能高枕无忧。但事实是,随着AI技术的升级,模型投毒、对抗攻击、算法偏见的手段越来越隐蔽、越来越高明,单一的防护手段,早已无法抵御这些安全威胁。今天,我们就一次性讲透这三大AI安全致命隐患,教你全面筑牢AI防护防线,拒绝被动踩坑。

先说说模型投毒,这是最隐蔽、最具破坏性的AI安全隐患,也是黑客最常用的攻击方式。它的核心是黑客通过篡改AI训练数据、植入恶意代码,让AI模型“学坏”,从而实现窃取数据、篡改结果、瘫痪系统等目的。比如黑客在AI办公工具的训练数据中植入虚假信息,导致企业使用AI做报表时出现重大失误;在AI聊天助手的训练数据中植入恶意话术,诱导用户泄露隐私。

防范模型投毒,核心是“选正规、多核对”:个人用户优先使用官方、正规渠道的AI工具,不下载小众、无资质的AI插件和模型;对AI生成的内容,尤其是涉及财务、合同、机密文件等重要内容,一定要进行人工核对,不盲目采信;不向AI输入核心隐私信息,遇到AI索要敏感信息时,直接拒绝。企业要加强AI模型的管控,优先使用自主研发或正规第三方的AI模型,定期检测模型安全性,及时修复漏洞。

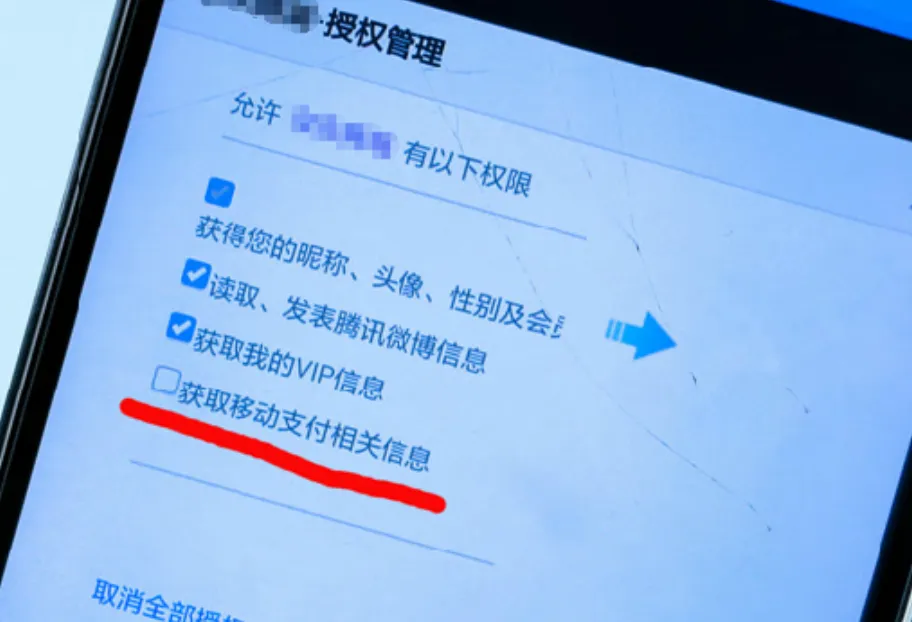

再来说对抗攻击,这是最容易实施、最贴近普通人生活的AI安全隐患。它的核心是黑客通过对输入AI的图片、语音、文本做微小修改,添加干扰信息,让AI的算法出现误判,做出错误的决策。比如在图片上添加细微噪点,让AI把正常图片识别成违禁物品;修改语音频率,让AI把“拒绝支付”识别成“确认支付”,进而实施诈骗。

防范对抗攻击,关键是“不盲目、多警惕”:个人用户不随意接收、识别不明来源的图片、语音、文本,避免被植入干扰信息;涉及身份验证、支付、安防等敏感场景,不单纯依赖AI识别,一定要添加人工核对环节;定期更新AI工具和设备系统,开启安全防护,提升抗攻击能力。企业要加强AI算法的防护,定期对AI模型进行对抗性测试,及时修复算法漏洞,避免被黑客利用。

最后是算法偏见,这是最容易被忽视,却最影响个人权益的AI安全隐患。它的核心是AI的训练数据存在偏差、算法设计不完善,导致AI产生偏见,做出不公平、不合理的决策,影响我们的就业、贷款、消费甚至社会公平。比如AI筛选简历时存在性别偏见,拒绝优秀女性求职者;贷款平台的AI存在地域偏见,无故拒绝某些地区用户的贷款申请;购物平台的AI存在消费偏见,实施“大数据杀熟”。

应对算法偏见,核心是“善识别、护权益”:个人用户要学会识别算法偏见,遇到大数据杀熟、求职歧视、贷款不公等情况,及时向平台投诉、向相关部门举报,维护自己的合法权益;企业要规范AI算法设计,清洗训练数据,去除偏见,定期审核AI决策,及时纠正不公平现象;平台要加强监管,公开AI算法逻辑,接受用户监督,推动AI行业公平发展。

其实,AI安全的核心,从来都不是“事后补救”,而是“事前防范”。模型投毒、对抗攻击、算法偏见,这三大致命隐患,看似可怕,但只要我们做好全方位的防护,就能有效抵御。无论是个人用户,还是企业用户,都不能忽视AI安全——个人的AI安全,关乎隐私、财产和权益;企业的AI安全,关乎生存、发展和公信力;而整个AI生态的安全,需要我们每个人、每个企业共同守护。

在这里,给大家总结一个“AI安全防护口诀”,方便大家记忆和落实:正规AI才靠谱,来源不明不接触;生成内容多核对,敏感信息不泄露;干扰信息要警惕,人工核对不能少;算法偏见要识别,合法权益要守护。

数字化时代,AI是一把“双刃剑”,它能给我们带来便捷,也能给我们带来安全隐患。别再心存侥幸,觉得“AI安全与我无关”,在AI普及的今天,每一个使用AI的人,都可能成为安全威胁的目标。从今天起,做好AI防护,远离模型投毒、对抗攻击、算法偏见的威胁,主动守护自己的数字生活和合法权益,拒绝被动踩坑。

欢迎关注"AIoT智联慧讯"

免责声明 :

本文档可能含有预测信息,包括但不限于有关未来的财务、运营、产品系列、新技术等信息。由于实践中存在很多不确定因素,可能导致实际结果与预测信息有很大的差别。因此,本文档信息仅供参考,不构成任何违约或承诺。可能不经通知修改上述信息,恕不另行通知。

夜雨聆风

夜雨聆风