说起网络上的色情诈骗,大伙第一反应都是裸聊敲诈、低俗直播。

总觉得自己不随便露脸、不乱转账,就能躲得远远的。

可看完近日央视刚曝光的AI涉黄产业链,我是真的后背发凉,彻底惊醒了:

现在的危险,根本不是你主动避开就没事的,

它就像看不见的毒雾,工业化、零成本地往普通人生活里钻,

藏在日常聊天框、微信群,甚至随手弹出来的链接里,防不胜防。

以前的裸聊诈骗,好歹得真人出镜,一步一步诱导人上钩,成本不算低,也容易留下证据。

可AI一掺和进来,这事就彻底变味了,

这条黑色产业链,猖狂到没底线,比咱们想的要恶心多了。

央视调查说得明明白白,不法分子直接把AI当成了“造黄机器”,整条链分工细得很,跟工厂流水线似的,一环扣一环。

上游专门琢磨怎么绕开平台审核,用英文关键词、本地装模型,

轻轻松松就能一键生成大尺度的色情内容;

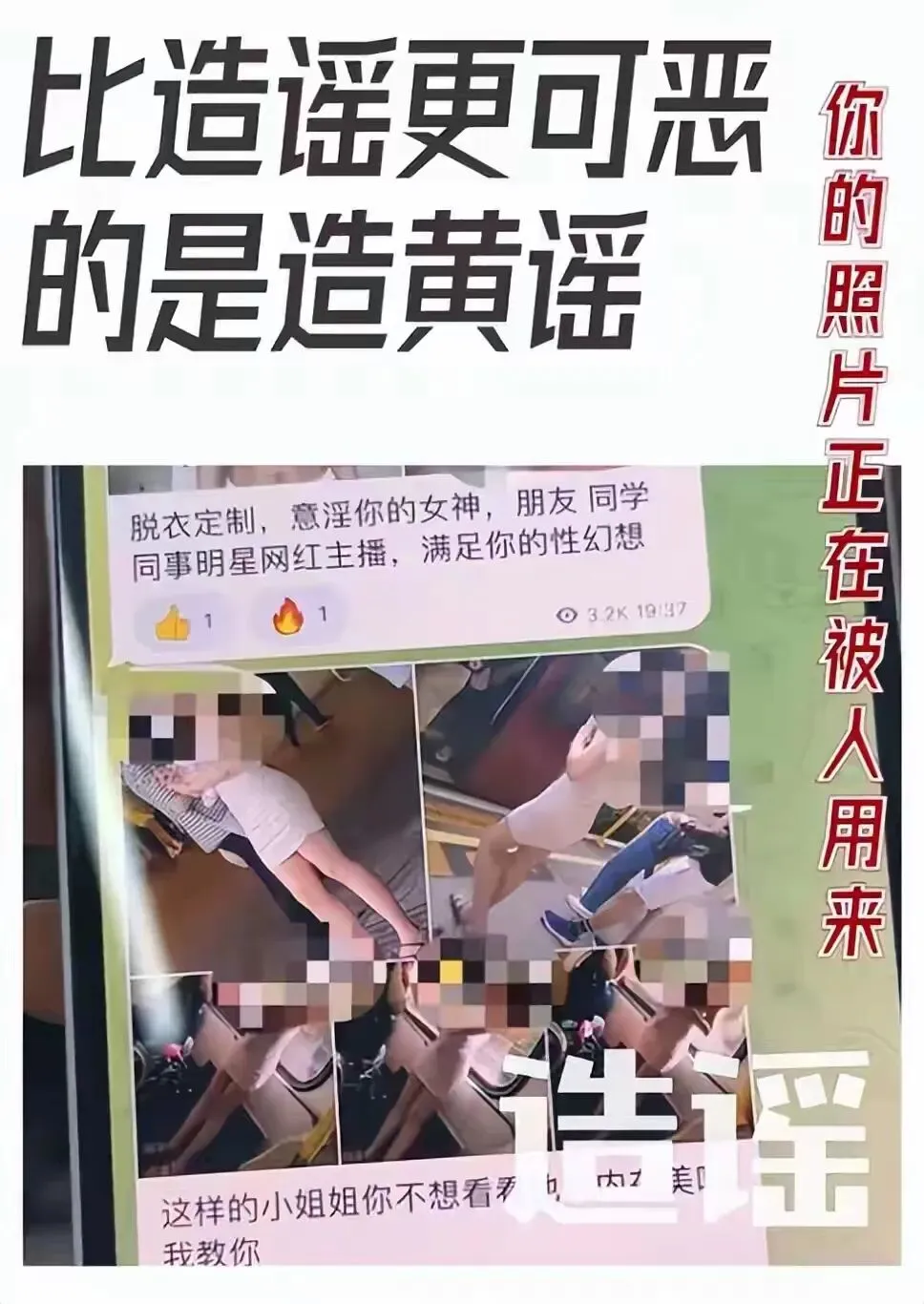

中游更过分,社交平台上公然叫卖:

9块9就能买全套造黄教程,

5块20块就能做AI脱衣、换脸,明码标价,一点都不遮掩;

下游更是无法无天,随便扒拉普通人发在网上的照片,恶意合成淫秽视频,

要么拿去敲诈,要么批量卖钱牟利,

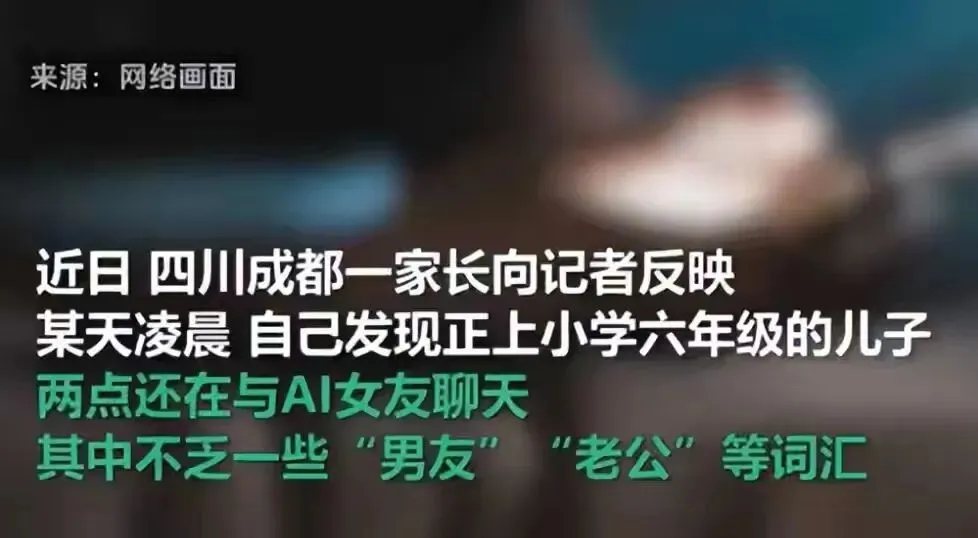

甚至还做境外的涉黄AI聊天软件,借着翻墙软件渗进来,专门盯着未成年人下手。

最让人害怕的是,这东西成本低到离谱,传播速度快得吓人。

不用真人露面,不用复杂操作。

你随手发朋友圈的一张生活照、一段自拍视频,被他们抓到,几秒钟就能合成不堪入目的东西。

你以为只是发个动态留个纪念,转头就成了坏人赚钱的工具。

被乱传、被抹黑,连辩解的地方都没有。

跟裸聊诈骗那种一对一设套比,

而AI涉黄的危害要隐蔽得多、范围也广得多。

裸聊只是盯着你的钱,可AI造黄,是不管你是谁,无差别伤害。

明星、普通人、未成年人,谁都可能遭殃。

照片被换脸,隐私被侵犯,名誉被糟蹋。甚至有人因为这些伪造的东西,被敲诈、被网暴,好好的生活全被搅乱。

更吓人的是,它无孔不入,群里的陌生文件、朋友发的奇怪链接、弹窗广告,都可能是陷阱,稍不留神就掉进去。

技术本来是往好的方向发展的,AI发明出来,是为了让生活更方便、做事效率更高。

可偏偏有些人心肠太坏,钻技术的空子,把好好的高科技变成了作恶的工具。

这种批量生产色情的做法,不光把网络环境搞得乌烟瘴气,更是踩了法律的红线,丢了最基本的道德底线。

咱们普通人拦不住技术往前发展,但能守住自己的底线。

别随便在网上发私密照片。

陌生链接不点,来路不明的软件不下载。看到涉黄、恶意合成的内容,立马举报。也希望监管能管得更严,堵住技术漏洞,狠狠惩罚这些不法分子,

别让AI变成藏在对话框里的黑手,别让技术进步,反倒成了伤害我们的武器。

AI作为颠覆性的新技术,本是推动时代进步的利器,

却被不法分子扭曲成牟利作恶的工具,实在令人痛心。

“科技是强大的催化剂,善用则兴,滥用则亡”,

技术从来没有对错,关键在于使用它的人,新鲜事物的价值,从来都体现在正向用途之上。

我们不该因AI被滥用就抵触新技术,也不能因贪图便利就放松警惕。

正如“君子使物,不为物使”所言,要做技术的主人,而非被技术牵着走。

面对AI这类新兴事物,既要拥抱它带来的便利,更要守住法律与道德的底线,管好自己的言行,护好个人隐私。

唯有“仰不愧于天,俯不怍于人”,坚守本心,才能让新技术真正服务于生活。

让科技回归向善的本质,这才是我们对待新兴事物该有的样子。

夜雨聆风

夜雨聆风