前言

三件最近发生的事,放在一起看,其实在讲同一个故事。OpenClaw,一个奥地利程序员独自写出来的开源 AI Agent 框架,在中国爆火到人们排队去腾讯总部装它,GitHub 星标超过 35.6 万。Claude Code,Anthropic 的旗舰编程 Agent,在 3 月 31 日凌晨因一个 .npmignore 的小失误,把 51 万行 TypeScript 源码暴露在了公网,几小时内被 fork 上万次。Hermes Agent,Nous Research 悄悄在二月发布的框架,两个月内涨到 71.9k stars,社区开始大规模从 OpenClaw 迁移。

这不是三条科技新闻。这是同一场底层范式迁移的三个截面——我们和 AI 协作的方式,正在经历一轮根本性的重构。

理解这场重构,需要从头讲起。

PART 1

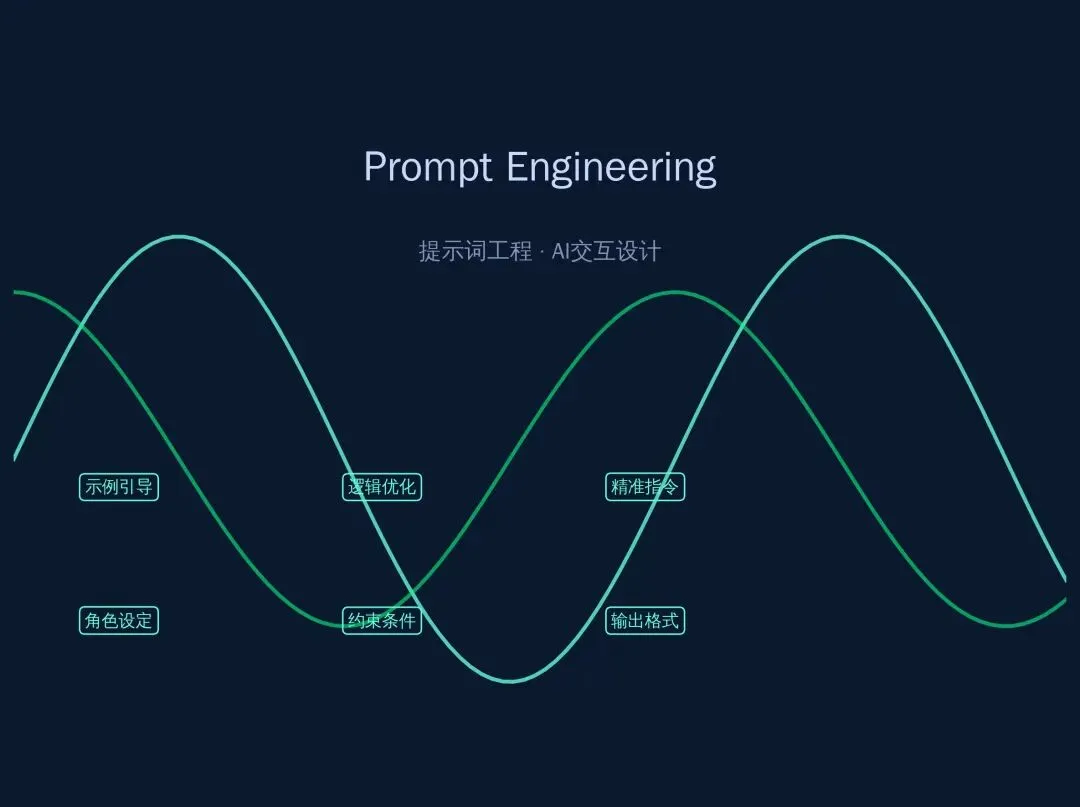

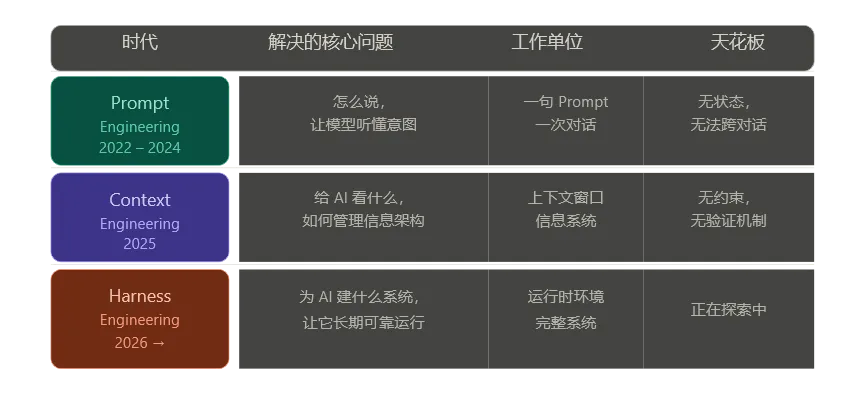

Prompt Engineering

最早和 AI 打交道,本质上是在解一道语文题:怎么说,才能让它听懂?

这个阶段涌现出了大量技巧。Few-shot learning,给几个例子让模型学会套路。Chain-of-Thought,要求模型一步步推导而不是直接跳结论。角色扮演,把模型扮成某个专家来激活特定的"模式"。XML 结构化输出,用标签约束格式让结果可被程序解析。有人专门研究哪些词放在句首最能激活模型注意力,哪种语气能让它更"认真",甚至有人写出了 Prompt Engineering 的完整方法论。

这些东西是真的有用的。一个写得好的 Prompt,和一个随手打的问题,得到的答案质量差距可以非常大。

但它有一道无法逾越的天花板:出了这个对话框,AI 什么都不知道,也什么都不记得。

你在跟一个每天早上都会失忆的天才顾问打交道。他能力超群,但昨天聊过的项目背景、你们建立的工作默契、上次他理解的你的偏好——一概清零。你可以把 Prompt 写得无比精准,但他接收到的,依然只是这一刻这一句话。

当你的需求是"帮我回答一个问题",这没问题。但当你的需求变成"帮我完成一个项目",Prompt Engineering 就不够用了。

PART 2

Context Engineering

2025 年中,Andrej Karpathy 说了一句话,在 AI 工程师圈子里传开了:

"Context engineering is the most important skill."

Shopify CEO Tobi Lütke 随后跟上: "Context engineering is the new skill."

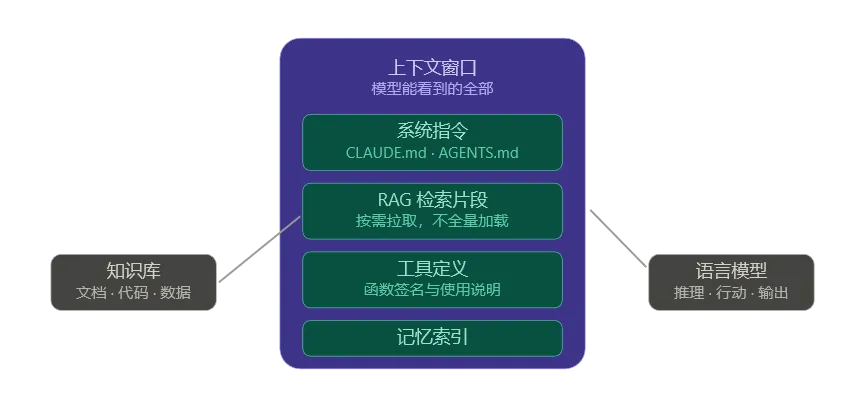

这句话的意思,不是说 Prompt 不重要了,而是说思考的粒度变了。不是"这句话怎么说",而是"在这次推理发生时,模型能看到什么"。

上下文窗口是一块寸土寸金的 RAM。你需要工程化地管理它:哪些信息要常驻,哪些按需加载,哪些压缩存储,哪些永远不需要被读进来。这是一个系统设计问题,不再只是一个语言技巧问题。

Context Engineering 的核心实践包括:用CLAUDE.md/AGENTS.md 给 Agent 一份"开工前必读",写清楚项目结构、规范和禁区;用 RAG(检索增强生成)从知识库里动态拉取相关片段,而不是把整本手册塞进去;对静态指令和动态上下文做切割,让 prompt cache(提示词缓存)真正生效,避免每次重新计费;设计记忆系统,让信息在会话之间流转而不是每次从头开始。

Claude Code 泄露:意外的公开课

3 月 31 日那次泄露,在安全圈引发了很多讨论,但对工程师群体来说,它更像是一堂意外的公开课。51 万行代码里,最值得研究的不是功能列表,而是 Anthropic 工程师们实际上是怎么做 Context Engineering 的。

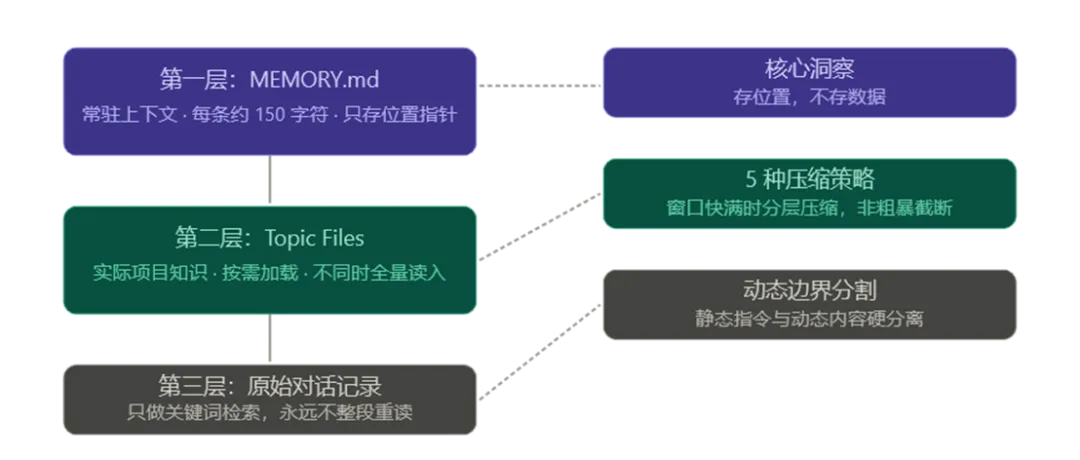

其中最精妙的是三层记忆系统:

MEMORY.md 不存数据,只存指针——每条记录大约 150 个字符,告诉 Agent"关于这件事的详细信息在哪里",而不是把详细信息本身塞进常驻上下文。真实的项目知识住在独立的 Topic Files里,只在需要时加载。原始的对话记录从不被整段重读,只在需要查找特定信息时做 grep(Unix 系统里的文本精准搜索命令,这里借指关键词匹配而非全文扫描)式检索。这个设计背后的核心洞察是:上下文窗口里的每一个 token(模型处理的最小文本单元)都是稀缺资源,应该放路标,不应该放地图集。

Context Engineering 是一个真正的范式升级。它把思考的对象从"一句话"变成了"一个信息架构"。但它依然有盲区:信息给对了,Agent 还是会跑偏。跑了五十步之后行为退化怎么办?模型评估自己的输出时有没有可靠性?多个 Agent 并行执行时上下文互相污染怎么处理?这些不是信息问题,而是系统问题。

PART 3

Harness Engineering

"Harness"这个词来自马具——马勒、缰绳、马鞍,那整套让骑手能驾驭马的装备。这个比喻非常精准:不是替代马的力量,而是把它引向正确方向。

2026 年 2 月,两件事几乎同时发生。HashiCorp 联合创始人 Mitchell Hashimoto 在博客里使用了"harness engineering"这个术语来描述他的工程实践。几天后,OpenAI Codex 团队发布了一份实验报告:从 2025 年 8 月到 2026 年 1 月,5 个月时间,团队从 3 人扩展到 7 人,合并了约 1500 个 PR(Pull Request,代码合并请求),写了近 100 万行代码——其中人工编写的行数是零。

但这个结果不是一开始就实现的。报告里说得很清楚:早期生产力很低,不是模型不行,是harness 没建好。每次改进 harness,生产力就跳一个台阶。 Harness 才是产品,模型只是引擎。

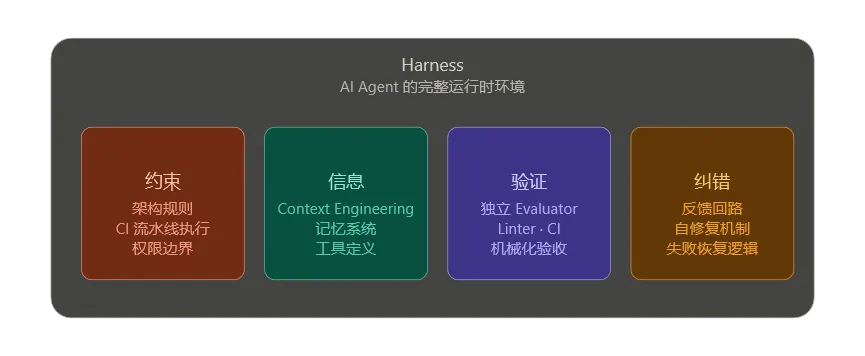

Harness 的四根支柱里,具体来说:

约束是架构层面的硬规则——依赖方向、文件边界、禁止操作,不是建议,是 CI(持续集成,Continuous Integration)流水线强制执行的。代码写错了方向,pipeline 直接拦截,不让合并。

信息就是前一章讲的 Context Engineering 的全部成果,在这里作为 harness 的一个组成部分,负责确保 Agent 在任何时刻都能拿到它需要的信息,且只拿它需要的信息。

验证这根支柱格外值得强调。Anthropic 的研究表明,模型不能可靠地评估自己的输出——这个发现影响深远。你不能让 Agent 既是运动员又是裁判。解决方案是 GAN 式(生成对抗网络,Generative Adversarial Network,借用它"生成者与判别者相互独立"的思路)的双 Agent 架构:一个 Generator(生成器)负责产出,一个独立的 Evaluator(评估器)负责裁判。这不只是防错机制,它从根本上改变了 Agent 系统的可靠性上限。

纠错是当事情出错时真正发生的那层逻辑。不是简单的重试,而是能理解失败原因、修正执行路径、写回经验的闭环机制。

一个具体的数字说明 harness 的价值:LangChain 的 coding agent,模型一行没换,只改了 harness 里的编辑格式——引入了一种基于行哈希(hash)的引用方式,让模型不需要精确复现原文就能修改代码——Terminal Bench 2.0 得分从 52.8% 直接跳到 66.5%,排名从 Top 30 进了 Top 5。改变的不是智能,是工具。

PART 4

OpenClaw:把Harness变成文件系统

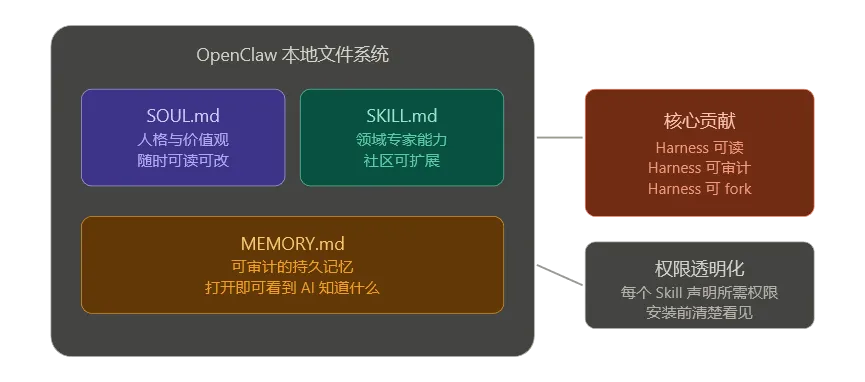

OpenClaw 最大的贡献,不是功能,而是把抽象的 harness 概念具象成了人人可以打开、读懂、修改的文件。

SOUL.md 定义 Agent 的人格和行为准则,是 Harness 里"约束"支柱的人格化表达。SKILL.md 是按需加载的领域能力,技能即文件,社区可以自由贡献和扩展。MEMORY.md 存储可审计的持久记忆——你可以随时打开这个文件,看到你的 Agent 到底"知道"什么。

这种透明度在工程上是一把双刃剑:它让 harness 从工程师的专属领域变成了开源生态,但也使攻击面变得更大——一封精心构造的邮件就可能通过 Agent 读取内容的方式注入恶意指令,也就是所谓的 prompt injection(提示词注入攻击)。这也是 OpenClaw 安全事件频发的根本原因之一。

PART 5

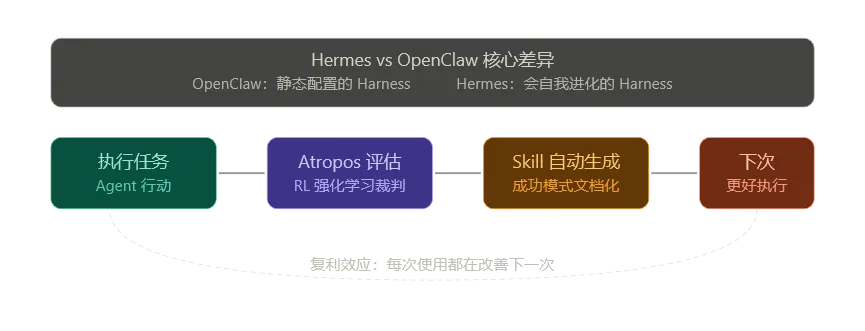

Hermes:让 Harness自己进化

Hermes 的核心是 Atropos RL(强化学习,Reinforcement Learning)框架——这是 Nous Research 内部用来训练更好的工具调用模型的强化学习框架,被直接集成进了 Agent 运行时。每次成功的任务执行,交互模式被强化;失败的路径,被记录修正。更重要的是,完成一类任务之后,Hermes 会自动将成功的执行模式提炼成可复用的 Skill 文档,下次遇到同类任务时自动调用。

这带来了一个 OpenClaw 无法实现的复利效应:Harness 不再只是被搭建的,它在被使用的过程中持续变好。 知识在系统里沉淀,不再只存在于用户的脑子里。

两个月内从零到 71.9k stars、大量用户从 OpenClaw 迁移过来还有一个直接理由:安全性。OpenClaw 累积了多个已知 CVE(通用漏洞披露,Common Vulnerabilities and Exposures),其中 CVE-2026-25253 的CVSS(通用漏洞评分系统,Common Vulnerability Scoring System)评分高达 8.8;Hermes 到目前为止Agent CVE 数量为零。这不是巧合,而是架构设计时就把安全边界作为一等公民的结果。

PART 6

尾声:一张演化图

这三次演化不是相互替代的关系。每一代都包含上一代,并在此基础上把视野扩展了一个层次。Prompt Engineering 没有消失,它成了 Context Engineering 的基础组件;Context Engineering 没有消失,它成了 Harness 的信息支柱。每一次升级,都是在上一层的天花板上凿开一个新的维度。

还有一个值得记住的事实:Meta 在2025 年底以约 20 亿美元收购了 Manus。买的不是模型——Manus 用的是 Anthropic、OpenAI 的基础模型。买的是它第五次重写的 harness。在模型能力日益趋同的今天,系统设计才是真正的护城河。

回头看这三年,有一条隐藏的主线:我们对 AI 的控制粒度,在持续下沉。 Prompt Engineering 时代,我们控制的是语言——一句话怎么写。Context Engineering 时代,我们控制的是信息——让模型看什么、不看什么。Harness Engineering 时代,我们控制的是环境——把整个运行时做成一个工程对象来设计和迭代。每一次下沉,都意味着更大的杠杆,也意味着更高的工程复杂度门槛。

这也是为什么这三件事——OpenClaw 爆火、Claude Code 泄露、Hermes 崛起——放在同一个时间窗口里看,会觉得如此密集。这不是巧合,这是一个行业在同一时刻集体跨过某个阈值的信号。OpenClaw 让 Harness 从论文走进了 GitHub。Claude Code 的泄露让工程师第一次看清楚了顶级 Harness 的内部截面。Hermes 让 Harness 本身也成为一个可以学习、可以进化的系统。

你现在写的每一行 CLAUDE.md,每一条 AGENTS.md 规则,每一个 RAG pipeline 的设计决策,都是在做 Harness Engineering——只是你可能还没有用这个词称呼它。而当你开始用这个词思考的时候,你对这件事的理解,就已经升了一个维度。

PART 7

写在最后

有人调侃,在 AI 时代,学习得慢就不用学习了。

但真正的问题不是学不学,而是你是否还在跟上变化。

从 Prompt 到 Context,再到 Harness,AI能力在快速迁移。很多人还在优化提示词,行业已经在重构系统。

模型会变强,但不会提醒你已经落后;工具在进化,但认知需要自己更新。

所以关键不只是“会用”,而是持续理解最新技术演进,并及时调整自己所处的位置。

这一代人的差距,不在努力,而在你停留在哪一层范式里。

夜雨聆风

夜雨聆风