数据、架构与物理常识,三维交汇处的下一个十年

引言 AI的下一代命题,从语言走向空间

过去十年,人工智能的主旋律是语言。GPT系列展示了惊人的知识整合与推理能力,让人们习惯了用文字与AI交流、用文字描述任务。2025年末,李飞飞在一篇万字长文中提出了一个根本性的追问:如果AI的下一代是空间智能,仅靠语言模型足够吗?她的答案是:不够。真正理解物理世界,需要一种全新的能力——世界模型。

什么是世界模型?李飞飞的定义简洁而清晰:世界模型是一种生成模型,能够理解、推理、生成和交互复杂的虚拟或真实世界。它需要同时具备三种能力——生成能力(几何一致、物理一致地模拟世界)、多模态能力(处理图像、视频、文字、动作等多种输入)、交互能力(根据行动和目标预测下一个世界状态)。

第一章为什么语言模型无法独立构建世界模型

理解世界模型为何困难,先要理解语言模型擅长什么、不擅长什么。

语言模型的强项:知识整合与推理

GPT系列展示了惊人的知识整合能力——能记住数万亿Token的语料,能在不同领域进行逻辑推理,能写出流畅的文章和代码。这些能力建立在对文字的统计规律建模之上:当模型见过的文字模式足够丰富,它能在新场景中复现和组合这些模式。这是语言模型的本质——对符号序列的分布建模。

语言模型的结构性局限:对物理世界的"语言式理解"

但语言对物理世界的描述是高度抽象的。当我们说"把玻璃杯放到桌上",这句话在语言模型那里会解析为token序列,而在真实物理场景中,这个动作涉及对力矩的感知、对摩擦力的估计、对杯子重心偏移的实时修正——这些信息在文字描述中几乎完全缺失。

更深层的局限在于:语言模型处理的是符号序列,对物理世界的时间性和空间性缺乏天然的理解。"杯子从桌面掉落"——这个过程在语言中只是一句话,但在物理中是一个连续的时间过程,涉及重力、空气阻力、弹性碰撞、碎片分布……语言无法承载这些连续物理过程的完整细节。

这意味着:构建世界模型,需要一种不同的数据、一种不同的架构、一种不同的学习目标——不是更多文本,而是更多关于物理时空的经验。

第二章两条技术路径的各自贡献

当前探索世界模型的技术努力,主要沿两条路径展开。它们各自解决了问题的不同层面,不是对立,而是互补。

路径一:数据规模化路线——从大规模数据到空间涌现

这条路径的核心逻辑是:当训练数据足够丰富、足够多样,覆盖了足够多的视觉、物理和动作场景,模型会自发形成对空间关系的理解——智能从数据中涌现,而非被手工设计出来。

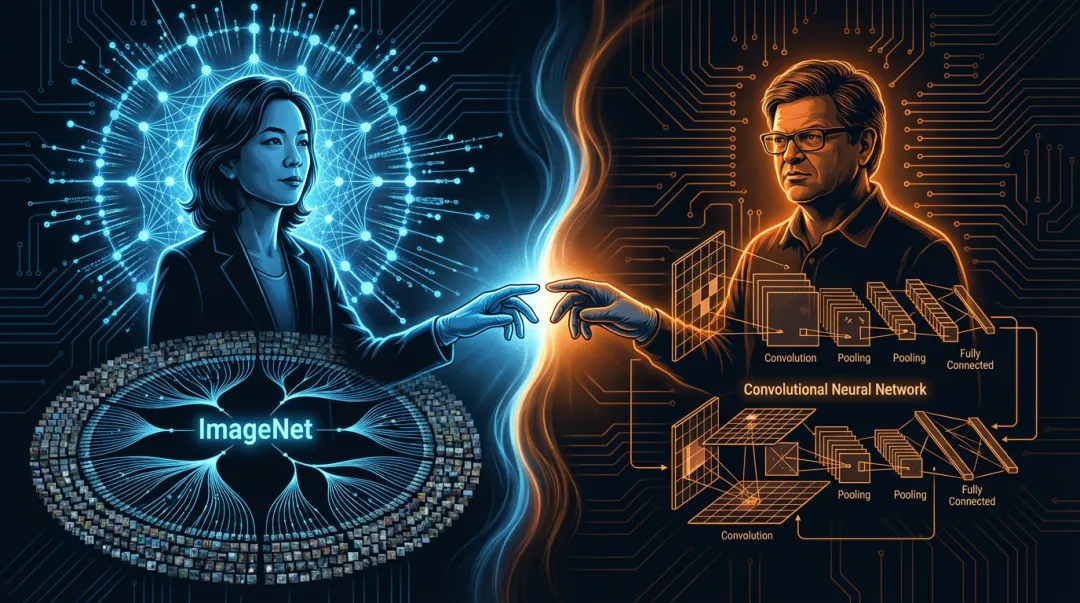

从ImageNet到CLIP、MAE、DINOv2,这条路线在视觉领域逐步验证了一个假设:自监督学习配合大规模图像/视频数据,可以让模型学会丰富的空间和物理直觉。RT-2、ACT-1等视觉-语言-动作模型则进一步证明,当这种视觉理解与动作数据结合,机器人可以直接从"看到"映射到"做到"——不需要显式建模物理方程。

李飞飞主导的World Labs在2025年底推出了Marble,首款商用世界模型产品。只需一句话,Marble就能生成精确到几何细节和物理属性的3D场景——这正是数据规模化路线在空间智能领域的一次重要验证。它证明了:当数据足够丰富、架构足够适配,生成式世界模拟不是梦。

路径二:结构归纳偏置路线——从物理先验到因果推理

这条路径的核心逻辑是:物理世界有其固有的结构规律,将这些规律以结构先验的形式嵌入模型,可以让模型用更少的数据、更可靠地掌握空间理解能力。

杨立昆提出的JEPA(联合嵌入预测架构)是这条路线最具代表性的创新。它的核心思路是:不做像素级的预测(Sim-to-Real gap太大),而在抽象表征空间中预测世界的下一步状态。这既保留了结构归纳的效率优势——让模型学习"高层次的物理规律"而非像素级重建,又借助了自监督学习从海量数据中吸收知识的能力。

在这条路线上,还有一批重要的底层工作:NeRF通过神经辐射场实现3D场景的隐式表征;3D Gaussian Splatting提供了实时可微的3D场景渲染;diffusion model在视频生成领域的突破正在为物理仿真提供高质量数据来源。这些技术并不追求端到端的通用性,而是在各自擅长的领域提供可靠的空间建模能力。

第三章三个根本问题:数据、架构与物理常识

无论沿哪条路径前进,构建世界模型都绕不开三个根本问题。它们是当前所有技术路线的真实交汇处,也是真正的挑战所在。

问题一:具身数据从哪来

语言模型的数据可以来自互联网,但机器人在物理世界中感知的数据无法靠爬取获得。具身数据的采集成本极高——需要真实的机器人、真实的场景、真实的力反馈,而且每一条数据的标注都需要动作级别的标注,远比图片分类复杂得多。

三条解决思路正在被同时探索:仿真合成数据(Sim2Real)用虚拟环境批量生成训练数据再迁移到真实机器人;互联网视频学习从YouTube等视频中提取人体动作表征;数据飞轮通过量产机器人让真实使用数据不断回流。这三条路各自有效,但都尚未能完全解决规模问题。

问题二:什么样的架构适合空间推理

Transformer在语言和视觉理解上表现卓越,但它将所有输入token化为一维序列的处理方式,对三维空间信息的建模并不友好——物理世界的物体之间存在三维几何关系,将3D信息强行展平为1D序列会带来结构性效率损失。

新的架构探索正在多个方向展开:3D感知Transformer尝试在模型中保留3D结构信息;图神经网络直接建模物体间的关系网络;Neuro symbolic方法尝试将物理定律以规则形式嵌入。这仍是开放的前沿问题,尚无定论。

问题三:如何让AI理解因果

这是世界模型构建中最核心、也最困难的问题。"玻璃杯会碎"、"水会流动"、"门推开后会自动关上"——这些对人类来说是常识的物理规则,对AI而言并非从数据中自动习得。

数据规模化路线认为:只要有足够多的视频数据(涵盖各种物理现象),模型能从统计相关性中推断出因果关系。结构归纳偏置路线认为:必须将基本的物理守恒律以硬编码或软约束形式嵌入模型,否则即便数据再多,对因果的理解也是不可靠的。

目前最有效的路径可能是两者的结合:用大规模视频数据预训练一个"物理直觉"基础,再用结构化物理模型进行校准和修正——这类似于人类先用经验积累直觉,再用物理定律纠偏。

第四章具身智能的两层挑战:VLA与世界模型

2025年,VLA(视觉-语言-动作)模型成为具身智能领域的焦点。RT-2、ACT-1、π₀等模型展示了端到端"看到→做到"的强大能力——摄像头输入图像,输出直接是对机器人的控制指令。这让不少人认为具身智能的核心问题已经解决了。

但这个判断为时过早。VLA解决的是实时执行层的感知-动作映射,属于短时、局部、反应式的任务——把杯子拿起来、绕过障碍物、把抽屉关上。这类任务不需要显式建模重力、摩擦力或因果链条,只需要从海量数据中学会"在这种情况下这样做"的模式即可。

而世界模型要解决的是另一类问题:长程规划("我要花几步把这间屋子收拾干净")、因果推理("这个物体从这个高度掉下去会碎还是弹起来")、反事实预测("如果我施加不同的力,物体运动轨迹会怎样变化")。这些能力的缺失,正是当前VLA模型在全新场景中泛化能力仍然有限的根本原因。

因此,VLA和世界模型并不在同一个层次上竞争:VLA是执行层的工具,世界模型是认知层的支撑。真正完整的具身智能系统,需要世界模型做长程规划和推理,再用VLA执行实时的感知-动作映射。两条路线解决的是不同层次的问题,缺一不可。

评测体系:从技术驱动到可衡量进步

无论是VLA还是世界模型,要取得真正进步,都需要建立统一的评测标准。评测驱动而非概念驱动的转变,对整个领域的健康发展至关重要。

结语 AI的新大陆,需要多艘船

回望AI发展的关键节点:2012年的AlexNet让机器学会"看",2017年的Transformer让机器学会"读",2020年的GPT-3让机器学会"写"——每一个节点都伴随着一种新的数据范式和新的模型结构的共同作用。

下一个十年,AI的新大陆是让机器学会"理解空间"——理解三维世界的几何结构,理解物理规律的因果链条,理解行动与后果之间的映射关系。

在这片新大陆的探索中,数据规模化和结构归纳偏置不是两个互相排斥的选项,而是两艘驶向同一片大陆的船。它们各自携带着不同的工具和视角,各自解决了一部分问题——数据规模化解决了经验积累的问题,结构归纳解决了因果推理的问题。最终,它们将在真实的物理任务面前汇合,检验的标准只有一个:AI能否在物理世界中可靠地工作。

夜雨聆风

夜雨聆风