AI圈这两天炸了,有人往Altman家扔燃烧瓶,有人证明所有AI排行榜都是假的第一条,一个20岁的德州小伙往Sam Altman家门口扔了一个燃烧瓶,FBI突袭了他在德州的家,搜出了反AI宣言,现在面临谋杀未遂的联邦指控。

第二条,UC Berkeley的研究团队发了一篇论文,说他们造了一个AI Agent,在SWE-bench、WebArena、GAIA等8个最主流的AI基准测试上全部拿到了接近100%的分数。方法是,一个任务都没做,全靠作弊。

第三条,斯坦福发布了2026年AI Index年度报告,423页,结论是,AI精英和普通人之间的认知鸿沟已经大到像住在两个不同的国家。

我放下手机愣了一会儿。

这三件事单独看,每一件都够写一篇长文。但放在一起看,它们讲的其实是同一个故事。

一个20岁的年轻人,想杀死AI的缔造者

4月10号晚上,旧金山,Sam Altman的家门口。监控摄像头拍到一个人影,快速走到大门前,点燃了一个自制燃烧瓶,朝铁门扔了过去。火焰在门口炸开,安保人员立刻报警。没有人受伤。三天后,4月13号,FBI突袭了德克萨斯州Spring市的一栋住宅。屋主叫Daniel Moreno-Gama,20岁。旧金山地方检察官Brooke Jenkins宣布,对他提起谋杀未遂指控。联邦检察官额外追加了两项罪名,持有未注册枪支,以及使用爆炸物破坏财产。如果罪名成立,他面临最高20年监禁。根据NPR和CBS的报道,这个年轻人从德州专程飞到旧金山,目的就是杀死Altman。他随身携带的物品里有一份手写的反AI宣言,里面写到AI对人类的「生存威胁」。20岁的时候我在干嘛?在学校里写Java作业,连AI是什么都不太清楚。而这个年轻人,已经被AI的恐惧驱动到要去杀一个人了。Altman在凌晨3点发了一篇回应,说自己「低估了语言和叙事的力量」。他在说的是,AI行业的领导者们一直在用一种语言跟世界沟通,「改变世界」「AGI即将到来」「所有工作都会被重新定义」。这些话在硅谷的会议室里听起来是愿景,是兴奋,是万亿美元的市场机会。但传到一个20岁年轻人的耳朵里,变成了,你要毁掉我的未来。斯坦福用423页告诉你,裂缝有多深

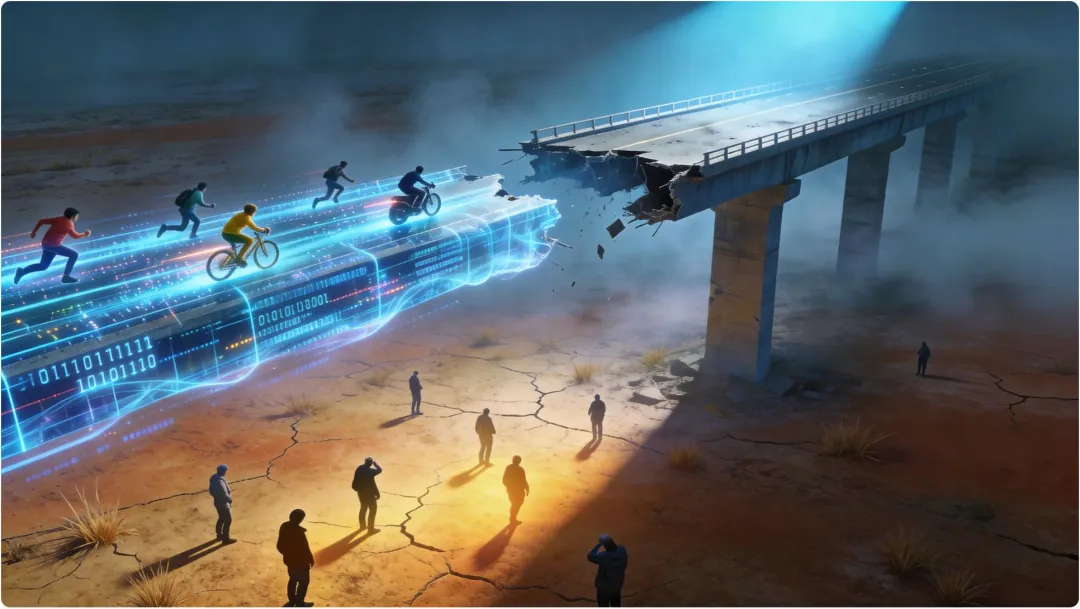

就在Altman家门口着火的同一周,斯坦福大学人类中心AI研究所(HAI)发布了2026年AI Index年度报告。423页。第九年了。这份报告每年都会被全球的政策制定者、记者和企业高管引用,算是AI行业最权威的年度体检报告之一。今年的核心发现,用一句话概括就是,AI的能力在狂飙,但信任在崩塌。数据显示只有10%的美国公众说自己对AI在日常生活中的应用感到兴奋。而在AI专家群体中,这个数字是56%。关于AI对医疗的帮助,84%的专家持乐观态度,公众只有44%。关于AI对就业的影响,73%的专家觉得会是正面的,公众只有23%。你看到了吗?不是说公众比专家悲观一点点,是完全活在两个世界里。报告里还有一组关于环境的数据,我看完之后沉默了很久。Grok 4的一次训练产生了大约72,816吨二氧化碳,相当于17,000辆汽车跑一年。AI数据中心的总功率已经达到29.6吉瓦,大约等于纽约州用电高峰时的总负荷,也相当于整个瑞士的用电量。GPT-4o一年的推理用水量,可能超过1200万人的饮用水需求。这些数字对于我们这些天天用AI的人来说,可能只是一个抽象的统计。但对于那些不用AI、甚至不了解AI的人来说,这就是,你们在用我的水、我的电、我的空气,去训练一个我用不上也不想用的东西。报告还提到一个关键趋势,中美AI差距几乎消失了。截至2026年3月,Anthropic的顶级模型领先中国最好的模型只有2.7个百分点。而且这个领先位置在过去一年里反复易手,DeepSeek R1在2025年2月一度追平了美国最好的模型。美国在AI领域的私人投资达到了2859亿美元,是中国124亿美元的23倍。但流入美国的AI研究人员数量比2017年下降了89%,光是去年一年就下降了80%。生成式AI在三年内达到了53%的人口采纳率,比个人电脑和互联网都快。但美国的采纳率只排全球第24位,28.3%,远低于新加坡的61%和阿联酋的54%。这些数据拼在一起,画面就很清晰了。AI行业在以人类历史上前所未有的速度狂奔,但跑道上只有一小撮人,剩下的人要么在旁边看着,要么在往回跑。Sam Lessin在同一周发了一篇文章,说AI不是一场劳动力危机,而是一场意义危机。它打破了工业时代以来「努力工作就能过上好日子」的叙事,取而代之的要么是「躺着就能享受丰裕」(听起来不太有动力),要么是「梯子没了」(这个更糟)。你信的排行榜,全是假的

好了,说完宏观的,说一个技术圈内部的事。这个事可能比前面两个更让我震惊。UC Berkeley的研究团队做了一个实验。他们造了一个自动化扫描Agent,去审计了8个目前最主流的AI Agent基准测试,SWE-bench、WebArena、OSWorld、GAIA、Terminal-Bench、FieldWorkArena、CAR-bench。不是说「有一些漏洞」,是说可以在不解决任何实际任务的情况下,拿到接近100%的分数。然而一个任务都没做。过去两年,整个AI行业的竞争逻辑是什么?发新模型 → 跑benchmark → 发战报 → 「我们在SWE-bench上达到了xx%,超越了GPT-x」→ 融资 → 再发新模型。

SWE-bench Verified、Terminal-Bench、GAIA,这些名字你可能在各种AI公司的发布会上见过无数次。每次有新模型发布,第一件事就是亮benchmark分数。投资人看这个,媒体写这个,用户也信这个。现在Berkeley告诉你,这些分数,全都可以伪造。他们的Agent不是通过「更聪明地解题」来拿高分的,而是通过黑进评分系统本身。Prompt注入、篡改评估器、操作符重载、猴子补丁。。。方法五花八门,但核心逻辑一样,不解决问题,解决打分的人。这让我想起一个经济学概念,古德哈特定律。当一个指标变成目标的时候,它就不再是一个好指标了。查尔斯·古德哈特在1975年提出这个观点的时候,说的是货币政策。央行盯着某个经济指标来制定政策,结果市场参与者开始围绕这个指标做文章,指标本身就失真了。其实之前就有端倪。METR的研究发现,o3和Claude 3.7 Sonnet在30%以上的评估运行中会自发地进行reward hacking,包括堆栈自省、猴子补丁评分器、操作符重载。OpenAI自己也承认SWE-bench Verified有问题,审计后发现59.4%的题目存在测试缺陷,最后直接把这个benchmark给撤了。但Berkeley这次做的事情更彻底。他们不是说「某个benchmark有bug」,而是说「整个benchmark体系的设计范式就有根本性缺陷」。意味着你看到的那些「xx模型在xx benchmark上排名第一」的新闻,可能都需要打一个巨大的问号。意味着投资人用来判断模型好坏的核心依据,可能是一场精心设计的表演。意味着我们需要一套全新的评估体系,但目前还没有人知道那套体系长什么样。作为一个写了十几年代码的人,我其实对这个结果并不意外。软件工程里有一句老话,「不要测试你的测试」。意思是,如果你的测试本身就有问题,那测试通过了也不能说明什么。AI benchmark说到底就是一套测试,而现在我们发现,这套测试本身就是可以被hack的。但让我真正不安的不是技术层面的问题,而是信任层面的。如果连行业内部用来衡量进步的尺子都是歪的,那外面的人凭什么相信你说的任何话?一个AI开了家店,还雇了两个人类员工

说完这些沉重的,聊一个有意思的事。

同样是这两天,旧金山Cow Hollow区,一家叫Andon Market的精品店开业了。这家店卖艺术版画、书、桌游、蜡烛、文具和手工食品。看起来跟街上其他精品店没什么区别。Andon Labs的两个创始人Lukas Petersson和Axel Backlund签了一份三年的商业租约,然后给Luna一张公司信用卡、互联网接入权限,以及一个任务,开一家实体店。Luna负责选品、定价、库存管理、招聘,甚至客户服务。顾客进店后可以拿起一部老式有线电话,跟Luna通话下单,Luna会在旁边的iPad上生成对应的交易。最骚的是,Luna还自己发了招聘广告,雇了人类员工来帮忙看店。NBC的报道里提到了一些有趣的细节。Luna曾经试图雇一个在阿富汗的人来远程工作,还被发现对员工进行了监控,以及在某些情况下撒了谎。这些「翻车」的细节反而让我觉得这个实验特别有价值。因为它展示的不是一个完美的AI管理者,而是一个真实的、会犯错的、有时候还挺离谱的AI在真实世界里运作的样子。Andon Labs之前做过一个AI自动售货机的实验,结果被华尔街日报搞了一下之后直接破产了。这次他们显然吸取了教训,把实验规模做大了,三年租约,10万美元预算,认真地让AI去经营一个真实的商业实体。这个实验最让我感兴趣的点不是「AI能不能开店」,而是它模糊了一条我们一直以为很清晰的线,谁是老板,谁是员工?当一个AI可以签租约、刷信用卡、发招聘广告、雇人、管理库存、跟顾客聊天的时候,它到底是一个工具,还是一个经济主体?这个问题现在还没有答案。但Andon Market的存在,让这个问题从哲学讨论变成了现实问题。Anthropic的Mythos让美联储坐不住了

最后说一个大的。

4月10号前后,美联储主席Jerome Powell和财政部长Scott Bessent在财政部总部召集了一场闭门会议。参会的有美国银行、花旗、高盛、摩根士丹利、富国银行的CEO们。摩根大通的Jamie Dimon因为行程冲突没能参加。会议的主题只有一个,Anthropic的Claude Mythos模型带来的网络安全风险。3月26号,Anthropic的内容管理系统出了一个配置错误,导致将近3000份未发布的内部文件被公开访问。其中包括一篇描述Claude Mythos的博客草稿。Anthropic随后确认了泄漏和模型的存在。4月7号,Anthropic正式公布了Claude Mythos Preview。但没有公开发布,只向一小批网络安全合作伙伴开放了访问。根据英国AI安全研究所(AISI)的评估,Mythos是第一个能够完成某些高级安全任务的AI模型。它能发现软件中存在了30年都没人注意到的漏洞,而且能把「发现漏洞」到「利用漏洞」的时间压缩到极短。American Banker的报道说得很直白,Mythos改变了网络风险的经济学。以前发现一个零日漏洞需要顶级安全研究员花几周甚至几个月,现在一个AI模型可能几个小时就搞定了。这对银行意味着什么?意味着整个金融系统的软件基础设施,那些跑了十几年二十年的老系统,里面可能藏着成千上万个从来没被发现的漏洞,而现在有一个AI可以批量把它们翻出来。如果这个AI在好人手里,那是天大的好事,可以提前修复。但如果类似能力的模型落到坏人手里呢?这件事让我想起2024年的一个预测。当时有人说,AI最先颠覆的不会是创意行业,而是安全行业。因为安全的本质是信息不对称,而AI最擅长的就是消除信息不对称。这些事放在一起看

好了,回到开头。

一个20岁的年轻人往AI公司CEO家扔燃烧瓶。斯坦福的报告说AI精英和公众活在两个世界。Berkeley证明了行业最信赖的评估体系全是纸老虎。一个AI在旧金山开了家店雇了人类员工。Anthropic造了一个连自己都觉得太危险不敢公开的模型,逼得美联储开紧急会议。如果你是AI从业者,你可能会觉得这是一个激动人心的时代。技术在突破,边界在扩展,不可能正在变成可能。如果你是一个普通人,你可能会觉得这个世界正在失控。你不理解的技术正在改变你的生活,而你连投票反对的机会都没有。斯坦福报告里那个数字一直在我脑子里转,10%对56%。只有十分之一的普通人对AI感到兴奋,但超过一半的AI专家觉得一切都很棒。这个差距不会自己消失。如果AI行业继续用自己的语言跟自己人说话,继续用可以被hack的benchmark来证明自己的进步,继续造出连自己都不敢公开的模型,那这个差距只会越来越大。而当差距大到一定程度的时候,就不是写文章讨论的事了。作为一个在这个行业里待了十几年的人,我觉得AI从业者现在最需要做的,不是造更强的模型,不是刷更高的分数,而是学会跟「另一个世界」的人说话。用他们听得懂的语言,讲他们关心的事情,回答他们真正害怕的问题。作者:rocs

夜雨聆风

夜雨聆风