这两年,很多研发团队都有一个很强的共同感受: 代码写得更快了,但人并没有更轻松。

从工具层面看,AI 编程助手确实带来了可见的效率提升。补全更快了,样板代码更省事了,单测、注释、文档草稿也能自动生成不少。可从团队体感看,加班没有减少,交付节奏反而更紧,很多人甚至觉得项目压力比以前更大。

这背后不是因为 AI 没有价值,而是因为很多组织把“编码效率提升”直接等同成了“整体研发效率提升”。这两个概念,表面上只差几个字,实际差的是整套软件工程的方法论。

真正的问题不是 AI 能不能提效,而是:它提的是哪一段的效率,这种效率有没有真正传导到端到端交付,以及组织到底在用什么尺度衡量生产力。

目录

AI 提速的,主要还是编码这一段 为什么编码更快了,交付却没有同步变快 研发管理最容易量错的,不是努力,而是生产力 AI 时代,研发效能到底该怎么量 为什么复杂系统不能把“提效”直接换算成“裁人”

一、AI 提速的,主要还是编码这一段

先说结论:AI 目前最稳定、最容易落地的提效,主要集中在“可结构化、可验证、可重复”的研发环节。

比如:

样板代码生成 接口调用拼装 单元测试草稿生成 文档初稿整理 基础测试用例补全 常见问题定位与脚本修补

这类工作有一个共同特征:输入相对明确,输出有一定规则,且结果容易检查。 只要上下文给得足够清楚,AI 的确能把这部分效率拉起来。

但问题在于,软件交付从来不只有“写代码”这一个动作。

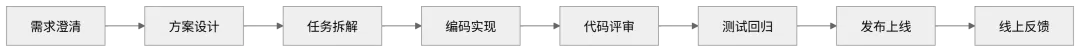

一个需求真正落地,通常要经过需求澄清、方案设计、任务拆解、编码实现、代码评审、联调验证、测试回归、上线发布、线上观察和问题修复。很多企业里,纯编码时间在整个研发链路里,占比并没有想象中那么高。

也就是说,AI 加速的是研发流程中的一个局部节点,而不是整个交付链路。

如果只有 D 这一段变快了,而 E、F、G 这些环节没有同步优化,那么团队最终感受到的就不是“整体更顺”,而是“前面更快、后面更堵”。

这也是很多团队为什么会出现一种反常现象: AI 明明让编码提速了,但整个项目还是在赶,而且比以前更赶。

二、为什么编码更快了,交付却没有同步变快

这个问题的核心,不在工具,而在组织。

AI 编程工具普及以后,很多管理层很快形成了一个判断:既然代码能更快写出来,那交付周期就应该更短。于是,本来按正常节奏推进的事情,被重新压缩工期;原本还有缓冲空间的需求,被要求更早给结果。

问题是,编码提速,不代表系统交付链路已经打通。

现实中的研发组织,真正拖慢节奏的,往往不是一个人写代码的速度,而是下面这些东西:

需求反复变更 上下游接口未对齐 评审排队 测试资源有限 环境准备慢 发布窗口受限 线上回归成本高 多团队协作带来的沟通损耗

这些问题,不会因为 AI 会写代码,就自动消失。

所以,很多团队现在处在一个典型状态里:

编码阶段更快了 评审阶段还是排队 测试阶段还是紧张 发布阶段还是受控 线上问题还是要人兜底

最后的结果就是:AI 省下来的不是整条链路的时间,而只是局部时间;而这部分时间,往往又被更高的交付预期重新吃掉了。

这就是为什么很多开发者的真实感受不是“轻松了”,而是“更忙了”。

因为组织并没有把 AI 当成优化系统效率的工具,而是先把它当成了压缩工期的理由。

三、研发管理最容易量错的,不是努力,而是生产力

AI 一进研发流程,另一个问题也马上冒出来了: 既然大家都在用 AI,那到底怎么判断谁的产出更高?

于是,一些最容易统计、但也是最容易失真的指标,又被重新捡了回来。

最典型的两个,就是:

1. 代码行数

代码行数一直都是一个很危险的指标。 因为它只能描述“写出来了多少字符”,却描述不了“解决了多大问题”。

在 AI 时代,这个问题会被进一步放大。

原因很简单:AI 生成代码本身就更容易偏“展开式写法”。同样一个逻辑,AI 往往会写得更完整、更详细,也更容易出现结构重复、封装冗余、样板代码偏多的问题。 如果这时候仍然用“谁写得多”来衡量效率,就很容易把“代码膨胀”误判成“生产力提升”。

高质量的软件工程,很多时候不是把代码写多,而是把复杂性控制住。 有时一个高价值改动,最后只落成几十行;而一个低价值改动,反而能生成几百行模板代码。

所以,代码行数最多只能做过程观察,不能直接代表工程产出。

2. Token 消耗量

另一个看起来很“新”,但本质上同样容易跑偏的指标,是 token 消耗。

有些团队会默认:谁调用 AI 多,谁更积极;谁 token 用得多,谁更深入使用了工具。 但这同样不成立。

因为 token 高消耗可能意味着两件完全相反的事:

一种是处理了更复杂、更有价值的任务 另一种是提示不清、反复试错、上下文失控,导致大量资源被低效消耗

也就是说,token 更像资源消耗指标,而不是价值产出指标。 它能反映“用了多少”,但不能直接证明“做成了多少”。

真正危险的地方在于什么?

在于这些指标都特别容易统计、特别容易做榜单、特别容易形成表面上的管理秩序。

但越容易统计的东西,越可能偏离问题本身。

研发管理最怕的,不是没有数字,而是拿最省事的数字,去代替最复杂的判断。

四、AI 时代,研发效能到底该怎么量

如果代码行数不靠谱,token 消耗也不能直接代表生产力,那 AI 时代到底该怎么量研发效能?

我的观点是:底层逻辑其实没有变,变的是度量口径要重新校准。

软件工程的本质问题并没有因为 AI 出现就消失。 复杂度、协作成本、系统约束、质量责任、稳定性要求,这些东西今天都还在。

所以,真正该看的依然是那些能够反映“交付结果”的指标,而不是只反映“工具使用痕迹”的指标。

更值得关注的四类指标

1. 交付周期指标

看需求从进入研发到真正上线,周期有没有缩短。

不是单看写代码快了没有,而是看一个需求能不能更快进入生产环境。

2. 质量稳定性指标

看变更失败率、线上缺陷率、回滚率、故障恢复时间这些指标有没有恶化。

因为真正有效的提速,一定不能靠牺牲质量换来。

3. 有效产出指标

看交付的需求数、完成的业务目标、进入生产环境且通过质量门控的有效改动,而不是看原始代码数量。

换句话说,要看“有效交付”,不是看“表面活跃”。

4. 人机协同指标

AI 时代的研发,评价对象不再只是“人”,而是“人 + 工具 + 流程”的组合。

这时可以关注:

AI 生成内容的采纳率 生成代码进入生产的比例 一个任务平均需要几轮 AI 交互 哪类任务 AI ROI 更高 哪类任务验证成本过高,反而不划算

这类指标更接近真实情况,因为它们反映的是:AI 到底有没有真的形成工程产出,而不是只是被频繁调用。

五、为什么复杂系统不能把“提效”直接换算成“裁人”

AI 提效最显著的,通常是一些相对轻量、标准化程度高、生命周期较短的项目。 在这些场景下,AI 的确容易打出非常夸张的效率提升。

因为这类项目通常具备几个特点:

业务逻辑相对直接 协作链路较短 架构历史包袱少 维护周期有限 容错空间相对更大

在这种场景里,一个人借助 AI 承担更多工作是可能的。 但这并不代表所有研发场景都能按这个逻辑类推。

越是复杂系统,越不能把“编码提速”直接换算成“人可以更少”。

比如金融系统、核心交易系统、工业软件、大型中后台、强监管业务平台,这些系统真正难的地方,不是把代码写出来,而是:

是否符合既有架构约束 是否理解复杂业务规则 是否能保证跨模块一致性 是否能满足审计、合规、监管要求 是否能在长期迭代中持续维护 是否有人愿意对系统稳定性负责

这些能力里,很多并不是单纯依赖“生成速度”就能解决的。 它更依赖经验、判断、责任边界和工程约束意识。

所以,对复杂系统来说,AI 的合理角色更像是:

帮工程师提速 帮团队降低重复劳动 帮组织扩大能力覆盖面

而不是简单替代掉那些真正理解系统的人。

从工程角度看,复杂系统最值钱的,往往不是“把代码产出来”的能力,而是“知道什么能改、什么不能乱动,知道改完以后会不会出事”的能力。

这类价值,本来就不容易被代码行数和 token 消耗量量出来。

六、写在最后

AI 进入研发体系以后,最容易出现的误判,就是把局部提速当成整体提效,把工具能力当成组织能力,把资源消耗当成生产力。

这三种误判叠加起来,结果往往不是团队更高效,而是:

交付预期被拉高 节奏被进一步压缩 指标开始跑偏 技术债更容易被前置掩盖 人的压力并没有下降

所以,今天真正值得讨论的,已经不是“AI 能不能写代码”。 这个问题其实已经没有太大争议了。

更值得讨论的是另外三个问题:

AI 提速的,到底是研发链路中的哪一段 这部分提速,有没有真正传导到端到端交付 组织到底在用什么方法,判断这种提速是不是有价值

如果这三个问题没有想清楚,那么 AI 带来的很可能不是研发体系升级,而只是更快的局部动作、更重的整体压力,以及一套看起来很先进、实际却越来越失真的绩效尺子。

真正成熟的研发组织,不会只盯着“写得更快”。 它会更关心:能不能在质量可控、成本可控、风险可控的前提下,把业务更稳定地交付出去。

这才是 AI 时代更重要的工程能力。

推荐阅读

夜雨聆风

夜雨聆风