为你揭开这层神秘的面纱,系统地梳理构建一个机器学习项目的标准化路径。我们将不再把目光局限于模型的“黑盒”内部,而是聚焦于那条更为广阔的“端到端”流水线。这条流水线涵盖了从业务问题的理解、数据的收集与清洗、特征的工程与构建,到模型的训练、评估、优化,直至最终的部署与持续监控。 1 训练集、验证集、测试集:模型的“学习-模拟考-高考” 数据划分是机器学习中最基础也最重要的一步,其核心思想是模拟模型在未来未知数据上的表现。我们可以用一个生动的“学生备考”比喻来理解这三者的区别。 作用:这是模型学习的“教材”。模型通过反复“阅读”训练集中的样本(输入数据)和标签(正确答案),来调整其内部的参数(权重和偏置),学习数据中的规律和模式。 比喻:就像学生用来学习的课本和课后练习题。学生通过反复做题、对照答案来掌握知识点。 作用:这是一个“模拟考场”。在模型训练过程中,我们会用它来评估模型当前的性能,并基于这个评估结果来调整模型的超参数(如学习率、网络层数、正则化强度等)或选择不同的模型架构。它帮助我们判断模型是“学好了”还是“死记硬背了”。 比喻:就像学校组织的模拟考试。通过模考,学生和老师可以了解学习情况,发现薄弱环节,并调整复习策略(比如是继续刷题还是回归课本)。关键点在于,验证集参与了模型的“调优”过程。 作用:这是模型从未见过的“全新考卷”。它只在模型最终训练和调优完成后使用一次,用于给出一个客观、公正的最终性能评估。这个评估结果代表了模型的泛化能力,即它在真实世界中处理新数据的能力。 比喻:就像最终的高考。这套卷子学生之前从未见过,也不能根据它来调整复习计划。高考成绩是衡量学生真实水平的最终标准。关键点在于,测试集必须完全隔离,不能用于任何形式的模型选择或参数调整,否则评估结果就会有偏差。 2 过拟合与泛化:模型的“死记硬背”与“举一反三” 表现:模型在训练集上表现极好,误差非常低,但在验证集或测试集上表现却很差。 原因:模型过于复杂,它没有学到数据背后普适的规律,而是把训练数据中的每一个细节(包括噪声和偶然性)都“背”了下来。就像一个学生,把练习题的答案都记住了,但题目稍作改动就不会做了。 泛化(Generalization):举一反三的天才 表现:模型不仅在训练集上表现良好,在从未见过的验证集和测试集上也能保持稳定的高性能。 目标:这是我们训练模型的终极目标。一个好的模型应该能抓住事物的本质规律,从而对新的、未知的情况做出准确预测。 更多高质量数据:这是最根本、最有效的方法。数据越多、越多样,模型就越难“背”下所有情况,被迫去学习更普适的规律。 正则化(Regularization):一种在模型训练时施加的“约束”,防止模型参数变得过大、模型变得过于复杂。可以理解为给模型的“复杂度”征税,让它变得更“简约”。

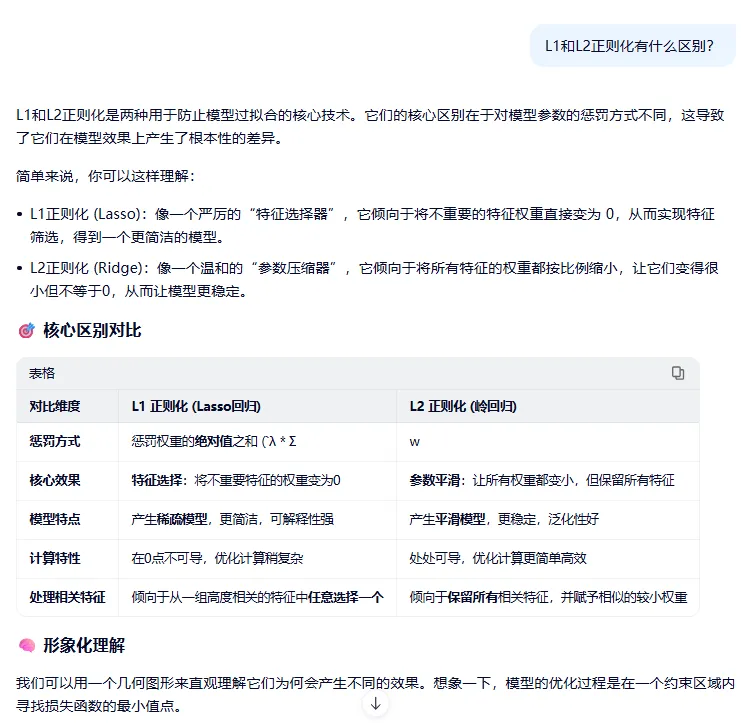

数据增强(Data Augmentation):在现有数据的基础上,通过一些变换(如图像的旋转、裁剪、翻转;文本的同义词替换等)人工生成新的训练样本。这相当于在不增加新数据的情况下,丰富了数据的多样性。 交叉验证(Cross-Validation):一种更稳健的模型评估和选择方法。它将训练集分成K份,轮流用其中K-1份训练,1份验证,最后取K次结果的平均值。这能更充分地利用数据,减少因单次数据划分带来的偶然性。 早停策略(Early Stopping):在训练过程中,持续监控模型在验证集上的表现。当验证集的性能不再提升甚至开始下降时,就提前停止训练。这可以有效防止模型在训练集上“学过头”,从而避免过拟合。 3 三个关键公式(直觉版):模型学习的“三板斧” 1) 经验风险最小化(Empirical Risk Minimization) 公式:Loss = (1/N) * Σ(模型预测值 - 真实值) 这个公式定义了模型的“损失函数”(Loss Function)。它的含义非常直白:把模型在所有训练样本上的预测误差加起来,然后求平均。训练模型的过程,就是想方设法让这个平均误差(Loss)变得越小越好。每一次预测错误,模型都会得到一个“惩罚”,而它的目标就是最小化这个总惩罚。 2) 梯度下降(Gradient Descent) 假设损失函数(Loss)是一座山,我们的目标是找到山谷的最低点(即Loss最小的地方)。梯度(Gradient)就是当前位置最陡峭的下山方向。学习率(Learning Rate)就是我们迈出的步子大小。 这个公式告诉我们:每次迭代,都沿着当前最陡峭的下山方向(负梯度方向)走一小步。通过不断地“走一步,看一步”,我们就能一步步接近山谷的最低点,也就是找到了最优的模型参数。 公式:总损失 = 训练误差 + λ * 模型复杂度 这是对“经验风险最小化”的改进。我们不再只追求训练误差小,还要给模型的“复杂度”加一个惩罚项。 复杂度惩罚:衡量模型本身有多复杂。模型越复杂(例如参数值越大),惩罚就越重。λ(Lambda)是一个超参数,用来控制我们对复杂度的“厌恶”程度。 通过这种方式,正则化迫使模型在“拟合数据”和“保持简单”之间找到一个平衡点。一个更简单的模型,往往意味着更强的泛化能力,因为它不太可能去“死记硬背”训练数据中的噪声。常见的L1和L2正则化,就是两种不同的“计算复杂度”的方式。

夜雨聆风

夜雨聆风