Views are my own.

Key Takeaways

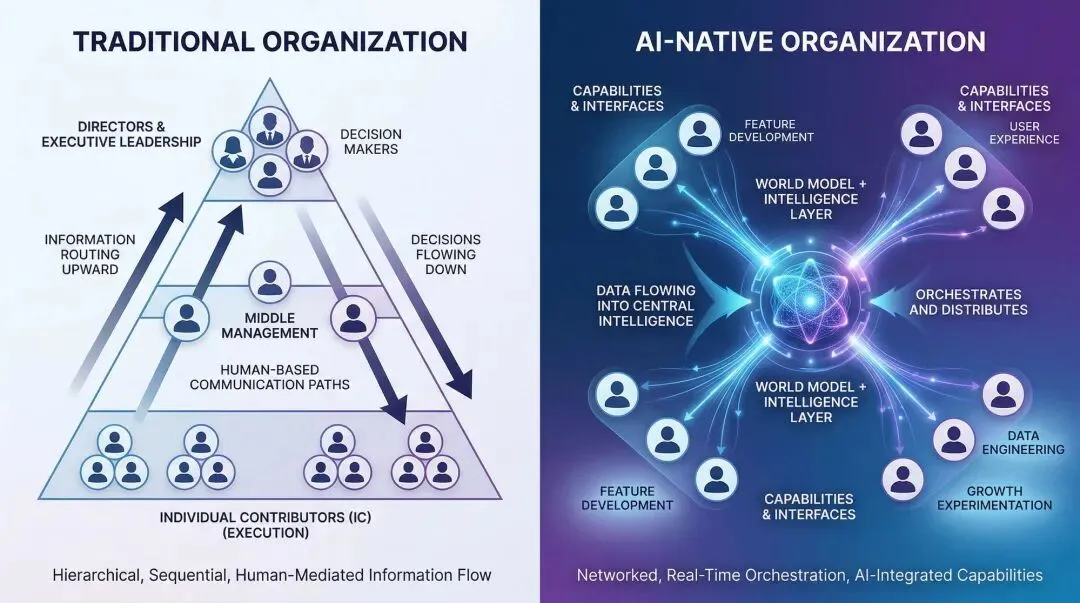

AI 放大了执行速度和协调速度之间的落差。 协调瓶颈一直存在,但过去被执行瓶颈“掩盖”了。当 AI 把执行速度拉到极高,组织内信息流动的带宽和延迟成为真正的制约因素。

层级制度的本质是信息路由协议,设计约束是人类认知带宽。 2000 年来没有替代方案。AI 第一次提供了维护实时“公司世界模型”的可能性,这动摇了层级存在的根基。

Block 的四层架构(Capabilities → World Model → Intelligence Layer → Interfaces)逻辑自洽,但依赖特殊前提:业务可原子化、客户信号高密度、工作过程数字化。 大部分公司不完全具备这些条件,需要找到自己的映射方式。

AI-Native 转型中最容易被低估的瓶颈是判断力。 不是 AI 能不能做,而是谁来判断 AI 做得好不好,团队需要培养足够比例这样的人。

中层管理者的价值需要重新审视。 信息路由的职能会被系统替代,但 judgment、文化塑造、人才发展、“江湖平事儿”的价值反而会上升。AI-Native 不一定消灭管理职责,但会倒逼管理者回归真正不可替代的价值。

从一篇激进的文章说起

上周,颇具争议的 Block(原 Square) Founder&CEO Jack Dorsey 和 Sequoia 的管理合伙人 Roelof Botha 联合发表了一篇文章“From Hierarchy to Intelligence”,提出了一个相当激进的观点:

AI 替代层级制度的信息路由功能,把公司从 hierarchy 变成 intelligence。

背景同样激进。2 月份,Block 宣布裁员约 4,000 人,接近 40% 的员工。这个操作并不是一家处于严重亏损时期的断臂求生之举:Block 2025 财年 Gross Profit 约 103.6 亿美元,同比增长 17%,2026 年指引上调至 122 亿美元。一家赚着钱、增长着的公司,主动砍掉近一半的人,然后在致股东信中解释说 AI “从根本上改变了建立和运营公司的意义”。

不只是 Block 的激进实验,随着 AI 飞速发展和各种 AI 焦虑,你有没有发现一个越来越普遍的现象:

团队里每个人都在用 Cursor、Claude、ChatGPT,Gemini 等各种五花八门的 AI 工具,个人生产力确实提升了,但跨团队协作反而更混乱了?

需求对齐的会越开越多,context 在传递中不断失真,每个人都在高速产出,但产出的方向经常对不齐。AI 解决了“做得快”的问题,却暴露了一个更深层的组织瓶颈——信息流动。

这个文章想讨论的就是这个问题:

当 AI 消解了执行瓶颈之后,组织的真正瓶颈是什么?AI-Native 组织到底意味着什么?以及,一个中小团队如何务实地开始这场转型?

为什么组织的瓶颈变了?

过去十年,技术团队管理者最头疼的问题是执行速度:开发进度慢、功能交付延期、代码质量不稳定。管理的核心工作围绕任务拆解、资源分配、进度跟踪展开。整个管理体系的设计假设是:

执行是瓶颈。

AI 正在快速改变这个假设。根据 Anthropic 最新的 Economic Index Report,经验丰富的老手不仅利用最新的 AI 技术尝试更高价值的任务,甚至把 AI 当成迭代的思考伙伴,而非简单搜索答案的工具。

当执行速度不再是瓶颈,协调的低效就无处遁形。Fred Brooks 在《人月神话》里早就说过“adding manpower to a late project makes it later”,协调成本一直存在。但过去,执行速度慢到足以“掩盖”协调的低效:反正代码写不完,协调慢一点也不是最痛的问题。

当 AI 把执行速度拉到极高之后,执行和协调之间的速度差开始变得不可忍受。 就像一条高速公路突然把限速从 60 提到 300,原来凑合能用的收费站和匝道设计瞬间变成了致命瓶颈。

我们过去习以为常的层级制度,到底在解决什么问题?“From Hierarchy to Intelligence”文章里最核心的观点是:层级制度本质上是一个信息路由协议(Information Routing Protocol)。

他们从罗马军团讲起。最小单位 contubernium 是 8 个人,共用一顶帐篷、一套装备、一头骡子,由一个 decanus 领导。10 个 contubernium 组成一个 century(80 人),由 centurion 指挥。6 个 century 组成一个 cohort,10 个 cohort 组成一个 legion(约 5,000 人)。每一层的指挥官做同样的事:从下层聚合信息,向上传递,接收上层决策,向下分解。

8 → 80 → 480 → 5,000。这个结构的设计约束只有一个:一个人能有效管理 3 到 8 个人,这是人类认知带宽的硬约束。罗马人通过几百年的战争发现了这个约束,今天的美军层级链遵循同样的模式,现在叫它 Span of Control。过去很多年的组织创新,本质上都是在同一个约束条件下做优化:人类认知带宽有限,所以需要层级来路由信息。

最近的几十年,科技公司做过各种尝试突破这个约束。Spotify 试过 Squad 模式,Zappos 试过 Holacracy,Valve 试过完全扁平化。结果呢?Spotify 在扩张后回归了传统管理,Zappos 经历了大规模离职,Valve 的模式在几百人以上就难以为继。

这些实验碰上了同一个问题:当组织试图用文化、流程或制度来取代层级的协调功能时,却没有一个拥有真正能执行这些功能的技术。 组织一旦超过几百人,就会回归层级,因为没有其他信息路由机制能替代它。

直到现在。

AI 第一次提供了一种技术,能够维护一个持续更新的“公司世界模型”,并用它来协调工作,而这些工作过去都需要人类通过层级来完成。

如果这个判断成立,组织层级必须存在的假设就动摇了。

Block 的激进实验:公司即 Agent

大多数公司对 AI 的使用方式是:给每个人一些 AI 工具或者 Token,期望让现有结构和流程运转得好一点,这叫 AI-augmented。Block 要做的事情完全不同,他们想把公司本身变成一个“mini-AGI”。

AI-augmented 的组织里,智能分布在人脑中,层级负责路由。AI-Native 的组织里,智能在系统中,人在边缘节点。

传统组织的信息流是:IC 产出 → 经理聚合 → 总监决策 → 经理分解 → IC 执行。AI-Native 组织的信息流是:World Model 持续更新 → Intelligence Layer 识别机会 → 直接组合 Capabilities → 通过 Interface 交付。

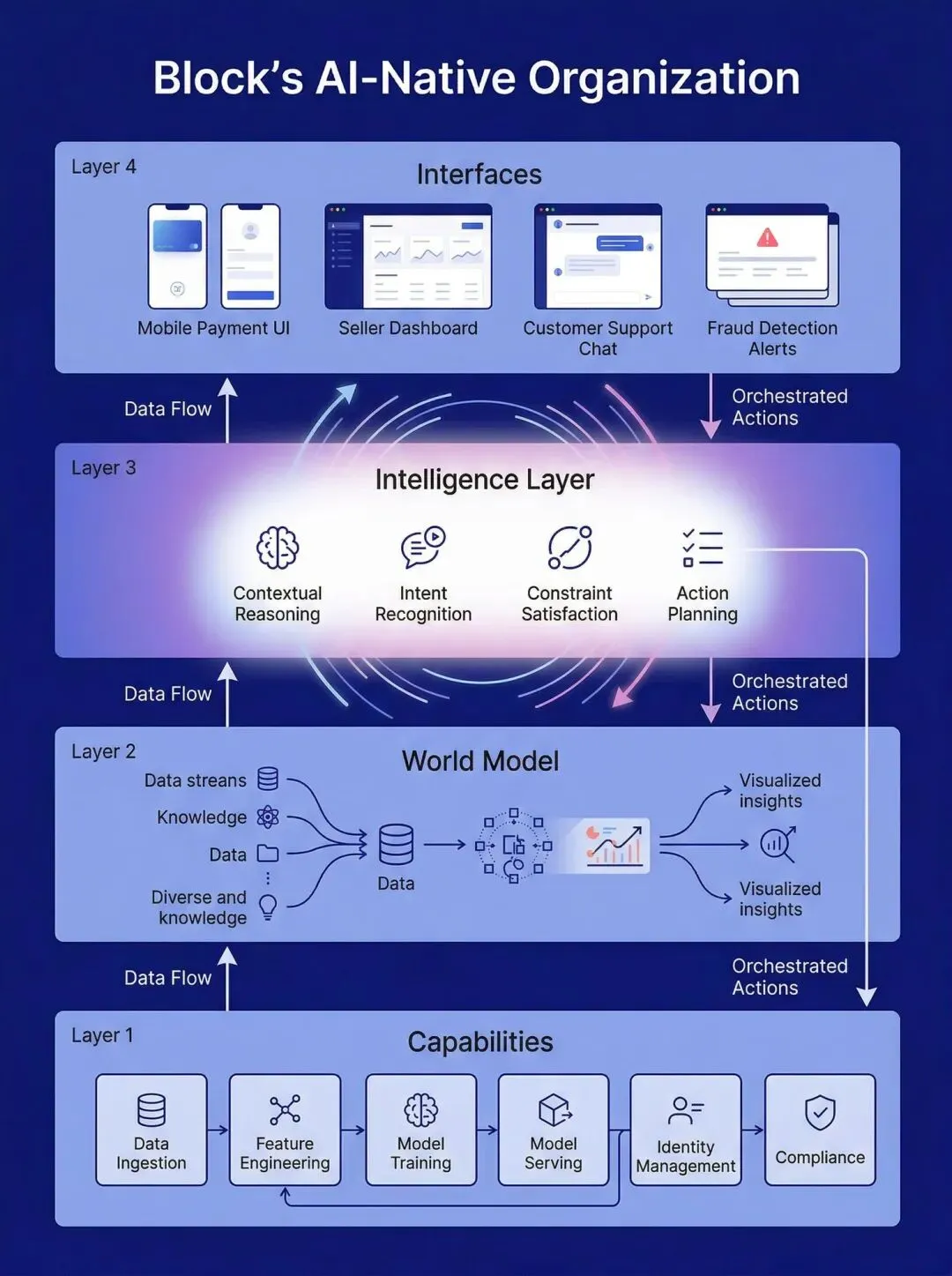

Block 设想的组织架构分四层。

第一层:Capabilities(能力层)。 首先是原子化的金融能力,包括支付、借贷、发卡、银行、先买后付、薪资等等。这些不是“产品”,是乐高积木块。它们没有自己的 UI,只有可靠性、合规性和性能指标。它们之所以有价值,是因为获取和维护这些能力的门槛很高,有些涉及网络效应,有些需要监管许可。

第二层:World Model(世界模型)。 两个子模型。Company World Model 是公司对自身运营的理解,什么在建、什么被阻塞、资源如何分配、什么有效什么无效。这些信息过去由管理层通过层级聚合和传递,现在可以由 AI 持续维护。需要说明的是,Block 是 remote-first 的公司,所有工作交付物都是数字化 artifact,比如决策、讨论、代码、设计、计划等,这些就是 World Model 的原材料。Customer World Model 则是公司对客户的理解,基于交易数据构建的 per-customer、per-merchant、per-market 模型,从原始交易数据起步,逐步演进为因果和预测模型。

第三层:Intelligence Layer(智能层)。 这是整个架构中最有想象力的一层。它的功能主要是在特定时刻,为特定客户,组合 Capabilities 来解决具体问题。 文章举了两个例子。一家餐厅的现金流在季节性低谷前开始收紧,模型之前见过这个模式:智能层从借贷能力中组合一笔短期贷款,用支付能力调整还款计划,在商户还没想到要找融资之前就主动推送方案。一个 Cash App 用户的消费模式发生了变化,模型判断他搬了家,智能层组合工资直存设置、针对新社区的 Cash App Card 优惠、根据更新收入校准的储蓄目标,打包推送。没有产品经理决定做这些功能,Capabilities 本来就在那里,Intelligence Layer 识别到了 moment,实时组合了方案,神不神。

第四层:Interfaces(界面层)。 Square、Cash App、Afterpay、TIDAL、bitkey 等,这些是“交付界面”,智能层通过它们把组合好的方案送达用户。界面很重要,但价值创造不在这里。价值在 Model 和 Intelligence。

这四层架构带来了一个极其激进的推论:传统 Roadmap 可以消失。

传统模式下,产品经理假设用户需要什么,排优先级,安排开发。Dorsey 认为这是“any company‘s ultimate limiting factor”。在 Block 的模型中,当 Intelligence Layer 尝试组合方案但发现某个 Capability 不存在时,这个失败信号直接生成了 backlog。“Customer reality generates the backlog directly.” 从“假设驱动”到“现实驱动”,我认为这是整个架构中最值得思考的转变。

在这个架构下,组织结构也随之倒置。传统组织里,人在中间(管理层路由信息),智能在边缘(IC 做具体工作)。Block 的模型里,智能在中间(World Model + Intelligence Layer),人在边缘。

用 Dorsey 的话说:“A world model that can‘t touch the world is just a database.” 而边缘是智能与现实接触的地方。人在边缘的最大价值在于,触达模型还无法触达的地方,感知模型无法感知的东西,比如直觉、文化语境、信任关系等,以及做模型不应该独自做的决策,比如伦理判断、情境判断、犯错代价极高的决策等。

Block 将组织角色精简为三种:

IC(Individual Contributor):资深专家,负责构建和运维某一层,World Model 提供过去由经理提供的 context,IC 可以自主决策

DRI(Directly Responsible Individual):拥有某个跨职能问题的临时 owner,比如 90 天内负责解决某细分市场的商户流失问题,有权跨团队调配资源,问题解决后转向下一个

Player-Coach:既写代码/建模型/做设计,又培养人,替代传统 manager,但不再花时间开状态同步会和谈判优先级

这样的组织模式变成了:

World Model 处理对齐,DRI 结构处理优先级,Player-Coach 专注于 craft 和 people,没有常设的中层管理。

Block 自己也承认这个转型还处于早期阶段,但他们选择现在就公开讨论,因为他们相信每家公司最终都要面对同一个问题:你的公司到底理解了什么真正难以理解的东西?这个理解每天在变深吗?

如果答案是“没有”,那 AI 对你来说只是一个降本增效的故事,砍人、提利润、撑几个季度,最终被更聪明的东西吞掉。如果答案是“深”,AI 不是在增强你的公司,而是在揭示你的公司对什么的理解比别人深。

这个架构成立的前提条件是什么?

显然,Block 的这个叙事非常理想,真要做成也需要依赖几个非常特殊的前提条件。

前提一:业务能力天然可原子化。 Block 做的是金融服务,像支付、借贷、发卡等,这些能力本身就是高度标准化、API 化的。你可以把“发放一笔贷款”抽象成一个原子操作。但如果你做的是咨询、内容、硬件、或者任何涉及大量非结构化,决策判断为主的业务,“Capability”这一层怎么定义?把“写一份战略报告”或者“设计一款消费电子产品”拆成原子化能力,难度完全不同。

前提二:有高质量、高密度的客户信号。 Block 坐在交易数据上,每一笔支付、每一次借贷、每一个消费行为都是实时的、结构化的、诚实的信号。这是 Customer World Model 的基础。但大多数公司的客户信号远没有这么干净。SaaS 公司有用户行为数据,但颗粒度和信噪比跟交易数据差很远。做 B2B 的公司,客户信号可能主要来自销售的口头反馈和季度 review,这怎么建 World Model?

前提三:工作过程天然数字化。 Block 是 remote-first 公司,所有决策、讨论、代码都以数字化 artifact 的形式存在。这是 Company World Model 的原材料。但很多公司的关键决策发生在会议室白板前、微信群里、甚至饭局上。这些信息 AI 看不到,World Model 就建不起来。

前提四:Intelligence Layer 的可靠性问题。 这是我个人认为最值得质疑的一点。Block 描述的 Intelligence Layer,本质上是一个自动化决策系统,它要在金融场景下实时组合方案并推送给客户。这对系统的可靠性要求极高。当前 LLM 的 hallucination 问题、因果推断的不可靠性、以及金融监管对自动化决策的合规要求,都是实实在在的技术障碍。

而且这里有一个隐藏的悖论:Intelligence Layer 判断“应该组合什么方案”本身就是一种模型假设,它基于历史模式做推断,而历史模式不等于未来现实。如果模型过度拟合了过去的交易模式,它“发现”的需求可能只是对旧模式的重复,而非真正的客户现实。

基于上面的分析,更准确地说,Block 的模型是从“人的假设驱动”变成了“模型的假设驱动”,而后者更快、覆盖更广,但并没有消除假设本身。

说这些不是要否定 Block 的方向。个人判断,Block 提出的组织设计原则,即“智能在中间、人在边缘、信息路由由系统承担”的大方向是对的。 但具体的四层架构是 Block 根据自身业务特点设计的,不能直接照搬。

每个团队需要根据自己的业务特点,找到属于自己的“能力层”、“世界模型”和“智能层”的映射方式。

转型真正难在哪儿?

理解了 Block 架构的前提条件之后,再来看转型的难点,就不只是“技术难”或“组织难”这么简单了。

最核心的难点:中层管理者的存在性危机。

这是整个 AI-Native 转型中最敏感、也最值得讨论的问题。Dorsey 的文章说得很直接:传统中层管理者的核心职能,比如信息聚合、上传下达、资源协调、优先级判断等等,在 AI-Native 架构中由系统承担了。Block 的方案是让他们转型为 Player-Coach 或 DRI。

但这个方案回避了一个问题:中层管理者做的真的只是信息路由吗?

大多数公司,优秀的中层管理者做的远不止这些。他们做冲突调解,两个团队对优先级有分歧,不是靠数据就能解决的,需要有人理解双方的情绪、利益和面子。他们做文化塑造,团队的价值观、工作标准、什么行为被鼓励什么行为被制止,这些微妙的东西很难写成规则让 AI 执行。他们做政治缓冲,替团队挡掉来自上层的不合理要求,或者在资源争夺中为团队争取空间。他们做“翻译”,把高层的战略意图翻译成团队能理解和执行的具体方向,这个翻译过程本身就包含大量的判断和取舍。有人的地方就有江湖,更别提各种“江湖”上的人情事故了。

World Model 能替代信息聚合,但能替代这些吗?个人认为短期内肯定不能。

所以更准确的说法可能是:AI-Native 架构不是消灭中层管理,而是迫使中层管理者从“信息路由器”转型为“judgment provider”。 那些核心价值就是信息搬运的管理者确实会被替代,但那些核心价值是判断力、文化塑造和人才发展的管理者,反而会变得更重要。

第二个难点:团队的 AI 能力分布严重不均。

Deloitte 2026 State of AI 报告调研了 3235 位管理者,结论是:企业 AI 落地的第一障碍并不是预算、技术或者领导层支持,而是技能。更值得注意的是,84% 的公司没有围绕 AI 能力重新设计工作和岗位,大部分还停在“给现有流程加 AI”的阶段。

但这里的“技能”不是指“会用 ChatGPT”。不是每天简单用用 AI,有几个顺手的工具,就是“AI-native”了。

遇到问题是不是第一反应如何用 AI 方式来解决?是不是用 AI 加速了现有的思考方式?是不是因为 AI 改变了思考方式本身?是不是开始用 AI 来挑战自己的假设、探索你原本不会考虑的方案、构建你一个人根本搭不起来的系统?

这个 gap 本质上是一个 taste-and-judgment gap:工具人人都有,但知道什么该做、什么该测、什么该砍,以及如何保证 AI 输出的质量标准,这些判断力的差异,才是真正拉开差距的地方。

管理者往往会高估团队的 AI 能力水平。团队推 AI-Native 架构,很多人可能只是把它当成“又一个新工具”来用。更麻烦的是,这个问题不是培训能解决的,它需要思维方式的根本转变,这个转变因人而异,没有标准路径。

架构债和技术挑战也是真实的,但相对来说是更“可解”的问题。 产品要拆成原子化的 Capabilities,数据要重构为 World Model 的输入,业务逻辑要从代码里抽出来放进 Intelligence Layer,这些都是工程问题,有明确的技术路径,难的是投入和耐心。

真正卡住大部分组织的,是上面说的人的问题。

一个中小团队怎么开始?

Block 的实验是公司级别的全面重构。对大多数公司来说,这个路径的说服成本和执行风险都太高。但如果把范围缩小到一个百人以内的中小团队,尝试的可行性就高多了。决策链短,试错成本可控,团队 Leader 可以真正做到从上到下推动。

以下是我个人 YY 的一套渐进路径,逻辑上是通的,但尚未验证。权当抛砖引玉。

第一步,让团队的工作对 AI 可见。

这是一切的前提。

Block 能建 World Model,是因为它是 remote-first 公司,所有工作天然产生数字化 artifact。大多数团队不具备这个条件,决策在会议室里做,context 在微信群里传,知识在老员工脑子里存。

所以起点不是引入什么 AI 工具,而是建立“信息总线”:把决策过程文档化(不是会议纪要,是决策的 Why 和背后的推演过程),把异步沟通作为默认模式(不是禁止开会,是让开会变成 exception),建立 Single Source of Truth(一个地方能查到所有 context)。

团队 Leader 的角色也随之发生变化,TL 需要变成 Chief Context Officer:首要职责不再是下达指令和监督执行,而是构建、维护和优化这条信息总线,确保关键 context 在团队内无损、高速地流动。

听上去不难,做起来一点也不容易。大部分团队试过“文档化”,最后都变成了没人看的 wiki 坟场。文档化的目的不是“记录”,而是“让 AI 能读懂你的团队在干什么”。如果你的文档连 AI 都解析不了,那人就更读不了。

一个简单的检验标准:新人加入团队后,能否在不依赖“找人问”的情况下理解团队在做什么、为什么这么做。

能做到这一步,新人一入职就会感觉到团队的“调性”。

第二步,重点培养团队的判断力,而不仅是工具熟练度。

坦率地评估团队的 AI 能力分布。

对于很多资深专家,需要的不是更多工具培训,而是思维方式的转变。几个值得重点投入的方向:

Context Engineering:管理 AI 的信息环境,比如 memory、skills、rules、retrieval context 等,而非只是写写 prompt,搞搞文档,做做总结等

Token Economics:把 token 当成工程成本来思考。可以尝试,如果给团队无限量的 token 和非常有限的人,团队的产出是不是可以有数量级的提升?

Judgment:建立评估 AI 输出质量的标准和直觉。现在所谓的“Taste(品味)”有点烂大街了,甚至很多人自我感觉 taste 很好,实际上未经业务和商业价值验证的 taste 都只是“廉价的判断”而已。另外,taste 这个事情吧,听上去很玄,我个人觉得也是可以刻意练习和培养的。

让团队里所有人都有足够的判断力不现实,但要确保有足够比例的人具备判断力,能在 AI 高速产出的环境下把住质量关。

第三步,选一个子系统做 AI-Native 的重新设计。

不要试图一次性改造整个团队的工作方式。选一个足够小但足够完整的子系统,问一个问题:

如果这个系统从第一天就假设 AI 是基础设施,它应该怎么设计?

这里需要注意前面讨论的适用性问题。Block 的四层架构是为金融服务设计的,你的业务可能完全不同。

但底层思路是可以借鉴的:这个系统提供哪些原子化的“能力”?它需要理解什么——这就是它的“世界模型”。AI 如何组合这些能力来解决问题——这就是它的“智能层”。具体的映射方式需要你自己想,照搬 Block 的架构大概率不 work。

需要注意的是,“给现有系统加 AI 功能”只是AI增强,而“假设 AI 是地基,系统应该长什么样”才是AI-Native。

最后,在组织结构上做小范围实验。

当前面几步有了初步成果,可以开始试验:让一部分 manager 转为 Player-Coach,既做具体工作又带人;设立临时的 DRI 角色(围绕具体问题而非固定职能),让信息总线承担更多的对齐职能。

这一步的核心不是“去掉管理层”,因为优秀管理者的价值远不止信息路由。需要观察和度量的是:

当信息路由的职能被系统承担后,管理者的时间花在了什么地方?

如果释放出来的时间用在了 judgment、craft 和 people development 上,方向就对了。如果管理者发现自己“没事干了”,那说明他之前的价值确实主要是信息搬运,这个信号本身就很有价值。

整个路径的核心原则:

小步快跑,及时调整方向盘,不要跑偏太多。

每一步都应该在不破坏现有运转的前提下进行,不 work 就快速回滚。把它当成一系列实验,每个实验有清晰的假设,跑一段时间看结果,不断纠偏校准。

一个值得思考的问题

Block 的实验,不管最终成败如何,提出了一个对所有管理者都值得认真想想的问题:

如果 AI 可以承担层级制度中信息路由、资源协调、优先级决策的职能,那“管理”这件事的本质到底是什么?

也许答案是 taste 和 judgment,对“什么值得做”的品味,和对“做得好不好”的判断。也许答案是帮助人成长,这件事 AI 目前做不了,可能很长时间内都做不了。也许答案是我们还没想清楚的某种能力。

但有一点是确定的:如果你作为管理者的核心价值是信息路由,只做聚合、传递、分解,那这个价值正在被 AI 快速侵蚀。AI 可以做到你物理上做不到的事:同时维护整个组织的实时状态,7×24 小时在线,不遗漏,不失真,还能不断自我进化。

Block 今天的实验可能太激进,可能太早,可能在执行中挂掉。但他们提出的问题是真实存在的,而且每过一个月,随着 AI 能力的提升,这个问题就变得更突出一分。

Enjoy!

References

Jack Dorsey & Roelof Botha, “From Hierarchy to Intelligence”, Sequoia Capital / Block, 2026.3

Anthropic, “Economic Index Report: Learning Curves” , 2026.3

PwC, “2025 Global AI Jobs Barometer”, 2025.6

Deloitte, “State of AI in the Enterprise: The Untapped Edge”, 2026.1

Nyk ( @nyk_builderz), “How to become AI native”, 2026

Dhanji R. Prasanna (Block CTO), “Building the AI-First Enterprise with Goose”, Training Data (Sequoia Capital), 2025.9

夜雨聆风

夜雨聆风