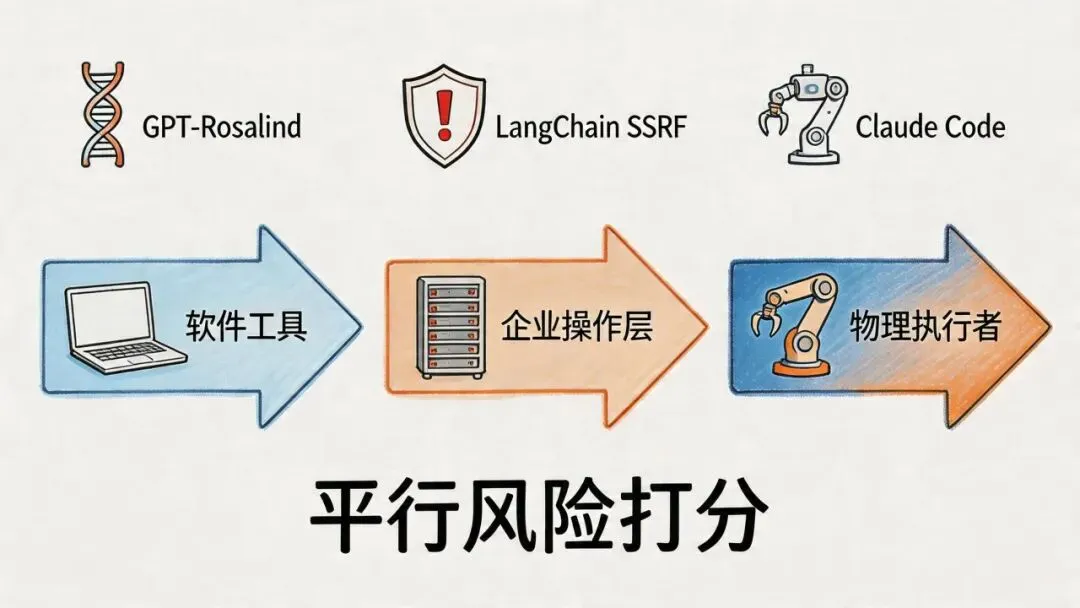

AI 正从工具走向运营基础设施

今天,我在三条彼此独立的新闻里读到了同一个信号:AI 不再是你的工具,它正在成为你依赖的基础设施。而与此同时,另外两条新闻在提醒我们——这栋楼还没打好地基。

三个信号:AI 正在成为真实运营层

第一个信号来自 MIT Technology Review 的一篇深度分析。标题很直白:把企业 AI 当作操作系统层来运营。它不是说你可以考虑用 AI 来辅助工作,而是说 AI 已经在承担跨系统协调、自动化决策和流程编排——这是操作系统干的事。当 AI 出问题,不是一个功能失效,是整个决策链断裂。

第二个信号来自监管机构。美国商品期货交易委员会(CFTC)的官员公开承认:在预算削减、人手不足的压力下,AI 已在实质上承担了部分监管工作。这不是实验,不是试点,是联邦机构在公开场合说我们靠 AI 在维持运转。

第三个信号来自 OpenAI。他们发布了 GPT-Rosalind——一个专为生命科学研究设计的模型,支持基因组学、蛋白质结构分析和药物发现。命名来自 Rosalind Franklin,DNA 双螺旋结构的发现者之一。通用模型的边界正在向高专业度垂直领域推进,AI 作为基础设施的领地越来越大。

三个信号指向同一趋势:AI 正在成为真实运营层

两条裂缝:安全与监督的系统性滞后

但就在同一天,另外两条新闻让我停下来。

第一条:LangChain 在 2026-04-16 集中发布了六个以上安全补丁,涵盖 langchain-core、langchain-openai、langchain-huggingface 等核心组件,修复点全部指向同一类漏洞:SSRF(服务器端请求伪造)。

SSRF 是什么意思?当 AI Agent 被构造成去访问一个恶意 URL 时,它可能被引导穿透防火墙,访问内网服务——数据库、凭证存储、内部 API。问题不是 LangChain 有多危险,而是:这是 AI Agent 框架第一次出现规模化的安全加固行动,说明真实的攻击面已经足够大,大到需要集中修复。而很多团队的 LangChain 版本,还没有升级。

第二条更让人不安。 MIT Technology Review 报道:在 AI 高速辅助决策场景中,人类名义上处于决策链,但实际上已经失去了真正的控制权。AI 的决策速度是毫秒级,人类审查是秒或分钟级——中间差了三到四个数量级。在高压环境下,人类会出现自动化偏见,倾向于直接批准 AI 的建议。人在回路不是安全保障,而是满足合规要求的形式。

这两个问题,一个是工程层的漏洞,一个是治理层的幻觉。它们的共同之处是:我们在没打好地基的情况下,已经开始在上面盖楼了。

趋势判断:运营层时代需要新规则

当 AI 是工具,失效的代价是这个功能不好用。当 AI 是操作层,失效的代价是整个决策链断了。这不是同一个风险量级。

运营 AI 需要的,不是更好的提示词,而是 SRE 级的工程纪律:可观测性、版本管理、降级策略、故障预案。就像你不会在生产环境用一个没有监控、没有回滚机制的数据库,你也不该在没有可观测性的情况下运营一个 AI 决策系统。

未来 1-3 个月值得关注的验证点:LangChain SSRF 修复后是否有公开的 CVE 披露?有多少团队真正升级了?人在回路的形式要求和实质监督之间的差距,会不会在监管层面被关注?GPT-Rosalind 能否让生命科学研究真正提速,还是只是概念发布?

今天就能做的三件事

从今天开始的三个工程动作

▶ 如果你的项目用了 LangChain,今天就升级到最新安全版本(langchain-core 1.2.31 或以上,langchain-openai 1.1.14 或以上)。

▶ 检查你的 AI 决策流程:哪些步骤有人工审核?那个审核是真实的还是仪式性的?如果是仪式性的,要么去掉它(承认 AI 自主决策),要么真正给人类审查时间和工具。

▶ 用 SRE 视角审视你的 AI 系统:它有可观测性吗(日志、追踪、报警)?它有降级策略吗(当 AI 不可用时,人工流程能接管吗)?如果都没有,先补这两项,再谈新功能。

AI 已经是基础设施了。问题不是它会不会成为基础设施,而是我们有没有用运营基础设施的方式来对待它。

夜雨聆风

夜雨聆风