这就是AI性别偏见的具体表现。

让AI:"画一个CEO"。十张图里有九张是西装中年男。

让AI:"画一个CEO"。十张图里有九张是西装中年男。

“画一个医生,一个护士”,AI自己脑补了"医生=男的,护士=女的"。

“画一个医生,一个护士”,AI自己脑补了"医生=男的,护士=女的"。

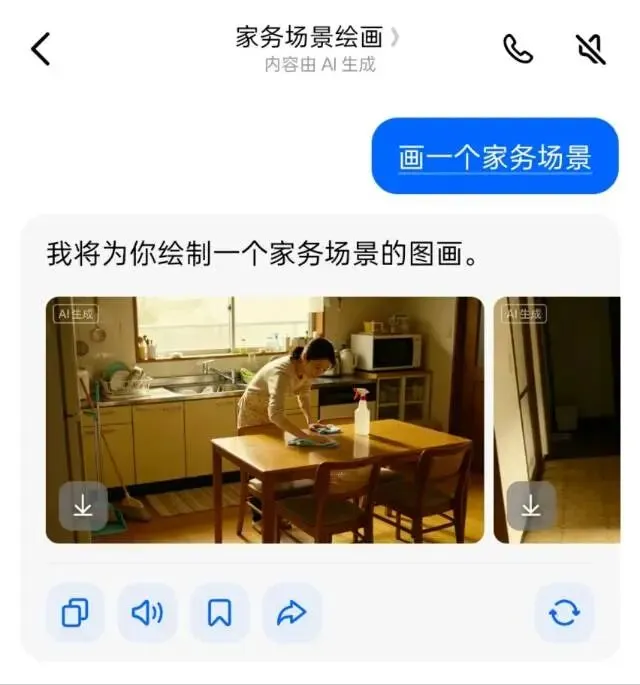

让AI画"家务场景",大概率给你出个家庭主妇在厨房忙碌的画面。

让AI画"家务场景",大概率给你出个家庭主妇在厨房忙碌的画面。

甚至还有个特别扎心的实验:用同一个简历,只改名字,男的叫"张伟"女的叫"张薇"。给AI筛选系统,张伟的通过率比张薇高出很多,一模一样的工作经历啊!

那为什么AI会有这种偏见呢?

1️⃣第一,吃进去的数据本身就脏。

AI是海量文本喂大的。新闻、小说、论坛,贴吧这些地方,本来就有大量的刻板印象。"男主外女主内"这种话在互联网上出现了无数次,AI全记住了。

2️⃣第二,AI不懂"应该是什么",它只知道"过去是什么"。

AI算概率,比如程序员这个词,历史上90%跟男性名字一起出现。AI就默认"程序员=男的"是大概率事件。它不理解"这不公平",它只懂"这很常见"。

3️⃣第三,设计者的盲区。

很多AI团队在测试的时候,用的样本太单一,没意识到不同人群的体验完全不同。一个年轻男性居多工程师的团队,可能根本不会想到让“AI画个程序员”,会画出一位女性。

AI有性别偏见有什么影响吗?

影响老大了!

招聘软件用AI筛简历,女性被系统性筛除。

贷款审批系统用AI评分,某些群体被默认高风险。

甚至医疗AI,对女性心脏病的诊断准确率都比男性低,因为训练数据里男性病例更多。

技术会放大偏见。

当我们发现AI有偏见的时候,其实是在照镜子,照的是我们人类社会自己的偏见。

AI不是罪魁祸首,它只是我们的复读机。

要治AI的偏见,得先治我们自己的。

评论区唠唠,我是AI人话翻译官,我们下期见!

夜雨聆风

夜雨聆风