来源期刊: JMIR Medical Informatics, 2026, Vol. 14, e85270

摘要

本研究通过覆盖全国29个省级行政单元、4024名在职医生的横断面调查,系统评估了中国医生对AI医疗工具的接受意愿。结果显示,各亚组接受率均超90%,组织支持(医院积极推广AI)与感知临床价值是最核心驱动因素。研究融合扩展UTAUT模型与可解释机器学习,为医疗AI实施策略提供了循证依据。

原文PDF和中文解读PPT可通过 https://t.zsxq.com/34vuJ 或者文末阅读原文获取

详细内容

一、研究背景:AI浪潮下的医疗变革

人工智能(AI)正在深刻重塑全球医疗服务格局。从医学影像分析、临床决策支持,到慢性病管理,AI的应用场景日益广泛。 基于深度学习的卷积神经网络已在影像诊断领域展现出超越人类专家的性能;研究表明,AI医疗工具可将诊断时间缩短约30%,并将准确率提升约10%,在肿瘤学和心血管医学领域表现尤为突出。

近年来,大型语言模型(LLM)的崛起进一步拓展了AI在医疗领域的应用边界。ChatGPT、谷歌的Med-PaLM,以及国内的DeepSeek、豆包(字节跳动)等系统,在生成病历文书、翻译医学文献、辅助临床决策、促进医患沟通等方面展现出显著潜力。在中国,AI工具在影像分析和决策支持领域的应用持续增长,尤其集中于三级医院。

然而,算法偏见、数据隐私与问责机制等问题,始终是AI大规模落地的核心障碍,而医生的接受意愿,则被视为成功推进AI实施的关键变量。

二、全球视野:中西方医生态度的分野

放眼全球,医生对AI医疗工具的态度呈现出复杂的地域差异。

- 西方国家

:约半数医生认可AI在提升诊断效率方面的潜力,但对隐私保护和伦理问题存有顾虑;在英国,部分医生因缺乏系统培训而拒绝使用AI影像工具;算法偏见(如种族性诊断偏差)进一步侵蚀了医生对AI的信任。 - 日本

:一项小规模调查显示,较高的学习成本是AI医疗工具普及的重要障碍。 - 体制差异

:西方国家以私立医疗体系为主,医生享有更高自主权、更丰富的资源和较短的工时(约40小时/周);而中国以公立医疗体系为主,医生周工时往往超过50小时,工作负荷与自主空间差异显著。

更值得关注的是,现有中国研究大多为区域性或小规模研究,缺乏全国代表性数据,且鲜有整合可解释机器学习方法的尝试。 这一空白,正是本研究的出发点与核心价值所在。

三、理论框架:扩展的UTAUT模型

本研究以"统一技术接受与使用理论"(UTAUT)为核心分析框架,并在此基础上进行了本土化扩展。 UTAUT最初由Venkatesh等人提出,通过整合多个技术接受理论,将"社会影响(SI)"、"便利条件(FC)"和"风险感知"等维度纳入分析框架,较传统技术接受模型(TAM)更具解释力。

然而,既有UTAUT研究主要在西方医疗语境中开展,未能充分回应中国公立医疗体系的特殊挑战——高工作负荷与相对有限的医生自主权。此外,AI的"正面影响"维度(如提升效率、改善诊断精度、强化医患关系)此前未被系统纳入UTAUT框架。

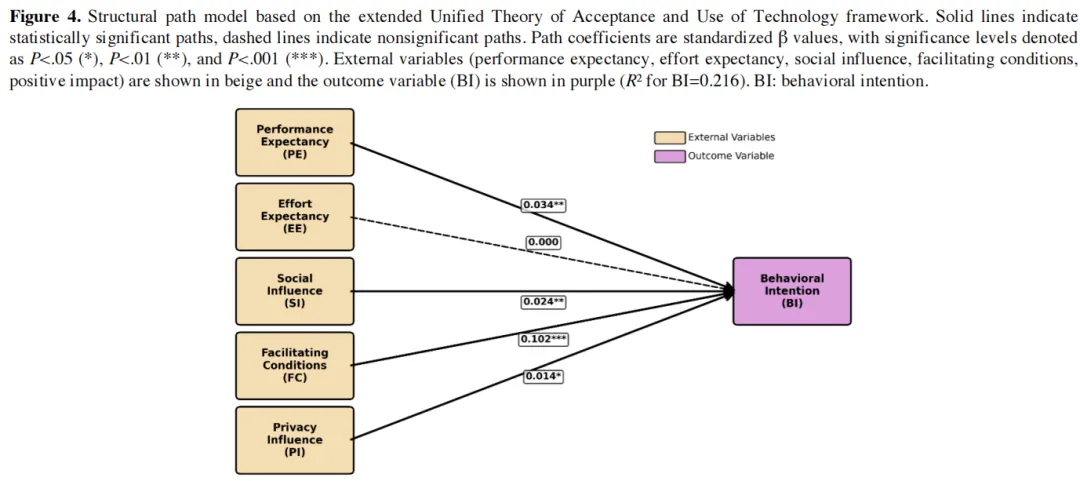

为此,本研究在原有四大维度(绩效预期PE、努力预期EE、社会影响SI、便利条件FC)基础上,新增"正面影响(PI)"构念,专门捕捉医生对AI临床收益的感知评估,形成扩展的五维UTAUT模型。

五大核心构念说明:

四、研究设计:全国横断面调查

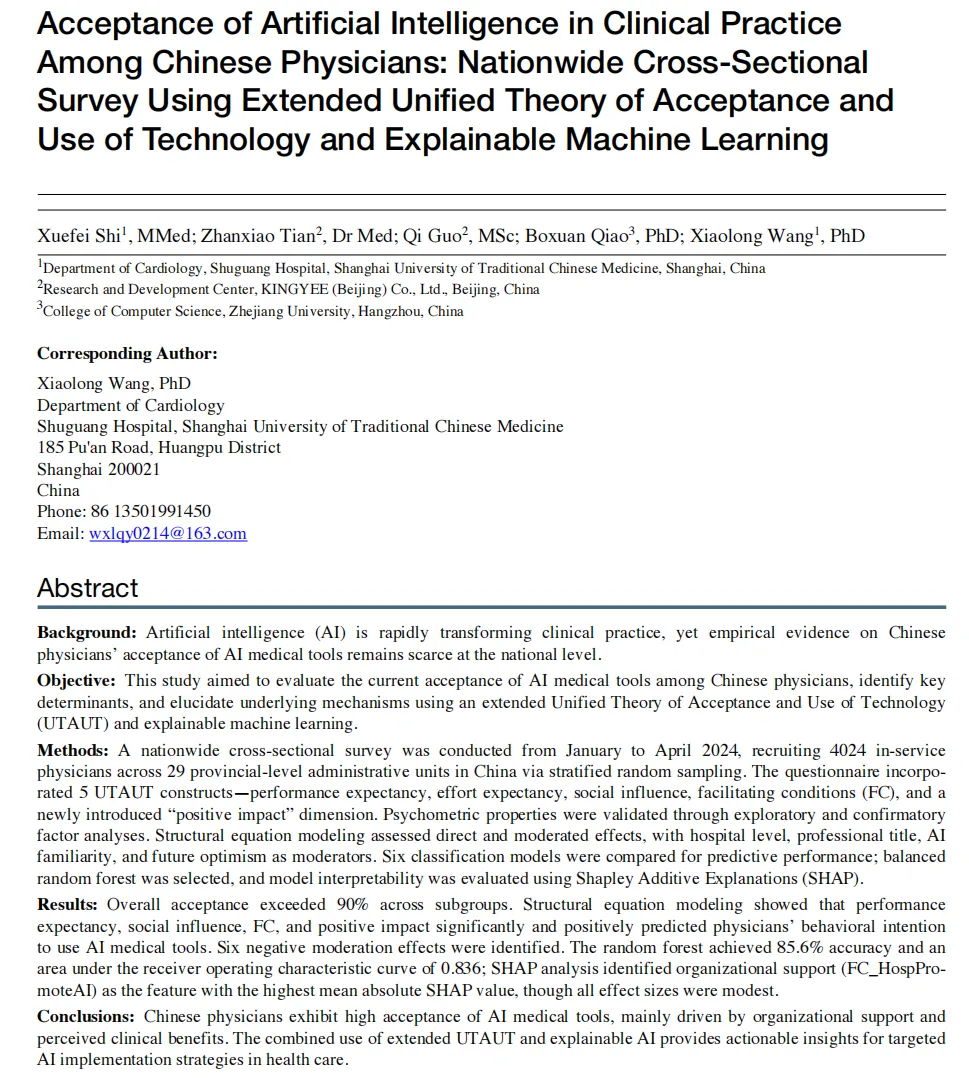

调查基本信息:

- 调查时间

:2024年1月至4月 - 样本规模

:4024名在职医生 - 覆盖范围

:中国29个省级行政单元 - 抽样方式

:分层随机抽样,确保样本的全国代表性

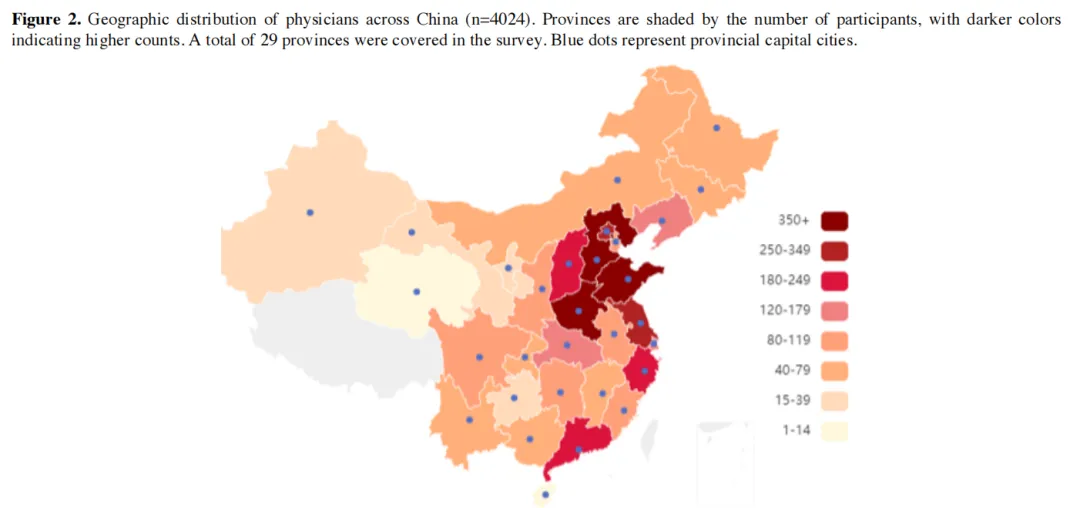

问卷在验证心理测量属性方面,综合运用了探索性因子分析与验证性因子分析;在结构模型分析中,以医院等级、职称、AI熟悉度和未来乐观倾向作为调节变量,通过结构方程模型(SEM)检验直接效应与调节效应。

在机器学习模型选择上,研究团队比较了六种分类模型的预测性能,最终选用平衡随机森林(Balanced Random Forest),并采用SHAP(Shapley Additive Explanations)方法对模型进行可解释性分析。

五、核心发现一:接受率高达90%以上

研究最引人注目的发现,是中国医生对AI医疗工具的接受意愿之高。 在所有亚组中,接受率均超过90%,呈现出显著的"天花板效应"。

这一数字与西方国家形成鲜明对比。近期多国调查数据显示,北美和欧洲仅有40%至60%的医生表示愿意将AI融入日常临床实践。

如何解读这一差异? 研究者认为,可能的解释包括:

- 真实需求驱动

:中国医生面临高患者量、长工时的结构性压力,对能够提升效率的工具存在务实的开放态度; - 政策导向作用

:中国政府将AI融入医疗系统列为国家战略,政策层面的推动效应显著; - 社会期望偏差

:高接受率也可能部分反映受访者的社会期望偏差,即倾向于给出与主流期待一致的答案; - 量表设计局限

:测量工具可能缺乏足够的区分度,导致方差受限。

研究者特别提醒,高度的意愿表达并不等同于实际使用行为的持续转化。英国的追踪研究发现,尽管医生对AI诊断支持工具持积极态度,但由于工作流程不兼容和法律责任顾虑,实际使用率依然偏低。 这提示我们需要通过纵向监测来评估意愿能否有效转化为持续使用行为。

六、核心发现二:结构方程模型揭示驱动机制

结构模型整体拟合良好(RMSEA=0.043;CFI=0.948;TLI=0.941),共解释行为意向(BI)方差的21.6%。

显著正向预测因素:

- 便利条件 FC

(β=.10,P<.001):最强预测因素,体现医院资源支持和制度保障的核心作用; - 绩效预期 PE

(β=.03,P=.001):医生感知AI能提升工作效率; - 社会影响 SI

(β=.02,P<.001):同事和上级的态度具有传导效应; - 正面影响 PI

(β=.01,P=.047):对患者结局改善和医患关系增进的预期。

不显著因素:

- 努力预期 EE

(β≈0,P=.99):使用难易程度对接受意愿几乎没有影响。

这一结果意味着,在当前中国医疗AI推广语境下,医生更关心"AI有没有用"和"医院支不支持",而不太担心"AI难不难学"。

六项负向调节效应

研究还发现了六项显著的负向调节效应(见下表),表明以下背景变量在更高水平时,会削弱相应主效应的强度:

解读: 医院等级越高、AI熟悉度越强、未来乐观度越高的医生,其行为意向对便利条件和努力预期的依赖程度反而更低。这意味着,随着医生经验的积累和自信心的增强,他们对外部制度支撑的依赖会逐渐降低。

七、核心发现三:可解释机器学习揭示关键特征

在六种机器学习模型中,梯度提升(GB)和逻辑回归(LR)均以0.840的AUC并列最优,随机森林(RF)以0.836位居第三。综合考虑性能与平衡性,研究最终选择平衡随机森林进行SHAP解释分析,整体准确率达85.6%。

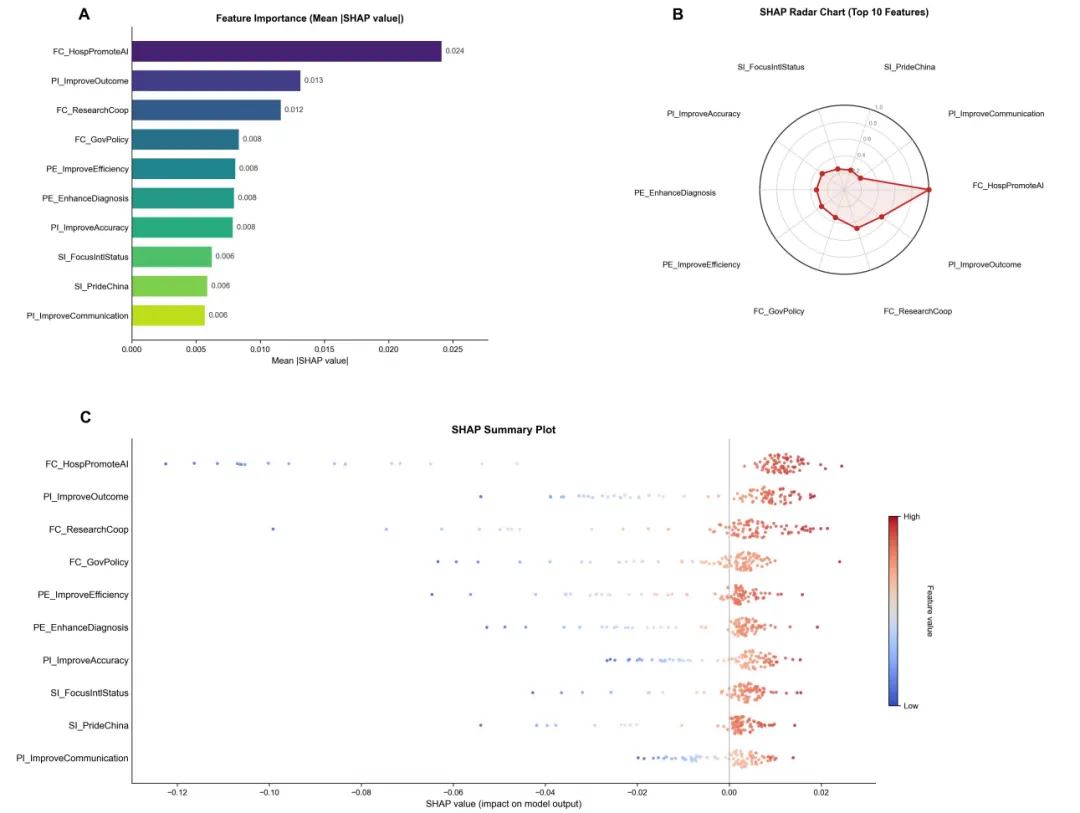

SHAP分析结果——特征重要性排名(Top 10):

图A为横向条形图,展示Top 10特征的平均绝对SHAP值;B图为雷达图,对比各特征相对重要性;C图为SHAP摘要图,展示特征影响的方向与分布。

Top 10特征与含义(按重要性排序):

| 排名 | 特征代码 | 中文含义 | 平均|SHAP|值(约) ||------|---------|---------|-----------------|| 1 | FC_HospPromoteAI | 医院应积极推广AI医疗工具的使用 | ~0.024 || 2 | PI_ImproveOutcome | AI能帮助改善患者临床结局 | ~0.012 || 3 | FC_ResearchCoop | 研究机构应加强AI相关研究与合作 | ~0.011 || 4 | FC_GovPolicy | 政府应出台政策促进医疗AI应用 | ~0.009 || 5 | PE_ImproveEfficiency | AI医疗工具能提升医疗效率 | ~0.008 || 6 | PE_EnhanceDiagnosis | AI医疗工具能增强医生诊断能力 | ~0.007 || 7 | PI_ImproveAccuracy | AI能提高诊断准确性 | ~0.006 || 8 | SI_FocusIntlStatus | 我关注中国在医疗AI领域的国际地位 | ~0.004 || 9 | SI_PrideChina | 我为中国在医疗AI领域的快速发展感到自豪 | ~0.003 || 10 | PI_ImproveCommunication | AI能帮助改善医患沟通 | ~0.002 |

SHAP摘要图进一步揭示了特征影响的方向:对于绝大多数特征(如FC_HospPromoteAI、PI_ImproveOutcome等),较高的特征值(红色点)与正向SHAP值相关,即更高的预测接受概率;较低的特征值(蓝色点)则与负向SHAP值相关,降低预测接受概率。

核心结论: 医院组织对AI的积极推广(FC_HospPromoteAI)是预测医生高度接受AI的最重要单一特征,其影响力远超其他因素,尽管所有特征的效应量总体偏小(受天花板效应制约)。

八、SEM与机器学习的交叉验证

本研究的方法论亮点之一,在于将结构方程模型(SEM)与机器学习(ML)进行互补验证:

- SEM层面

:FC(β=.10)是UTAUT框架中对行为意向预测力最强的潜变量; - SHAP层面

:FC_HospPromoteAI(医院组织推广AI)被识别为预测高接受度最重要的条目级特征(均值|SHAP|=0.024)。

两种方法的高度一致性,为"优先强化机构推广与领导背书"的干预建议提供了双重实证支撑。此外,SHAP分析还揭示,二级医院中具有中等AI熟悉度的医生,对组织支持的响应模式可能与三级医院医生存在差异,提示分亚组定制实施策略的必要性。

九、政策启示与实践建议

基于上述实证发现,研究提出三项具体政策建议:

1. 建立医院级AI治理机制

FC_HospPromoteAI在SHAP分析中的主导地位表明,机构背书比个体因素更具影响力。政策层面应推动在医院部署AI前,建立院级AI治理委员会,确保领导层的明确承诺。

2. 分阶段调整支持策略

AI熟悉度对FC→BI路径的负向调节效应(β=-.024)揭示:随着医生经验积累,对组织支持的依赖会减弱。这意味着AI推广策略应随阶段演进——初期:强化机构背书与系统培训;成熟期:转向同伴知识共享与自主探索,适当减少自上而下的行政推力。

3. 聚焦实际使用而非意愿提升

普遍超过90%的高接受率表明,当前的主要挑战不在于说服医生"想用"AI,而在于如何确保AI工具切实融入临床工作流程、产生可量化的临床收益。针对低接受意向群体,决策者可参考SHAP分析的提示,优先在组织支持层面和临床证据展示层面发力,而非采用"一刀切"的培训方案。

十、研究局限与展望

本研究也存在若干需要审慎解读的局限性:

- 横断面设计

:仅能反映特定时间点的状态,无法追踪意愿与实际行为之间的转化过程; - 天花板效应

:超过90%的高接受率压缩了预测模型的方差空间,导致所有效应量均偏小; - 社会期望偏差

:问卷自报数据可能受到受访者迎合社会期望的干扰; - 中国特殊性

:研究结论的外推需考虑中国医疗体制的特殊性,不宜直接移植至其他医疗系统。

未来研究方向包括:开展纵向追踪研究,评估意向能否转化为持续使用行为;在多国背景下开展对比研究;以及在更精细的AI应用场景(如大型语言模型的具体临床用途)中分层分析医生态度。

标签:

#AIinHealthcare#PhysicianAcceptance#医疗人工智能#中国医疗#UTAUT模型#数字健康转型

夜雨聆风

夜雨聆风