各位朋友早上好,你是否察觉AI正在悄悄挖医患关系的墙角?

假设,未来某天你捂着肚子走进医院,接待你的不是白大褂医生,而是一台闪着蓝光的屏幕,屏幕上跳出一行字:“您好,我是AI医生,请描述您的症状。”

你忍着疼说:“右下腹疼,还有点发烧。”

三秒钟后,AI温柔地回复:“根据大数据分析,您有98%的概率是肠胃炎,建议回家多喝热水。”

结果你信了,回家喝了三天热水,最后被家人抬进急诊室——急性阑尾炎,差点穿孔。

别笑,这不是科幻段子。这是目前AI看病的真实水平。

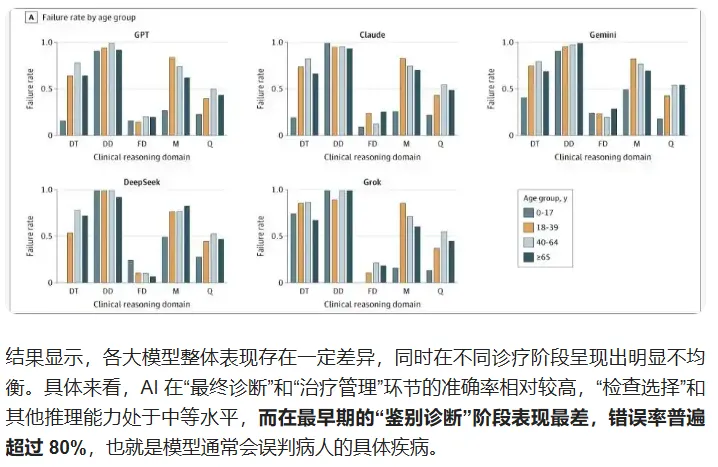

最新数据显示:AI在初步诊断环节的错误率高达80%。也就是说,你去找AI看病,10次里面有8次,它给的第一版诊断是错的。

哪怕你再耐心一点,再给它多提供一些信息——抽个血、拍个片、做个CT——把各种检测结果都喂给它,它的失败率也只能降到40%。

换句话说,即便经过“加试”,AI每看10个病人,依然有4个会被误诊。

这个成绩如果放在医学院,基本属于“建议转专业”的水平。

AI看病,到底差在哪儿?

你可能会问:AI不是能读几百万篇论文吗?不是能记住所有罕见病吗?怎么连个普通感冒都搞不定?

问题就出在这儿。AI确实是个“学霸”,记忆力超强,但它是个不会举一反三的学霸。

举个真实的例子:同样是“发烧+咳嗽”,可能是普通感冒,可能是流感,可能是肺炎,可能是肺结核,甚至可能是肺癌早期。人类医生会怎么判断?他会看你有没有接触过病人,会听你咳嗽的声音是干咳还是湿咳,会问你发烧是白天烧还是晚上烧,甚至可能注意到你说话时有气无力、嘴唇发紫——这些信息,AI统统拿不到。

AI能拿到的,只有你输入的那几个关键词。你少说一个症状,它就少一条线索。而人类最擅长的,恰恰是描述不清自己的病情——“医生,我就是感觉不太得劲”这句话,任何一个AI听到都会死机。

更麻烦的是,AI没有“临床直觉”。老医生看多了病人,有时候病人一进门,他就能看出大概。这不是玄学,而是经验和直觉的结晶。AI没有直觉,它只有概率。它会在统计学上最可能的诊断上押注,但医学最可怕的地方恰恰在于——最可能的答案,往往不是最危险的答案。

把普通感冒当成肺炎,最多是让你白担心一场;把早期肺癌当成普通感冒,那后果谁担得起?

医患关系,正在被AI悄悄“挖墙脚”

AI看病不准,影响的不仅是你的身体,还有你和医生之间的那点脆弱的信任。

想象一下这个场景:你习惯性地打开手机上的AI问诊App,输入症状,AI说你是“轻度胃炎,建议吃奥美拉唑”。你不放心,跑去医院挂了号。医生看了看你,问了几个问题,摸了摸肚子,说:“我觉得不像胃炎,更像是胆囊的问题,先做个B超吧。”

你会怎么想?你会不会在心里嘀咕:“这医生是不是想多开检查多赚钱?人家AI说得清清楚楚,他非要折腾。”

你看,矛盾就这么来了。AI的80%错误率,在患者眼里反而成了“确定性”;医生的临床判断,反而被当成了“过度医疗”。这不是患者的错,而是AI给了人一种虚假的安全感——它说话太肯定了,语气太像权威了,结果太“像那么回事”了。

反过来,如果医生真的图省事,直接采纳了AI的诊断结果,那就更糟了。一个本来需要仔细鉴别诊断的病例,被AI“带偏”,医生也懒得复核,最后患者倒霉。这种“人机合谋”的医疗事故,责任算谁的?算AI的?算医生的?还是算医院的?目前没有任何一条法律能回答这个问题。

AI不是神医,但可以是个好助理

说了这么多,并不是要把AI一棍子打死。AI在医疗领域确实有用,只是作用被吹得太大了。

AI擅长的,是那些重复、标准、不需要动脑子的事。 比如看一张胸片有没有结节,比如数一数心电图上的波形有没有异常,比如提醒医生“这个药和那个药不能一起吃”。这些活儿AI干得很好,因为它本质上是模式匹配,不是临床推理。

但真正复杂的诊断——尤其是那种“症状不典型、病因不明、涉及多个系统”的疑难杂症——AI还差得远。80%的初步误诊率就是最好的证明。

所以,正确的姿势不是“用AI取代医生”,而是“用AI帮医生省点时间”。 让AI去干那些枯燥的筛选工作,把医生从重复劳动中解放出来,让他们有更多时间去问诊、去思考、去和患者好好说话。这才是AI在医疗领域最现实的出路。

至于看病这件事,至少在可预见的未来,你还是得找那个穿着白大褂、会皱眉、会叹气、会跟你说“别紧张,没事的”的真人医生。

因为只有活人,才懂得另一个活人的痛苦。 而AI,连“痛苦”是什么感觉都不知道。

回归常识:技术是工具,不是神

80%和40%,这两个数字应该成为一记警钟。它们提醒我们:在医疗这个关乎生命的领域,没有捷径可走。AI可以是一个优秀的助手,但它远未准备好成为决策者。

真正的进步,不是用机器取代医生,而是用技术赋能医生——让AI处理那些重复性、机械性的工作,把医生解放出来,把更多时间还给患者,用于倾听、沟通和人文关怀。医患关系的核心从来不是数据交换,而是信任与共情。这份信任,是算法永远无法计算的。

往期精彩回顾:

夜雨聆风

夜雨聆风