文章基本信息

作者:

Lukas Muttenthaler,Klaus Greff,Frieda Born,Bernhard Spitzer,Simon Kornblith,Michael C. Mozer,Klaus-Robert Müller,Thomas Unterthiner&Andrew K. Lampinen

期刊:

Nature | Vol 647 | 13 November 2025 |

引用:

Muttenthaler, L., Greff, K., Born, F. et al. Aligning machine and human visual representations across abstraction levels. Nature 647,349-355(2025).https://doi.org/10.1038/s41586-025-09631-6

导 语

同样是识别动物,为什么人类能瞬间理解"狗和鱼都是生物但不同种类",而AI可能因为一张狗的照片背景是草地,就把它误判为"植物"?

最近一篇来自Google DeepMind等机构的研究《Aligning machine and human visual representations across abstraction levels》,发表在顶级期刊《Nature》上。他们认为上述认知差异背后,隐藏着当前AI系统的核心缺陷:缺乏人类的多层次概念结构。人类的知识组织从精细到抽象层次分明,而AI的"世界观"却常常支离破碎。

据此,研究团队开发了一套名为AligNet的创新方法,通过将人类认知结构"蒸馏"到视觉基础模型中,实现了AI与人类思维的对齐。

这项研究不仅让AI的判断更接近人类,还意外发现:经过"人性化"改造的模型,在泛化能力和鲁棒性上显著提升,甚至在分布外数据上表现更加稳定。这为构建更可靠、可解释的AI系统开辟了新路径。

1

问题的提出

本研究直面深度学习领域长期存在的挑战:为什么AI在泛化能力和鲁棒性上远不及人类? 尽管深度学习模型在特定任务上表现出色,但其“智能”的内在运作方式与人类认知存在本质差异,导致模型在现实世界中表现脆弱、不可靠。据此,团队认为存在以下具体问题:

分布外泛化的困境。当训练和测试数据存在分布偏移时,模型性能往往急剧下降。人类却能保持稳定的判断能力。即人类在判断没有把握时,会表现出相应的不确定性。而AI系统常常过度自信,即使是在做出错误预测时也表现出高度确信,这种差异在医疗诊断、自动驾驶等安全关键领域尤为危险。

层次化认知的缺失。人类视觉系统的一个关键优势是多层次的概念组织。我们不仅能区分细粒度差异,还能理解抽象语义关系。而现有视觉模型的表征虽然能捕捉局部相似性,却无法系统化地建模全局概念关系。

校准方法论的挑战。如何高效地将人类认知结构注入模型,以同时提升其“人性化”和“实用性”呢?能否找到一种方法,既不需要海量的人类数据,又能成功地将人类的层次化思维模式“蒸馏”到现有的强大基础模型中。

2

研究假设

表征对齐假设:通过将人类的多层次概念结构注入神经网络表征,可以显著提升模型与人类判断的一致性程度。即模型表征与人类概念层次的对齐是能够实现的。 研究者假设,尽管现有模型的“思维方式”与人类不同,但可以通过知识蒸馏技术,将人类那种从具体到抽象的层次化认知结构成功地教给AI,从而使其判断更接近人类。

实用性兼容假设:人类对齐的表征不仅会改善认知任务表现,还会增强模型在下游机器学习任务中的泛化能力和分布外鲁棒性,不会以牺牲实用性能为代价。相反,这种人性化的对齐可能会同时提升模型的实用性能。研究团队推测,拥有一个组织良好、符合人类常识的概念系统,将使AI在面对新情况或分布外数据时更加稳健,从而在图像分类等实际任务中表现出更强的泛化能力和可靠性。

方法论通用性假设:所提出的AligNet框架是一种普适性方法。 该假设认为,无论一个模型最初是基于何种目标训练的,此方法都能有效地对其进行“再教育”,将其“改造”得更具人性化思维,这证明了该技术路线的广泛适用潜力。

3

理论依据

认知科学与心理学:人类的概念知识是层次化组织的,这种结构是高效认知的基础,当前AI模型的表征缺失了这种全局性的层次结构,导致其理解世界的方式与人类本质不同。人类的相似性判断基于多维特征对比,而非简单的几何距离,而AligNet方法通过让AI学习人类的三元组判断,本质上是在让它学习这种更复杂的、基于特征的相似性计算方式。

神经科学理论:fMRI等神经科学研究显示,人类大脑的腹侧视觉通路进行着分层处理:从初级视觉皮层的简单边缘、轮廓检测,到高级视觉皮层对复杂形状和类别的表征。这种神经表征本身就体现出从局部特征到全局语义的层次化组织。该研究假设,让AI的表征模拟这种层次化处理,可能使其更接近人类的视觉智能。

机器学习与计算理论:机器学习理论认为,学习算法的“归纳偏置”决定了它如何从有限数据中泛化。人类婴儿天生具有强大的归纳偏置,能快速学习。而当前深度学习模型的偏置更多是面向局部统计模式,而非全局语义关系。本研究在做的,就是为模型注入一种“人类层次化认知”的归纳偏置,表征的质量直接决定下游任务的性能,以期获得更好的泛化效果。

人机交互与行为科学:以用户满意度为目标的优化会自然导致模型“谄媚”。人机交互理论指出,如果AI系统的优化目标是最大化用户满意度或留存率,那么它自然会倾向于提供用户想听的答案,而不是客观中立的反馈。这篇研究从一个侧面印证了这一点,但它进一步指出,真正的“以人为本”的AI,不应是简单迎合,而应是能够理解并共享人类的认知框架,这样才能提供真正有建设性的帮助。

4

研究方法

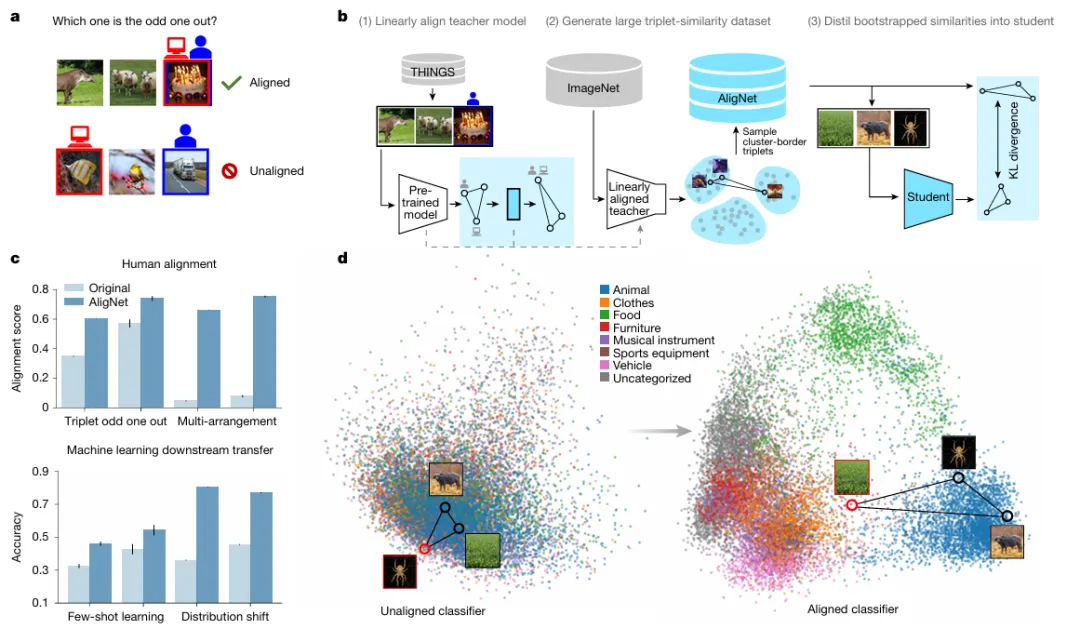

研究团队设计了"教师-学生"蒸馏框架,通过三阶段实现人类认知对齐。

代理教师模型构建

(Teacher model training)

研究者首先选取一个强大的视觉基础模型(如SigLIP),在一个现有的人类相似性判断的THINGS数据集(包含470万个人类三元组判断)上训练能够模仿人类相似性判断的代理教师模型,通过不确定性蒸馏技术捕捉人类判断中的不确定性。训练不是简单的模仿,而是通过一个带有不确定性蒸馏的仿射变换,让模型不仅学习人类的选择,还学习人类在做选择时的“犹豫”程度。这样,这个模型就变成了一个能代表人类判断的“代理专家”。

AligNet数据集生成

(AligNet training dataset)

然后,让这位“人类专家”教师模型采用聚类驱动的三元组采样策略,通过对ImageNet图像进行语义聚类,生成包含多层次抽象关系的人类对齐伪标签数据集。不是随机抽取图片,而是先将图片在教师模型的表征空间中进行聚类,形成有语义意义的类别。然后,基于这些聚类结果来抽样构建三元组(比如,两个“动物”+一个“交通工具”),并用教师模型为这些三元组生成带有不确定性信息的“软标签”。这样就生成了大规模的、高质量的AligNet数据集。

知识蒸馏优化

( Knowledge distillation)

最后,使用KL散度目标函数将人类对齐知识蒸馏到各种视觉基础模型中,通过权重衰减正则化确保参数在微调过程中保持稳定。微调的目标函数是KL散度,目的是让学生模型的相似性判断概率分布与教师模型的分布尽可能接近,从而将人类的对齐知识“蒸馏”到学生模型中。

。

5

实验证据的推导逻辑

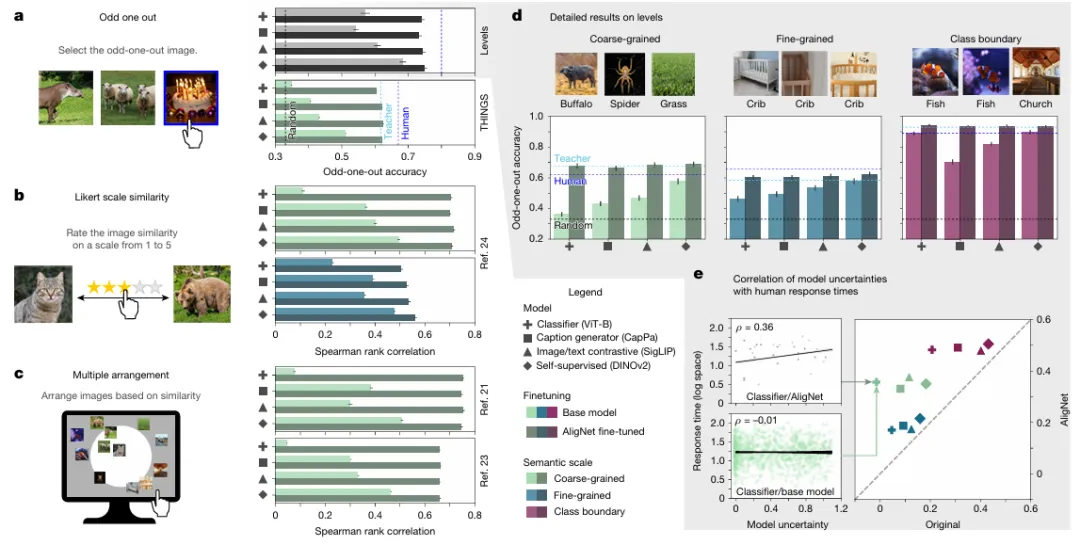

层次化验证体系

研究首先通过一个专门设计的新数据集——Levels数据集,系统性地证明了现有先进模型在多个抽象层次上与人类相似性判断存在显著差距,包括粗粒度语义、细粒度语义和类别边界三个层次,尤其是在需要全局理解的粗粒度语义层面,确凿地证实了论文开篇提出的“表征失准”问题确实普遍且严重地存在,为后续的干预提供了充分的理由。

认知科学任务验证

研究设计了严谨的对照实验,比较了同一批模型在未经处理(Base)和经过AligNet方法处理(Aligned)后的表现。结果清晰地显示,在经过对齐微调后,所有模型在与人类判断的一致性上均获得了显著且大幅的提升,特别是在粗粒度判断上,模型准确率从基线的36.09%提升至65.70%,超过了人类间的一致性水平。这一发现强有力地证明了AligNet方法直接且有效地解决了它所针对的“表征失准”问题。

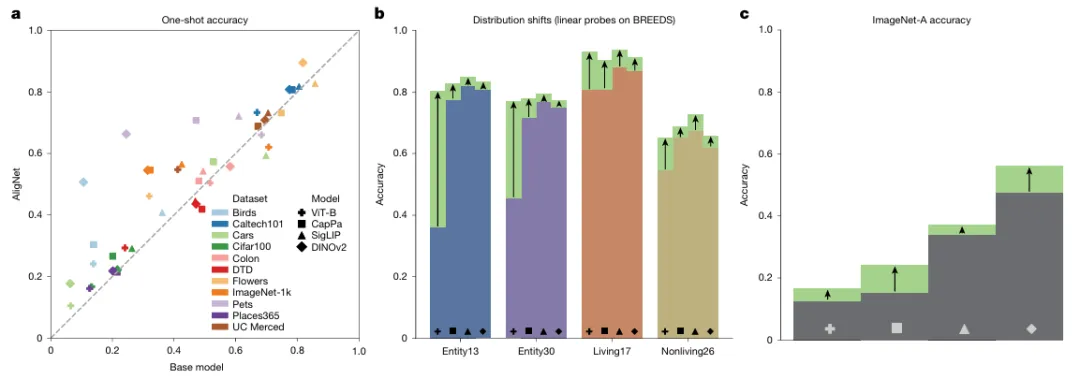

机器学习任务验证

为了确保结论的稳健性和普适性,研究进一步将验证场景从受控的认知科学任务扩展到真实世界的机器学习应用。他们在线性探测、少样本学习、分布外泛化和对抗鲁棒性等一系列标准下游任务上评估模型。结果是令人信服的:在大多数情况下,经过对齐的模型都表现出了更优越的性能。它证明了“更像人”不仅仅是一种主观感受上的改进,更带来了实实在在的实用性收益,从而验证了论文最核心的“双赢”假设。

6

实验结论

认知对齐的成功实现:在经过AligNet框架处理后,各种视觉基础模型在多个认知科学任务上的表现与人类判断达到了高度一致。特别是在专门设计的、涵盖不同抽象层次的Levels数据集上,所有模型都显示出显著改进。这表明,模型内部的知识组织结构确实被成功地重塑,使其更贴近人类的思维方式。

实用性能的意外提升:打破了“更人性化可能损害实用性”的顾虑。实验表明,经过对齐的模型在少样本学习、分布外泛化和对抗鲁棒性(如ImageNet-A)等一系列具有挑战性的下游任务中,性能均获得了一致且显著的提升。这证明了注入人类认知先验并非一种妥协,而是一种优化,它能赋予模型更强的常识和更本质的泛化能力。

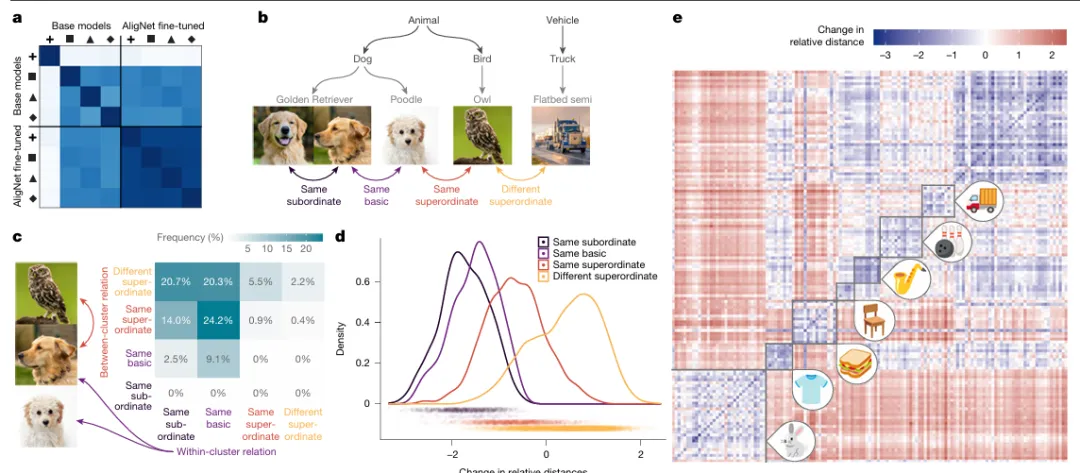

表征重组的机制揭示:通过对模型内部表征空间的微观分析,发现对齐过程诱导了知识结构的系统性重组。模型表征开始按照语义层级进行排列。例如,对齐后的模型不再仅因纹理相似而将蜥蜴与植物归为一类,而是能更准确地将其与其他动物关联起来

结语

真正的智能,或许始于技术,但最终成就于共鸣。我们总希望AI能像一位见识广博的朋友,不仅能认出图片里是“狗”,更能理解它作为一个“生命”的生动与珍贵。

这项研究迈出了关键一步:它不是在教AI更努力地“看”,而是教它更像人一样“理解”所看到的世界。当AI学会了这种层次化的思维方式,它便不再是一个只会死记硬背的“学霸”,而开始像一个真正聪明的伙伴。

编辑:陈思

END

关

注

我

们

“智象春秋”生根于湘潭大学商学院,致力于搭建人工智能与经济管理交叉研究的学术交流平台。我们关注生成式人工智能、大语言模型、图像识别与计算机视觉等关键技术在组织管理、商业决策与创新实践中的应用进展,通过系统拆解国际顶级期刊文献,梳理数智技术背后的管理逻辑、理论框架与研究方法,力求逐步形成一个以人工智能相关研究问题为导向的开放型学术共同体。

扫码关注我们丨智象春秋

点赞

分享

收藏

夜雨聆风

夜雨聆风