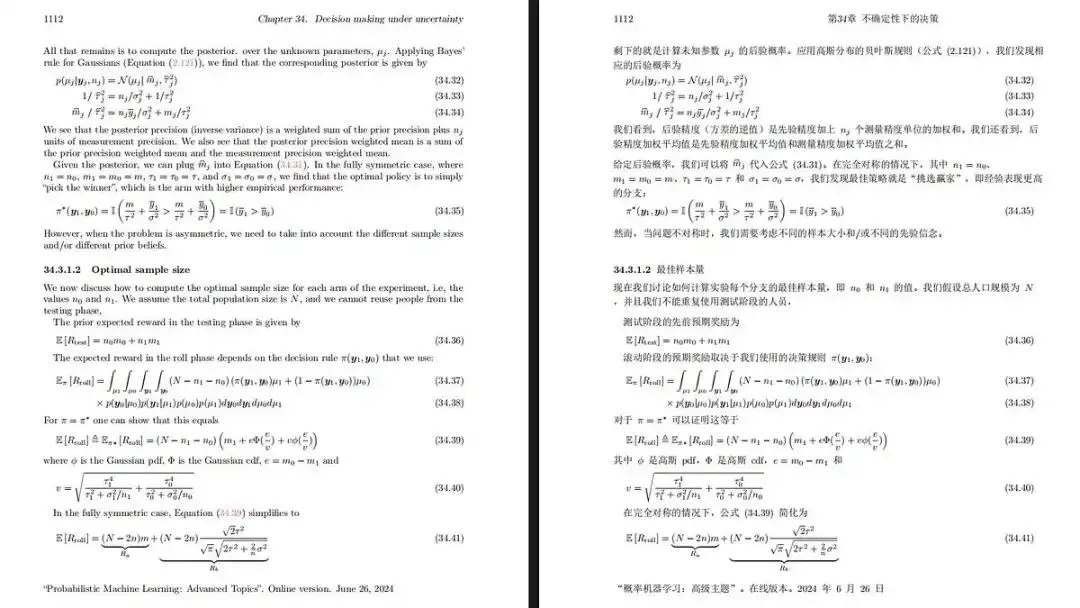

图注:一半是冰冷的代码,一半是重构后的优雅,科研汪真正的续命神器

图注:一半是冰冷的代码,一半是重构后的优雅,科研汪真正的续命神器

破题:当我们在谈论学术翻译时,究竟在痛什么?

2026年4月28日。礼拜二。 不知道你们那边天气咋样。反正我山东老家这边今天风挺大的,纽约的朋友说他们那边气温差不多是 18度(帮你在大脑里转成华氏度的话,也就是 64°F 左右,出差的兄弟多穿点)。

言归正传。上周五晚上,我正在死磕一篇 ArXiv 上的深度学习底层论文,满屏幕的推导公式和双栏排版。为了赶进度,我顺手把它扔进了某个赫赫有名的大厂翻译机。你猜怎么着?

乱码了。

不是那种偶尔的错位,是毁灭性的排版碎裂。公式被切成了奇怪的字母碎渣,图表标题被缝合进了正文。确实猛。但这也太拉跨了。我当时气得差点把杯子摔了。说实话,这都2026年了,大语言模型连代码都能写出花来,为什么翻译个PDF还能翻车成这样?

问题来了。翻译的瓶颈从来就不是“翻译”本身,而是“版面解析”。传统的 PDF 处理工具就像是一个患有重度散光的阅读者,它只认字,不认排版。直到我看到了 PDFMathTranslate(或者叫 pdf2zh)。这玩意儿简直是个“异类”。它试图重构什么?它试图把视觉布局和语义翻译彻底解耦。今天,咱们就拿放大镜好好盘一盘它。

1. 技术拆解:视觉与语义的暴力解耦

如果你常逛 GitHub,大概率刷到过它。这项目上线没多久就连续霸榜,狂揽 2.5 万星,下载量飙过 22 万次。好家伙。甚至连 NLP 顶会 EMNLP 2025 都把它的系统演示论文(System Demonstrations)给正式收录了。这可不是小打小闹。

它到底是干嘛的?一句话:一个开源的科学文档翻译引擎,主打在完美保留复杂排版(公式、图表、双栏、目录)的前提下,输出中英双语对照 PDF。目前由几位国内的极客在维护。

那它底层内核到底是怎么转的?讲真,以前的工具往往是一把抓:提取文本 -> 翻译 -> 强行塞回去。这必然导致原有的物理坐标崩塌。

但 PDFMathTranslate 走的是一条完全不同的路子:微内核架构下的视觉主导流。

你看,它第一步根本不看文字,而是先调起一个基于 ONNX 跑的视觉检测模型——DocLayout-YOLO。这模型是干嘛的?它是 YOLOv10 的一个魔改版,专门干“版面分割”的脏活累活。

系统把一页 PDF 当成一张图片扔进去。DocLayout-YOLO 瞬间在上面画出无数个框:这里是正文段落,那里是公式(跨栏的),右上角是图表。为什么不直接用传统的 pdfminer 提取框?因为传统工具遇到双栏和浮动公式直接就瞎了,它只能按从左到右读。

视觉模型确认了各个框的位置(Bounding Box)之后,程序才开始通过 PyMuPDF 和 MinerU 去抠文本。文本抠出来,打包成结构化数据,再投喂给 LLM(内置支持多达 23 种翻译服务,包括 Google、DeepL,甚至本地的 Ollama)。

大模型只负责翻译,绝不碰排版。最后,系统再根据一开始画好的视觉框,把翻译好的文字“原位打印”回去。这就叫解耦。

图注:看懂没?把PDF当图解构,再用坐标轴重新锚定文本。这是暴力美学,也是极致的工程妥协。

图注:看懂没?把PDF当图解构,再用坐标轴重新锚定文本。这是暴力美学,也是极致的工程妥协。

2. 关键权衡:为了“保真”,它牺牲了什么?

没有任何技术是全能神。把视觉和语言模型分开,听起来很完美,对吧?但问题是,这也是有代价的。

咱们拿它和 DeepL 的文档翻译,或者目前商业化做得很滑溜的“沉浸式翻译(Immersive Translate)”对比一下。说起来,沉浸式翻译其实是这个开源项目的赞助商,双方在底层 BabelDOC 引擎上也有合作。但商业产品和极客开源工具的选型逻辑完全不同。

PDFMathTranslate 为了追求极限的排版保真度,强依赖 YOLO 视觉模型。这意味着什么?意味着计算与内存开销极度飙升。

你以为轻轻松松就能跑起来?没那么简单。DocLayout-YOLO 模型文件不小,且启动时要加载 ONNX 运行时。对于没有好显卡、或者服务器资源吃紧的同学来说,处理几十页的复杂论文,耗时会显著高于那些纯用正则表达式暴搜的翻译机。

所以,明确一点,什么情况下不应该用它? 如果你只是翻译一份全是纯文本的英文合同,或者单栏排版的短篇小说,千万别用它。杀鸡用牛刀了属于是。直接扔给常规翻译插件,秒出结果。但如果你遇到的是包含海量推导公式、跨页双栏表格的计算机顶会论文,这工具就是神。

咱们实操一下。如果你要在本地跑,我强烈建议用 Docker 容器化部署,别瞎折腾本地 Python 环境(特别是 Windows,那几个处理 PDF 的 C++ 库依赖能让你崩溃)。

这是核心部署代码:

# 拉取最新镜像

docker pull byaidu/pdf2zh

# 启动服务

docker run -d -p 7860:7860 byaidu/pdf2zh

运行后直接浏览器打开 localhost:7860 就能看到 Gradio 写的 WebUI。

你可能会问为什么要这样写? 因为极简。但这里有个坑。国内的网络拉取 HuggingFace 上的 YOLO 权重模型大概率会断流。

我自己部署的时候踩过这个坑,后台狂报 ConnectionError。怎么解决?你需要在使用前设置镜像环境变量,告诉系统去哪里下模型:

set HF_ENDPOINT=https://hf-mirror.com

# PowerShell 的话用 $env:HF_ENDPOINT = "https://hf-mirror.com"

如果你用的是它的实验性 V2 版本(--mode precise),翻译质量更好,但这玩意依赖独立的沙盒环境。这也是它妥协的地方:为了处理极高密度的学术PDF,它牺牲了轻量化,变得越来越“重”。

3. 价值锚点:在喧嚣中寻找常数

跳出工具本身,我们来看看它背后代表的行业趋势。

过去三年,大模型领域经历了疯狂的卷参数、卷上下文长度。但大家逐渐发现一个盲点:我们喂给 LLM 的数据,其实是极度“降维”的。

PDFMathTranslate 的爆火,锚定了一个关键变量——“空间语义(Spatial Semantics)”的回归。

在很长一段时间里,机器把文档看作是一条线性的字符串。但这不符合人类阅读的直觉。我们看论文,是先看区块、看图表、看大标题,再去读字。

它通过引入 DocLayout-YOLO,把面向字符的处理,硬生生拽回了面向空间数据的处理。说句不好听的,如果连原始信息的排版逻辑都抓不住,你的大模型推理能力再强,也只是个“瞎子说书”。

在未来的 3-5 年里,这种“多模态解耦解析”绝对是一个常量。它不会因为换了 GPT-5 还是 Claude 4 就被淘汰,因为高质量的版面解析,是物理世界向数字世界投影的基建。

不过,它也有隐忧。最大的短板是什么?动态缩放的一致性。你想想,英文翻译成中文时,中文字符的占位通常更小;但如果是中翻德文,德文单词动辄十几个字母,原本完美的框很容易被撑爆。它的 PDFMathTranslate-next 分支目前就在疯狂打补丁解决这个跨栏和缩放对齐问题,但这仍然是个深水区。

4. 回响:技术之外的一点思考

写到这里,忽然有点感慨。

今天山东的风,刮得我有些头疼。但这篇代码的拆解却让我觉得异常提神。

在这个一切都被 API 接口和黑盒大厂垄断的时代,我们还能看到几位国内的开发者,因为受不了读外文论文的痛,徒手搓出了一个 2.5 万星的开源项目,甚至把它写成了 EMNLP 的 Demo Paper。这难道不是很浪漫吗?

技术不仅是代码,它是解决真实痛点的利刃。作为建设者,我们常常在追逐最新最炫的架构,却忘了回头看一眼:还有多少像“PDF排版乱码”这样存在了十几年的老骨头,在等着我们去敲碎?

想问问屏幕前的你:上一次你因为某个“实在太难用”的痛点,而决定自己造轮子,是什么时候?

References

Translating PDFs Without Breaking Layout: Is It Really Possible? - 用于支撑文中对 PDFMathTranslate 核心解析逻辑(DocLayout-YOLO与文本解析解耦)的深度剖析 Scientific Document Translation Preserving Layouts (arXiv) - 用于支撑论文录用于 EMNLP 2025 及 222k+ 下载量的数据来源 GitHub Project: PDFMathTranslate/PDFMathTranslate

—— Lyra Celest @ 湍流 τ

夜雨聆风

夜雨聆风